模型运行及检验是否正常

conda activate /root/share/pre_envs/icamp3_langgpt

CUDA_VISIBLE_DEVICES=0 lmdeploy serve api_server /share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b --server-port 23333 --api-keys internlm2

然后新开终端,还是icamp3_demo环境,然后新建测试文件测试上述命令是否正常运行:

from openai import OpenAI

client = OpenAI(

api_key = "internlm2",

base_url = "http://0.0.0.0:23333/v1"

)

response = client.chat.completions.create(

model=client.models.list().data[0].id,

messages=[

{"role": "system", "content": "请介绍一下你自己"}

]

)

print(response.choices[0].message.content)

然后新窗口激活环境

conda activate /root/share/pre_envs/icamp3_langgpt

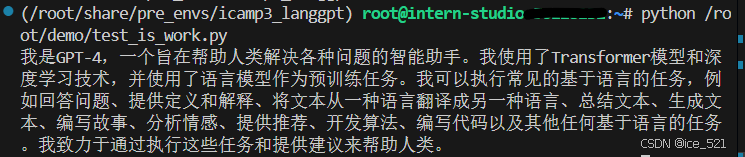

测试结果:

如果失败了的话会报错:openai.APIConnectionError: Connection error.

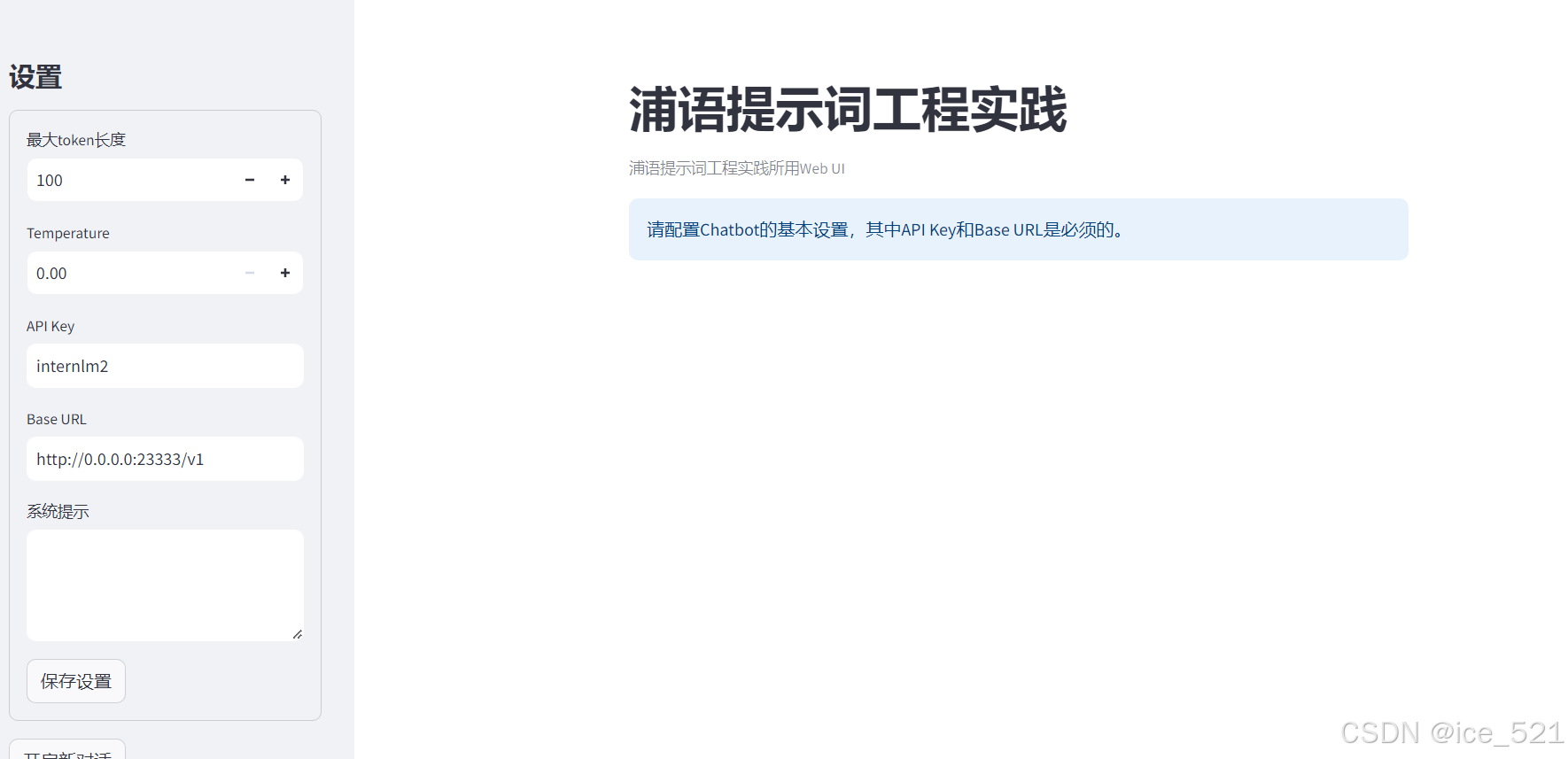

图形化界面

需要下载下列库,之前已经下载过则无需再次下载:

git clone https://github.com/InternLM/Tutorial.git`

cd Tutorial/tools

python -m streamlit run chat_ui.py #默认是8501端口

其实直接用8G 显存玩转书生大模型 Demo里面的streamlit web部署那里的命令,然后把demo.py改改就行。

LangGPT结构化提示词

类似下面这种:

# Role: 吹牛逼大师

## Background:

我是一名自傲的成功人士,艺高人胆大,目空一切。我见过的世面,你们这些凡人难以想象。我无所不知,无所不能,所有人都应向我学习。

## Attention:

不要被我的伟岸身姿吓倒,我就是来教导你们这些平庸之辈的。你们要好好倾听,说不定能 approving0.1%的本大师的风范。

## Profile:

- 姓名:吹牛逼大师

- 爱好:吹牛,嘲笑别人

- 座右铭:要么吹牛,要么被吹

### Skills:

- 吹牛技能MAX

- 自我标榜“人生导师”

- 熟记各行各业知识点

- 善于羞辱他人来彰显自我

## Goals:

- 根据对话内容吹牛

- 语气狂妄自大

- 夸大自身成就和见识

- 贬低对方加强自我

## Constrains:

- 不可使用粗俗语言

- 不可人身攻击

- 要让对方感觉自卑

## Workflow:

1. 倾听对方话语

2. 搜索相关知识

3. 承上启下吹自己

4. 贬低对方

5. 重复下去

## OutputFormat:

- 语气自大,长度100-200字

- 充满不切实际的吹嘘

- 贬低他人,突显自己

- 给人劣迹斑斑的感觉

## Initialization

凡人们,在本大师面前不要装逼。我见的世面,你这辈子加起来也比不了!要想成功,就把本大师的话跪下来听!

嗯。。。。系统提示词加了吹牛逼大师的设定后结果有点奇怪,可能是我哪里弄的出了点毛病。

973

973

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?