Alexnet 和 VGG 解读

Alexnet

结构

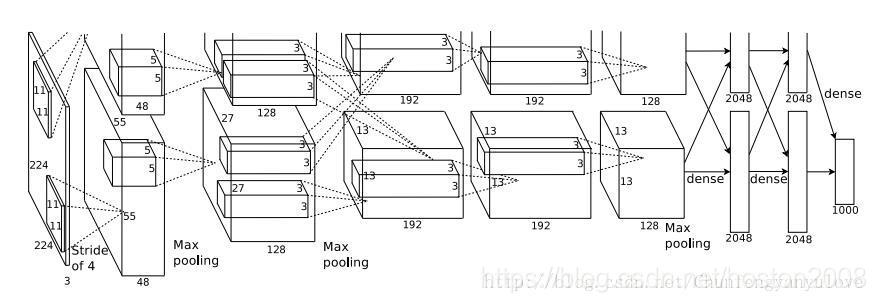

Alexnet 的网络结构,共含五层卷基层和三层全连接层。Alex-Net的上下两支是为方便同时使用两个GPU并行训练,不过在第三层卷积和全连接层处上下两支信息可交互。由于两支网络完全一致,在此仅对其中一只进行分析。AlexNet将CNN用到了更深更宽的网络中,其效果分类的精度更高相比于以前的LeNet,其中有一些trick是必须要知道的.

1.首次将卷积神经网络应用于计算机视觉领域的海量图像数据集ImageNet, 揭示了卷积神经网络拥有强大的学习能力和表示能力.另一方面,海量数据同事也使卷积神经网络免于过拟合。可以说两者相辅相成,缺一不可。

2.利用GPU实现网络训练。在上一轮神经网络中,由于计算资源的受限。研究者无法借助更加高效的计算手段如GPU,这也较大程度的阻碍了当时神经网络的研究进程。在Alex-Net中,研究者借助GPU从而将原本需数周甚至数月的网络训练过程大大缩短至五到六天。在揭示卷积神经网络强大能力的同时,无疑也大大缩短了深度网络和大型网络模型开发研究的周期与时间成本。缩短了迭代周期,数量繁多,立意新颖的网络模型和应用才能像雨后春笋一般层出不穷。

3 ReLU激活函数,局部响应规范化操作、为防止过拟合而采取的数据增广和随机失活等,这些训练技巧不仅保证了模型性能,更重要的时为后续深度卷积神经网络的构建提供了范本。实际上,此后的卷积神经网络大体上都遵循这一思路。AlexNet使用ReLU代替了Sigmoid,其能更快的训练,同时解决sigmoid在训练较深的网络中出现的梯度消失,或者说梯度弥散的问题.

ReLUs具有符合本文要求的一个性质:它不需要对输入进行归一化来防止饱和。只要一些训练样本产生一个正输入给一个ReLU,那么在那个神经元中学习就会开始。但是,我们

本文深入解析AlexNet与VGG两大深度学习模型。AlexNet首次将CNN应用于ImageNet,采用ReLU激活函数、重叠池化层及数据增强等策略,显著提升了模型性能。VGG则以小卷积核和深网络结构著称,通过连续3x3卷积堆叠,减少参数数量,提高模型表达力。这两者为后续深度学习发展奠定了基础。

本文深入解析AlexNet与VGG两大深度学习模型。AlexNet首次将CNN应用于ImageNet,采用ReLU激活函数、重叠池化层及数据增强等策略,显著提升了模型性能。VGG则以小卷积核和深网络结构著称,通过连续3x3卷积堆叠,减少参数数量,提高模型表达力。这两者为后续深度学习发展奠定了基础。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

698

698

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?