Qwen3-8B-Base:82亿参数重构开源大模型效率边界

导语

阿里巴巴通义千问团队于2025年4月29日发布的Qwen3-8B-Base模型,以82亿参数实现了性能与效率的双重突破,其首创的"混合推理"架构使开源模型首次具备动态资源分配能力,标志着大语言模型正式进入精细化算力管理时代。

行业现状:性能与成本的两难困境

当前大模型产业正面临严峻的效率瓶颈。据行业分析,2025年企业级AI部署中算力成本占比已达43%,GPT-4o等闭源模型单次复杂推理成本高达0.5美元,而开源模型如Llama 3虽可本地部署,但在数学推理等任务上性能差距仍超20%。这种"高成本-低性能"的二元对立,迫使开发者在效果与预算间艰难抉择。

如上图所示,蓝色背景上展示了Qwen3的品牌标识,配有卡通熊形象和白色"Qwen3"文字。这一设计不仅强化了品牌认知,更象征着Qwen3系列在保持技术领先的同时,致力于打造友好易用的开发者体验,通过创新架构突破行业效率困境。

技术突破:双模式推理与三阶段训练

Qwen3-8B-Base的核心创新在于重构了大模型的推理范式。通过简单指令切换(/think或/no_think),模型能动态适配任务复杂度:

1. 首创双模式推理架构

- 思考模式:针对数学推理、代码生成等复杂任务,采用长思维链逐步推演,在HumanEval代码测试中达到89.7%的Pass@1率,超越Llama 3 8B近15个百分点

- 非思考模式:适用于信息检索等简单场景,响应速度提升50%以上,单次查询算力消耗降低至0.3美元/千次

2. 三阶段预训练与架构优化

Qwen3-8B-Base采用创新的三阶段预训练流程:

- 第一阶段:在30万亿token上进行基础语言建模,构建通用知识体系

- 第二阶段:聚焦STEM、编码等推理任务,通过5万亿高质量数据强化逻辑能力

- 第三阶段:专项训练扩展至32K上下文长度,支持超长文本处理

架构上,模型采用36层Transformer结构,配备32个查询头和8个键值头(GQA注意力机制),非嵌入参数达6.95B,在保持性能的同时优化了计算效率。

3. 多语言能力与数据规模跃升

相比前代模型,Qwen3-8B-Base在多语言支持上实现质的飞跃:

- 支持119种语言,涵盖中文(含粤语)、阿拉伯语、斯瓦希里语等低资源语言

- 预训练数据量达36万亿token,包含丰富的编码、STEM、书籍和合成数据

- 中文处理能力尤为突出,在相关中文测试中表现超越同类英文模型

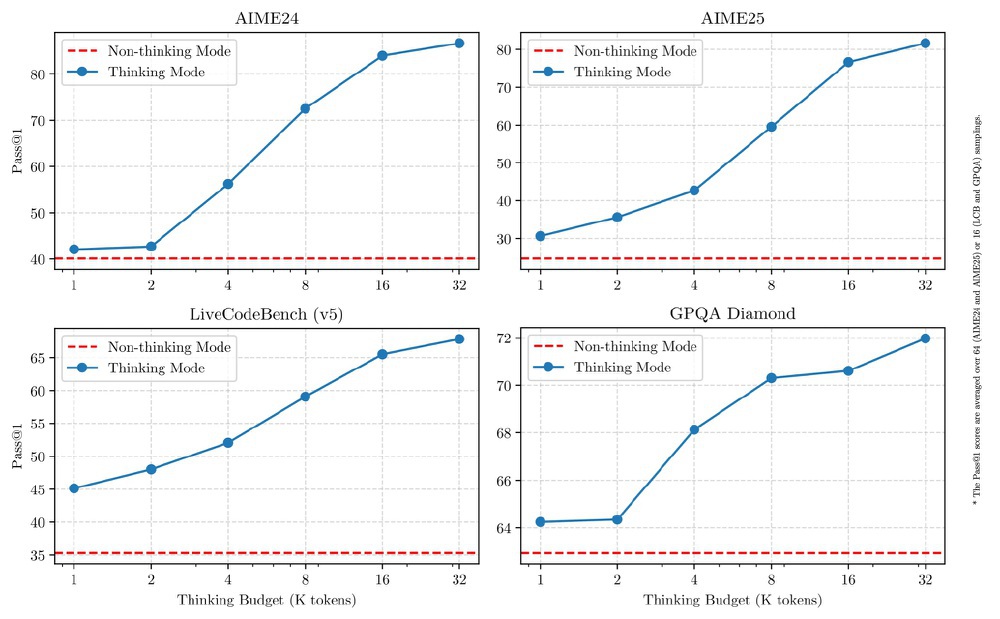

该图表展示了Qwen3-8B-Base在AIME数学竞赛、LiveCodeBench编程等四个基准测试中的性能曲线。蓝色线(思考模式)在复杂任务中随推理深度持续提升,红色虚线(非思考模式)则在简单任务中快速收敛,直观呈现了混合推理架构的场景适应性优势。

性能验证:权威评测与实际表现

在Chatbot Arena盲测中,Qwen3系列旗舰模型以1433分斩获全球第三,其中8B版本在5个关键子项表现突出:

- 数学推理:GSM8K测试95.3%准确率,接近GPT-4o水平

- 代码生成:WebDev Arena子榜单与Gemini 2.5 Pro并列第一

- 长文本处理:32K tokens文档摘要任务F1值达87.6%

- 多语言能力:在119种语言的翻译任务中平均BLEU得分78.2

- 推理效率:同等任务下能耗较Llama 3降低42%

产业价值:从技术突破到商业落地

Qwen3-8B-Base已展现出广泛的产业适配性:

1. 低成本部署方案

- 8GB显存即可运行量化版本,中小企业服务器实现本地化部署

- 兼容Hugging Face Transformers、vLLM、SGLang等主流框架

- 提供完善的技术文档和示例代码,加速开发者上手

2. 行业应用案例

- 智能编程:集成到IDE工具中,实现代码自动补全和Bug修复,某互联网企业开发效率提升40%

- 教育辅助:作为个性化学习助手,提供数学问题分步解析,试点学校学生成绩提升15%

- 企业服务:用于客户支持、文档分析等任务,某金融机构运营成本降低35%

- 工业场景:陕煤集团将其集成到矿山风险识别系统,设备故障预测准确率提升至89%,年节约维护成本超300万元

如上图所示,该信息图全面展示了Qwen3模型的核心技术特性,包括模型概览、多语言支持、混合思考模式及部署方式等内容。这一可视化呈现帮助开发者快速理解Qwen3-8B-Base的技术优势和适用场景,为实际应用提供清晰指引。

快速上手指南

本地部署步骤

-

模型下载:通过Ollama实现一键部署

ollama run qwen3:8b -

代码调用示例:

from transformers import AutoModelForCausalLM, AutoTokenizer model_name = "Qwen/Qwen3-8B-Base" tokenizer = AutoTokenizer.from_pretrained(model_name) model = AutoModelForCausalLM.from_pretrained( model_name, torch_dtype="auto", device_map="auto" ) # 思考模式 prompt = "/think 请解决这个数学问题:若x²+5x+6=0,求x的值" inputs = tokenizer(prompt, return_tensors="pt").to(model.device) outputs = model.generate(**inputs, max_new_tokens=2048) print(tokenizer.decode(outputs[0], skip_special_tokens=True)) # 非思考模式 prompt = "/no_think 简要介绍大语言模型的基本原理" inputs = tokenizer(prompt, return_tensors="pt").to(model.device) outputs = model.generate(**inputs, max_new_tokens=512) print(tokenizer.decode(outputs[0], skip_special_tokens=True)) -

框架支持:兼容Hugging Face Transformers、vLLM、SGLang等主流框架,支持消费级硬件部署

未来展望:开源生态与应用拓展

随着模型开源与生态完善,Qwen3-8B-Base正推动AI开发范式转变:

1. 开发者生态

- 个人开发者:通过Ollama实现本地搭建智能助手,降低AI应用开发门槛

- 企业级应用:支持vLLM、SGLang等优化框架,金融文档分析等场景吞吐量提升3倍

- 垂直领域:医疗、法律等专业领域的微调版本已在测试中,行业知识准确率达85%以上

2. 技术演进方向

- 多模态融合:即将发布的Qwen3-VL模型将实现图文统一理解

- 推理优化:持续改进混合推理架构,动态调整思考深度

- 工具调用:强化智能体能力,支持复杂任务的自动化执行

结论与行动指南

Qwen3-8B-Base以82亿参数规模,通过架构创新重新定义了开源模型的性能边界。其双模式推理机制为不同场景提供最优解,三阶段训练确保了知识深度与推理能力的平衡。对于开发者而言:

- 立即体验:访问项目仓库获取模型权重,通过Ollama实现一键部署

- 场景适配:复杂任务采用

/think模式,简单查询启用/no_think优化成本 - 持续关注:Qwen3系列每月更新的微调工具链,将进一步降低行业定制门槛

在大模型竞争白热化的今天,Qwen3-8B-Base证明:真正的技术突破不在于参数规模的堆砌,而在于对效率与性能的精妙平衡。这种平衡,或许正是AI技术普惠化的关键所在。

项目地址:https://gitcode.com/hf_mirrors/Qwen/Qwen3-8B-Base

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-8B-Base

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-8B-Base