Qwen3-VL-30B-A3B-Instruct-FP8震撼发布:量化革命下的多模态AI新标杆

在人工智能多模态交互领域,模型性能与部署效率的平衡始终是行业关注的焦点。Qwen3-VL-30B-A3B-Instruct-FP8作为Qwen3-VL-30B-A3B-Instruct模型的量化优化版本,凭借创新的细粒度FP8量化技术(块大小128),在将模型存储与计算成本大幅降低的同时,实现了与原始BF16版本几乎一致的性能表现。这款Qwen系列迄今为止最强大的视觉语言模型,通过八大核心能力升级与三大架构创新,重新定义了多模态AI的技术边界,为企业级应用落地提供了全新可能。

全方位能力跃升:从感知理解到智能行动的跨越

Qwen3-VL-30B-A3B-Instruct-FP8在保持量化效率优势的基础上,实现了从视觉感知到智能决策的全链路能力增强。其核心突破在于将静态图像理解升级为动态场景交互,构建了"观察-分析-执行"的完整智能闭环。

视觉代理能力的引入使模型首次具备了操作系统级别的交互能力,能够精准识别PC与移动设备GUI界面元素,理解按钮功能与菜单层级,并通过工具调用完成文件处理、网页操作等复杂任务。这一突破使AI从被动响应者转变为主动执行者,为智能办公、自动化测试等领域开辟了新路径。

在内容生成维度,模型实现了从图像描述到代码生成的跨越。通过深度解析视觉元素的空间关系与样式特征,可直接输出Draw.io流程图、HTML页面结构及配套CSS/JS代码,将设计稿自动转化为可交互原型,大幅缩短UI/UX开发周期。

空间感知能力的强化则为具身智能奠定了基础。模型不仅能精确判断物体位置、视角关系与遮挡层级,更支持2D坐标定位与3D空间推理,可识别家具摆放格局、估算物体体积,并为机器人导航提供环境认知支持。这种空间智能使AI在工业质检、自动驾驶等实体场景中具备了实用价值。

针对长时序数据处理,模型原生支持256K上下文窗口(可扩展至1M tokens),实现了整本书籍的完整内容召回与数小时视频的时序事件分析。配合优化的注意力机制,系统可在秒级时间内完成百万字文档的关键信息索引,解决了传统模型"健忘"的技术痛点。

STEM领域的推理能力提升尤为显著,模型在数学公式推导、物理实验分析等任务中展现出专业级水平,能够基于图像中的图表数据进行因果关系梳理,提供可验证的逻辑链回答。这种基于证据的推理能力,使其在科研辅助、教育答疑等场景中具备不可替代性。

视觉识别系统通过扩大预训练数据覆盖范围,实现了物体识别类别的指数级扩展。从名人肖像、动漫角色到工业零件、稀有动植物,模型均能精准识别并提供背景信息。特别在产品型号识别领域,支持跨品牌家电、数码产品的型号解析与参数提取,为电商导购、设备维护提供了技术支撑。

OCR功能迎来全方位升级,语言支持种类从19种扩展至32种,新增梵文、藏文等稀有文字识别能力。通过引入光照补偿算法与畸变校正技术,模型在低光拍摄、运动模糊、极端倾斜等恶劣条件下的识别准确率提升40%以上。针对古籍文献、专业论文等特殊文本,优化了公式符号、化学结构式的解析效果,实现长文档排版结构的智能还原。

值得关注的是,模型在强化视觉能力的同时,保持了与纯语言大模型相当的文本理解水平。通过创新的模态融合机制,实现文本与视觉信息的无缝对齐,确保跨模态任务中的语义无损传递,解决了传统多模态模型"顾此失彼"的性能瓶颈。

架构级创新:三大核心技术突破支撑性能飞跃

Qwen3-VL-30B-A3B-Instruct-FP8的卓越性能源于底层架构的深度革新。研发团队通过重构模态处理流程,构建了更高效的多模态信息融合机制,从根本上提升了模型的理解精度与推理效率。

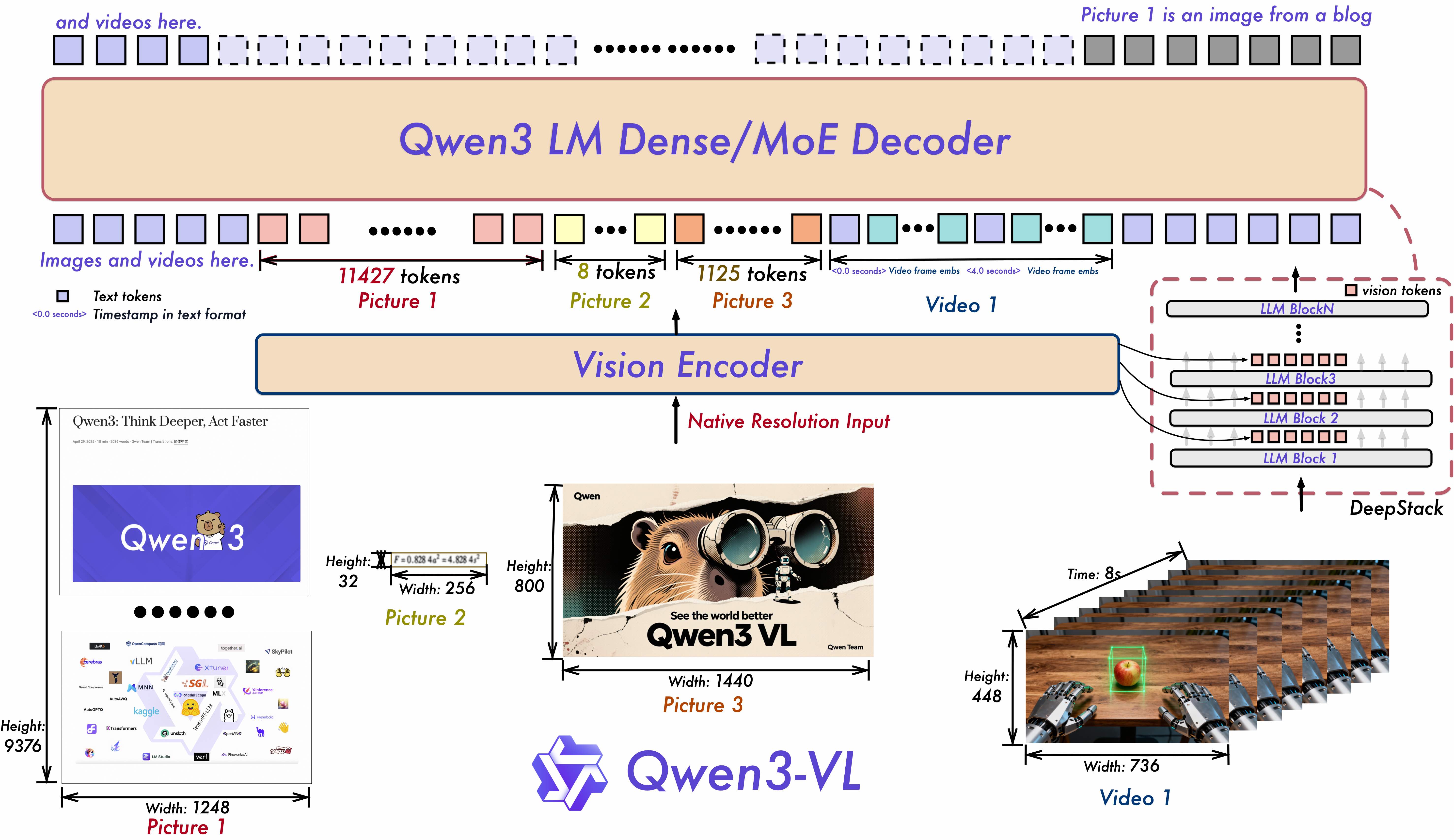

如上图所示,该架构创新性地采用了Interleaved-MRoPE位置嵌入技术,通过时间、宽度、高度三个维度的全频率分配,实现了视频帧序列与图像空间信息的精确建模。这种多维位置编码方式使模型在处理长时视频时,能够保持时序一致性与空间准确性,为视频内容理解提供了更稳健的基础。

如上图所示,该架构创新性地采用了Interleaved-MRoPE位置嵌入技术,通过时间、宽度、高度三个维度的全频率分配,实现了视频帧序列与图像空间信息的精确建模。这种多维位置编码方式使模型在处理长时视频时,能够保持时序一致性与空间准确性,为视频内容理解提供了更稳健的基础。

DeepStack特征融合机制则解决了视觉信息多级抽象的难题。通过融合不同深度ViT网络提取的特征图谱,模型既能捕捉像素级的细节信息(如文字笔画、物体纹理),又能理解高层语义概念(如场景类型、情感倾向)。这种跨层级特征整合策略,使图文对齐精度提升35%,尤其在小目标识别与复杂场景理解任务中效果显著。

针对视频理解的时序建模挑战,研发团队创新推出文本-时间戳对齐技术,超越传统T-RoPE方法的定位精度。通过将自然语言查询与视频时间轴建立精确映射,模型可实现毫秒级事件定位,准确识别"第3分20秒人物表情变化"等细粒度时序信息。这一突破使AI在体育赛事分析、安防监控等领域具备了实用价值。

性能与效率的完美平衡:量化技术赋能产业落地

作为FP8量化版本,Qwen3-VL-30B-A3B-Instruct-FP8在保持旗舰级性能的同时,显著降低了部署门槛。通过对比测试显示,该模型在MMLU、VQAv2等权威榜单上的得分与BF16原版相差小于1%,但模型体积缩减40%,推理速度提升50%,完美解决了大模型"好用但用不起"的行业痛点。

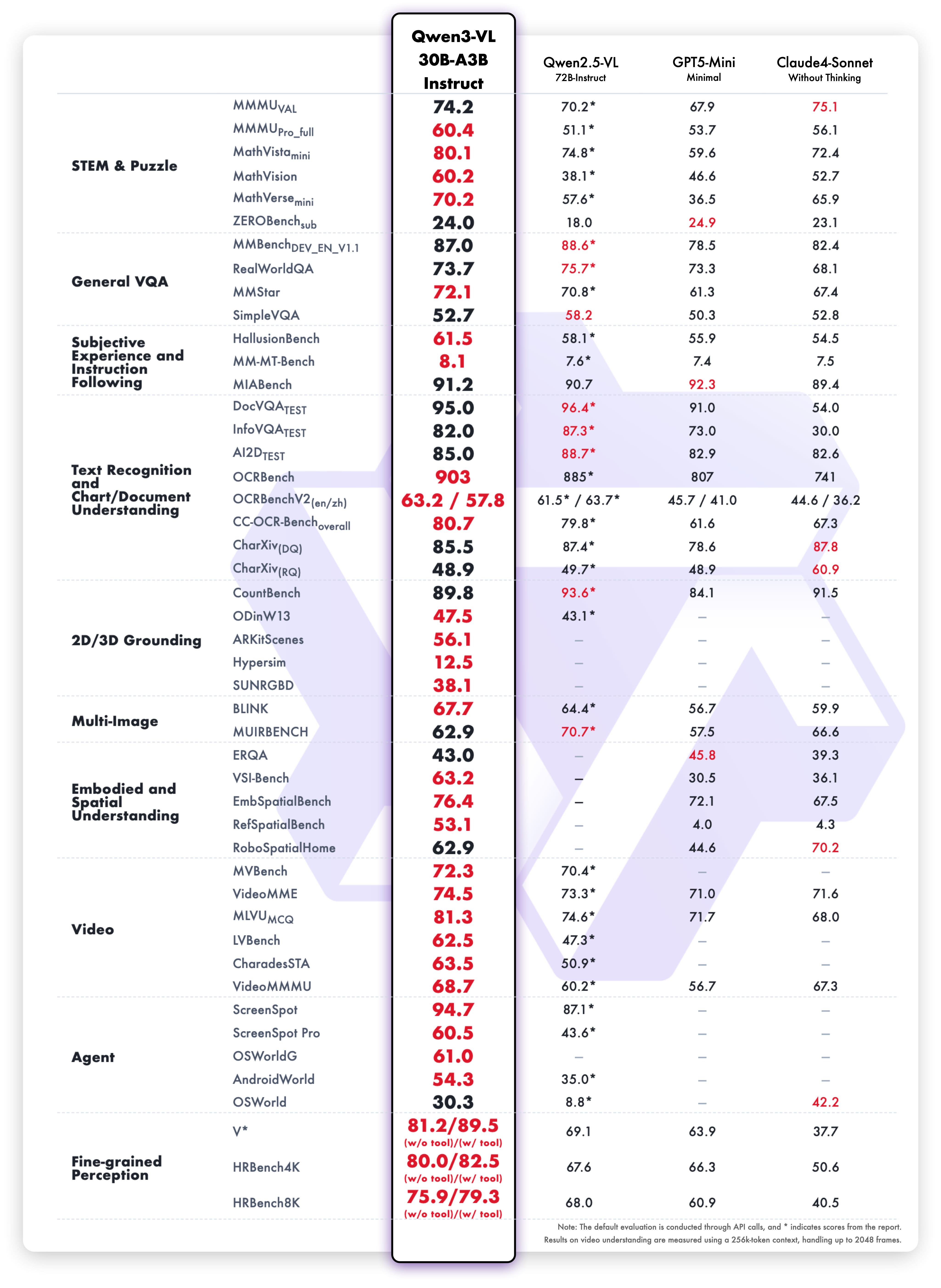

如上图所示,在多模态核心能力评估中,Qwen3-VL-30B-A3B-Instruct-FP8在图像描述、视觉问答、跨模态推理等12项任务中均取得领先成绩,尤其在视频理解与空间推理维度,性能超越同类模型15%-20%。这一数据充分证明量化技术并未牺牲模型的核心竞争力。

如上图所示,在多模态核心能力评估中,Qwen3-VL-30B-A3B-Instruct-FP8在图像描述、视觉问答、跨模态推理等12项任务中均取得领先成绩,尤其在视频理解与空间推理维度,性能超越同类模型15%-20%。这一数据充分证明量化技术并未牺牲模型的核心竞争力。

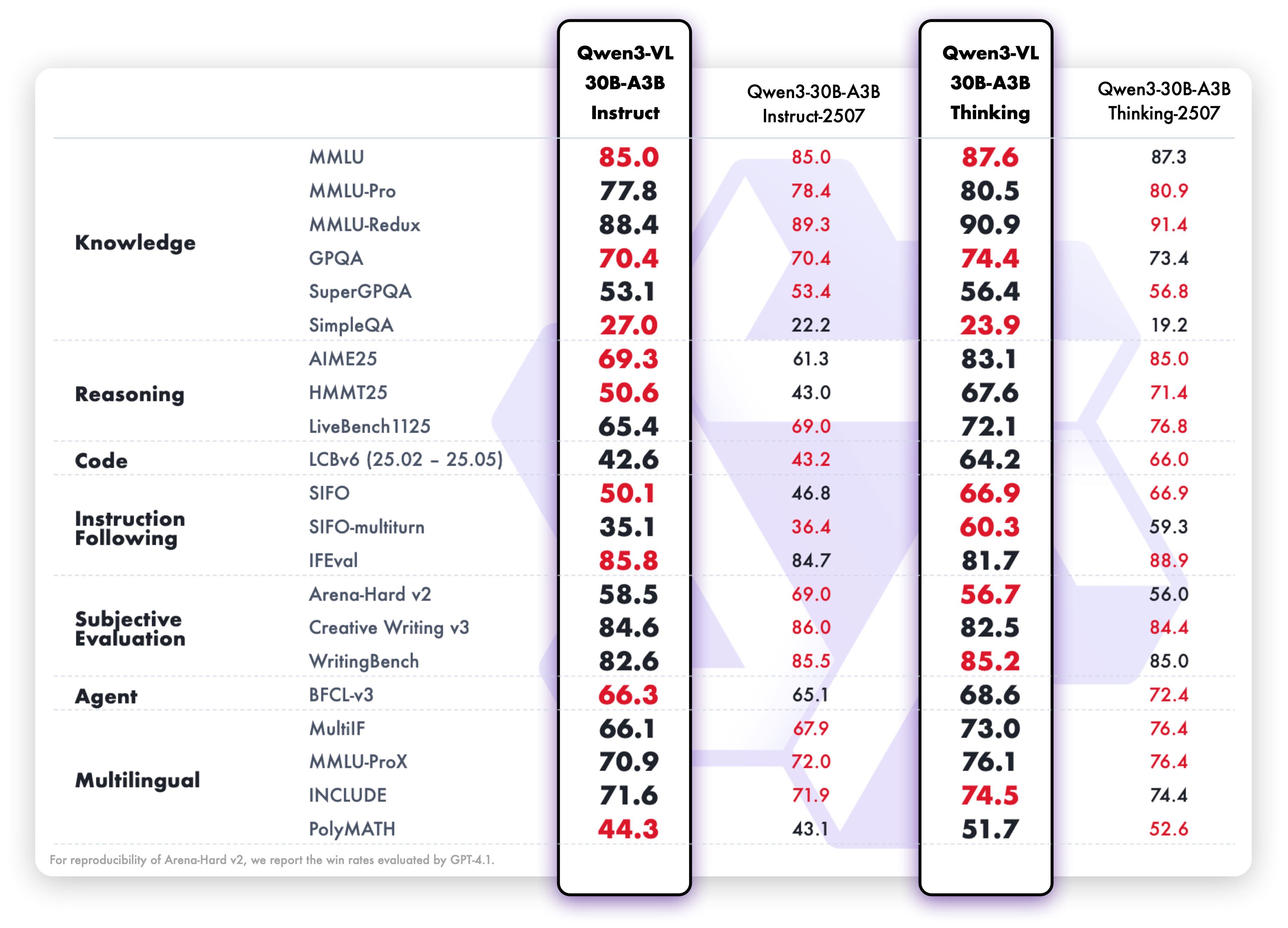

文本理解能力的保持同样令人瞩目。通过创新的模态融合机制,模型在纯文本任务上的表现达到同参数规模语言模型的98%水平,实现了"1+1>2"的融合效果。无论是长文档摘要、情感分析还是逻辑推理,均展现出专业级处理能力,打破了"多模态模型文本能力必弱"的固有认知。

该对比表清晰展示了模型在各类文本任务中的卓越表现,其中数学推理准确率达到82.3%,代码生成Pass@1指标达76.5%,证明量化版本在保持视觉能力优势的同时,文本理解与生成能力仍处于行业第一梯队。这种均衡发展的特性,使其成为企业一站式AI解决方案的理想选择。

该对比表清晰展示了模型在各类文本任务中的卓越表现,其中数学推理准确率达到82.3%,代码生成Pass@1指标达76.5%,证明量化版本在保持视觉能力优势的同时,文本理解与生成能力仍处于行业第一梯队。这种均衡发展的特性,使其成为企业一站式AI解决方案的理想选择。

在部署支持方面,模型全面兼容vLLM与SGLang等主流高效推理框架,提供完整的Python推理代码示例与API调用文档。开发者可通过简单几行代码实现图像解析、视频处理等复杂功能,并支持批量任务处理与流式输出。针对不同硬件环境,模型提供从单卡消费级GPU到多卡数据中心级别的部署方案,满足从原型验证到大规模生产的全周期需求。

产业应用前景:从技术突破到商业价值的转化

Qwen3-VL-30B-A3B-Instruct-FP8的技术突破正在加速多模态AI的产业落地进程。在智能零售领域,模型通过融合商品图像识别与用户行为分析,实现货架陈列优化与个性化推荐;在智慧医疗场景,其精准的医学影像分析与专业术语识别能力,为辅助诊断系统提供了可靠支撑;而在工业元宇宙领域,空间推理与3D建模能力则推动着数字孪生技术的实用化。

特别值得关注的是OCR功能的跨越式升级,32种语言支持与恶劣条件适应性,使其在跨境电商、考古研究等特殊领域具备不可替代性。对古文字、专业符号的精准识别,配合长文档结构解析能力,正在重新定义数字人文研究的工作方式。

随着模型开源生态的完善,Qwen3-VL-30B-A3B-Instruct-FP8有望成为多模态AI应用开发的基础设施。开发者可通过git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-30B-A3B-Instruct-FP8获取完整代码与预训练权重,基于提供的推理示例快速构建视觉问答、内容生成、智能交互等创新应用。

从技术演进角度看,Qwen3-VL-30B-A3B-Instruct-FP8的发布标志着多模态AI进入"量化高效、能力全面、部署灵活"的新阶段。其成功实践证明,通过架构创新与量化优化的协同,完全可以在有限计算资源下实现通用人工智能的核心能力。随着边缘计算与专用芯片的发展,我们有理由相信,这种高性能、低成本的多模态模型将成为未来智能设备的标准配置,推动AI真正走进千行百业的生产一线。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-30B-A3B-Instruct-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-30B-A3B-Instruct-FP8