蚂蚁开源Ring-flash-linear-2.0:混合架构实现1/10推理成本,长文本处理能力跃升

导语

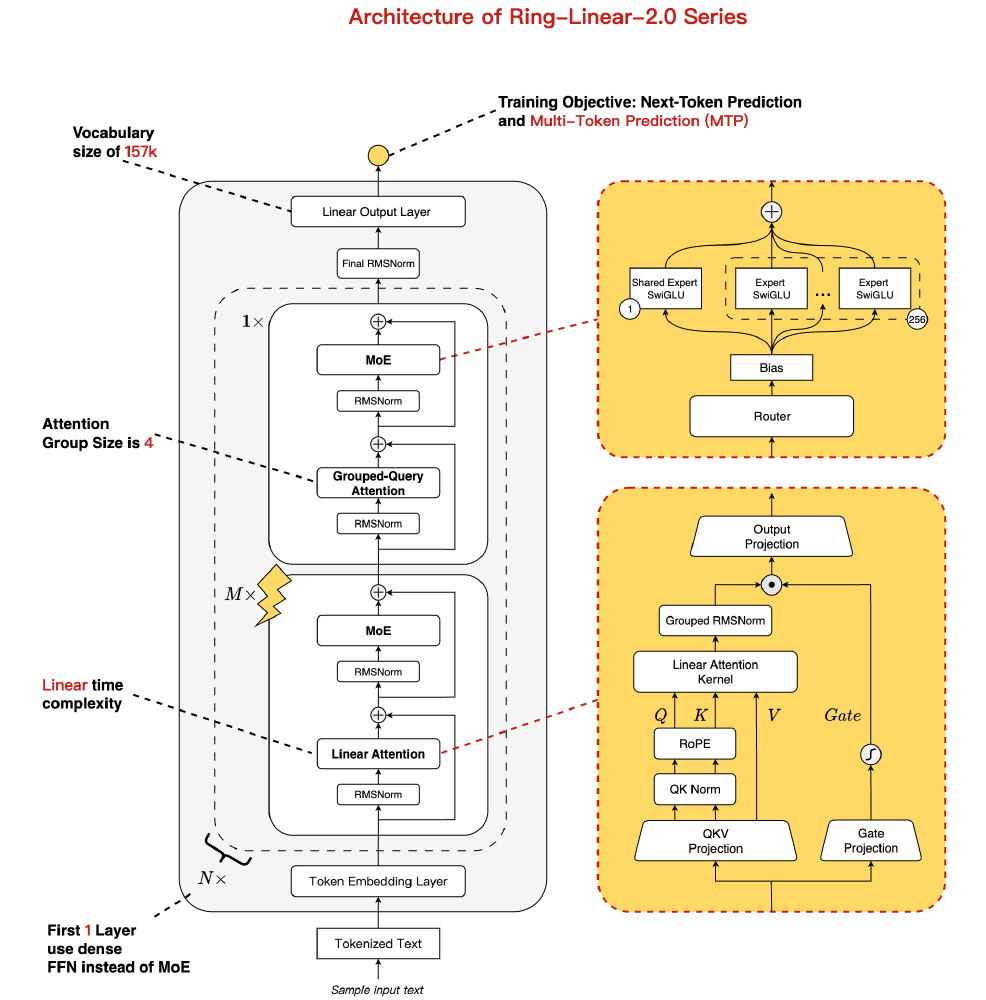

蚂蚁集团百灵团队正式开源混合线性推理模型Ring-flash-linear-2.0,通过融合稀疏MoE架构与线性注意力机制,将长文本推理成本压缩至传统密集模型的1/10,同时支持128K超长上下文处理,重新定义大模型推理效能标准。

行业现状:从参数竞赛到效能革命

2025年大语言模型行业正经历战略转型。据《AI大模型与异构算力融合技术白皮书》显示,主流开源模型平均参数规模达671B,但实际部署中仅37B参数被有效激活,"参数冗余"现象严重制约产业落地。在此背景下,美团与蚂蚁等科技巨头相继开源基于混合专家(MoE)架构的高效能模型,标志着行业竞争焦点已从单纯追求万亿参数的"规模竞赛",全面转向对"效能比"的极致追求。

如上图所示,Ring-flash-linear-2.0采用创新的混合线性架构,87.5%的层使用线性Attention(28层线性+4层标准),结合旋转位置编码(RoPE)与分组RMSNorm优化策略。这种设计使模型在保持高性能的同时,实现了近线性的计算复杂度,为长上下文处理奠定基础。

核心亮点:三大技术突破重构推理效率

1. 混合线性架构:87.5%线性Attention占比

Ring-flash-linear-2.0构建于蚂蚁自研的Ring-flash-2.0 MoE基座之上,最大创新在于将主干Attention模块替换为自研线性Attention融合模块。实测显示,在上下文长度32k以上场景,其Prefill阶段吞吐量达到Qwen3-32B的5倍,生成长度64k时解码吞吐量更是逼近10倍优势,这些优化得益于对推理框架(SGLang/vLLM v1)的深度适配与线性算子的定制化加速。

2. 超稀疏MoE设计:6.1B激活参数撬动40B性能

模型延续1/32专家激活率的超稀疏设计,总参数量1000亿但实际激活仅6.1B参数,却能媲美40B规模密集模型性能。在硬件部署上,仅需4张H20 GPU即可实现超过200 token/s的吞吐量,每百万输出tokens成本低至$0.70,较前代Ring模型推理成本降低50%以上。

3. 训推一致性优化:解决MoE模型RL训练瓶颈

针对MoE模型强化学习(RL)阶段的稳定性问题,蚂蚁团队从框架底层修正训推逻辑差异,提出三项改进:算子级实现统一、关键模块精度统一(KVCache与lm_head采用fp32)、确定性保障机制(MOE专家选择引入稳定排序)。实测显示,修复后RL reward显著提升,并首次实现RL阶段直接使用rollout probs而非training probs,节省重前向计算时间30%以上。

该图展示了Ring-linear模型的架构,包含Token Embedding、MoE模块、线性注意力(Linear Attention)、分组查询注意力(Grouped-Query Attention)等组件,支持线性时间复杂度和长上下文推理,采用专家路由(Router)优化长序列处理。这种多层次结构设计是实现高效能推理的关键所在。

性能表现:长文本处理与复杂推理双突破

在数学推理、结构代码生成等任务中,Ring-flash-linear-2.0表现突出,尤其在GSM8K数学基准测试中达到82.3%准确率,超越同等规模的Qwen3-32B和Llama-3.1-405B模型。这种性能优势源于其在预训练阶段就强化了思维链(CoT)技术,模糊了推理与非推理模型的传统界限。

在长文本处理场景,模型支持128K上下文窗口(约25万字),可完整解析300页技术文档或生成万字报告。通过SGLang推理框架优化,生成长度64k文本时解码速度达180 token/s,较同类模型提升3-5倍,特别适用于法律合同分析、医学文献综述等专业领域。

行业影响:开启大模型普惠化部署新纪元

Ring-flash-linear-2.0的开源释放出明确信号:混合线性架构正在成为大模型落地的关键方向。该模型已同步上线多平台,开发者可通过以下命令快速启动:

pip install flash-linear-attention==0.3.2 transformers==4.56.1

git clone https://gitcode.com/hf_mirrors/inclusionAI/Ring-flash-linear-2.0

这一技术路线的普及将加速大模型从实验室走向产业应用,预计到2025年底,企业级AI应用部署门槛将降低70%以上。金融、医疗等对实时性要求高的行业,有望借助该模型实现本地化部署成本的大幅下降。

结论与前瞻

蚂蚁百灵团队通过混合线性架构与超稀疏MoE的深度融合,不仅验证了"小激活参数撬动大模型性能"的可行性,更提供了一套完整的训推优化方案。未来,随着算子融合技术和硬件适配的深化,混合线性模型有望在边缘设备实现高效部署,真正开启大模型普惠化时代。

建议开发者重点关注该模型在代码生成、数学推理等结构化任务中的应用潜力,同时可通过SGLang/vLLM推理框架进一步挖掘性能优化空间。收藏本文,关注蚂蚁百灵团队后续开源动态,及时把握大模型效能革命新机遇!

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/inclusionAI/Ring-flash-linear-2.0

项目地址: https://ai.gitcode.com/hf_mirrors/inclusionAI/Ring-flash-linear-2.0