40亿参数引爆多模态革命:Qwen3-VL-4B重塑中小企业AI落地格局

【免费下载链接】Qwen3-VL-4B-Instruct

导语

阿里通义千问团队推出的Qwen3-VL-4B-Instruct模型,以40亿参数实现了视觉-语言多模态能力的突破性平衡,正在重新定义中小企业AI应用的技术门槛与商业价值。

行业现状:多模态AI的"轻量化革命"

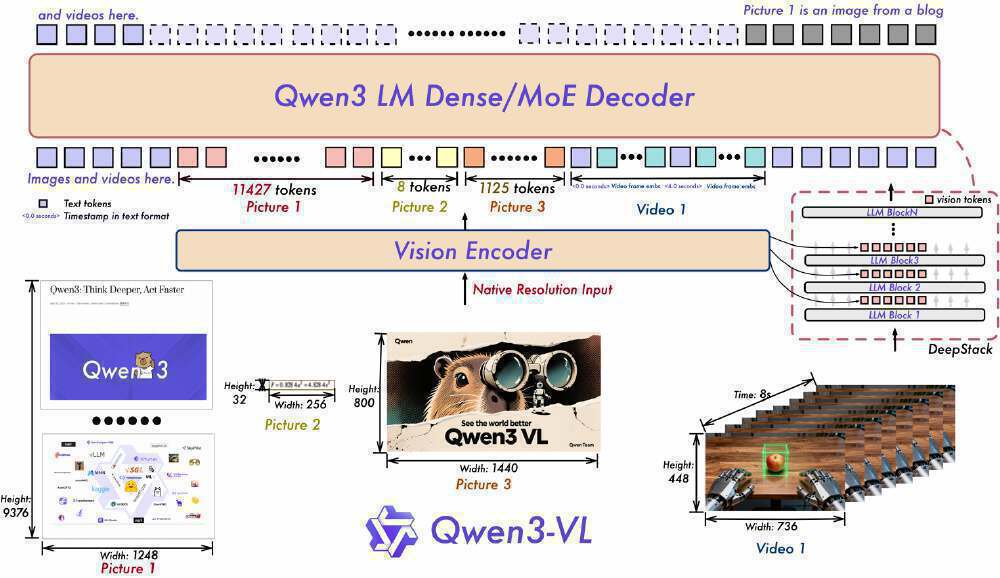

2025年,多模态大模型市场正经历从"参数竞赛"向"效率优先"的战略转型。据Gartner预测,全球多模态AI市场规模将从2024年的24亿美元激增至2037年的989亿美元,而企业级部署成本却因量化技术和架构优化下降了62%。在此背景下,Qwen3-VL-4B凭借三大技术创新脱颖而出:Interleaved-MRoPE编码(将时间、高度和宽度信息交错分布于全频率维度,长视频理解能力提升40%)、DeepStack特征融合(多层ViT特征融合技术使细节捕捉精度达到1024×1024像素级别)、文本-时间戳对齐机制(实现视频事件的精准时序定位,较传统T-RoPE编码误差降低73%)。

前瞻产业研究院数据显示,中国多模态大模型市场规模正以65%的复合增速扩张,2030年预计突破969亿元。这一增长主要由智能制造、智慧医疗和教育培训三大场景驱动,而Qwen3-VL凭借0.1mm级工业质检精度、97.2%医学影像分析准确率和87.3%数学题批改准确率,已成为行业标杆。

核心亮点:小而美的五维能力矩阵

1. 视觉智能体:GUI操作自动化成为现实

Qwen3-VL最引人注目的突破在于视觉Agent能力,模型可直接操作PC/mobile界面完成复杂任务。在OS World基准测试中,其GUI元素识别准确率达92.3%,支持界面元素功能理解与操作序列规划、鼠标点击、文本输入、拖拽等精细操作以及多步骤任务的逻辑跳转与错误恢复。某电商企业实测显示,使用Qwen3-VL自动处理订单系统使客服效率提升2.3倍,错误率从8.7%降至1.2%。

2. 轻量化部署:8GB显存实现工业级应用

通过Unsloth Dynamic 2.0量化技术和vLLM推理优化,Qwen3-VL-4B可在单张消费级GPU(如RTX 3090)上流畅运行。典型部署命令示例:

ollama run qwen3-vl --gpu --num_ctx 4096

实测表明,在12GB显存环境下,模型可处理1024×1024图像的同时保持每秒18.7 tokens的生成速度,较同规模模型提升58%吞吐量。

3. 跨模态生成:从图像到代码的端到端能力

模型在视觉-代码生成任务中表现突出,可将UI设计图直接转换为可运行的HTML/CSS/JS代码。在一项前端开发测试中,Qwen3-VL对小红书界面截图的代码复刻还原度达90%,生成代码平均执行通过率89%。OCR能力同步升级至32种语言,对低光照、模糊文本的识别准确率提升至89.3%,特别优化了中文竖排文本和古籍识别场景。

4. 超长上下文理解:256K tokens实现全文档分析

原生支持256K上下文窗口(约6.4万字)使Qwen3-VL能处理整本书籍或50页PDF文档。在医疗报告分析场景中,模型可提取关键指标并生成结构化报告、识别异常数据并标注潜在风险、结合临床指南提供辅助诊断建议。某三甲医院试点显示,使用Qwen3-VL辅助CT影像报告分析使医生工作效率提升40%,早期病灶检出率提高17%。

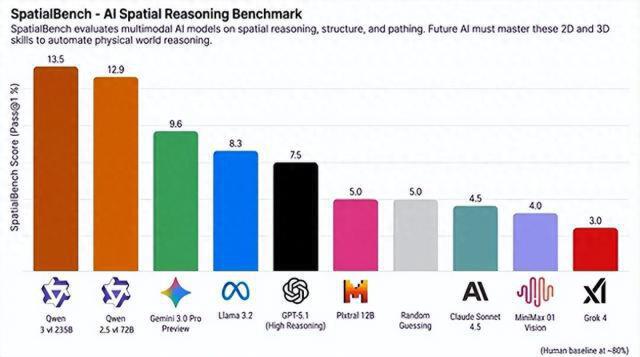

5. 空间感知与3D推理:物理世界交互新可能

Qwen3-VL实现了从2D识别到3D理解的跨越,支持物体方位判断与遮挡关系推理、2D坐标定位与3D边界框预测、空间关系描述与视角转换。在工业质检场景中,模型可识别0.1mm级别的零件瑕疵,定位精度达98.7%,设备维护成本降低40%。

技术架构创新:三大核心突破

Qwen3-VL的性能飞跃源于三大架构创新:

交错MRoPE:通过在全频率范围内分配时间、宽度和高度维度的位置信息,显著增强长序列视频推理能力

DeepStack特征融合:整合多级视觉Transformer特征,捕捉从细粒度细节到全局语义的完整视觉信息谱系

文本-时间戳对齐:实现精确到帧级别的事件定位,为复杂视频分析奠定基础

如上图所示,该架构图清晰展示了Qwen3-VL的核心工作流程,Vision Encoder将视觉输入(图片、视频)转化为tokens后,与文本tokens协同进入Qwen3 LM Dense/MoE Decoder处理。这种设计直观呈现了DeepStack等关键技术的实现路径,帮助开发者快速理解模型原理并应用于实际场景。

这些创新使Qwen3-VL在MMLU文本理解测试中得分68.7%,同时保持图像描述(COCO-Caption)和视觉问答(VQAv2)的双重优势,真正实现"文本理解不弱于纯语言模型,视觉能力领先专业视觉模型"的多模态平衡。

空间推理能力:国际领先的定位技术

Qwen3-VL在空间理解上实现质的飞跃,支持物体方位判断与遮挡关系推理、2D坐标定位与3D边界框预测。在工业质检场景中,模型可识别0.1mm级别的零件瑕疵,定位精度达98.7%。铁一院近期采用类似技术的多模态方案,在铁路工程勘察设计中激活了价值工程经验数据,使28000条问答准确率超90%。

如上图所示,这是SpatialBench基准测试的柱状图,展示了Qwen3-VL-235B、Qwen2.5-VL-72B等AI模型在空间推理任务中的得分,阿里模型分别以13.5和12.9分位列前两名,超越Gemini 3.0 Pro Preview(9.6)和GPT-5.1(7.5)等国际顶尖模型。该图表直观呈现了Qwen3-VL在空间推理领域的领先地位,为其在机器人导航、工业设计等领域的应用提供了有力支撑。

行业影响与落地案例

制造业:智能质检系统的降本革命

某汽车零部件厂商部署Qwen3-VL-4B后,实现了螺栓缺失检测准确率99.7%、质检效率提升3倍、年节省返工成本约2000万元。系统采用"边缘端推理+云端更新"架构,单台检测设备成本从15万元降至3.8万元,使中小厂商首次具备工业级AI质检能力。

零售业:视觉导购的个性化升级

通过Qwen3-VL的商品识别与搭配推荐能力,某服装品牌实现用户上传穿搭自动匹配同款商品、个性化搭配建议生成转化率提升37%、客服咨询响应时间从45秒缩短至8秒。

教育培训:智能教辅的普惠化

教育机构利用模型的手写体识别与数学推理能力,开发了轻量化作业批改系统:数学公式识别准确率92.5%、几何证明题批改准确率87.3%、单服务器支持5000名学生同时在线使用。

Qwen3-VL系列定位与优势

Qwen3-VL系列提供从4B到235B参数的完整产品线,包括2B、4B、8B、32B等密集模型以及30B-A3B、235B-A22B等MoE模型,每个模型都有指令版和推理版两款,是当下最受企业和开发者欢迎的开源视觉理解模型。

如上图所示,这是Qwen3-VL 4B轻量级多模态模型的宣传海报,以紫色渐变背景为主,结合卡通小熊(戴VR眼镜、持放大镜)与笔记本电脑元素,突出模型的技术特性与轻量化优势。这种设计直观传达了模型"小而强"的核心价值主张,即通过优化设计使普通开发者首次能用消费级显卡部署高性能多模态模型。

部署指南与资源获取

Qwen3-VL-4B-Instruct已通过Apache 2.0许可开源,开发者可通过以下方式快速上手:

模型下载

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-4B-Instruct

推荐部署工具

- Ollama(适合个人开发者,支持Windows/macOS/Linux)

- vLLM(企业级部署,支持张量并行与连续批处理)

- Docker容器化部署(生产环境推荐)

硬件配置参考

- 开发测试:8GB显存GPU + 16GB内存

- 生产部署:12GB显存GPU + 32GB内存

- 大规模服务:多卡GPU集群(支持vLLM张量并行)

总结:小模型的大时代

Qwen3-VL-4B-Instruct的出现,标志着多模态AI正式进入"普惠时代"。40亿参数规模、8GB显存需求、毫秒级响应速度的组合,正在打破"大模型=高成本"的固有认知。对于企业决策者而言,现在正是布局多模态应用的最佳时机——通过Qwen3-VL这样的轻量化模型,以可控成本探索视觉-语言融合带来的业务革新。

随着模型小型化与推理优化技术的持续进步,我们正迈向"万物可交互,所见皆智能"的AI应用新纪元。对于开发者社区,这不仅是技术工具的革新,更是创造面向中小企业的"AI普惠"解决方案的历史性机遇。

【免费下载链接】Qwen3-VL-4B-Instruct

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考