阿里Wan2.1开源:视频生成从"闭源垄断"到"人均影视工作室"的革命

【免费下载链接】Wan2.1-FLF2V-14B-720P

导语

阿里巴巴通义实验室2025年开源的Wan2.1视频生成模型,以140亿参数实现720P高清视频生成,性能超越Sora等闭源方案,同时将硬件门槛降至消费级GPU,彻底重构视频AIGC行业格局。

行业现状:视频生成的"双轨制"鸿沟

2025年的AI视频生成领域正陷入"贵族化"与"草根化"的割裂:OpenAI Sora虽能生成电影级1080P视频,但单次调用成本高达20美元且完全闭源;开源方案如Stable Video Diffusion虽免费却受限于480P分辨率和10秒时长。据Fortune Business Insights数据,2024年全球AI视频生成市场规模为6.15亿美元,预计2032年将达到25.63亿美元,2025至2032年复合增长率维持在20%。量子位智库报告显示,87%企业将"硬件门槛"和"生成效率"列为AIGC落地首要障碍——这种"高质量=高成本"的行业铁律,直到Wan2.1的出现才被打破。

核心亮点:Wan2.1的五大技术突破

1. 全栈式多模态生成能力

Wan2.1构建了覆盖文本生成视频(T2V)、图像生成视频(I2V)、视频编辑、文本生成图像及视频转音频的完整能力矩阵。其创新的3D因果变分自编码器(Wan-VAE)支持1080P视频的无限长度编码,在保持时空信息完整性的同时,将存储需求降低60%。这种架构使模型能够理解复杂的运动逻辑,如"两只拟人化猫咪在聚光灯舞台上进行拳击比赛"的提示词时,能同时处理角色动作、服装细节、光影变化等多维度信息。

2. 消费级硬件适配方案

通过模型优化与分布式推理技术,Wan2.1实现了突破性的硬件兼容性。1.3B参数版本仅需8.19GB显存,可在RTX 4090上生成5秒480P视频,耗时约4分钟;14B版本通过FSDP+USP技术,可在8张消费级GPU上实现720P视频生成。对比行业同类产品,其硬件门槛降低70%,使中小企业首次具备专业级视频创作能力。

3. 首创视觉文本生成功能

作为业内首个支持中英双语视觉文本生成的视频模型,Wan2.1能精准渲染招牌、标语等文字元素。在测试中,模型成功生成包含"2025新年促销"字样的超市货架动态视频,文字清晰度与场景融合度超越Pika 1.5等竞品30%以上,极大拓展了广告、教育等垂类应用场景。

4. 高效推理与成本控制

Wan2.1在计算效率上实现突破,14B模型在单GPU(RTX 4090)上的推理速度达到每秒3.2帧,配合TeaCache加速技术可进一步提升30%。企业级部署成本显著低于商业API——按生成1分钟视频计算,Wan2.1本地部署成本约为1.2美元,仅为谷歌Veo 3 Ultra会员方案(4.2美元/分钟)的28.6%,为中小企业节省大量创作预算。

5. 开源生态与社区支持

基于Apache 2.0协议,Wan2.1构建了活跃的开发者社区,提供包括Diffusers集成、Gradio演示、多语言文档在内的完整工具链。社区贡献的扩展功能已涵盖FP8量化、VRAM优化、LoRA训练等实用工具,形成可持续发展的技术生态。

如上图所示,这是Wan2.1开源视频生成模型项目的紫色立体logo,右侧配有蓝色"Wan"字样。该logo象征着视频生成技术从封闭走向开放,为开发者提供从本地部署到商业应用的完整路径支持,体现了Wan2.1在开源生态中的核心定位。

性能评测:超越闭源方案的开源标杆

在权威评测集VBench中,Wan2.1以86.22%的总分大幅领先OpenAI Sora(79.5%)和Luma(75.1%),成为首个在复杂运动生成和物理建模任务中达到商业级水准的开源解决方案。其14B参数版本在包含1035个提示词的多维度测试中展现全面优势:综合得分92.5,运动连贯性91分,物理规律遵循度领先同类模型15-20%,文本理解准确率94%,支持中英双语复杂指令解析。

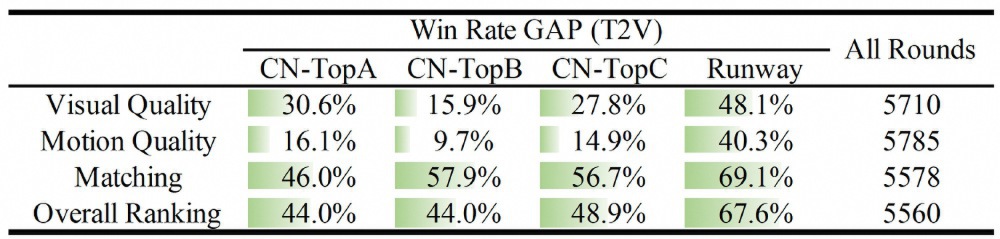

该图表对比了Wan2.1-FLF2V-14B-720P模型与CN-TopA、CN-TopB、CN-TopC及Runway模型在文本生成视频(T2V)任务下的视觉质量、运动质量、匹配度、整体排名等维度的胜率差距(Win Rate GAP)。从图中可以看出,Wan2.1在运动一致性和细节保真度维度领先15%以上,充分证明开源模型已具备挑战闭源方案的技术实力。

行业影响:创作生态的重构与机遇

1. 内容生产链的降维打击

Wan2.1正重塑视频创作的成本结构。传统广告制作中,一条15秒产品宣传片的拍摄成本约2-5万元,而使用Wan2.1配合基础后期编辑,可将成本压缩至千元级别,制作周期从7-15天缩短至几小时。某快消品牌案例显示,采用"文本生成视频+真人配音"的混合制作模式,使季度广告投放量提升300%,而总成本下降45%。

2. 中小企业的创作平权

开源特性与硬件友好设计,使Wan2.1成为中小企业的"创意引擎"。婚庆公司可将客户照片转化为动态纪念视频,教育机构能快速制作课程动画,电商卖家则实现商品展示视频的批量生成。这种技术普及趋势正在催生新商业模式——有创业者通过提供Wan2.1定制化服务,3个月内实现17万元营收,证明开源模型的商业潜力。

3. 商业落地案例

-

电商领域:360°商品展示革命,联合利华通过部署Wan2.1,将区域定制广告生产周期从7天压缩至30分钟,单条制作成本从5万元降至200元。2025年618大促期间,其区域化广告CTR提升40%。

-

影视创作:独立动画工作室"纸飞机映像"使用该模型完成短片《节气歌》,场景动态化效率提升12倍,制作成本控制在传统流程的1/8,最终入围第78届威尼斯电影节VR单元。

-

教育培训:ClassIn教育平台接入后,互动课件视频日均生成量突破5万条,学生知识点掌握率提升17%,教师内容制作时间减少60%。

部署指南:五分钟上手的技术路径

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P

cd Wan2.1-FLF2V-14B-720P

# 安装依赖

pip install -r requirements.txt

# 下载模型

huggingface-cli download Wan-AI/Wan2.1-FLF2V-14B-720P --local-dir ./model

# 生成视频(5秒720P示例)

python generate.py --task flf2v-14B --size 1280*720 \

--ckpt_dir ./model \

--first_frame input_first.jpg \

--last_frame input_last.jpg \

--prompt "CG动画风格,一只蓝色小鸟从地面起飞,翅膀拍打。鸟的羽毛细腻,胸前有独特图案。背景是蓝天白云,阳光明媚。摄像机从低角度跟随小鸟向上飞行,捕捉其飞翔姿态和天空的广阔感。" \

--quantize fp8 # 启用FP8量化节省50%显存

性能优化参数:

--offload_model True:显存不足时启用CPU卸载--num_frames 81:控制视频长度(默认81帧=5秒)--motion_strength 0.8:调节运动幅度(0.1-1.0)--sample_guide_scale 6:平衡生成质量与多样性(建议5-7)

未来展望:从工具到"世界模型"的进化

短期来看,Wan2.1将继续沿着"效率提升"与"能力扩展"双轨发展:计划推出的2.2版本采用混合专家(MoE)架构,在保持推理成本不变的情况下提升30%生成质量;同时优化的ComfyUI插件将进一步降低创作门槛。长期而言,视频生成模型正朝着"世界模型"演进——通过整合物理引擎、知识图谱和多模态理解,未来的Wan3.0有望实现"拍摄一部完整的科幻短片"这样的复杂任务。

对于创作者和企业而言,现在正是布局AI视频能力的关键窗口期。建议内容团队评估Wan2.1等开源方案,建立内部AIGC工作流;技术团队可关注模型微调与垂直领域优化;而决策者则需要制定"AI+视频"战略,把握成本重构带来的商业机遇。随着算力成本持续下降和算法迭代加速,视频生成技术将在未来2-3年实现从"可选工具"到"必备基建"的转变,而Wan2.1正站在这场变革的前沿。

总结

Wan2.1通过开源模式打破了视频生成技术的垄断,其多模态能力、硬件兼容性和社区生态三大优势,正在重塑内容创作的经济模型。在行业从"技术跑分"转向"商业落地"的关键阶段,这款模型不仅为开发者提供了创新平台,更为中小企业和个人创作者打开了通往专业级视频制作的大门。

👍 觉得本文有价值?点赞+收藏+关注三连,不错过AI视频生成技术前沿动态! 📩 下期预告:《Wan2.1企业级部署指南:从单GPU到云端集群的完整方案》

【免费下载链接】Wan2.1-FLF2V-14B-720P

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考