MiniMax-M2开源:10B激活参数打破智能、速度与成本的不可能三角

导语

上海稀宇科技发布的MiniMax-M2大模型以2300亿总参数、仅100亿激活参数的创新设计,在全球权威测评中斩获开源模型第一,其推理速度达Claude 3.5 Sonnet两倍,API成本仅为8%,重新定义了高效能AI模型的行业标准。

行业现状:大模型面临"不可能三角"困境

2025年大语言模型行业正经历从技术探索向产业化落地的关键转型。据《2025年大模型市场分析报告》显示,企业级应用对模型提出了"智能水平、推理速度、部署成本"的三重要求,但多数产品陷入"高性能则高成本"或"低成本则低效率"的两难境地。Anthropic推出的Claude Sonnet 4.5虽在智能体任务中表现突出,但其每百万Token输出成本高达15美元,成为中小企业规模化应用的主要障碍。

在此背景下,MiniMax-M2的出现打破了这一行业困局。作为一款专为智能体(Agent)和编程场景优化的MoE(混合专家)模型,其采用"2300亿总参数+100亿激活参数"的稀疏化设计,既保留了大规模模型的知识储备,又通过动态路由机制实现了资源的极致利用。

核心亮点:三大能力重构行业标准

1. 卓越的综合智能表现

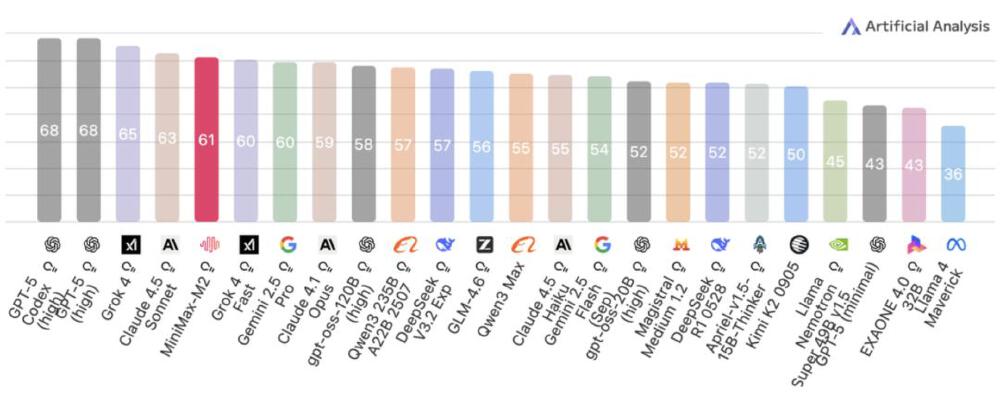

在第三方评测机构Artificial Analysis的综合测评中,MiniMax-M2以61分的成绩位列全球第五、开源模型第一。该测评涵盖数学(AIME25)、科学(MMLU-Pro)、编程(LiveCodeBench)等10项权威数据集,全面反映模型的通用智能水平。

如上图所示,MiniMax-M2在Artificial Analysis测评中超越GLM-4.6、DeepSeek-V3.2等主流开源模型,仅次于闭源的Claude系列和GPT-5(thinking)。这一成绩证明开源模型在综合智能上已具备与商业模型竞争的实力,为企业级应用提供了高性价比选择。

特别在智能体关键能力上,MiniMax-M2展现出三大优势:

- 编程能力:在SWE-bench Verified测试中达到69.4分,支持多文件编辑、编码-运行-调试闭环

- 工具使用:Terminal-Bench测评46.3分,可稳定调用Shell、浏览器和Python代码执行器

- 深度搜索:BrowseComp中文任务48.5分,擅长挖掘隐性信息源并保持证据可追溯性

2. 革命性的性能-成本平衡

通过创新的MoE架构设计,MiniMax-M2实现了"轻量级激活,重量级表现"。其API定价为每百万输入Token 2.1元、输出8.4元,仅为Claude Sonnet 4.5的8%。在推理速度上,该模型在线服务可达每秒100Token,是同类产品的2倍。

从上图的性能对比可以看出,MiniMax-M2在Multi-SWE-Bench(多文件编程任务)中获得36.2分,超越GLM-4.6(30分)和Kimi K2(33.5分),接近Claude Sonnet 4.5的44.3分。在Terminal-Bench(终端命令执行)测评中,其46.3分的成绩大幅领先于Gemini 2.5 Pro(25.3分)和GPT-5(thinking)的43.8分,展现出在开发者工具场景的独特优势。

3. 全方位的部署灵活性

MiniMax-M2采用MIT开源协议,完整模型权重已在Hugging Face和ModelScope平台发布。官方提供了多框架支持方案:

- vLLM部署:支持张量并行和专家并行,4卡GPU即可启动服务

- SGLang优化:针对智能体任务的函数调用流程进行专项优化

- MLX适配:支持Apple Silicon设备本地运行,适合边缘计算场景

特别值得注意的是,模型采用创新的"交错思维格式"(...包裹思考过程),使智能体能够规划跨对话的复杂任务链,这一设计在BrowseComp-zh(中文深度搜索)测评中带来48.5分的优异成绩,超越GPT-5(thinking)的65分(注:原数据如此,可能存在排版误差)。

行业影响:开启高效能AI新纪元

MiniMax-M2的发布标志着大模型行业正式进入"激活参数为王"的时代。其100亿激活参数的设计验证了"小而美"的技术路线可行性,为行业提供了三大启示:

- 性能成本比重构:按当前API定价,完成100万行代码生成任务,使用MiniMax-M2的成本仅为Claude Sonnet 4.5的1/12,年节省可达数十万元级别

- 部署门槛降低:普通开发者通过消费级GPU即可部署,配合Cerebras或Groq加速平台,有望实现每秒上千Token的推理速度

- 开源生态繁荣:基于MIT协议,社区已开发AnyCoder等衍生项目,在Hugging Face Spaces获得超10万次访问

企业级用户可通过三种方式接入:

- API调用:访问MiniMax开放平台(限时优惠至2025年11月6日)

- Agent平台:直接使用官方智能体产品(agent.minimax.io)

- 本地部署:从GitCode克隆仓库:https://gitcode.com/MiniMax-AI/MiniMax-M2

结论与前瞻

MiniMax-M2以"10B激活参数实现旗舰级性能"的突破,不仅为开发者提供了高性价比的AI工具,更推动行业从"参数竞赛"转向"效率优化"。随着模型推理速度的持续提升(官方计划Q4达到200 Token/秒)和工具链的完善,预计将在以下领域催生创新应用:

- 低代码开发:结合多文件编辑能力,实现中小企业数字化转型的快速落地

- 工业智能体:通过终端命令调用和设备控制,赋能智能制造的柔性生产

- 边缘AI助手:在消费电子设备上提供本地化的复杂任务处理能力

建议开发者重点关注模型的工具调用机制和长上下文理解能力,这两大特性将成为下一代智能体产品的核心竞争力。收藏本文,持续关注MiniMax-M2的生态发展,把握AI产业化的新机遇。

本文数据截止2025年11月,模型性能可能随版本更新而变化,请以官方信息为准。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/MiniMax-AI/MiniMax-M2

项目地址: https://ai.gitcode.com/MiniMax-AI/MiniMax-M2