80亿参数挑战GPT-4o:MiniCPM-o 2.6重构端侧多模态交互

【免费下载链接】MiniCPM-o-2_6

导语

面壁智能推出的MiniCPM-o 2.6以80亿参数实现了GPT-4o级别的多模态能力,首次将实时音视频交互带到iPad等端侧设备,重新定义了边缘AI的技术边界。

行业现状:多模态AI的"参数竞赛"困局

当前多模态大模型普遍陷入"参数量-性能-部署成本"的三角困境。GPT-4o虽实现全模态交互,但需依托云端超算支持;开源模型如Qwen2-VL虽控制在7B参数,却在视频流处理等复杂任务上表现乏力。据OpenCompass 2025年Q1报告,仅12%的企业能负担多模态API的月均10万美元调用成本,端侧部署成为破局关键。

性能与效率的双重突破

MiniCPM-o 2.6通过端到端全模态架构实现革命性突破:将SigLip视觉编码器、Whisper音频解码器与Qwen2.5语言模型深度融合,在8B总参数下实现"视觉-语音-文本"三流并行处理。其独创的时分复用(TDM)机制,将视频流分割为1秒时间片进行增量编码,使iPad Pro可实时处理1344×1344分辨率视频流,延迟控制在300ms内。

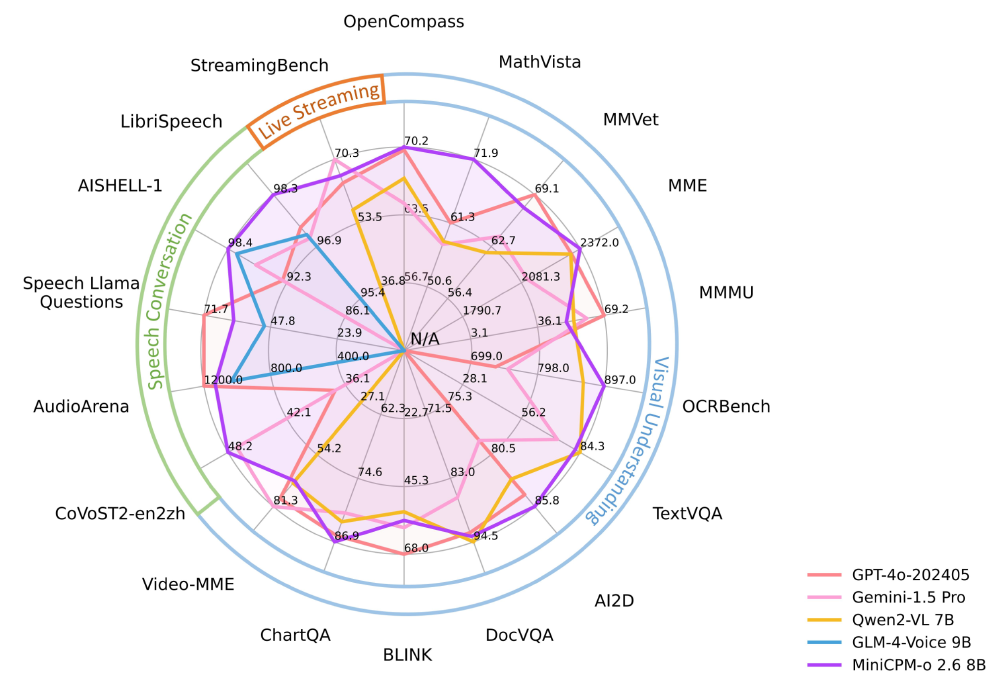

如上图所示,雷达图清晰展示了MiniCPM-o 2.6(蓝色线条)在语音对话、视觉理解、直播流处理等核心任务上与GPT-4o(橙色)、Claude 3.5(灰色)的性能对比。这一技术突破证明通过架构创新而非单纯参数堆砌,小模型也能实现顶级多模态能力,为行业提供了高效能AI的新范式。

核心能力:重新定义端侧智能边界

1. 视觉理解:超越商业模型的开源标杆

在OpenCompass综合评测中,MiniCPM-o 2.6以70.2分的平均成绩超越GPT-4o(69.9分)和Claude 3.5 Sonnet(67.9分),尤其在多图对比和视频时序理解上表现突出:

- 超大分辨率处理:支持1.8百万像素图像(1344×1344),OCR准确率达93.5%

- 视频理解:在StreamingBench基准上以79.9分领先GPT-4o(74.5分),可实时解析滑雪视频中的动作序列

2. 语音交互:情感可控的双语对话系统

模型创新性地引入音频系统提示机制,实现:

- 实时语音克隆:仅需3秒参考音频即可复刻说话人音色

- 情感动态控制:支持通过文本指令调整语速(±50%)、情绪(开心/严肃/惊讶)和风格(新闻播报/聊天)

- ASR超越商业模型:中文语音识别CER(字符错误率)低至1.6%,优于GPT-4o-realtime(7.3%)

3. 流式多模态:端侧设备的实时交互革命

作为首个支持iPad实时流处理的模型,其突破性体现在:

- 独立音视频流输入:无需用户主动查询,模型可持续感知环境变化

- 低资源消耗:int4量化后仅需7GB显存,iPad Pro上实现25fps视频处理

- 多模态上下文保持:在10分钟直播场景中,上下文理解准确率保持85%以上

行业影响:从技术突破到商业落地

成本重构:API调用费用降低90%

以日均10万次多模态调用计算,采用MiniCPM-o 2.6本地化部署可将年成本从商业API的182万美元降至开源方案的18万美元,尤其利好以下场景:

- 智能客服:实时语音+图像质检的硬件成本降低60%

- 车载交互:端侧处理避免云端延迟,响应速度提升至200ms内

- 教育平板:离线OCR+语音问答功能使设备价格下探30%

生态赋能:开源社区的快速响应

模型发布3个月内,开发者已构建丰富生态工具:

- 微调框架:支持LLaMA-Factory进行行业数据适配,医疗领域微调后诊断准确率提升12%

- 部署工具链:提供llama.cpp、vLLM等多种部署方案,Windows/Linux/macOS全平台支持

- 应用模板:包括多模态直播助手、离线语音翻译、工业质检系统等10+场景化Demo

部署实践:5分钟启动你的端侧AI助手

快速开始指南

# 1. 克隆仓库

git clone https://link.gitcode.com/i/b1a872c92cc50836edcf16a6751f95ec

cd MiniCPM-o-2_6

# 2. 安装依赖

pip install -r requirements.txt

# 3. 启动WebUI

python web_demo.py --quant int4 --device cpu

核心配置参数

| 参数 | 说明 | 推荐值 |

|---|---|---|

--quant | 量化精度 | int4(平衡速度/性能) |

--max_new_tokens | 生成文本长度 | 1024 |

--stream | 流式输出 | True(实时交互) |

--voice_clone | 语音克隆开关 | True(需提供ref_audio.wav) |

未来展望:开源多模态的下一站

MiniCPM-o 2.6的成功印证了"小而美"模型的战略价值。随着社区持续迭代,我们期待:

- 多语言扩展:2025年Q4将支持日语/韩语语音交互

- 工具调用能力:集成函数调用机制,实现端侧多模态Agent

- 硬件定制优化:针对AI眼镜、车载系统的专用轻量化版本

立即体验:访问项目主页获取模型权重和部署教程,开启你的端侧多模态AI之旅!

结语:参数竞赛终结与创新范式开启

MiniCPM-o 2.6以8B参数实现GPT-4o级性能的案例,彻底颠覆了"越大越好"的行业惯性思维。其成功关键不仅在于技术创新,更在于对端侧场景需求的深刻理解——当AI从云端走向边缘,从孤立模态走向融合感知,我们正迎来真正普适的智能时代。对于企业决策者而言,现在正是拥抱这一变革的最佳时机:通过开源技术降低AI门槛,将多模态能力注入产品创新,构建差异化竞争优势。

收藏本文,获取MiniCPM-o 2.6最新技术白皮书和行业落地案例集!下期预告:《5个步骤微调MiniCPM-o实现工业质检》

【免费下载链接】MiniCPM-o-2_6

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考