引领视频超分辨率新潮流:可变形3D卷积网络(D3Dnet)

随着视频质量要求的日益提升,如何高效地增强视频清晰度成为了一个炙手可热的研究课题。今天,我们向大家隆重介绍一个基于PyTorch实现的创新开源项目——Deformable 3D Convolution for Video Super-Resolution(简称D3Dnet)。这个项目通过引入可变形3D卷积技术,为视频超分辨率领域带来了新的突破。

项目简介

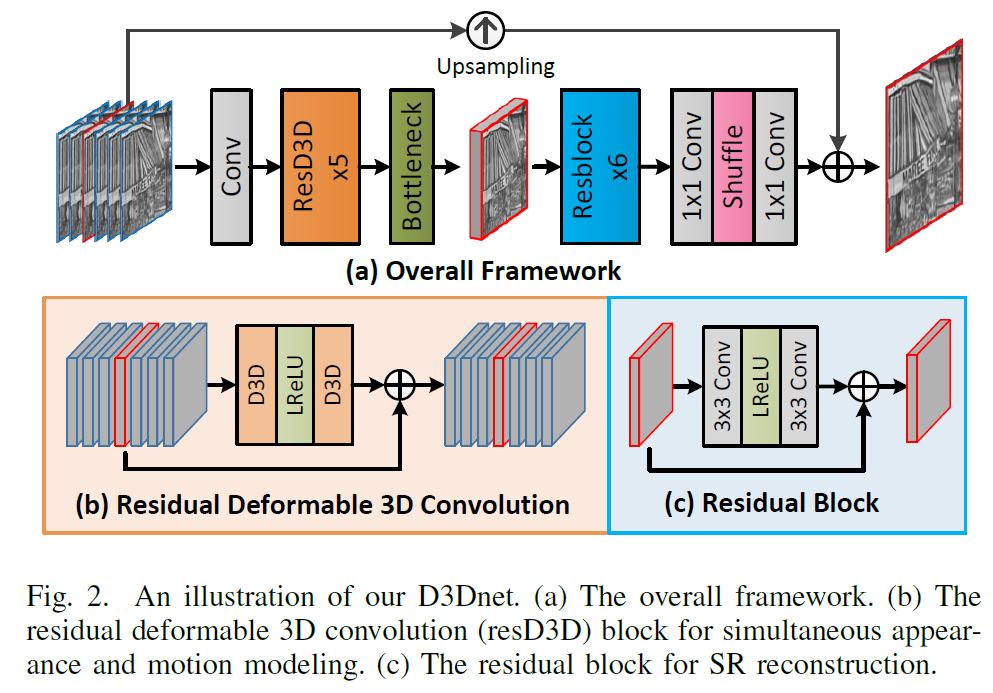

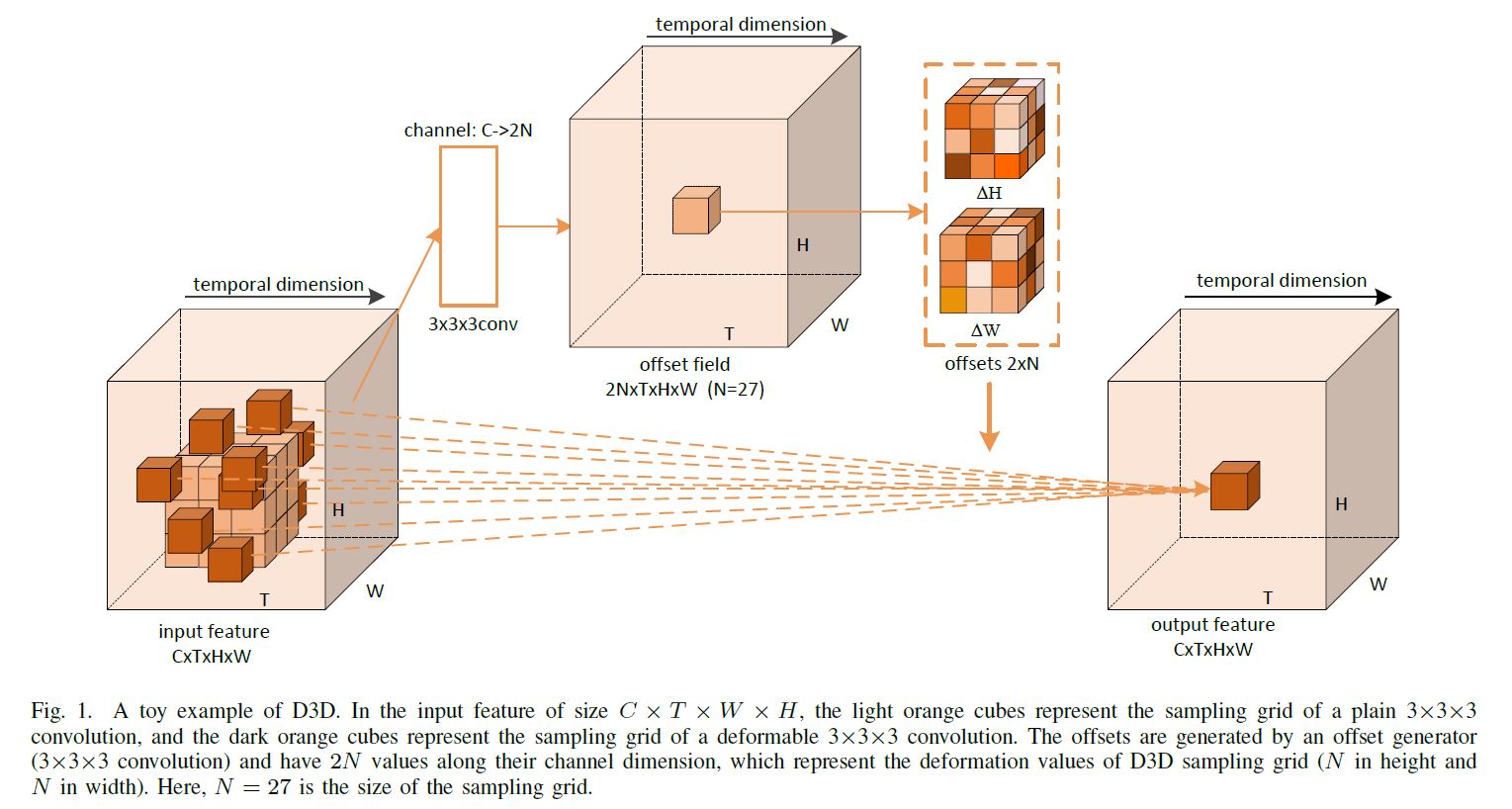

D3Dnet是一个在PyTorch平台上实现的开源项目,旨在利用可变形3D卷积网络提升视频的分辨率。它不仅继承了深度学习的卓越性能,还针对视频数据的特点进行了特别优化。该项目的灵感源自其核心组件——可变形3D卷积,能够在3D空间中的任意维度进行自由形变,从而更精准地捕捉时间序列上的动态信息和空间细节,实现了卓越的视频超分辨率效果。

技术分析

D3Dnet的核心在于其独特的可变形3D卷积层,能够根据预测的偏移量动态调整滤波器的位置,这远超传统固定网格采样的范畴,极大提高了模型对复杂时空变换的适应能力。结合深度神经网络的多层非线性映射特性,D3Dnet能够有效学习并重建高分辨率视频帧,达到了当前技术前沿的定量和定性结果。

应用场景

D3Dnet的强大之处在于其广泛的应用范围。从在线流媒体服务的质量提升到历史影像资料的高清修复,再到监控录像的细节增强,几乎涵盖了所有需要视频画质提升的场合。特别是在影视制作、远程教育、智能安防等领域,该技术可以显著改善用户体验,甚至在科学可视化和医疗影像分析中也有着潜在应用价值。

项目特点

- 高度灵活性:支持任意维度的3D卷积变形,适应多样化的视频处理需求。

- 卓越性能:通过精准的时间和空间采样,大幅度提高视频超分辨率的效果。

- 易于部署:基于成熟的PyTorch框架,提供详细的构建指南,便于研究人员和开发者快速上手。

- 全面的评价体系:提供包括量化评估和视觉比较在内的全方位测试手段,确保模型的有效性和实用性。

- 开放共享:不仅提供了代码,还有视频质量评估工具的配套,鼓励社区参与和贡献。

结语

D3Dnet是视频处理领域的革新之作,它以先进的技术实力和开放的姿态,为追求高质量视频体验的开发者们提供了一个强大的工具箱。无论你是致力于视频优化的技术专家,还是对图像处理充满好奇的学习者,D3Dnet都值得您深入探索,共同推动视频超分辨率技术的进步。现在就加入进来,开启您的高清视界之旅!

以上是对D3Dnet项目的简要介绍和推荐。如果你正寻找提升视频质量的解决方案,不妨尝试一下这个充满潜力的开源项目。记得遵守开源协议,并考虑在你的工作中引用原作者的工作成果,尊重知识的传播与发展。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考