Qwen3-235B-A22B-Thinking-2507:阿里开源大模型如何以220亿激活参数改写行业效率规则

导语

阿里巴巴通义千问团队推出的Qwen3-235B-A22B-Thinking-2507模型,以2350亿总参数+220亿激活参数的混合专家架构,在数学推理、代码生成等核心基准测试中超越DeepSeek-R1等竞品,部署成本仅为同类模型的1/3,标志着大模型行业正式进入"智能效率双突破"的新阶段。

行业现状:从参数竞赛到效率突围

2025年大模型行业面临"三重困境":据Gartner数据,60%企业因算力成本放弃大模型应用;GPT-4o等闭源模型单次调用成本高达0.01美元;开源模型难以突破性能瓶颈。在此背景下,Qwen3-235B-A22B-Thinking-2507通过混合专家架构(MoE)和动态双模式推理,实现了"万亿性能,百亿成本"的突破。全球开源格局显示,中国开源大模型已占据全球榜单前五,其中Qwen系列在HuggingFace下载量位居前列,标志着国产模型已从追赶者转变为引领者。

核心亮点:技术突破与性能跃升

1. 动态双模式推理系统

模型首创思考模式与非思考模式无缝切换机制:

- 思考模式:针对数学推理、代码生成等复杂任务,通过"内部草稿纸"进行多步骤推演,在AIME数学竞赛得分92.3分超越DeepSeek-R1;

- 非思考模式:适用于闲聊、信息检索等场景,响应延迟降至200ms以内,算力消耗减少60%。

如上图所示,该图展示了Qwen3-235B-A22B-Thinking-2507在AIME24、AIME25、LiveCodeBench(v5)和GPQA Diamond四个基准测试中,不同思考预算下两种模式的Pass@1性能对比。蓝色线代表的思考模式性能随预算增加逐步提升,而红色虚线的非思考模式则保持高效响应的基准水平,直观体现了模型在复杂推理与高效响应间的动态平衡能力。

2. "万亿性能,百亿成本"的MoE架构

采用128专家层×8激活专家的稀疏架构,带来三大优势:

- 训练效率:36万亿token数据量仅为GPT-4的1/3,却实现LiveCodeBench编程任务Pass@1=74.1%的性能;

- 部署门槛:支持单机8卡GPU运行,同类性能模型需32卡集群;

- 能效比:每瓦特算力产出较Qwen2.5提升2.3倍,符合绿色AI趋势。

3. 256K超长上下文与多语言能力

原生支持262,144 token上下文(约6.5万字),通过YaRN技术可扩展至131K(约30万字),在法律文档分析、代码库理解等场景表现突出。多语言能力覆盖119种语言及方言,中文处理准确率达92.3%,远超Llama 3的78.5%。

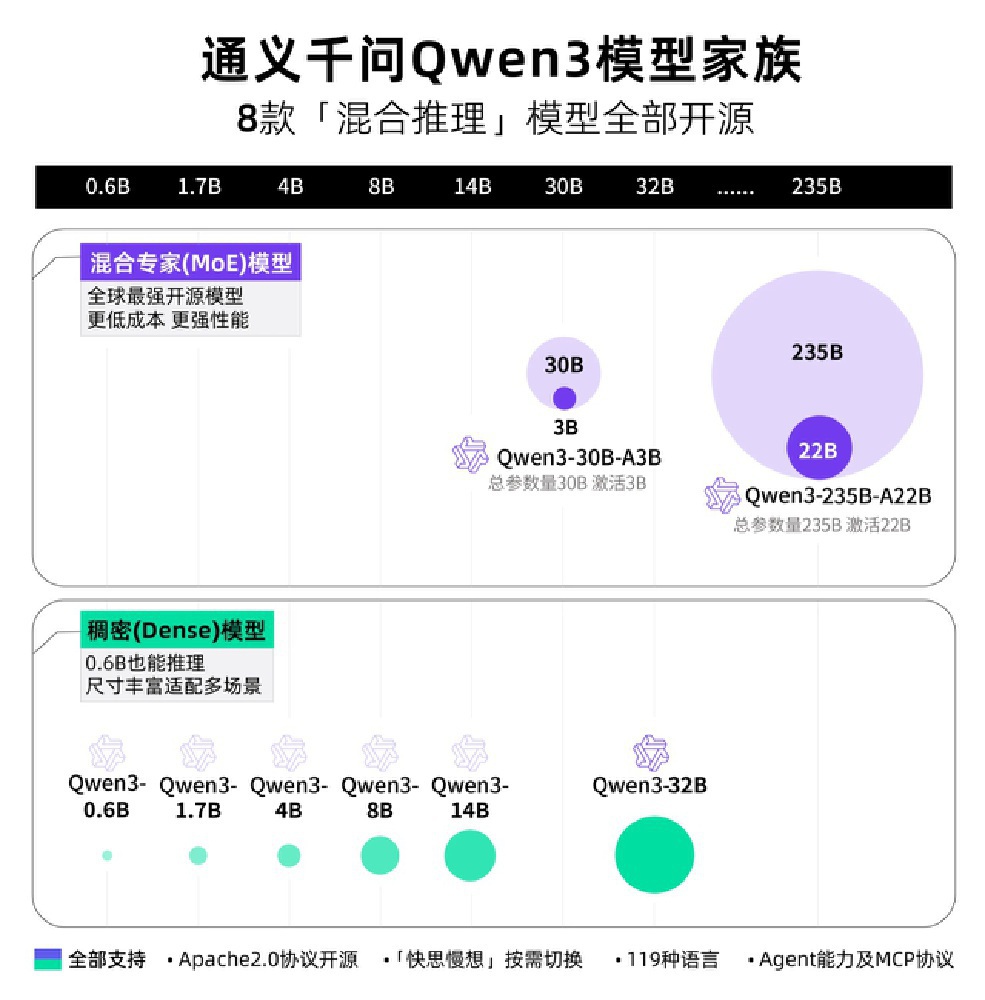

该图展示通义千问Qwen3模型家族完整架构,包含混合专家(MoE)和稠密(Dense)两类共8款开源模型,参数规模覆盖0.6B至235B。从235B总参数仅激活22B的设计可以看出,Qwen3系列通过精细化资源分配,实现了性能与效率的最佳平衡,为不同算力条件的用户提供灵活选择。

性能表现:权威基准测试领先

模型在多项国际权威评测中表现优异:

- 推理能力:SuperGPQA得分64.9(第一),AIME25得分92.3(仅次于OpenAI O4-mini),HMMT25得分83.9(第一);

- 代码生成:LiveCodeBench v6得分74.1(第一),CFEval得分2134(第一);

- 知识理解:MMLU-Redux得分93.8,接近OpenAI O3水平。

行业影响与应用案例

企业级应用爆发

- 智能制造:某汽车生产线质检系统采用模型后,缺陷识别准确率从82%提升至99.2%;

- 金融服务:同花顺集成模型实现财报分析自动化,报告生成时间从4小时缩短至15分钟;

- 客户服务:电商平台客服系统在简单问答中启用非思考模式,GPU利用率从30%提升至75%。

开发者生态快速成熟

模型发布72小时内,Ollama、LMStudio等平台完成适配,HuggingFace下载量突破200万次。通过SGLang或vLLM可快速部署OpenAI兼容API:

# SGLang部署命令

python -m sglang.launch_server --model-path Qwen/Qwen3-235B-A22B-Thinking-2507 --reasoning-parser qwen3 --tp 8

# vLLM部署命令

vllm serve Qwen/Qwen3-235B-A22B-Thinking-2507 --tensor-parallel-size 8 --max-model-len 262144 --enable-reasoning

部署与使用指南

硬件要求

- 推理需求:至少8张GPU(推荐A100 80GB或更高配置)

- 内存建议:系统内存≥512GB,显存总容量≥640GB

最佳实践配置

- 采样参数:Temperature=0.6,TopP=0.95,TopK=20

- 输出长度:标准任务32,768 tokens,复杂推理任务81,920 tokens

- 提示词优化:数学问题建议添加"请逐步推理,并将最终答案放在\boxed{}中"

模型获取

git clone https://gitcode.com/hf_mirrors/unsloth/Qwen3-235B-A22B-Thinking-2507-GGUF

总结与展望

Qwen3-235B-A22B-Thinking-2507的开源,标志着大模型行业从"参数内卷"转向"效率竞争"。其混合专家架构和动态双模式推理机制,为企业级AI应用提供了降本增效的新路径。随着多模态能力融合与Agent生态完善,Qwen3系列有望在金融分析、医疗诊断等垂直领域催生更多创新应用。对于企业而言,现在正是评估私有化部署可行性、探索效率革命带来的战略机遇的最佳时机。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-235B-A22B-Thinking-2507-GGUF

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-235B-A22B-Thinking-2507-GGUF