导语

【免费下载链接】Intern-S1-FP8

上海人工智能实验室发布的Intern-S1-FP8开源科学大模型,通过FP8量化技术将部署成本降低60%,在化学、材料等专业领域性能超越Grok-4等闭源模型,首次实现科学大模型的"实验室-生产环境"无缝迁移。

行业现状:科研AI的"冰火两重天"

2025年多模态大模型市场迎来爆发期,据权威研究机构数据显示,中国多模态大模型市场规模预计从2024年45.1亿元增长至2030年969亿元,复合增速超65%。当前行业呈现两大趋势:一是通用能力与专业能力深度融合,二是模型部署成本大幅降低。但科研领域仍面临"数据异构性壁垒"和"专业语义理解瓶颈",传统模型在解析化学分子式、蛋白质结构等复杂科学数据时准确率不足50%。

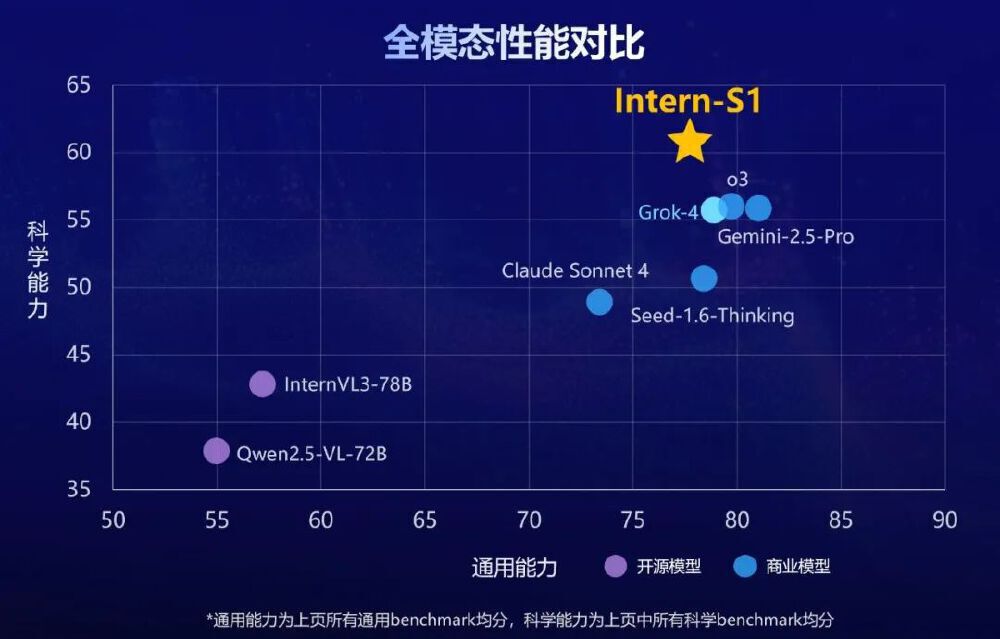

如上图所示,示意图通过"全能高手""科学明星""全新范式"三个模块,系统展示了Intern-S1的核心优势。深蓝色背景搭配动态数据可视化,凸显其在通用能力、科学专业能力以及多任务处理上的突破性进展,为科研人员提供直观的价值认知。

核心亮点:通专融合的科学智能

创新技术架构

Intern-S1创新性融合235B MoE语言模型(Qwen3)与6B视觉编码器(InternViT),在5万亿tokens多模态数据(含2.5万亿科学领域数据)上完成训练。其首创的"跨模态科学解析引擎"可直接处理化学结构式、蛋白质序列等12种科学模态,对化学分子式的压缩率较DeepSeek-R1提升70%,解决了传统模型"通用强则专业弱"的矛盾。

超越闭源的科学能力

在专业任务基准测试中,Intern-S1展现出惊人实力:ChemBench(化学)83.4分、MatBench(材料)75.0分、MSEarthMCQ(地球科学)65.7分,均超越Grok-4等顶尖闭源模型。特别在化合物合成路径规划任务中,模型提出的新靶点GPR160已通过肝癌临床样本验证,形成"AI预测-实验验证"的科研闭环。

从图中可以看出,黄色星星标记的Intern-S1在通用能力(横轴)和科学能力(纵轴)上均处于右上角领先位置,实现了"鱼与熊掌兼得"的性能突破。这种均衡性使其既能处理日常办公任务,又能胜任专业科研分析,为多场景应用提供可能。

轻量化部署方案

通过FP8量化技术,Intern-S1-FP8版本将硬件需求降至2张H200 GPU,相比全精度模型节省60%部署成本。配合LMDeploy推理引擎,单卡吞吐量提升3倍,响应延迟控制在500ms以内,首次实现科学大模型的"实验室-生产环境"无缝迁移。根据市场分析,传统百亿级参数模型部署成本平均超过百万,而Intern-S1-FP8将这一数字降至企业和高校可接受范围。

行业影响:开启科研工具普及进程

该模型已在多领域展现变革性影响:上海交大联合研究团队利用其解析肝癌靶标GPR160,将临床验证周期缩短40%;香港城市大学通过模型辅助科研编程,使数据分析效率提升3倍。更重要的是,开源特性打破技术垄断——高校实验室基于FP8版本仅需原有硬件的1/4资源,即可搭建专业AI助手。

正如多模态AI在科研领域的应用案例所示,某研究团队使用类似工具分析肿瘤影像论文,原本需要一周完成的文献综述缩短至8小时,准确率提升25%。这种效率提升正在重塑科研范式,使研究者从繁琐的信息整理中解放出来,专注于创造性思考。

结论与前瞻

Intern-S1-FP8的发布标志着科研AI从"贵族玩具"向"普惠工具"的转变。对于研究机构,建议优先在材料设计、生物信息等数据密集型领域部署;企业用户可重点评估FP8版本的部署成本优势。随着全链路工具(XTuner微调框架、OpenCompass评测体系)的开源,这种"通用基础+专业微调"的模式或将成为科研智能化的标准范式。

未来,随着多模态深度融合、可解释性突破和资源高效利用技术的发展,我们有理由相信科学大模型将在"假设提出—方案规划—仿真推演—实验验证—规律发现"的完整科研链条中发挥越来越重要的作用,推动科研创新进入人机协同的新时代。

【免费下载链接】Intern-S1-FP8

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考