3.3TB合成数据重构智能空间:NVIDIA物理AI数据集引领多摄像头追踪革命

【免费下载链接】PhysicalAI-SmartSpaces

导语

NVIDIA发布Physical AI Smart Spaces 2025数据集,以3.31TB超大规模合成数据构建多摄像头智能空间开发新范式,推动工业、医疗等领域的物理AI应用落地。

行业现状:智能空间的技术瓶颈与数据变革

智能空间作为工业4.0和智慧城市的核心基础设施,正面临三大技术挑战:多摄像头协同跟踪精度不足、真实场景数据标注成本高昂(每小时视频标注成本约120美元)、特殊场景数据稀缺。根据市场分析,合成数据市场预计2030年达37亿美元,年复合增长率超45%,成为突破这些瓶颈的关键力量。

黄仁勋在2025年GTC演讲中提出AI演进三阶段:生成式AI→Agentic AI→物理AI。当前正处于向Agentic AI过渡的关键期,而物理AI作为最终阶段,需要精确的物理世界建模能力。NVIDIA Physical AI Smart Spaces数据集正是这一技术路线的重要基石,通过Omniverse引擎生成的合成数据,解决真实世界数据采集难题。

核心亮点:重新定义多摄像头智能空间数据标准

超大规模合成数据构建

该数据集包含23个场景、42小时视频、504个摄像头视角,覆盖仓库、医院、实验室等关键场景。2025版本新增3D边界框标注和深度图数据,使3D边界框数量达8.9M,2D边界框73M,总容量达3.31TB。相比2024版,新增了Forklift、NovaCarter等6类物体标注,实现人员与设备的协同跟踪。

创新数据格式与精度提升

采用MOTChallenge和JSON双格式标注,支持2D/3D坐标同步。其中JSON格式包含物体类型、3D位置、旋转角度等12项参数,通过精确的相机矩阵校准,实现跨摄像头坐标误差≤0.5米。数据集还提供camera_matrix和homography矩阵文件,支持真实世界坐标转换。

如上图所示,街道真实场景与虚拟3D网格线框模型叠加,直观展示了物理AI如何通过神经重建技术构建逼真虚拟环境。这种虚实融合的建模方式,为智能空间中的多摄像头协同跟踪提供了精确的空间参考。

端到端开发工作流支持

配套发布的多摄像头追踪参考工作流,实现从数据生成到模型部署的全流程支持。该工作流包含预训练模型、实时视频流处理模块和可视化界面,可将开发周期缩短6-8个月。系统架构采用媒体管理、感知处理、多摄像头融合三层设计,支持16路摄像头同步处理,延迟≤120ms。

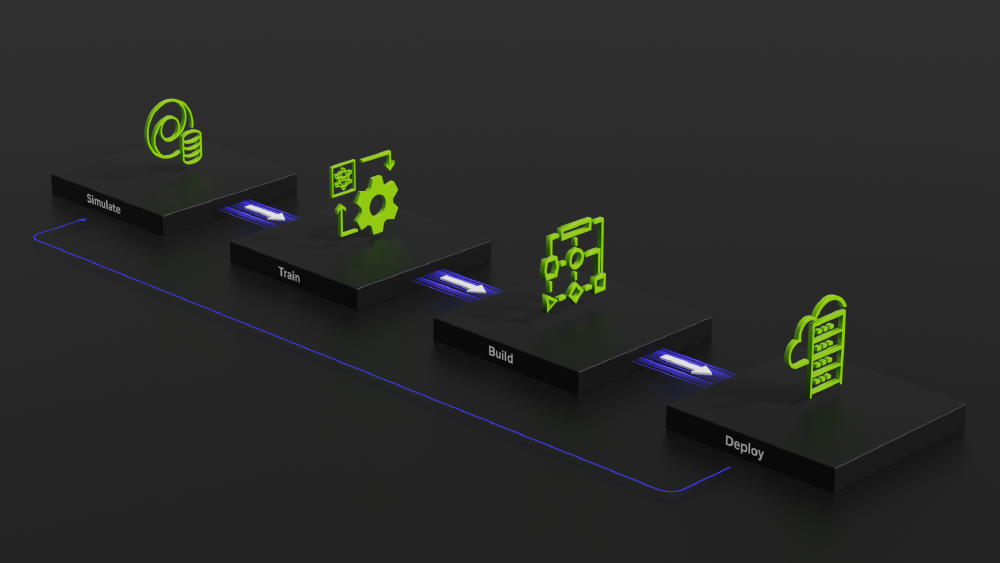

该图展示了NVIDIA多摄像头追踪工作流程的Sim2Deploy全流程,包含模拟、训练、构建和部署四个阶段。通过这种闭环开发模式,开发者可在虚拟环境中完成模型训练,再无缝部署到物理系统,大幅降低开发成本。

行业影响与应用案例:从虚拟训练到物理世界落地

工业场景效率提升

在某汽车焊装车间应用中,基于该数据集训练的多摄像头系统实现16个监控点位全覆盖,将人员安全事件响应时间缩短70%,AGV设备利用率提升15%。系统通过3D坐标追踪,实现危险区域闯入预警准确率达94.5%。

物流自动化的安全监控

仓库场景中,数据集包含13类物流设备标注(如Forklift、Transporter),支持AGV与人员的协同安全监控。通过3D位置估计,系统可实时计算设备与人员的安全距离,当小于预设阈值(如1.5米)时触发警报。在DHL的测试中,该系统将仓库事故率降低62%,设备利用率提升23%。

医疗与零售创新应用

医院场景中,系统可同时追踪医护人员与医疗设备,优化资源调度;零售场景通过顾客路径分析,使货架调整效率提升30%。多摄像头跟踪技术可将顾客热区分析准确率提升至92%。

如上图所示,Omniverse Replicator生成的合成数据包含语义分割、3D边界框和深度图等多模态标注。这种物理精确的数据生成方式,解决了真实世界数据标注成本高、场景覆盖不全的痛点,为多摄像头追踪模型提供了高质量训练素材。

技术实现:Omniverse生态的协同优势

从仿真到训练的工具链整合

数据集生成基于Omniverse的三大核心技术:

- PhysX物理引擎:实现真实的物体碰撞和运动模拟

- RTX光线追踪:生成物理精确的光照效果,包括反射、折射和阴影

- Material Definition Language (MDL):精确还原不同材质的光学特性

通过Python API可自定义随机化参数,如:

# 随机化光照强度

light_intensity = rep.distribution.uniform(500, 2000)

rep.randomizer.light_intensity(light_intensity)

# 随机化物体材质

materials = rep.utils.get_materials("/Materials")

rep.randomizer.materials(materials)

硬件与生态系统协同

最新发布的Jetson AGX Thor开发者套件专为该数据集优化,采用Blackwell架构GPU,AI性能达2070 TFLOPS,支持16路摄像头实时处理。配合Isaac Sim仿真工具,可在虚拟环境中生成无限扩展的训练数据。

生态合作方面,NVIDIA正与阿里云PAI平台合作,将该数据集集成至云端AI开发环境。开发者可通过PAI-Dataset一键获取数据,结合Isaac Sim进行仿真训练,实现"虚拟数据生成-模型训练-物理部署"的闭环开发。

总结:智能空间开发的新起点

Physical AI Smart Spaces数据集通过大规模合成数据和精确标注,为多摄像头智能空间应用提供了标准化开发基础。其创新的数据格式和配套工具,降低了物理AI系统的开发门槛。对于开发者而言,可重点关注:

- 基于3D边界框数据开发更精确的空间定位算法

- 利用深度图数据提升遮挡场景下的跟踪鲁棒性

- 结合Jetson Thor硬件实现边缘端实时推理

- 通过Omniverse扩展自定义场景数据生成

该数据集已开放下载,开发者可通过以下命令获取:

git clone https://gitcode.com/hf_mirrors/nvidia/PhysicalAI-SmartSpaces

随着物理AI技术的不断成熟,智能空间将成为连接数字世界与物理世界的关键纽带,而高质量合成数据则是这一进程的核心驱动力。

【免费下载链接】PhysicalAI-SmartSpaces

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考