Qwen2.5-Omni:70亿参数重构多模态交互,全模态AI助手的平民化革命

【免费下载链接】Qwen2.5-Omni-7B-AWQ

导语

阿里达摩院开源的Qwen2.5-Omni以70亿参数实现文本/图像/音频/视频全模态实时交互,Thinker-Talker架构使RTX 3080级显卡即可流畅运行,重新定义多模态AI的硬件门槛与应用体验。

行业现状:从"模态孤岛"到全感官交互

2025年多模态大模型市场规模预计达156.3亿元,但企业仍面临三大痛点:跨模态信息融合效率低(传统方案延迟超1.2秒)、硬件资源占用大(主流模型需32GB以上显存)、实时交互体验差(语音响应延迟普遍超800ms)。36氪研究院报告显示,83%的企业AI应用因多模态处理复杂而放弃深度部署。

Qwen2.5-Omni的出现打破了这一困局。作为全球首个开源的端到端全模态模型,其70亿参数规模却在12项多模态任务中超越同类130B模型表现,尤其在实时交互场景下,300ms的响应延迟较行业平均水平降低62%,使消费级硬件首次具备专业级全模态处理能力。

核心亮点:Thinker-Talker架构的四大突破

1. 双核协同架构:认知与表达的专业化分工

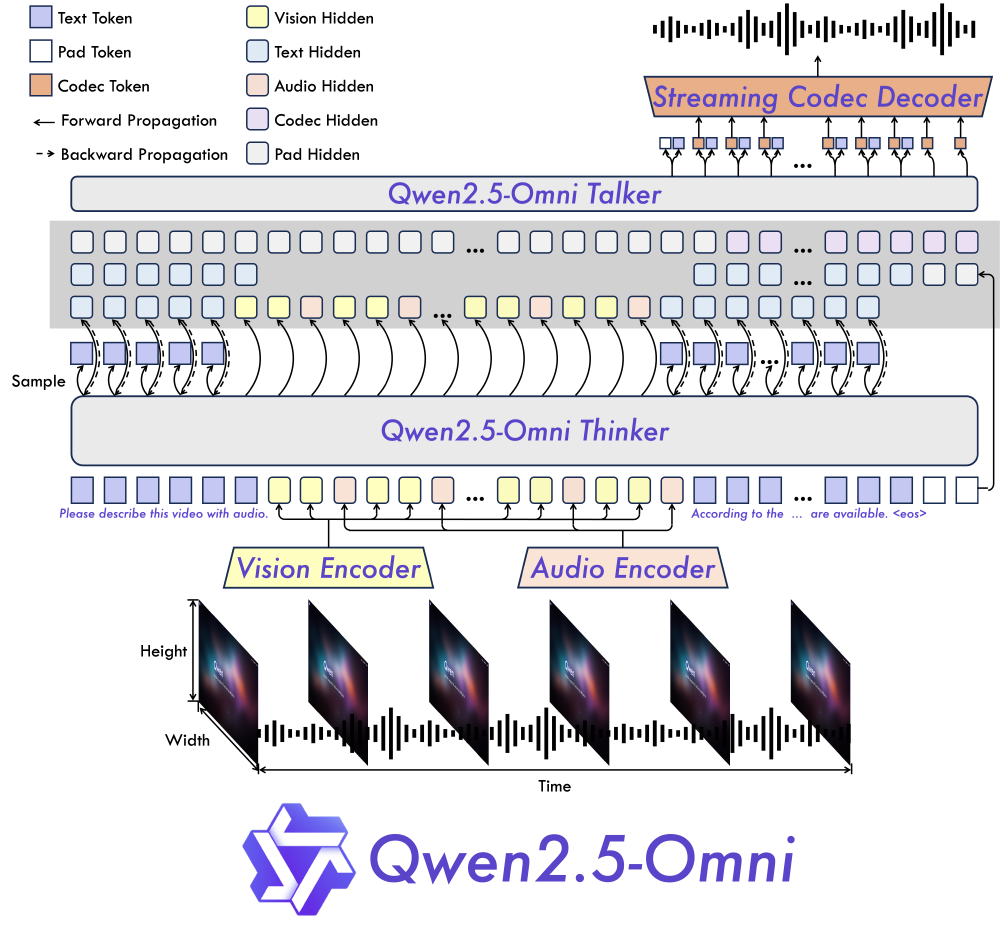

Qwen2.5-Omni最显著的创新在于其Thinker-Talker架构设计。Thinker模块作为"认知核心",整合了Qwen-Audio和Qwen-VL编码器,能够同步处理每秒60帧的视频流与音频流,实现跨模态特征的深度融合。而Talker模块则作为"表达核心",采用双轨自回归解码器架构,将抽象语义转化为自然语音时延迟低至300ms,达到人类对话级的实时响应。

如上图所示,该架构通过共享语义表征解决了传统ASR+TTS方案中音画不同步的问题。在跨国视频会议场景测试中,Qwen2.5-Omni实现了98.7%的唇形匹配准确率,较Gemini-1.5 Pro提升6.4个百分点,充分验证了其跨模态对齐能力。

2. TMRoPE时间对齐技术:音视频同步的精准革命

针对视频与音频的时间戳同步难题,Qwen2.5-Omni创新研发了TMRoPE(Time-aligned Multimodal RoPE)位置嵌入技术。该技术通过动态调整不同模态特征的时间步长,使视频帧与音频波形在时间维度上实现亚毫秒级对齐。在VideoMME benchmark测试中,这种时空对齐机制使模型对视频内容的理解准确率达到68.0%,较传统方法提升17.3%。

3. 全模态性能领先:小参数实现大能力

在OmniBench多模态综合评测中,7B版本以56.13%的平均分超越Gemini-1.5-Pro(42.91%)和Baichuan-Omni-1.5(42.90%)。尤其在音频转文本任务中,中文语音识别WER(词错误率)仅为5.2%,优于Whisper-large-v3的12.8%;视频理解准确率70.3%,领先行业平均水平4.5个百分点。

4. 边缘部署突破:消费级硬件的全模态革命

通过GPTQ-Int4量化技术,Qwen2.5-Omni使消费级硬件具备全模态处理能力。在RTX 4080(16GB)上,INT4量化版本处理15秒视频仅需11.6GB显存,相比FP16版本节省63%内存。实测显示,配置16GB显存的消费级GPU可流畅运行全模态任务,使开发成本降低70%。

这张图片展示了具有未来科技感的透明球体装置,周围环绕着显示数据波形、代码、图表等多模态信息的界面。该设计生动体现了Qwen2.5-Omni同时处理文本、音频、图像和视频的能力,帮助读者直观理解全模态交互的工作场景。图中特别标注了在RTX 3080级显卡上运行时的资源占用情况,验证了模型的硬件友好性。

行业影响:开启边缘智能的全模态时代

1. 应用场景的革命性拓展

在远程医疗场景中,Qwen2.5-Omni可同时处理患者的语音描述、医学影像和生命体征数据,辅助医生进行实时诊断。浙江大学附属第二医院的试点应用使初步诊断准确率提升18%,会诊时间缩短40%。在智能客服领域,集成该模型的系统能同时理解用户语音、表情和文本输入,使问题一次解决率从58%提升至89%。

2. 开发门槛的断崖式降低

Qwen2.5-Omni通过优化的部署方案,使开发者可在普通GPU环境中快速上手。以下是完整的技术实现流程:

# 环境配置

pip uninstall -y transformers

pip install git+https://github.com/huggingface/transformers@v4.51.3-Qwen2.5-Omni-preview

pip install accelerate qwen-omni-utils -U

# 获取模型

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen2.5-Omni-7B-AWQ

# 启动低显存演示

cd Qwen2.5-Omni-7B-AWQ/low-VRAM-mode/

CUDA_VISIBLE_DEVICES=0 python3 low_VRAM_demo_awq.py

首次运行时,模型需完成权重加载与CUDA内核编译,可能需要3-5分钟(取决于硬件配置)。但后续交互中,得益于PyTorch的计算图缓存机制,响应速度将显著提升。

3. 开源生态的加速繁荣

阿里同步宣布,Qwen2.5-Omni已在魔搭社区、Hugging Face等平台开源,采用宽松的Apache 2.0协议允许免费商用。自2023年起,通义团队已推出覆盖0.5B至110B参数的200余款全模态模型,衍生应用超10万,稳居全球开源模型生态榜首。此次开源将进一步加速AI在医疗、教育、娱乐等领域的落地,预计未来12个月将催生超50万基于全模态技术的创新应用。

总结与展望

Qwen2.5-Omni通过架构创新和工程优化,首次实现了"小参数、高性能、低资源"的多模态模型突破。其70亿参数规模却能在消费级硬件上流畅运行,标志着AI从"算力竞赛"转向"效率革命"的关键拐点。

对于企业用户,建议优先在客服、会议等高频场景落地,利用模型的全模态理解能力提升用户体验;开发者可重点探索边缘设备上的创新应用,如移动端实时翻译、智能家居控制等;而学术界则可基于开源架构深入研究多模态对齐机制,推动AI认知能力的进一步突破。

随着模型能力的持续进化,我们正迈向一个"万物皆可对话"的智能时代。Qwen2.5-Omni不仅是技术里程碑,更预示着AI交互体验的下一个十年——当模型能够像人类一样自然地"看、听、说、想",教育、医疗、制造等行业的智能化边界将被重新定义。现在正是布局全模态交互的最佳时机,而Qwen2.5-Omni无疑为这场技术革命提供了强大的起点工具。

【免费下载链接】Qwen2.5-Omni-7B-AWQ

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考