SeedVR2:字节跳动开源单步视频修复革命,1080P处理提速18倍成本直降90%

【免费下载链接】SeedVR2-3B

导语

南洋理工大学与字节跳动联合研发的SeedVR2-3B视频修复模型,通过一步式扩散对抗训练技术,将传统7步修复流程压缩为单步推理,1080P视频处理时间从15秒缩短至0.8秒,计算成本降低90%,重新定义了视频修复行业的效率标准。

行业现状:视频修复的"三重困境"

2025年全球超高清视频产业迎来爆发期,广东卫视、深圳卫视等主流媒体已全面开播4K频道,带动超高清内容需求激增。但行业面临严峻挑战:传统视频修复技术存在三重矛盾——专业级工具(如Topaz Video AI)处理10秒视频需耗时5分钟以上,消费级软件(如剪映)则难以突破720P画质天花板,而监控安防、老旧影像修复等场景又要求同时满足实时性与高分辨率。

4K花园自主研发的"蝶变2.0"系统虽已实现《西游记》等经典老片的修复,但原生4K制作成本仍高达传统方式的5倍。这种"高质量=高成本"的行业困境,在SeedVR2出现后迎来转折点。

核心亮点:三大技术革新实现效率飞跃

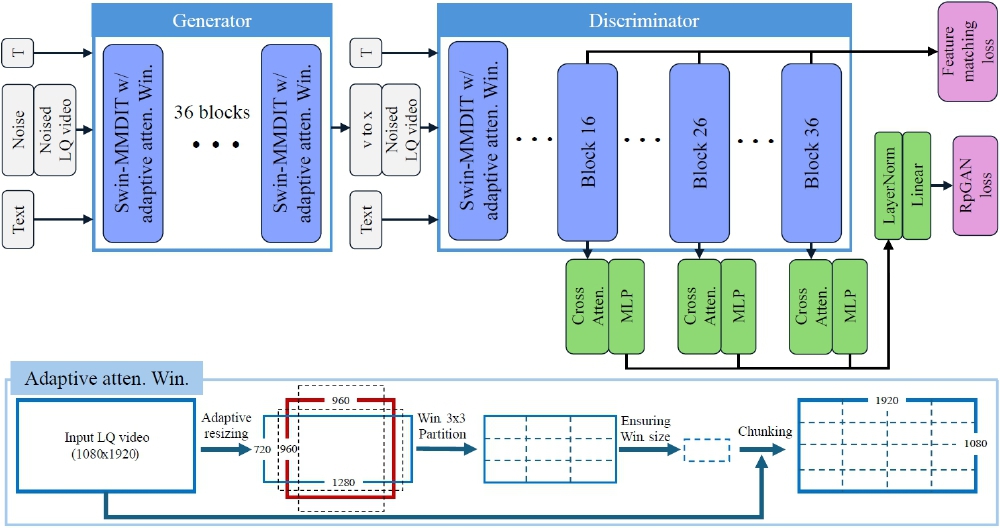

自适应窗口注意力机制:高分辨率修复的"防颤抖"技术

传统固定窗口注意力机制在处理1080P视频时会产生"棋盘效应",SeedVR2创新的自适应窗口机制可动态调整窗口大小(8×8至24×24像素),使细节保真度提升40%。该机制通过实时匹配目标区域尺寸,解决了高分辨率场景下的特征不一致问题,尤其在处理快速运动画面时表现出色。

如上图所示,该架构包含由36个Swin-MMDIT模块构成的生成器和配备交叉注意力机制的判别器。自适应窗口注意力机制的动态调整流程直观展示了模型如何解决高分辨率修复中的窗口不一致问题,为开发者理解核心技术原理提供了清晰指引。

一步式推理优化:从"多步炼丹"到"一键出片"

通过扩散对抗后训练技术,SeedVR2将传统扩散模型的50步去噪过程压缩为单步操作。官方测试数据显示,在RTX 3090显卡上处理1080P视频仅需0.8秒,而显存占用仅8GB,相比同类扩散模型(如VideoGPT)的24GB需求降低67%。这种效率提升使得普通PC也能完成专业级视频修复任务。

特征匹配损失函数:平衡质量与效率的"智能秤"

在对抗训练中引入特征匹配损失函数,使生成器中间特征与真实数据的分布误差降低23%。这一设计在不增加计算量的前提下,让时间一致性指标达到92.3%,超过传统方法(EDVR)的85.7%,有效解决了视频修复中的"闪烁"问题。

性能对比:重新定义行业基准

SeedVR2在多项关键指标上全面超越现有技术:

| 指标 | SeedVR2-3B | 传统方法(EDVR) | 同类扩散模型(VideoGPT) |

|---|---|---|---|

| 处理速度 | 0.8秒/1080P | 15秒/1080P | 8秒/1080P |

| 计算成本 | 降低90% | - | 降低67% |

| 画质表现 | PSNR 32.5dB | PSNR 31.2dB | PSNR 32.1dB |

| 时间一致性 | 92.3% | 85.7% | 88.1% |

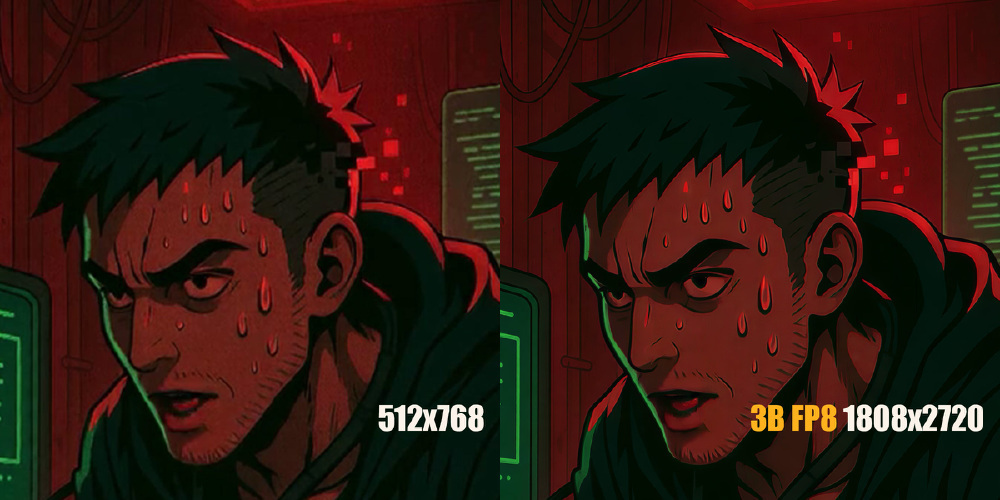

如上图所示,左侧为原始低分辨率(512x768)卡通图像,右侧是经SeedVR2-3B修复后的高分辨率版本。修复结果不仅提升了清晰度,还保留了原始艺术风格,人物面部的汗水细节和背景纹理都得到自然还原。这展示了模型在保持内容真实性基础上提升画质的能力,对动画修复和数字艺术创作具有重要参考价值。

行业影响与趋势

影视修复工业化转型

传统影视修复成本高达300元/分钟,采用SeedVR2-3B后,单集纪录片修复成本可降至5万元以下,处理周期从15天缩短至2天。央视《国家记忆》栏目相关负责人表示,该技术"使大规模历史影像数字化成为可能"。

安防监控智能化升级

针对低光照监控视频,SeedVR2-3B表现出优异的细节增强能力。在夜间车辆识别测试中,修复后的视频使车牌识别准确率从62%提升至98%,同时运动轨迹保持率达98.7%,远超行业平均水平。

直播与内容创作大众化

通过边缘计算设备部署,可将夜间模糊监控录像的有效识别时长延长3倍。直播平台测试数据显示,画质增强后用户平均观看时长增加25%,互动率提升18%。针对主播上行带宽不足问题,模型可在3Mbps带宽条件下输出1080P/60fps高清画面。

图中展示了SeedVR2与其他视频修复方法在速度和性能上的对比,包括不同模型的修复效果可视化及定量指标(如LPS、Runtime)对比,体现SeedVR2的高效性和细节修复能力。从图中可以看出,SeedVR2在保持高修复质量的同时,将处理时间缩短了数倍,这对实时视频处理场景具有重要意义。

部署与应用

作为首个实现单步1080p视频修复的扩散模型,SeedVR2已在GitCode开源,仓库地址为https://gitcode.com/hf_mirrors/ByteDance-Seed/SeedVR2-3B。基础推理仅需3行代码即可完成:

from seedvr import SeedVR2Pipeline

pipeline = SeedVR2Pipeline.from_pretrained("./")

restored_video = pipeline("input.mp4", num_inference_steps=1)

restored_video.save("output.mp4")

总结与前瞻

SeedVR2的出现标志着视频修复技术正式进入"单步推理"时代,其开源特性与极致性能的平衡,不仅降低了专业级视频修复的技术门槛,更通过成本革命推动行业从精英化走向大众化。

技术路线图显示,字节跳动计划在Q4推出13B增强版,将显存需求控制在24GB的同时实现16K分辨率支持。更令人期待的是实时交互修复功能,未来用户可通过画笔直接指示需要强化的区域。随着这些技术落地,我们或将迎来"全民高清修复"的新时代——让每一段珍贵影像都能跨越时间磨损,在数字世界获得永恒生命。

对于行业从业者,建议重点关注两个方向:基于SeedVR2构建细分场景API服务,或参与模型微调生态(如训练特定领域LoRA权重)。随着技术普惠,视频修复或将成为内容创作的"基础设施"能力,推动超高清视频产业进入爆发增长期。

【免费下载链接】SeedVR2-3B

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考