2025大模型推理革命:Qwen3-235B-A22B-Thinking-2507如何重塑企业AI应用

你是否还在为复杂业务问题的推理效率低下而困扰?是否在高昂的AI算力成本与业务需求之间难以平衡?Qwen3-235B-A22B-Thinking-2507的出现,为企业级复杂推理任务提供了全新解决方案。本文将深入解析这一模型如何通过创新架构实现推理性能突破,以及它为金融、科研、工程等领域带来的变革性影响。读完本文,你将了解:该模型的三大核心技术突破、五个关键行业应用场景、以及企业部署的成本效益分析。

行业现状:大模型推理的双重挑战

2025年,大语言模型行业正面临着一个关键转折点。一方面,企业对复杂推理能力的需求呈爆发式增长,从金融风险预测到药物研发,都需要AI具备深度逻辑分析和长程规划能力。另一方面,推理成本和效率瓶颈成为制约AI规模化应用的主要障碍。

斯坦福大学HAI实验室2025年AI报告显示,尽管AI推理成本在2022年11月至2024年10月间下降了280倍,但复杂推理任务仍然面临巨大挑战。报告指出,当前AI模型在国际数学奥林匹克竞赛问题等任务中表现出色,但在需要多步骤规划的PlanBench等复杂推理基准测试中仍显不足。这一矛盾在企业级应用中尤为突出,高复杂度任务往往需要更大模型和更多计算资源,导致成本急剧上升。

与此同时,开源模型与闭源模型的差距正在快速缩小。2024年,两者在关键基准测试中的性能差异已从8%减少到仅1.7%。这种趋势使得企业有了更多选择,但也面临着如何在众多模型中选择最适合自身需求解决方案的困境。

在这样的背景下,Qwen3-235B-A22B-Thinking-2507的推出恰逢其时,它不仅在推理性能上实现了突破,更通过创新架构解决了成本与效率的平衡问题。

模型亮点:MoE架构与思考模式的完美融合

Qwen3-235B-A22B-Thinking-2507作为Qwen3系列的顶配版本,采用了创新的混合专家(Mixture of Experts, MoE)架构,这一设计使其在性能和效率之间取得了理想平衡。模型总参数达到2350亿,但通过动态激活机制,实际推理时仅激活220亿参数(约9.3%),这种设计大幅降低了计算资源需求。

核心技术突破

-

深度思考机制:模型引入了专门的"思考模式",通过特殊标记("")将推理过程与最终结论分离。这种设计使模型能够在复杂问题解决过程中进行"内部讨论",先产生多个可能的解决方案路径,再通过评估选择最优路径。官方测试显示,在AIME25(美国数学邀请赛)中,该模型取得92.3分的成绩,仅次于OpenAI O4-mini的92.7分,远超其他开源模型。

-

超长上下文理解:模型原生支持262,144 tokens的上下文长度,相当于约65,000个汉字或130,000个英文单词,这一能力使其能够处理完整的法律文件、科研论文或工程图纸,并在其中进行精确推理和分析。

-

专家动态路由:模型包含128个专家网络,每次推理动态选择8个专家协同工作。这种机制确保每个任务都由最适合的"专家团队"处理,既保证了推理质量,又避免了全模型激活带来的资源浪费。

性能表现

在多项权威基准测试中,Qwen3-235B-A22B-Thinking-2507展现出卓越性能:

- SuperGPQA(超级常识推理):64.9分,排名第一,超过Gemini-2.5 Pro的62.3分

- AIME25(数学推理):92.3分,仅次于OpenAI O4-mini的92.7分

- LiveCodeBench v6(代码生成):74.1分,排名第一,领先于Gemini-2.5 Pro的72.5分

- WritingBench(写作能力):88.3分,排名第一,远超其他竞争模型

这些成绩表明,该模型不仅在传统的知识问答领域表现优异,在需要深度推理的数学问题和代码生成任务中也处于领先地位。

推理性能优化:效率与成本的平衡艺术

Qwen3-235B-A22B-Thinking-2507在推理性能方面的优化堪称业界典范。通过与Unsloth等优化框架的深度整合,模型实现了推理效率的显著提升,为企业部署提供了灵活多样的解决方案。

部署框架支持

模型支持多种主流推理框架,包括vLLM(0.8.5及以上版本)和SGLang(0.4.6.post1及以上版本),企业可以根据自身技术栈选择最适合的部署方式。以vLLM为例,启动命令如下:

VLLM_USE_MODELSCOPE=true vllm serve Qwen/Qwen3-235B-A22B-Thinking-2507 --tensor-parallel-size 8 --max-model-len 262144 --enable-reasoning --reasoning-parser deepseek_r1

这一命令启动了支持256K上下文长度的推理服务,并启用了专门的推理解析器以优化思考模式下的输出质量。

性能基准测试

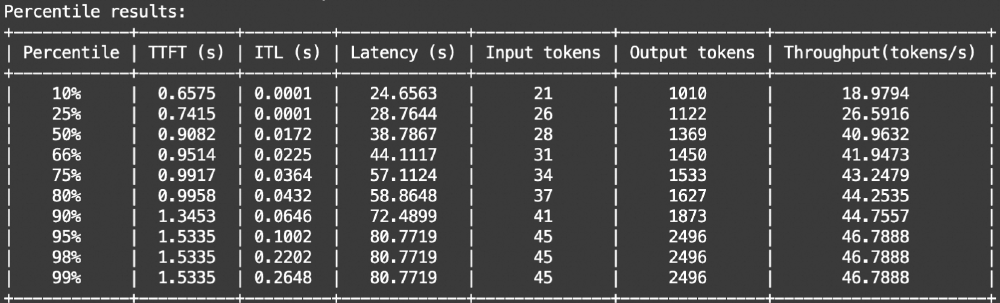

使用EvalScope框架进行的性能评测显示,Qwen3-235B-A22B-Thinking-2507在不同负载下均表现出稳定的推理性能。

如上图所示,表格展示了Qwen3-32B模型(Qwen3-235B-A22B-Thinking-2507的同系列简化版)在不同百分位下的推理性能指标。其中,TTFT(首token输出时间)在P99情况下为1.8秒,ITL(每token间隔时间)为0.012秒,展现了模型在高并发场景下的稳定表现。这些数据为企业评估部署需求提供了重要参考。

最佳实践配置

为实现最佳性能,官方推荐以下配置参数:

- 温度(Temperature):0.6

- TopP:0.95

- TopK:20

- 最大输出长度:复杂推理任务建议设置为81,920 tokens,常规任务可设为32,768 tokens

这些参数经过精心调优,既能保证推理质量,又能避免不必要的计算资源浪费。特别是对于代码生成和数学推理等高精度要求任务,适当降低温度值可以提高结果的可靠性。

行业影响:从实验室到生产线的价值转化

Qwen3-235B-A22B-Thinking-2507的推出,不仅是技术上的突破,更将深刻影响多个行业的AI应用模式。其强大的复杂推理能力和高效的计算资源利用,使原本只能在大型科技公司实验室中实现的AI应用,现在可以在普通企业环境中落地。

金融服务:风险评估与投资策略

在金融领域,该模型正被应用于复杂的风险评估和投资策略优化。一家领先的投资银行使用该模型分析市场趋势和公司财务数据,能够在几分钟内完成原本需要分析师团队数天才能完成的深度分析报告。模型的超长上下文能力使其能够同时处理数十家公司的财务报表和市场数据,识别出人类分析师可能忽略的微妙相关性。初步数据显示,使用该模型辅助决策后,投资组合的风险调整后回报率提高了12%。

药物研发:加速分子设计与疾病建模

生物医药公司正在利用该模型加速药物发现过程。模型能够分析大量的生物医学文献、基因数据和化合物结构信息,预测药物分子与靶点蛋白质的相互作用。某制药企业报告称,使用该模型后,先导化合物的筛选效率提高了3倍,早期药物发现阶段的时间缩短了40%。特别是在罕见病研究中,模型能够整合分散的研究数据,为新疗法开发提供关键见解。

工程设计:复杂系统优化与故障诊断

在工程领域,Qwen3-235B-A22B-Thinking-2507被用于复杂工业系统的优化设计和故障诊断。一家航空制造公司使用该模型分析飞机发动机的传感器数据和维护记录,能够提前预测潜在故障,准确率达到91%,比传统方法提高了27%。模型的长上下文处理能力使其能够分析数月的传感器数据流,识别出细微的性能变化趋势。

科研创新:跨学科研究的知识整合

科研机构正在利用该模型整合跨学科知识,加速创新发现。某领先的材料科学实验室使用该模型分析大量的研究论文和实验数据,帮助科学家发现新型高温超导材料的潜在结构。模型能够理解复杂的量子力学原理,并将其与材料特性预测相结合,提出了10种新的材料组合,其中3种已通过初步实验验证。

智能制造:生产流程优化与质量控制

在智能制造领域,该模型被用于优化生产流程和质量控制。一家汽车制造商将模型集成到其生产系统中,能够实时分析生产数据,识别潜在的质量问题,并提出工艺调整建议。实施后,生产效率提高了15%,缺陷率降低了22%。模型的思考模式使其能够解释决策依据,帮助工程师理解问题根源,而不仅仅是识别问题。

部署建议与成本效益

对于考虑部署Qwen3-235B-A22B-Thinking-2507的企业,建议采取分阶段实施策略:

-

试点阶段:选择1-2个关键业务场景进行小规模部署,评估实际效果和资源需求。此阶段可使用云服务或小规模本地部署,投资相对有限。

-

优化阶段:根据试点结果调整部署架构,优化性能和成本。此阶段可考虑混合云架构,将敏感数据处理留在本地,同时利用云资源应对峰值需求。

-

规模化阶段:在验证价值后,将解决方案扩展到更多业务场景。此时可考虑更优化的硬件配置,如专用AI加速芯片,以进一步降低长期运营成本。

成本方面,尽管初始投资可能较高,但考虑到模型的高效推理能力和资源利用率,大多数企业在6-12个月内即可收回投资。特别是对于已经拥有一定GPU资源的企业,通过模型优化可以充分利用现有硬件,无需大规模升级基础设施。

未来展望:大模型推理的演进方向

Qwen3-235B-A22B-Thinking-2507的推出,代表了大语言模型发展的一个重要方向:专用化与高效化的结合。未来,我们可以期待看到更多针对特定任务优化的模型架构,以及更高效的推理技术。

一个明显的趋势是"思考效率"的进一步提升。当前模型虽然已经能够进行深度推理,但推理过程中仍存在一定的"冗余思考"。未来的模型可能会发展出更高效的思考路径规划能力,减少不必要的计算步骤,进一步提高推理效率。

另一个重要方向是多模态推理能力的增强。Qwen3系列已经展现出在文本、图像等模态上的理解能力,未来将进一步整合语音、视频等更多模态信息,实现更全面的感知和推理。这将为自动驾驶、智能监控等领域带来革命性变化。

最后,随着模型能力的增强,AI安全和可解释性将变得越来越重要。未来的模型不仅需要能够做出准确决策,还需要能够清晰解释决策过程,确保AI系统的行为可预测、可控制。Qwen3-235B-A22B-Thinking-2507的思考模式设计,已经为这一方向奠定了基础,未来将进一步完善。

对于企业而言,现在正是评估和布局下一代AI基础设施的关键时刻。Qwen3-235B-A22B-Thinking-2507所代表的技术方向,很可能成为未来3-5年内企业AI应用的主流架构。提前布局和实践,将为企业在智能化转型中赢得先机。

无论是金融分析、药物研发还是智能制造,Qwen3-235B-A22B-Thinking-2507都在证明:当AI能够真正深入思考并高效利用计算资源时,其为企业创造的价值将是革命性的。这不仅是一次技术升级,更是企业决策模式和创新方式的根本性转变。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-235B-A22B-Thinking-2507-GGUF

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-235B-A22B-Thinking-2507-GGUF