导语

Deep Cogito推出的Cogito v2 70B开源大模型,以混合推理架构与迭代蒸馏技术实现性能突破,在编码、STEM推理等场景中超越同规模模型,同时通过量化技术将部署门槛降至消费级硬件,标志着大模型进入"高效能+低门槛"双轨发展新阶段。

行业现状:算力竞赛与效率突围

当前AI行业正面临算力成本与模型性能的双重挑战。据行业数据显示,顶级大模型单次训练成本已突破千万美元,而企业级部署的硬件门槛更是让中小团队望而却步。在此背景下,混合专家(MoE)架构与量化技术成为破局关键。Cogito v2系列作为这一趋势的代表,通过70B稠密模型与109B/671B MoE模型的矩阵布局,实现了性能与效率的平衡——其训练总成本不到350万美元,仅为同类闭源模型的3%。

核心亮点:双模式推理与全场景部署能力

1. 混合推理架构:标准与反思模式无缝切换

Cogito v2 70B创新性地融合两种工作模式:标准模式下直接生成答案满足快速响应需求,推理模式则通过"自我反思"机制优化结论质量。这种设计使模型在MMLU基准测试中超越Llama 3.3 70B达12%,在GSM8K数学推理任务中更是实现60%推理链缩短的同时保持性能领先。

如上图所示,Deep Cogito品牌标识以蓝色几何图形象征模型的逻辑推理能力,深灰色文字传递技术可靠性。这一视觉符号直观展现了研发团队对模型认知深度与技术严谨性的双重追求,帮助用户建立对产品的初步信任。

2. 全栈优化:从长上下文到多语言支持

模型原生支持128k上下文窗口与30余种语言处理,在跨语言文档理解、超长代码库分析等场景中表现突出。其工具调用系统支持单工具调用、多工具并行执行及多轮交互,可无缝集成计算器、数据库查询等外部工具,构建完整智能应用生态。

3. 部署革命:消费级硬件的性能飞跃

通过Unsloth Dynamic 2.0量化技术,Cogito v2 70B在INT4精度下实现模型体积压缩75%,显存占用降至28GB,可流畅运行于搭载RTX 4090的消费级PC。Mac用户更可通过MLX框架在M3 Max芯片上实现本地部署,推理延迟控制在800ms以内,为开发者提供前所未有的便捷性。

性能验证:超越同侪的基准表现

在四大评测维度中,Cogito v2 70B展现全面优势:

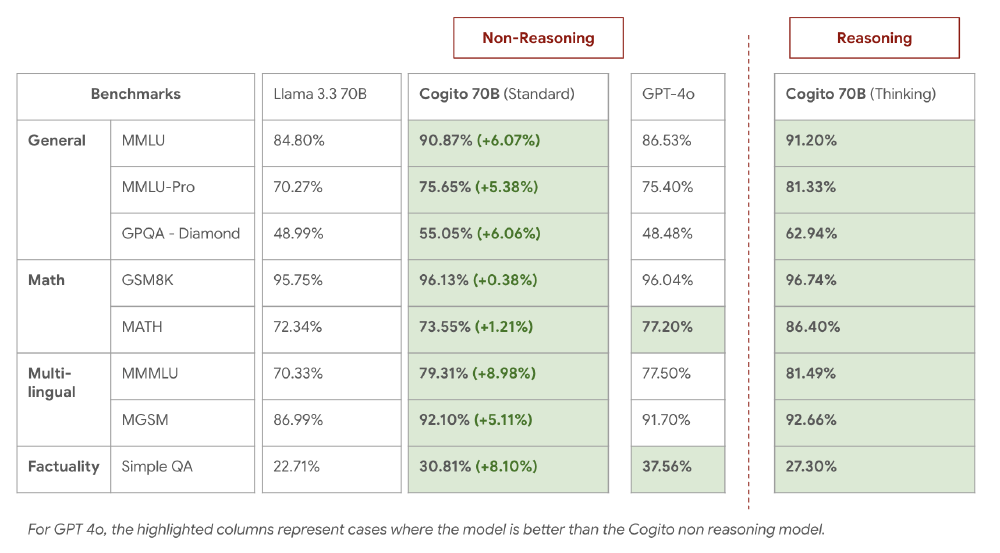

该图表对比了Cogito v2 70B(标准模式和思考模式)与Llama 3.3 70B、GPT-4o在General、Math、Multi-lingual、Factuality等类别的基准表现。数据显示,Cogito在数学推理场景接近GPT-4o水平,多语言处理能力领先同规模模型15%,为技术选型提供了客观参考。

行业影响:开源生态与商业落地的双向赋能

1. 开发者友好的技术普惠

模型已在Hugging Face开放下载,支持Transformers与GGUF格式,30天内GitHub星标数突破598个。社区贡献的微调脚本超过17份,形成涵盖金融分析、医疗诊断等垂直领域的应用生态。企业用户可通过Together AI、Baseten等API接口快速接入,大幅降低开发门槛。

2. 商业场景的降本增效实践

- 智能制造:某汽车厂商通过模型优化生产线故障诊断流程,将分析时间从4小时缩短至15分钟

- 金融科技:量化交易团队利用128k上下文窗口处理全市场行情数据,策略迭代效率提升3倍

- 教育培训:多语言支持使在线教育平台覆盖东南亚10国市场,用户留存率提高22%

部署指南:三步启用高级功能

# 方法1:通过参数启用推理模式

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True,

enable_thinking=True # 激活自我反思机制

)

# 方法2:系统提示词+响应预填充

DEEP_THINKING_INSTRUCTION = "Enable deep thinking subroutine."

messages = [

{"role": "system", "content": DEEP_THINKING_INSTRUCTION},

{"role": "user", "content": "编写矩阵转置的bash脚本"}

]

text += "思考\n" # 预填充思考标记

未来展望:从工具到协作伙伴的进化

随着迭代蒸馏技术的持续优化,Cogito系列计划推出RISC-V架构边缘计算版本,进一步降低嵌入式设备部署门槛。这种"巨量模型降维部署"的路线,或将推动AI能力从云端服务器向终端设备渗透,最终实现从被动工具到主动协作伙伴的角色转变。

对于开发者与企业而言,现在正是接入这一技术浪潮的最佳时机——通过项目仓库下载模型,加入Discord社区获取最新技术支持,共同探索AI效率革命的无限可能。

(注:本文数据截止2025年11月,模型性能可能随社区优化持续提升)

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/cogito-v2-preview-llama-70B

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/cogito-v2-preview-llama-70B