Qwen3-VL-4B-Instruct-FP8:开启多模态AI新纪元,视觉语言模型性能与效率的完美融合

在人工智能迅猛发展的今天,多模态模型正成为推动行业变革的核心力量。Qwen3-VL-4B-Instruct-FP8作为Qwen系列中一款极具突破性的视觉语言模型,凭借其先进的FP8量化技术,在保持模型体积小巧的同时,实现了与原始BF16模型近乎一致的卓越性能。这一突破性进展不仅降低了模型部署的硬件门槛,更为各行各业带来了前所未有的智能化应用可能。该模型在视觉代理、视觉编码增强、空间感知、长上下文与视频理解、多模态推理、视觉识别、OCR以及文本理解等多个关键领域进行了全面且深入的升级,构建起一个功能强大、应用广泛的多模态AI平台。

视觉代理:重塑人机交互,赋能智能任务自动化

Qwen3-VL-4B-Instruct-FP8的视觉代理功能堪称人机交互领域的一次革命性突破。它具备了直接操作PC与移动设备图形用户界面(GUI)的能力,能够精准识别界面上的各种元素,深刻理解其背后的功能逻辑,并根据用户需求自主调用相应工具,从而独立完成复杂的任务流程。想象一下,无论是自动填写表单、批量处理文件,还是智能导航应用操作,该模型都能像一位经验丰富的助手一样,高效、准确地执行,极大地解放了人力,提升了工作效率,为自动化办公和智能家居等领域注入了新的活力。

视觉编码增强:架起视觉与代码的桥梁,激发创意编程

在视觉编码方面,Qwen3-VL-4B-Instruct-FP8展现出了惊人的创造力和技术实力。它能够从给定的图像或视频内容中汲取灵感,并自动生成对应的Draw.io流程图、HTML网页结构以及CSS/JS代码。这一功能为设计师、开发者以及创意工作者提供了强大的辅助工具,使得将视觉创意快速转化为数字产品成为可能。设计师只需勾勒出草图,开发者便能借助模型生成的初步代码进行二次开发,极大地缩短了产品从概念到原型的迭代周期,激发了无限的创意潜能。

空间感知:洞察三维世界,精确判断位置与关系

Qwen3-VL-4B-Instruct-FP8在空间感知能力上实现了质的飞跃,达到了高级水平。它不仅能够精准判断图像中物体的相对位置、不同的观察视角(viewpoints),还能清晰识别物体之间的遮挡关系,全面支持二维平面与三维空间的精确定位。这一能力在自动驾驶领域,可辅助车辆精准识别路况和障碍物;在机器人导航中,能帮助机器人更好地理解周围环境;在虚拟现实(VR)和增强现实(AR)应用里,则能创造出更具沉浸感的用户体验,让虚拟世界与现实世界的融合更加自然、真实。

长上下文与视频理解:突破信息处理边界,驾驭海量内容

面对信息爆炸的时代,Qwen3-VL-4B-Instruct-FP8在长上下文与视频理解方面的表现同样出色。该模型原生支持高达256K的上下文窗口,并且通过技术扩展,能够进一步延伸至1M的超长文本处理能力。这意味着它可以轻松处理整本书籍的内容,或是对长达数小时的长时间视频进行深度理解和分析。更为重要的是,它实现了对这些海量信息的全量召回和秒级索引,用户能够快速定位到所需的关键信息,为学术研究、视频内容分析、智能教育等领域提供了强大的知识获取和处理工具。

多模态推理与视觉识别:融合智慧,拓展认知边界

Qwen3-VL-4B-Instruct-FP8在多模态推理方面展现出了卓越的能力,尤其在STEM(科学、技术、工程、数学)领域以及数学问题求解上表现突出。它擅长进行复杂的因果分析,并能基于确凿的证据给出富有逻辑性的回答,成为科研人员和学生的得力助手。在视觉识别范围上,该模型也进行了极大的扩展,不仅能够识别常见物体,还能精准辨认名人、动漫角色、各类产品、著名地标以及丰富的动植物物种等,几乎涵盖了日常生活和专业领域的众多视觉对象,极大地拓展了AI的认知边界。

OCR与文本理解:打破语言壁垒,实现文本视觉无缝融合

Qwen3-VL-4B-Instruct-FP8的OCR(光学字符识别)功能支持多达32种语言,其性能在各种复杂场景下均表现稳健,即使是在低光照、图像模糊或文字倾斜的情况下,依然能够保持较高的识别准确率。更值得一提的是,它对稀有文字、古代字符以及专业术语的识别能力也得到了显著增强,同时提升了对长文档结构的解析精度,为古籍数字化、多语言文献处理等领域提供了强有力的技术支持。此外,该模型的文本理解能力已达到与纯语言模型相当的水平,真正实现了文本与视觉信息的无缝融合与深度交互,使得多模态信息的理解和处理更加流畅自然。

创新架构:三大核心技术驱动模型性能飞跃

Qwen3-VL-4B-Instruct-FP8之所以能够在众多方面取得卓越成就,其创新的模型架构功不可没。

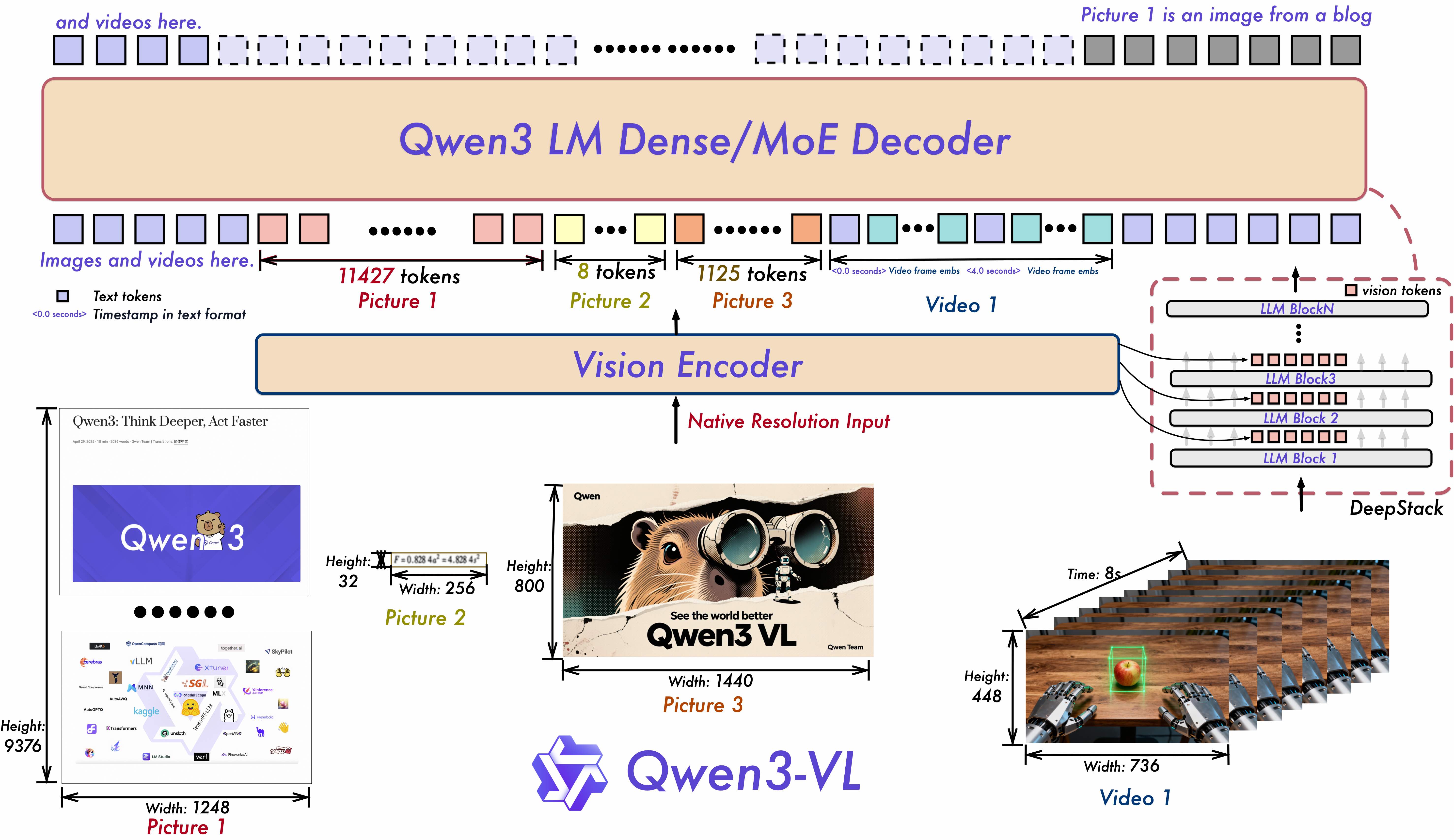

如上图所示,图片清晰展示了Qwen3-VL模型的内部架构设计。这一架构充分体现了模型在处理多模态信息时的核心思路与技术创新,为读者理解模型如何实现各项强大功能提供了直观的参考。

如上图所示,图片清晰展示了Qwen3-VL模型的内部架构设计。这一架构充分体现了模型在处理多模态信息时的核心思路与技术创新,为读者理解模型如何实现各项强大功能提供了直观的参考。

首先,采用了Interleaved-MRoPE位置嵌入技术,这一技术有效增强了模型对长视频序列的推理能力,使得模型在处理时间维度上跨度较大的视频信息时,能够更好地捕捉时序关系和动态变化。其次,DeepStack技术的应用,成功融合了多级别视觉Transformer(ViT)特征,使得模型能够同时捕捉图像或视频中的细微细节与整体场景信息,显著提升了图文对齐的精度和多模态理解的深度。最后,Text-Timestamp Alignment技术的引入,实现了文本描述与视频时间戳的精确对应,能够准确定位视频中发生特定事件的时间点,为视频内容分析、智能剪辑等应用奠定了坚实基础。

性能验证:多模态与纯文本能力双优

为了全面验证Qwen3-VL-4B-Instruct-FP8的综合性能,我们进行了多维度的测试与评估。

如上图所示,该多模态性能表详细罗列了Qwen3-VL-4B-Instruct-FP8在各类主流多模态任务上的表现数据。这些数据直观地证明了该模型在图像理解、视觉问答、跨模态检索等多模态能力上的领先地位,为开发者和用户选择合适的AI模型提供了有力依据。

如上图所示,该多模态性能表详细罗列了Qwen3-VL-4B-Instruct-FP8在各类主流多模态任务上的表现数据。这些数据直观地证明了该模型在图像理解、视觉问答、跨模态检索等多模态能力上的领先地位,为开发者和用户选择合适的AI模型提供了有力依据。

不仅如此,Qwen3-VL-4B-Instruct-FP8在纯文本处理能力上也毫不逊色。

如上图所示,纯文本性能表则清晰展示了该模型在语言理解、文本生成、知识问答等纯文本任务上的卓越性能指标。这表明Qwen3-VL-4B-Instruct-FP8实现了文本与视觉能力的均衡发展,真正做到了文本-视觉的无缝融合与高效协同。

如上图所示,纯文本性能表则清晰展示了该模型在语言理解、文本生成、知识问答等纯文本任务上的卓越性能指标。这表明Qwen3-VL-4B-Instruct-FP8实现了文本与视觉能力的均衡发展,真正做到了文本-视觉的无缝融合与高效协同。

便捷部署:优化工具链支持,加速模型落地应用

为了让广大开发者能够便捷地部署和使用Qwen3-VL-4B-Instruct-FP8模型,官方推荐使用目前业界领先的vLLM或SGLang部署框架。这些框架凭借其高效的推理引擎和优化的内存管理机制,能够充分发挥模型的性能潜力,实现低延迟、高吞吐量的服务响应。同时,官方还提供了详尽的代码示例,涵盖了模型加载、推理调用、参数配置等关键环节,大大降低了开发者的上手难度,助力模型快速在实际应用场景中落地,加速智能化解决方案的构建与实施。开发者可以通过克隆仓库 https://gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Instruct-FP8 获取相关资源和示例代码。

结语与展望:多模态AI的未来已来

Qwen3-VL-4B-Instruct-FP8模型的横空出世,无疑为多模态人工智能领域树立了新的标杆。其全面升级的功能特性、卓越的性能表现以及便捷的部署方式,共同构成了其核心价值。它不仅是科研探索的有力工具,更是推动产业升级、提升生活品质的强大引擎。展望未来,随着技术的不断迭代与优化,我们有理由相信,Qwen3-VL系列模型将在更多领域展现出巨大的应用潜力,例如更智能的城市管理、更精准的医疗诊断、更沉浸式的娱乐体验等。它将持续推动人机交互方式的革新,深刻改变我们认知世界、处理信息以及创造价值的方式,引领我们迈向一个更加智能、高效、便捷的多模态AI新时代。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Instruct-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Instruct-FP8