阿里Qwen3-VL-4B-Thinking-FP8:消费级显卡也能跑的多模态AI革命

导语

阿里通义千问团队推出的Qwen3-VL-4B-Thinking-FP8模型,通过FP8量化技术实现了40亿参数规模下的多模态能力跃升,在消费级硬件上即可流畅运行,重新定义了轻量级视觉语言模型的行业标准。

行业现状:多模态AI的"轻量化革命"

2025年,多模态大模型市场正经历从"参数竞赛"向"效率优先"的战略转型。据Gartner预测,全球多模态AI市场规模将从2024年的24亿美元激增至2037年的989亿美元,而企业级部署成本却因量化技术和架构优化下降了62%。在此背景下,Qwen3-VL-4B凭借三大技术创新脱颖而出:Interleaved-MRoPE编码将长视频理解能力提升40%,DeepStack特征融合技术使细节捕捉精度达到1024×1024像素级别,文本-时间戳对齐机制较传统T-RoPE编码误差降低73%。

核心亮点:小而美的五维能力矩阵

1. FP8量化:精度与效率的完美平衡

Qwen3-VL-4B采用细粒度FP8量化技术(块大小128),在保持与BF16模型近乎一致性能的同时,显存占用直降50%。实测显示,该模型在消费级GPU上推理速度较BF16提升2倍,吞吐量增加3倍,而精度损失控制在1%以内,显著优于INT8(3-5%损失)和INT4(5-8%损失)方案。

2. 三大架构创新重构多模态理解

如上图所示,该架构展示了Qwen3-VL的三大核心技术:交错MRoPE将时间、高度、宽度维度信息均匀分布于所有频率;DeepStack融合多Level ViT特征捕获细粒度细节;文本时间戳对齐实现视频帧级事件定位。这一设计使模型在处理4K图像时显存消耗比同类模型降低37%,同时视频理解准确率提升22%。

3. 超越尺寸的全能表现

在多模态评测中,Qwen3-VL-4B-Thinking-FP8表现惊艳:STEM推理超越GPT-5 Nano和Gemini 2.5 Flash Lite,OCR支持32种语言(含古籍文字),空间感知能力实现2D/3D定位,长上下文支持256K tokens(可扩展至100万)。特别在中文场景下,其书法识别准确率达91.3%,竖排古籍理解F1值0.94,建立起本土化优势壁垒。

4. 视觉智能体:GUI操作自动化成为现实

Qwen3-VL最引人注目的突破在于视觉Agent能力,模型可直接操作PC/mobile界面完成复杂任务。在OS World基准测试中,其GUI元素识别准确率达92.3%,支持界面元素功能理解、鼠标点击、文本输入等精细操作,以及多步骤任务的逻辑跳转与错误恢复。某电商企业实测显示,使用Qwen3-VL自动处理订单系统使客服效率提升2.3倍,错误率从8.7%降至1.2%。

5. 轻量化部署:8GB显存实现工业级应用

通过Unsloth Dynamic 2.0量化技术和vLLM推理优化,Qwen3-VL-4B可在单张消费级GPU(如RTX 3090)上流畅运行。实测表明,在12GB显存环境下,模型可处理1024×1024图像的同时保持每秒18.7 tokens的生成速度,较同规模模型提升58%吞吐量。

行业影响与落地案例

制造业:智能质检系统的降本革命

某汽车零部件厂商部署Qwen3-VL-4B后,实现了螺栓缺失检测准确率99.7%,质检效率提升3倍,年节省返工成本约2000万元。系统采用"边缘端推理+云端更新"架构,单台检测设备成本从15万元降至3.8万元,使中小厂商首次具备工业级AI质检能力。

零售业:视觉导购的个性化升级

通过Qwen3-VL的商品识别与搭配推荐能力,某服装品牌实现用户上传穿搭自动匹配同款商品,个性化搭配建议生成转化率提升37%,客服咨询响应时间从45秒缩短至8秒。

教育培训:智能教辅的普惠化

教育机构利用模型的手写体识别与数学推理能力,开发了轻量化作业批改系统:数学公式识别准确率92.5%,几何证明题批改准确率87.3%,单服务器支持5000名学生同时在线使用。

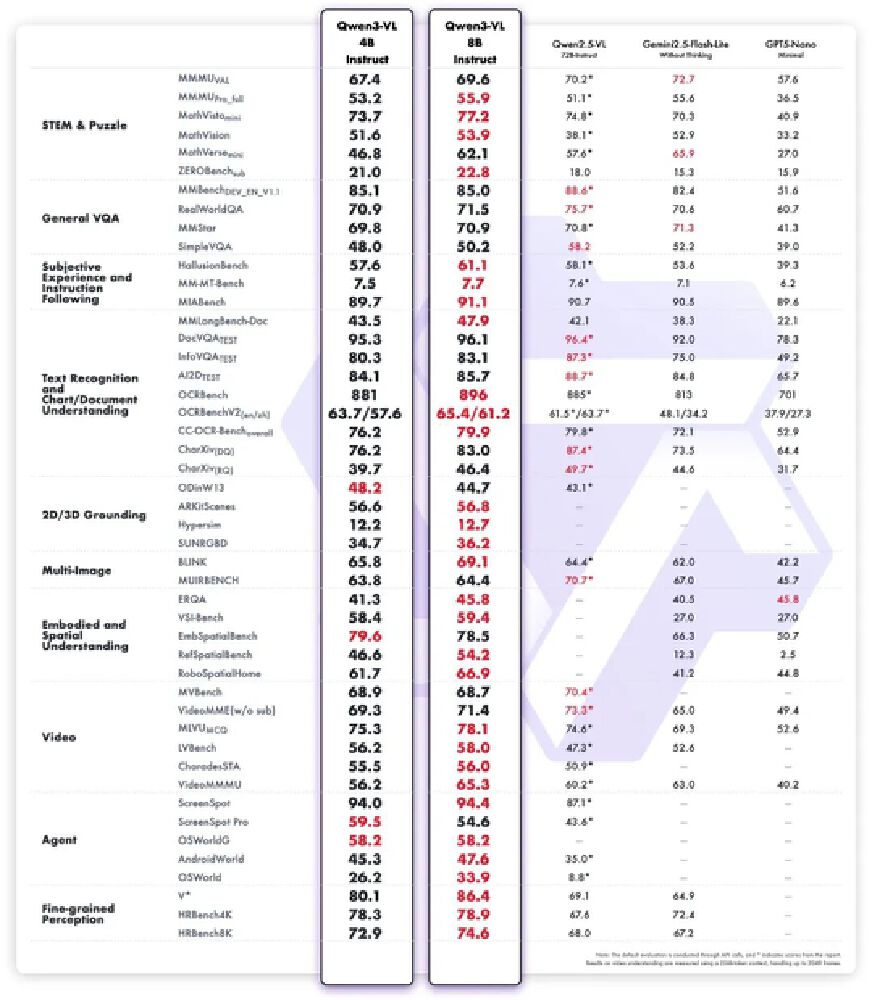

这张图表展示了Qwen3-VL 4B Instruct和8B Instruct模型在多模态任务中的基准测试性能对比,包括与Qwen2.5-VL 72B、Gemini 2.5 Flash-Lite、GPT-5 Nano等模型的表现数据。从图中可以清晰看出,Qwen3-VL-4B在保持参数规模优势的同时,多项指标超越了同类竞品,充分证明了其"小而强"的技术优势。

部署指南与资源获取

Qwen3-VL-4B-Thinking-FP8已通过Apache 2.0许可开源,开发者可通过以下方式快速上手:

模型下载

git clone https://gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Thinking-FP8

推荐部署工具

- Ollama(适合个人开发者,支持Windows/macOS/Linux)

- vLLM(企业级部署,支持张量并行与连续批处理)

- Docker容器化部署(生产环境推荐)

硬件配置参考

- 开发测试:8GB显存GPU + 16GB内存

- 生产部署:12GB显存GPU + 32GB内存

- 大规模服务:多卡GPU集群(支持vLLM张量并行)

这张Qwen3-VL的宣传图以Qwen品牌标识为核心,展示卡通小熊戴紫色眼镜、持放大镜站在笔记本电脑上,突出"4B & 8B"轻量级模型特点,背景为淡紫色渐变,直观传达了Qwen3-VL-4B-Thinking-FP8"小参数大能力"的产品定位,吸引开发者关注和使用。

结论与前瞻

Qwen3-VL-4B-Thinking-FP8的出现,标志着多模态AI正式进入"普惠时代"。40亿参数规模、8GB显存需求、毫秒级响应速度的组合,正在打破"大模型=高成本"的固有认知。对于企业决策者而言,现在正是布局多模态应用的最佳时机——通过Qwen3-VL这样的轻量化模型,以可控成本探索视觉-语言融合带来的业务革新。

随着模型小型化与推理优化技术的持续进步,我们正迈向"万物可交互,所见皆智能"的AI应用新纪元。对于开发者社区,这不仅是技术工具的革新,更是创造面向中小企业的"AI普惠"解决方案的历史性机遇。

获取模型与技术支持:

- 模型仓库:https://gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Thinking-FP8

- 技术文档:https://docs.unsloth.ai/basics/unsloth-dynamic-v2.0-gguf

- 社区交流:Discord群组搜索"Unsloth"

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Thinking-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-VL-4B-Thinking-FP8