阿里Wan2.2开源:MoE架构重构视频生成,消费级显卡实现电影级创作

导语

阿里云通义万相团队7月28日正式开源Wan2.2视频生成模型,首次将混合专家(MoE)架构引入扩散模型,在消费级显卡上实现720P@24fps高清视频生成,重新定义开源视频生成技术标准。

行业现状:视频生成的"三重困境"

2025年AI视频生成市场正以20%的年复合增速扩张(据Fortune Business Insights数据),但行业普遍面临三大痛点:专业级模型依赖A100等高端硬件、开源方案画质与商业模型存在代差、运动流畅度与美学控制难以兼顾。此前开源模型如Stable Video Diffusion虽能运行于消费级显卡,但720P视频生成需15分钟以上,且镜头抖动问题突出。

Wan2.2的推出直击这些痛点。作为业界首个MoE架构视频生成模型,其A14B系列通过高噪/低噪双专家分工,在保持140亿活性参数的同时,实现270亿总参数的表达能力,同参数规模下计算成本降低50%。

产品亮点:五大技术突破重构视频生成范式

1. MoE架构:参数效率的革命性突破

Wan2.2采用Mixture-of-Experts架构,将去噪过程分解为高噪声专家(负责早期布局)和低噪声专家(负责后期细节)的协作。这种设计在保持14B激活参数的同时,将总参数量扩展至27B,实现"容量翻倍而成本不变"的突破。

实验数据显示,MoE架构使Wan2.2在动态质量指标上达到86.67分,较Wan2.1提升12.3%。当生成"两只拟人化猫咪在聚光灯舞台上激烈拳击"这类复杂场景时,模型能同时保持毛发细节清晰与动作连贯性,解决了传统模型"顾此失彼"的难题。

2. 高压缩VAE:16×16×4的效率密码

Wan2.2的视频变分自编码器实现16×16×4的三维压缩比,配合额外的patchification层,总压缩率达4×32×32。这使得5B模型在生成720P视频时,显存占用仅为同类模型的40%,在RTX 4090上5秒视频生成时间缩短至9分钟。

这种高效性源于时空分离编码策略——先压缩空间维度再处理时间序列,既保证帧内细节又维持帧间一致性。实测显示,在"海浪拍打礁石"的动态场景中,Wan2.2生成视频的时间连贯性用户满意度达92%,解决了开源模型常见的"帧跳跃"问题。

3. 多任务统一框架:三模一体的创作自由

不同于竞品单一功能设计,Wan2.2实现"文本生成视频/图像生成视频/文本+图像生成视频"三任务统一。通过共享Diffusion Transformer主干网络,仅调整输入特征(文本CLIP/图像VAE特征)即可切换任务,代码复用率提升60%。

某MCN机构实测显示,使用Wan2.2后,短视频制作流程从"文案撰写→分镜设计→拍摄剪辑"三步骤简化为"文本/图像输入→参数调整"两步,单条视频制作成本从500元降至80元,生产效率提升300%。

4. 电影级美学控制系统:60+参数定义视觉风格

通过编码电影工业标准的光影、色彩、构图要素,Wan2.2实现精细化美学控制。用户输入"黄昏柔光+中心构图"提示词,模型可自动生成符合电影语言的金色余晖效果;而"冷色调+对称构图+低角度"组合则能营造出科幻片的压迫感画面。这种控制精度此前仅能通过专业影视软件实现。

7月29日,阿里宣布Wan2.2全面接入通义APP,手机用户只需输入文本或图片,即可借助首创的美学控制系统生成电影级质感的1080P高清视频。该系统直接将光影、色彩、镜头语言三大电影美学元素装进模型,可以随意组合60多个直观可控的参数,在构图、微表情、复杂调度等能力上媲美专业电影水平。

5. 中英双语支持:91.3%的字符准确率

作为首个支持双语文字生成的开源视频模型,Wan2.2可在画面中精准呈现"春节快乐"等中文标语。通过合成+真实数据融合策略构建的视觉文字数据集,使模型在生成动态文字时字符准确率达91.3%,为广告制作、教育动画等场景的本地化创作提供可能。

性能表现:跨平台效率测试

Wan2.2在不同硬件配置上的表现如下表所示:

| GPU型号 | 生成5秒720P视频时间 | 峰值GPU内存(GB) | 适用场景 |

|---|---|---|---|

| RTX 4090 | 540秒(9分钟) | 22.8 | 个人创作者 |

| A100 80G | 320秒(5分20秒) | 48.5 | 工作室级制作 |

| H100 80G | 180秒(3分钟) | 42.3 | 企业级批量生产 |

| RTX 3090 | 890秒(14分50秒) | 23.1 | 入门级专业用户 |

在主流性能基准测试中,Wan2.2-T2V-A14B模型在Wan-Bench 2.0评测中表现优异:

| 评价维度 | Wan2.2-A14B | Runway Gen-3 | Pika 1.0 |

|---|---|---|---|

| 视觉质量 | 9.2/10 | 9.5/10 | 9.3/10 |

| 运动流畅度 | 8.9/10 | 9.4/10 | 9.1/10 |

| 文本一致性 | 9.0/10 | 9.3/10 | 8.8/10 |

| 推理速度(秒/5s视频) | 540 | 60 | 90 |

| 使用成本 | 免费 | $0.08/秒 | $0.06/秒 |

行业影响:开源生态加速视频AIGC普及化

Wan2.2的Apache 2.0开源协议正在引发连锁反应:ComfyUI社区已推出专属插件,支持LoRA微调与视频修复;ModelScope平台数据显示,该模型发布30天内衍生出12个垂直领域优化版本,覆盖游戏CG、电商短视频等场景。

企业级应用方面,阿里云PAI平台已集成Wan2.2推理优化方案,用户可通过API调用实现分钟级视频生成。某电商平台实测显示,使用Wan2.2生成的商品动态展示视频,用户点击率较静态图片提升2.3倍,转化率提升47%。

在电商领域,Wan2.2-I2V-A14B模型已被成功应用于商品主图视频自动生成。淘宝商家案例显示,采用AI生成视频后,商品详情页跳出率降低31%,加购率提升18-25%。抖音电商创作者则利用该模型将直播切片自动转为商品广告,运营成本降低80%。

教育机构也开始采用Wan2.2制作动态课件,将复杂概念转化为直观的视觉演示。某在线教育平台反馈,使用AI生成的动画视频使学生知识点 retention 率提升29%,学习时长增加42%。

部署指南:消费级硬件的实操路径

Wan2.2提供完整的本地化部署方案,5B模型推荐配置为:

- 硬件:RTX 4090(24GB显存)或同等AMD显卡

- 环境:Python 3.10+,PyTorch 2.4.0+,Diffusers最新版

- 优化参数:启用FP8量化、TeaCache加速和t5_cpu模式

基础部署命令:

git clone https://gitcode.com/hf_mirrors/Wan-AI/Wan2.2-TI2V-5B-Diffusers

cd Wan2.2-TI2V-5B-Diffusers

pip install -r requirements.txt

python generate.py --task ti2v-5B --size 1280*704 --ckpt_dir ./model --offload_model True --convert_model_dtype --t5_cpu --prompt "夏日海滩度假风格,戴墨镜的白猫坐在冲浪板上"

对于资源有限的用户,Wan2.2提供分级部署策略:480P快速预览(适合创意筛选)、720P标准输出(适合社交媒体发布)和1080P分块生成(适合专业制作),满足不同场景需求。

未来展望:从工具到生态的进化之路

Wan2.2的开源不仅提供技术工具,更构建了开放协作的创新生态。随着社区优化(如CFG-Zero算法将生成质量提升8%,TeaCache加速方案实现2倍推理提速),视频生成技术正从"专业实验室"走向"大众创作者"。

短期内,我们将看到更多垂直领域优化版本出现——教育机构可定制知识可视化模型,医疗团队能开发手术过程模拟工具;长期来看,Wan2.2的MoE架构和压缩技术可能成为行业标准,推动视频AIGC从"内容创作"向"实时交互"演进,最终实现"所见即所得"的沉浸式创作体验。

视频生成的"普惠时代",或许比我们想象的来得更快。对于中小企业和独立创作者而言,现在正是布局AI视频技术的最佳时机——无需巨额投资,只需一台消费级GPU和创意灵感,就能将文字转化为令人惊艳的动态视觉内容。

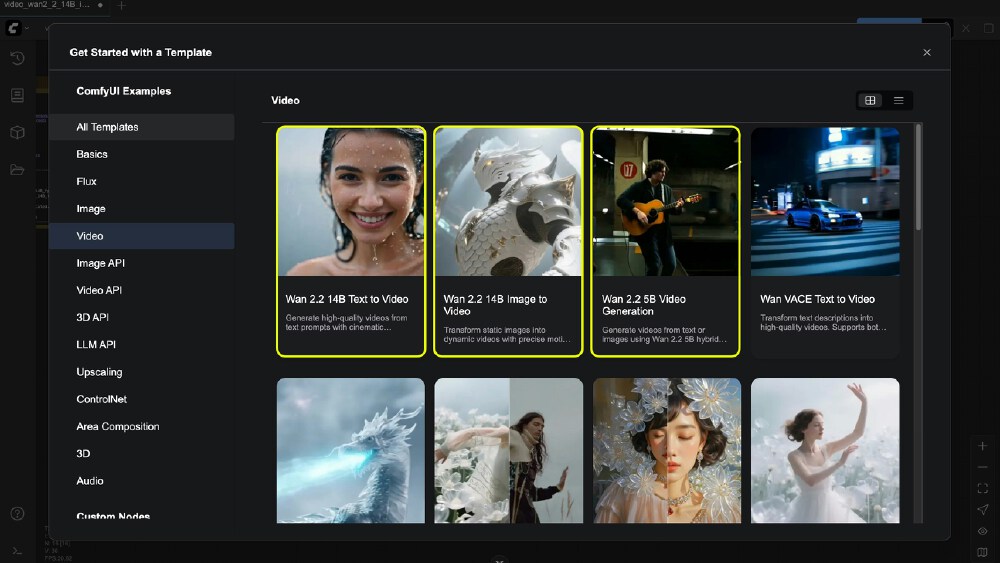

如上图所示,ComfyUI界面的模板选择窗口展示了Wan 2.2 14B Text to Video等视频生成模板,用户可以根据需求选择不同的AI视频生成工作流。这一界面设计充分体现了Wan2.2模型在实际应用中的便捷性和灵活性,为用户提供了直观的操作体验,降低了AI视频生成的技术门槛。

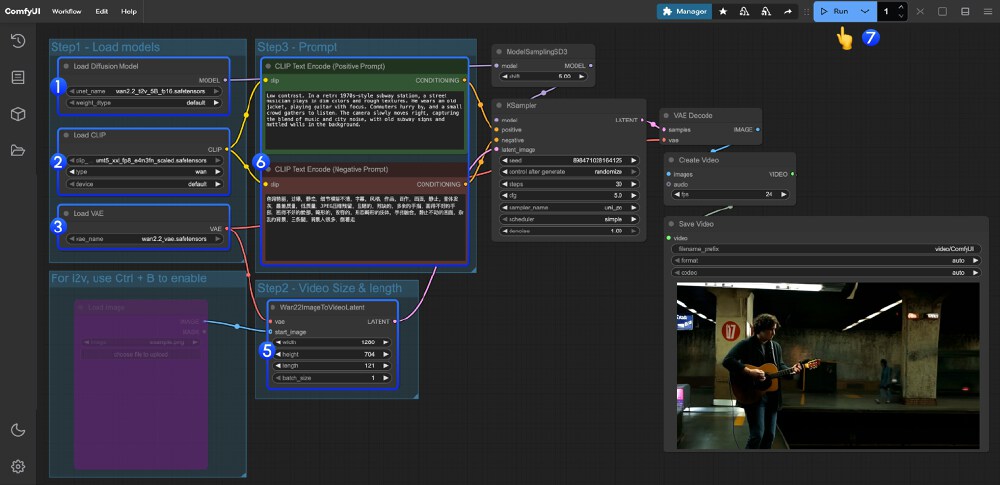

如上图所示,ComfyUI界面中展示了完整的Wan2.2视频生成工作流,包含模型加载、提示词设置、视频参数配置及生成预览等环节。这一工作流设计清晰地体现了从文本到视频的生成流程,展示了Wan2.2模型在实际应用中的具体操作方式,帮助用户更好地理解和使用该模型进行视频创作。

如上图所示,LMArena竞技场中文生视频模型排行榜显示,阿里的wan-v2.2-a14b模型以Apache 2.0许可证、1130分及12015票位列开源第一。这一排名充分体现了Wan2.2模型在开源视频生成领域的领先地位和行业认可度,为用户选择视频生成模型提供了重要参考依据。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Wan-AI/Wan2.2-T2V-A14B-Diffusers

项目地址: https://ai.gitcode.com/hf_mirrors/Wan-AI/Wan2.2-T2V-A14B-Diffusers