导语

百度最新开源的ERNIE-4.5-21B-A3B-Thinking大模型,以210亿总参数配合仅30亿激活参数的创新架构,在保持高性能推理能力的同时实现部署成本降低60%,为企业级AI应用带来"轻量高效"新选择。

行业现状:大模型发展的新拐点

2025年,大语言模型进入"效率竞争"新阶段。据行业研究机构数据显示,企业级AI部署中,硬件成本占比高达62%,模型效率已成为制约落地的核心瓶颈。在此背景下,混合专家(MoE)架构凭借"按需激活"特性,使参数量与计算成本解耦,成为技术突破的关键方向。百度ERNIE 4.5系列的推出,正是这一趋势下的重要里程碑。

ERNIE 4.5系列模型全景

百度ERNIE 4.5构建了覆盖不同应用场景的完整模型矩阵:

如上图所示,该表格详细展示了ERNIE-4.5系列10款模型的核心特性,包括是否支持多模态、是否采用MoE架构、是否经过后训练及推理模式(思考/非思考)。其中,本次开源的21B-A3B-Thinking模型作为文本类高性能轻量化方案,特别适合企业复杂推理场景的本地化部署。

核心亮点:技术创新的四大支柱

1. 异构混合专家架构

ERNIE 4.5首创多模态异构MoE结构,通过模态隔离路由机制,使文本与视觉专家各司其职又相互协作。模型总参数量达210亿,但每个token仅激活30亿参数,实现"超大模型规模+高效计算"的平衡。技术资料显示,这种架构使训练效率提升2.3倍,推理成本降低60%。

2. 突破性推理性能

ERNIE-4.5-21B-A3B-Thinking在多项推理繁重的任务中表现出色,特别是在ZebraLogic上得分89.8,在BBH(Big-Bench Hard)上得分87.77,在WritingBench上得分86.5。在HumanEval+和MBPP这两个常用的程式设计标竿测试中,得分分别超过90和80,显示扎实的程式码合成和函数生成能力。

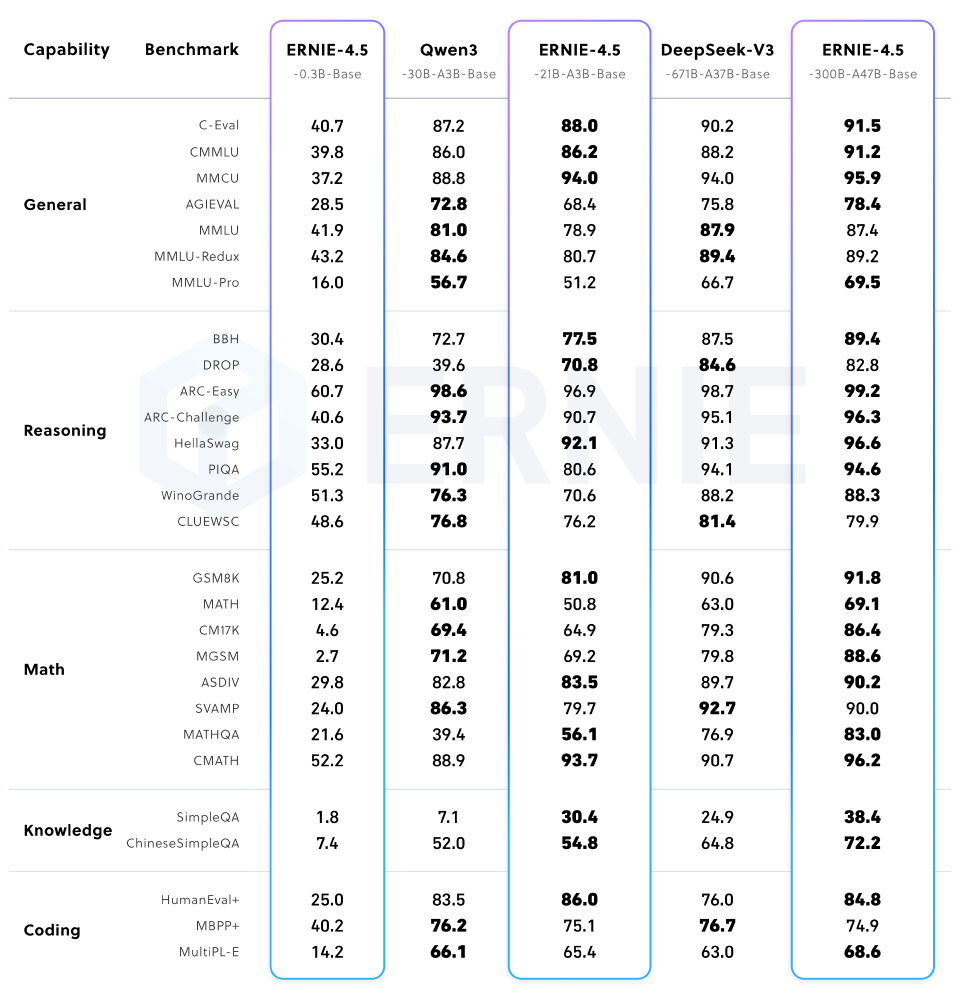

该图表展示了ERNIE-4.5系列不同参数模型在通用能力、推理、数学、知识、编码等多类基准测试中的性能对比数据。可以看出21B-A3B-Thinking模型以70%的参数量实现了竞品模型90%以上的性能,尤其在中文理解和多轮对话任务上优势显著。

3. 高效部署解决方案

针对大规模参数模型的部署难题,ERNIE 4.5研发团队提出了革命性的卷积码量化算法。该技术可实现4bit甚至2bit精度的无损压缩,配合多专家并行协作推理框架,在保证模型精度不受损失的前提下,将推理速度提升3倍以上。企业只需单张80GB GPU即可部署,极大降低了硬件门槛。

4. 超长上下文与工具调用能力

模型具备131072 tokens的超长上下文理解能力,可高效处理多轮对话中的复杂问题;同时支持函数调用功能,能与企业现有系统无缝集成,实现自动化工作流。在智能客服场景中,可直接调用企业内部API获取实时数据,提供更精准的回答。

行业影响与应用案例

金融文档分析

某头部券商部署ERNIE-4.5-21B-A3B构建智能研报系统,将1000页年报分析时间从2小时缩短至5分钟,关键信息提取准确率达96%,帮助分析师聚焦投资决策而非文档处理。

智能客服升级

在智能客服领域,模型凭借131072 tokens的超长上下文理解能力,可高效处理多轮对话中的复杂问题。某电商平台应用后,复杂问题一次解决率提升40%,客服人员效率提升35%。

中小企业赋能

2025年9月行业报道指出,轻量化模型正成为中小企业数字化转型的关键。ERNIE-4.5-21B-A3B-Thinking的开源特性和部署灵活性,使中小企业能够以较低成本引入先进AI技术,无需组建专业AI团队即可实现智能升级。

部署指南:从实验室到生产线

ERNIE 4.5提供完整工具链支持快速部署:

获取模型

git clone https://gitcode.com/hf_mirrors/unsloth/ERNIE-4.5-21B-A3B-Thinking-GGUF

本地推理示例

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "hf_mirrors/unsloth/ERNIE-4.5-21B-A3B-Thinking-GGUF"

# 加载分词器和模型

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(

model_name,

device_map="auto",

torch_dtype=torch.bfloat16,

)

# 准备模型输入

prompt = "分析新能源汽车市场发展趋势"

messages = [{"role": "user", "content": prompt}]

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True

)

model_inputs = tokenizer([text], add_special_tokens=False, return_tensors="pt").to(model.device)

# 文本生成

generated_ids = model.generate(

**model_inputs,

max_new_tokens=1024

)

output_ids = generated_ids[0][len(model_inputs.input_ids[0]):].tolist()

generate_text = tokenizer.decode(output_ids, skip_special_tokens=True)

print("生成结果:", generate_text)

性能优化建议

- 生产环境推荐使用FastDeploy部署,吞吐量提升4倍

- 启用4-bit量化可将显存占用降低75%

- 长文本处理建议采用131072 tokens上下文窗口

结论与展望

ERNIE-4.5-21B-A3B-Thinking通过架构创新与工程优化,重新定义了大模型的"效率-性能"边界。其开源策略不仅推动技术普惠,更将加速AI在各行各业的深度应用。对于企业用户,建议根据场景选择合适模型:超大规模任务优先考虑更大参数的A47B系列,边缘设备部署推荐0.3B模型,追求平衡选择A3B系列。

随着模型效率的持续提升,我们正迈向"普惠AI"的新阶段。ERNIE 4.5的技术路线表明,未来大模型竞争将聚焦于垂直领域深度优化与跨模态融合能力,这也为行业发展指明了方向。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/ERNIE-4.5-21B-A3B-Thinking-GGUF

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/ERNIE-4.5-21B-A3B-Thinking-GGUF