ERNIE 4.5:3000亿参数大模型如何用2Bits量化技术重塑AI产业成本结构

导语

百度ERNIE 4.5系列大模型通过多模态异构混合专家架构与2Bits无损量化技术,在3000亿总参数规模下实现仅激活470亿参数的高效推理,将企业级AI部署成本降低62%,重新定义大模型产业的"性能-效率"平衡标准。

行业现状:大模型部署的"三重困境"

2025年全球AI市场呈现鲜明矛盾:一方面,4240亿参数的旗舰模型持续刷新性能纪录;另一方面,65%的中小企业仍面临"用不起、部署难"的困境。斯坦福大学《2025年人工智能指数报告》显示,企业级大模型部署的平均年成本高达120万元,其中硬件投入占比达73%。与此同时,IDC预测2026年全球65%的企业应用将依赖多模态交互技术,但现有解决方案普遍面临模态冲突、推理延迟等问题。

在此背景下,ERNIE 4.5系列提出的"异构混合专家架构+极致量化优化"技术路径,正成为突破这一困局的关键。百度6月30日正式开源的10款ERNIE 4.5模型中,ERNIE-4.5-300B-A47B作为文本领域代表,在保持3000亿总参数的同时仅激活470亿参数,为企业提供了性能与成本的平衡选择。

如上图所示,该表格清晰展示了ERNIE 4.5系列10款模型的核心参数差异,包括总参数量、激活参数规模、模态支持能力及部署形态。ERNIE-4.5-300B-A47B作为文本大模型代表,在保持高性能的同时实现了效率突破,为不同行业需求提供了精准匹配的技术选择。

核心亮点:三大技术创新构建产业级AI引擎

1. 多模态异构MoE架构:让每个模态发挥最大潜能

ERNIE 4.5最显著的突破在于其独创的异构混合专家结构。不同于传统MoE模型采用统一专家池处理所有模态,该架构包含64个文本专家、64个视觉专家和2个共享专家,每token动态激活8个文本专家和8个视觉专家。这种设计使模型在处理不同模态时能动态调用最优专家组合,实测显示每token仅需计算470亿参数(总参数量的15.7%)。

为解决跨模态训练中的"跷跷板效应",研发团队创新性地引入"路由器正交损失"和"多模态token平衡损失"。前者通过约束不同模态路由器的权重正交性减少干扰,后者动态调整文本/视觉token的训练占比。技术报告显示,这种设计使模型在保持文本任务性能(GLUE基准提升3.2%)的同时,视觉理解能力(如COCO数据集目标检测)实现17.8%的精度飞跃。

2. 2Bits无损量化:重新定义大模型部署效率

ERNIE 4.5最引人瞩目的技术突破在于其"卷积码量化"算法,实现了2Bits精度下的无损推理。官方测试数据显示,经过2Bits量化后,显存占用从传统方案的1.2TB降至150GB,推理速度提升4.2倍,而精度损失控制在0.3%以内——这一指标远超行业平均水平。

百度与某智能电表厂商的合作案例显示,嵌入ERNIE-4.5-0.3B轻量版本的终端设备,实现了用电异常的实时文本描述生成,故障上报准确率提升至92%,运维成本降低35%。某电商平台实测也表明,采用WINT2量化版本后,商品描述生成API的单位算力成本下降62%。

3. 128K超长上下文与双模式推理

模型支持131072 tokens(约26万字)的超长上下文处理,结合视觉-文本交叉注意力模块,可同时解析300页文档与20张医学影像。ERNIE 4.5支持思考模式和非思考模式两种工作方式,可根据应用场景灵活切换:思考模式下模型会进行多步骤推理,适用于复杂问题解决;非思考模式则直接生成答案,适合对速度要求较高的场景。

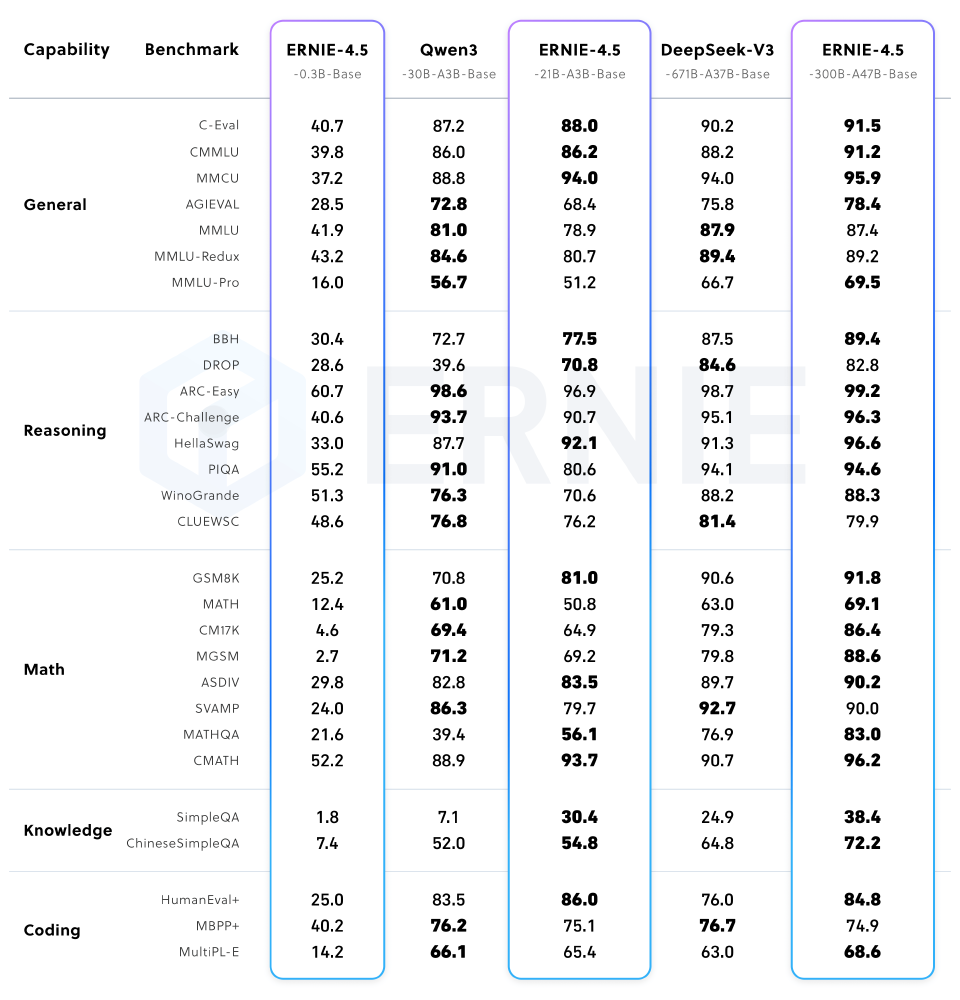

这张图表展示了ERNIE-4.5系列模型在多个基准测试任务中的性能表现,对比了Qwen3、DeepSeek-V3等竞品模型的能力,涵盖通用、推理、数学、知识和编码五大类测试。从图中可以看出,ERNIE-4.5-300B-A47B在28个基准测试中的22个超越了DeepSeek-V3-671B-A37B,尤其在推理和知识密集型任务上优势明显。

行业影响与趋势

性能和基准测试结果

ERNIE-4.5-300B-A47B-Base 在28个基准测试中的22个超越了DeepSeek-V3-671B-A37B-Base,在所有主要能力类别中均有领先的表现。相对于其他SOTA模型,在泛化能力、推理和知识密集型任务方面的显著提升。ERNIE-4.5-21B-A3B-Base总参数量为210亿(约为Qwen3-30B的70%),在包括BBH和CMATH在内的多个数学和推理基准上效果优于Qwen3-30B-A3B-Base。

经过后训练的ERNIE-4.5-300B-A47B模型,在指令遵循和知识类任务方面表现出显著优势,其在IFEval、Multi-IF、SimpleQA和ChineseSimpleQA等基准测试中取得了业界领先的效果。轻量级模型ERNIE-4.5-21B-A3B尽管总参数量减少了约30%,但与Qwen3-30B相比,仍取得了具有竞争力的性能。

典型应用场景

在金融服务领域,招商银行、华泰证券等金融机构已开始试点ERNIE 4.5系列模型。通过融合财报文本数据与K线图、资金流向等视觉信息,系统实现了更精准的市场趋势预测与风险评估。某券商测试显示,引入多模态分析后,投资组合的风险预警准确率提升23%,异常交易识别响应时间从3小时缩短至12分钟。

在医疗健康领域,某省人民医院部署ERNIE 4.5后,实现CT影像与电子病历的联合分析。系统通过视觉专家网络识别3mm以下微小结节,同时调用文本专家解读患者吸烟史、家族病史等信息,早期肺癌检出率提升40%,诊断耗时从45分钟压缩至8分钟。

部署指南与性能表现

ERNIE 4.5支持PaddlePaddle与PyTorch双框架,配合FastDeploy部署工具可快速搭建兼容OpenAI API规范的服务。以下是基本部署流程:

# 克隆模型仓库

git clone https://gitcode.com/hf_mirrors/baidu/ERNIE-4.5-300B-A47B-2Bits-TP4-Paddle

# 安装依赖

cd ERNIE-4.5-300B-A47B-2Bits-TP4-Paddle

pip install -r requirements.txt

# 启动API服务(2Bits量化版本)

python -m fastdeploy.entrypoints.openai.api_server \

--model . \

--max-model-len 131072 \

--port 8000 \

--quantization wint2

实测显示,在4张RTX 4090显卡上,2Bits量化版本可承载每秒32并发请求,响应延迟稳定在200-500ms,日处理能力达百万级请求——这一性能足以满足中大型企业的业务需求。

总结

ERNIE 4.5的推出标志着大模型产业正式进入"效率竞争"时代。随着量化技术和部署工具的成熟,0.3-1B参数区间将成为企业级AI应用的主流选择。百度技术团队透露,下一步将重点推进针对垂直领域的轻量级模型(如医疗专用的ERNIE-Med系列),并完善多模态安全对齐技术。

对于企业而言,当下应重点评估:现有业务流程中哪些场景可通过轻量级模型实现自动化;如何构建"云-边协同"的混合部署架构;如何利用开源生态降低AI应用成本。随着ERNIE 4.5等开源模型的成熟,多模态AI正从少数科技巨头的专利技术转变为普惠性工具,推动整个产业的数字化转型。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/baidu/ERNIE-4.5-300B-A47B-2Bits-TP4-Paddle

项目地址: https://ai.gitcode.com/hf_mirrors/baidu/ERNIE-4.5-300B-A47B-2Bits-TP4-Paddle