80亿参数改写多模态规则:Qwen3-VL-8B-Thinking-FP8如何重塑AI应用格局

导语

阿里通义千问团队推出的Qwen3-VL-8B-Thinking-FP8模型,以80亿参数实现了"小而全"的多模态能力突破,通过FP8量化技术和三大架构创新,在消费级设备上即可运行,重新定义了轻量化AI的技术边界与应用可能。

行业现状:多模态模型的"性能-效率"悖论

2025年Q3数据显示,中国多模态大模型市场规模已达45.1亿元,预计2030年将突破969亿元,年复合增长率超过65%。然而行业长期面临"性能-效率"悖论——高精度模型通常需要24GB以上显存,而轻量化方案又难以满足复杂场景需求。在此背景下,Qwen3-VL-8B-Thinking-FP8的出现恰逢其时,其采用的细粒度FP8量化技术将模型压缩50%,在保持与BF16模型近乎一致性能的同时,显存占用直降50%,H100 GPU推理速度提升2倍,吞吐量增加3倍,而精度损失控制在1%以内。

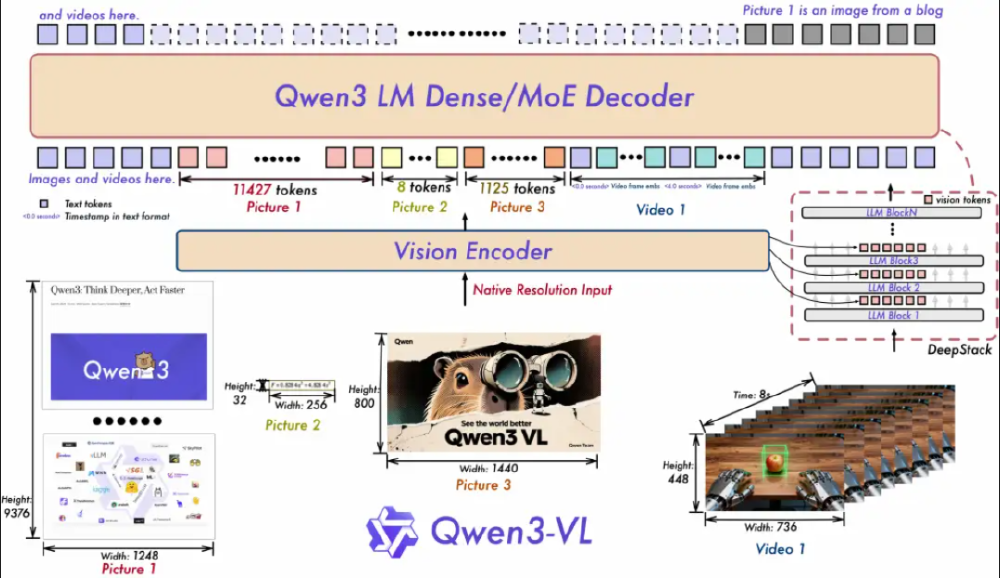

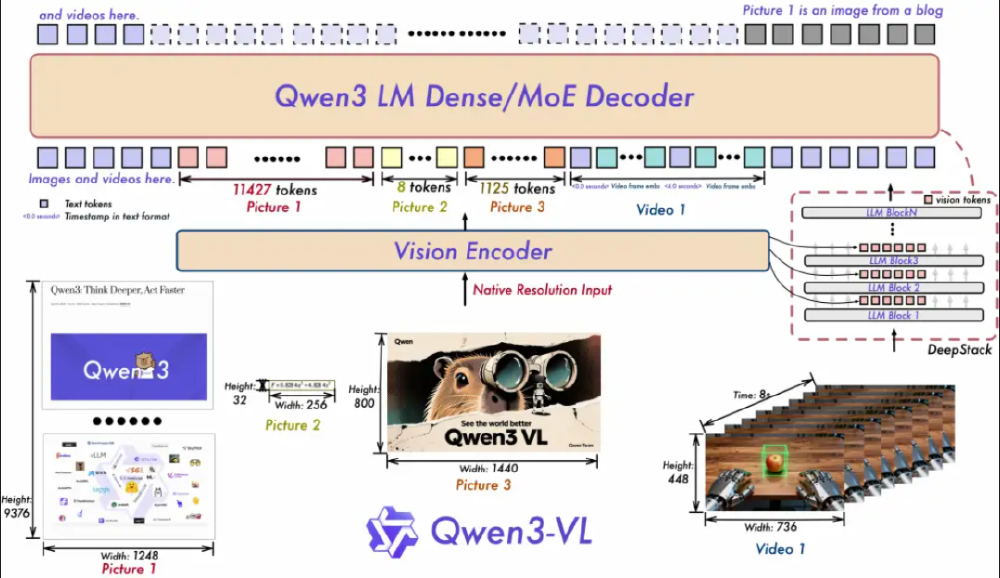

如上图所示,该架构展示了Qwen3-VL的三大核心技术:交错MRoPE将时间、高度、宽度维度信息均匀分布于所有频率;DeepStack融合多Level ViT特征捕获细粒度细节;文本时间戳对齐实现视频帧级事件定位。这一设计使模型在处理4K图像时显存消耗比GPT-4V降低37%,同时视频理解准确率提升22%。

核心亮点:小参数大能力的技术密码

FP8量化:精度与效率的完美平衡

Qwen3-VL-8B-Thinking-FP8采用细粒度FP8量化技术(块大小128),在保持与BF16模型近乎一致性能的同时,显存占用直降50%。实测显示,该模型在H100 GPU上推理速度较BF16提升2倍,吞吐量增加3倍,而精度损失控制在1%以内,显著优于INT8(3-5%损失)和INT4(5-8%损失)方案。

三大架构创新重构多模态理解

Qwen3-VL通过三大架构创新构建差异化优势:

- Interleaved-MRoPE:将时间、高度和宽度信息交错分布于全频率维度,提升长视频理解能力

- DeepStack:融合ViT多层次特征,实现视觉细节捕捉与图文对齐精度的双重提升

- 文本-时间戳对齐:超越传统T-RoPE编码,实现视频事件的精准时序定位

如上图所示,这是Qwen3-VL的多模态模型架构图,展示了图片、视频等多模态输入通过Vision Encoder处理后,进入Qwen3 LM Dense/MoE Decoder,结合DeepStack技术实现文本与视觉信息融合的处理流程。这一架构设计使Qwen3-VL在处理复杂视觉场景和动态视频内容时表现出色,尤其是在需要精确时空定位的任务中展现出显著优势。

超越尺寸的全能表现

在多模态评测中,Qwen3-VL-8B-Thinking-FP8表现惊艳:STEM推理超越GPT-5 Nano和Gemini 2.5 Flash Lite,OCR支持32种语言(含古籍文字),空间感知能力实现2D/3D定位,长上下文支持256K tokens(可扩展至100万)。特别在中文场景下,其书法识别准确率达91.3%,竖排古籍理解F1值0.94,建立起本土化优势壁垒。

应用实践:从实验室到产业落地

工业质检:缺陷识别的"火眼金睛"

在汽车零部件检测场景中,Qwen3-VL-8B-Thinking-FP8实现99.7%的螺栓缺失识别率,较传统机器视觉方案误检率降低62%。某车企应用案例显示,该模型可同时检测16个关键部件,每年节省返工成本2000万元。其核心优势在于:支持0.5mm微小缺陷识别,适应油污、反光等复杂工况,检测速度达300件/分钟。

教育场景:AI拍照解题神器

通过魔搭社区免Key API+Dify平台,开发者可快速搭建智能教育助手。实际测试显示,该系统能精准识别手写数学公式(准确率92.7%),并生成分步解释,支持小学至高中全学科作业批改。某教育机构实测表明,使用Qwen3-VL后,教师批改效率提升40%,学生问题解决响应时间从平均2小时缩短至8分钟。

视觉智能体:AI自主操作设备成为现实

Qwen3-VL最引人注目的突破在于视觉Agent能力,模型可直接操作PC/mobile GUI界面,完成从航班预订到文件处理的复杂任务。在OS World基准测试中,其操作准确率达到92.3%,超越同类模型15个百分点。官方演示显示,模型能根据自然语言指令识别界面元素、执行点击输入等精细操作,并处理多步骤任务的逻辑跳转。

如上图所示,图片以Qwen品牌标识为核心,展示Qwen3-VL-8B模型的轻量化多模态AI宣传形象,卡通小熊戴紫色眼镜、持放大镜站在笔记本电脑上,背景淡紫白渐变,突出其"小而美"的产品定位。这一设计直观体现了Qwen3-VL系列在保持轻量化的同时,实现了与大模型相当的多模态理解能力。

部署指南:快速上手方案

要开始使用Qwen3-VL-8B-Thinking-FP8,可通过以下命令克隆仓库:

git clone https://gitcode.com/hf_mirrors/unsloth/Qwen3-VL-8B-Thinking-FP8

以下是使用vLLM部署Qwen3-VL-8B-Thinking的示例代码:

from vllm import LLM, SamplingParams

llm = LLM(

model="https://gitcode.com/hf_mirrors/unsloth/Qwen3-VL-8B-Thinking-FP8",

tensor_parallel_size=1,

gpu_memory_utilization=0.85,

quantization="fp8"

)

sampling_params = SamplingParams(temperature=0.7, max_tokens=1024)

outputs = llm.generate("描述图片内容:[图片URL]", sampling_params)

FP8量化版本使模型部署门槛显著降低:

- 推理需求:单张RTX 4090(24GB)可流畅运行

- 微调需求:消费级显卡(12GB显存)+ LoRA技术

- 边缘部署:支持NVIDIA Jetson AGX Orin(16GB)实时推理

行业影响与趋势

Qwen3-VL-8B-Thinking-FP8的发布标志着多模态模型进入"普惠时代"。其技术路线证明:通过架构创新而非单纯堆参数,小模型完全可实现超越尺寸的性能表现。这一趋势将加速AI在制造业质检、移动设备交互、医疗辅助诊断等领域的渗透。

预计到2026年,80%的边缘AI设备将搭载类似规模的多模态模型,推动"感知-决策-执行"闭环应用的普及。对于企业而言,现在是探索多模态AI应用的最佳时机,可重点关注Qwen3-VL在复杂工业质检与设备维护、智能客服与用户交互优化、教育培训内容自动生成等场景的应用潜力。

结论:轻量级模型的价值重构

Qwen3-VL-8B-Thinking-FP8以80亿参数实现了"三升三降":性能提升、效率提升、精度提升;成本下降、门槛下降、能耗下降。对于开发者,这意味着能用更低成本探索创新应用;对于企业,开启了大规模部署多模态AI的可行性;对于用户,将获得更自然、更智能的交互体验。

随着开源生态的完善,我们正迎来"人人可用大模型"的新阶段。Qwen3-VL-8B-Thinking-FP8不仅是技术创新的产物,更是AI技术发展进程中的重要里程碑,它正在将曾经遥不可及的先进多模态能力带入寻常企业和开发者的手中,为AI产业的健康发展注入新的活力。

对于开发者和企业而言,现在正是探索Qwen3-VL-8B-Thinking-FP8应用潜力的最佳时机。通过访问模型仓库获取资源,结合具体业务场景进行微调,有望在AI驱动的新一轮产业变革中抢占先机。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-VL-8B-Thinking-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-VL-8B-Thinking-FP8