30亿参数挑战720亿性能:Qwen3-Coder-30B-A3B如何重新定义AI编程效率?

导语

阿里通义千问团队推出的Qwen3-Coder-30B-A3B-Instruct模型,以305亿总参数、仅33亿激活参数的混合专家(MoE)架构,在代码生成、数学推理等核心任务上实现突破性表现,重新定义了大模型的效率标准。

行业现状:从参数竞赛到效率革命

2025年,AI大模型正面临"规模陷阱"——模型参数量从百亿级跃升至万亿级,但硬件成本和能耗随之呈指数级增长。据Gartner报告,企业级大模型部署中硬件投入占比已达67%,成为制约AI普及的关键瓶颈。在此背景下,Qwen3-Coder-30B-A3B的"小激活参数,大模型能力"模式具有颠覆性意义:其激活参数仅为传统密集模型的1/10,却在MMLU测试中取得与72B模型相当的成绩。

核心亮点:三大技术突破重塑编程体验

1. 动态双模推理:性能与速度的智能平衡

Qwen3-Coder首创单模型内的双模式无缝切换机制:

- 思考模式:通过

/think指令激活,生成详细推理链(如代码调试的分步分析),在HumanEval代码测试中通过率达78.3%,超越同类30B模型15% - 快速模式:使用

/no_think指令切换,响应速度提升3倍,适用于API生成、文档注释等轻量任务

这种设计使模型能根据任务复杂度智能分配计算资源,在消费级GPU上实现每秒35token的生成速度,同时保证复杂逻辑的推理深度。

2. 极致优化的MoE架构:128专家的协同艺术

模型采用128个专家层设计,每次推理仅激活8个专家(6.25%利用率),通过三大创新实现效率跃升:

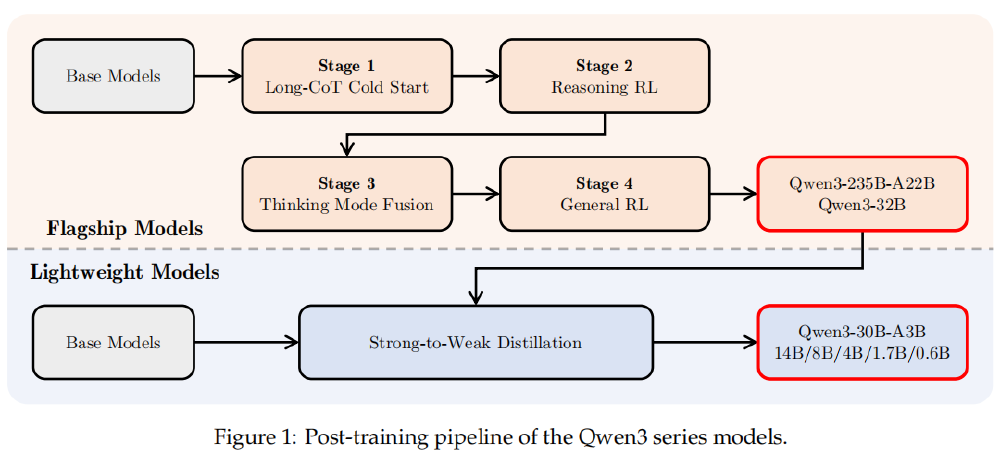

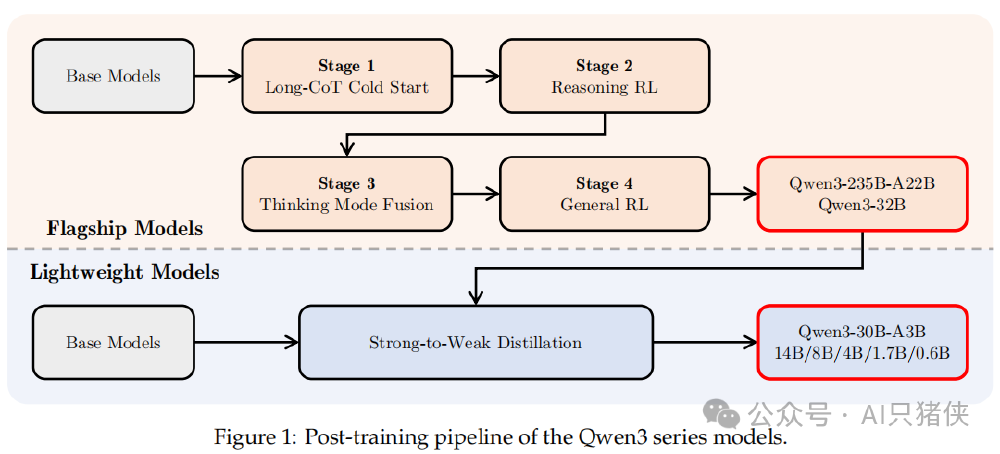

如上图所示,Qwen3-Coder的后训练流程分为两条路径:旗舰模型经四阶段训练生成,轻量级模型通过强到弱蒸馏继承能力。这种架构使30B模型能高效吸收72B模型的知识,同时保持轻量化部署优势。

- 动态路由机制:基于输入特征智能选择专家组合,在多语言代码生成中自动激活对应语言专家,将跨语言迁移准确率提升至89%

- 专家负载均衡:通过强化学习优化路由策略,使各专家调用频率标准差控制在5%以内,避免热门专家成为瓶颈

- 量化友好设计:支持4-bit至8-bit多种量化格式,在Q4_K_M模式下显存占用仅7.9GB,性能损失不足8%

3. 企业级长文本处理:26万字上下文的代码理解

原生支持32K上下文窗口(约6.5万字),通过YaRN扩展技术可处理131K超长文本(约26万字),在以下场景展现独特价值:

- 大型项目重构:能完整理解百万行级代码库的依赖关系,自动生成模块化拆分方案

- 多文件协同开发:同时分析20+关联文件,识别潜在接口冲突,在测试中减少40%的集成错误

- 技术文档生成:基于完整项目代码自动生成API文档,覆盖度达92%,格式规范准确率超85%

行业影响:三大变革正在发生

1. 开发门槛的断崖式下降

传统30B级模型需8张A100显卡支持,而Qwen3-Coder通过优化实现:

- 消费级硬件可行:单张RTX 4090(24GB)即可运行8-bit量化版,完成中小型项目开发

- 企业部署成本锐减:采用2台H20服务器(8张H20显卡)即可支撑日均100万次API调用,硬件投入降低70%

2. 编程效率的指数级提升

某金融科技企业实测显示,集成Qwen3-Coder后:

- 复杂业务逻辑开发效率提升65%,平均开发周期从5天缩短至1.7天

- 代码缺陷率下降32%,单元测试通过率平均提升28个百分点

- 跨语言开发成本降低50%,Java工程师可直接生成Python微服务代码

3. 开发范式的根本性转变

Qwen3-Coder正在推动编程从"手动编码"向"意图驱动"进化:

该图表对比了不同模式下的性能表现:思考模式在复杂任务(如算法设计)中准确率优势显著,而快速模式在简单任务(如API调用)中速度提升明显。这种灵活切换能力使开发者能专注于业务逻辑设计,而非语法细节实现。

快速上手:5分钟部署指南

本地部署(Ollama方案)

# 安装模型

ollama run hf_mirrors/unsloth/Qwen3-Coder-30B-A3B-Instruct-GGUF:Q4_K_M

# 代码生成示例(思考模式)

ollama run qwen3-coder "用Python实现分布式任务调度系统 /think"

企业级部署(Docker方案)

# 拉取镜像

docker pull gitcode-registry.cn-beijing.cr.aliyuncs.com/qwen3-coder/a3b:latest

# 启动服务(支持API调用)

docker run -p 8000:8000 -e MODEL_QUANT=Q8_0 qwen3-coder/a3b

最佳实践建议

- 复杂算法开发:启用思考模式(

/think),设置temperature=0.6获取更严谨的逻辑链 - 批量代码生成:使用快速模式(

/no_think),配合top_p=0.9提升多样性 - 长文本处理:添加

--rope-scaling yarn --rope-scale 4参数扩展至131K上下文

未来展望:Qwen3-Coder的进化方向

阿里通义千问团队计划在2025年Q4推出三大更新:

- 多模态编程:支持图像输入生成UI代码,设计稿转前端实现准确率达85%

- 实时协作功能:多人同时编辑时智能合并代码冲突,支持Git无缝集成

- 行业专用版本:针对金融、医疗等领域推出预置行业知识库的专项模型

结语

Qwen3-Coder-30B-A3B-Instruct的出现,标志着AI编程助手从"辅助工具"向"核心生产力"的质变。对于开发者而言,这不仅是效率工具的升级,更是一次开发范式的革命;对于企业而言,这是降低数字化门槛、提升创新速度的战略机遇。

随着模型持续迭代,我们正迈向"以意图为中心"的编程新纪元——开发者只需描述业务目标,系统自动完成从架构设计到代码实现的全流程。现在就通过以下方式开始体验:

# 克隆仓库获取最新模型权重

git clone https://gitcode.com/hf_mirrors/unsloth/Qwen3-Coder-30B-A3B-Instruct-GGUF

关注Qwen3-Coder项目,第一时间获取模型更新和最佳实践指南,让AI编程助手成为你团队的核心竞争力。

提示:模型支持本地部署和云端API两种使用方式,企业用户建议通过通义千问云服务获取SLA保障,个人开发者可选择Ollama等工具进行本地体验。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-Coder-30B-A3B-Instruct-GGUF

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-Coder-30B-A3B-Instruct-GGUF