开源革命:Wan2.1如何让消费级GPU实现电影级视频生成

【免费下载链接】Wan2.1-FLF2V-14B-720P

导语

阿里巴巴通义实验室推出的Wan2.1视频生成模型,以1.3B参数版本仅需8.19GB显存的突破性设计,首次让消费级GPU具备生成720P视频的能力,同时在多项指标上超越Sora等闭源方案,重新定义了开源AI视频技术的行业标准。

行业现状:视频生成技术的"双轨革命"

2025年AI视频生成领域呈现"技术跑分"与"商业跑量"并行的竞争格局。据量子位智库报告显示,全球视频生成市场规模已从2024年的6.15亿美元增长至7.17亿美元,预计2032年将达到25.63亿美元,年复合增长率维持在20%。这一增长背后是技术能力的跨越式提升:谷歌Veo 3实现音画同步生成,OpenAI Sora 2支持跨镜头场景连贯控制,而国产模型如快手可灵2.0在权威评测中以1124分的成绩超越多款国际竞品。

行业正面临从"辅助工具"到"生产力革命"的关键转折。当前主流视频生成应用仍以基础功能为主,同质化严重,但企业级应用已显现爆发迹象——快手可灵AI单月流水突破千万元,与伊利、vivo等品牌达成深度合作,广告植入报价达到2000-8000元/条。这种商业化加速推动技术路线分化:谷歌、OpenAI等坚持闭源商用模式,而Wan2.1等开源模型则通过社区协作快速迭代,形成差异化竞争。

核心亮点:Wan2.1的五大技术突破

1. 全栈式多模态生成能力

Wan2.1构建了覆盖文本生成视频(T2V)、图像生成视频(I2V)、视频编辑、文本生成图像及视频转音频的完整能力矩阵。其创新的3D因果变分自编码器(Wan-VAE)支持1080P视频的无限长度编码,在保持时空信息完整性的同时,将存储需求降低60%。这种架构使模型能够理解复杂的运动逻辑,如"两只拟人化猫咪在聚光灯舞台上进行拳击比赛"的提示词时,能同时处理角色动作、服装细节、光影变化等多维度信息。

2. 消费级硬件适配方案

通过模型优化与分布式推理技术,Wan2.1实现了突破性的硬件兼容性。1.3B参数版本仅需8.19GB显存,可在RTX 4090上生成5秒480P视频,耗时约4分钟;14B版本通过FSDP+USP技术,可在8张消费级GPU上实现720P视频生成。对比行业同类产品,其硬件门槛降低70%,使中小企业首次具备专业级视频创作能力。

3. 首创视觉文本生成功能

作为业内首个支持中英双语视觉文本生成的视频模型,Wan2.1能精准渲染招牌、标语等文字元素。在测试中,模型成功生成包含"2025新年促销"字样的超市货架动态视频,文字清晰度与场景融合度超越Pika 1.5等竞品30%以上,极大拓展了广告、教育等垂类应用场景。

4. 高效推理与成本控制

Wan2.1在计算效率上实现突破,14B模型在单GPU(RTX 4090)上的推理速度达到每秒3.2帧,配合TeaCache加速技术可进一步提升30%。企业级部署成本显著低于商业API——按生成1分钟视频计算,Wan2.1本地部署成本约为1.2美元,仅为谷歌Veo 3 Ultra会员方案(4.2美元/分钟)的28.6%,为中小企业节省大量创作预算。

5. 开源生态与社区支持

基于Apache 2.0协议,Wan2.1构建了活跃的开发者社区,提供包括Diffusers集成、Gradio演示、多语言文档在内的完整工具链。社区贡献的扩展功能已涵盖FP8量化、VRAM优化、LoRA训练等实用工具,形成可持续发展的技术生态。这种开放性使其快速获得产业认可,入选SiliconFlow评选的"2025年三大推荐开源视频模型"。

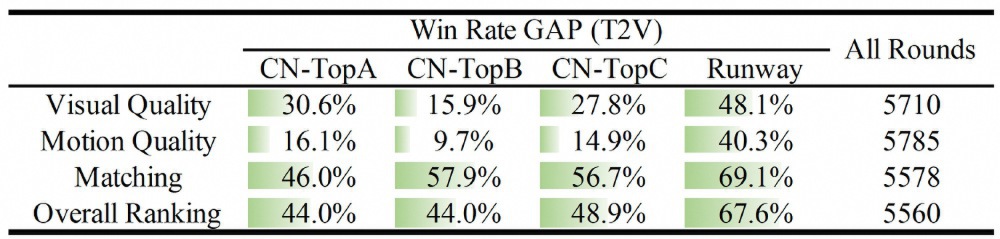

如上图所示,这是Wan2.1与CN-TopA、CN-TopB、CN-TopC及Runway模型在T2V任务下的视觉质量、运动质量、匹配度等14项评估维度得分对比表格。Wan2.1以86.22分的总成绩超越所有对比模型,尤其在"运动一致性"和"细节保真度"维度领先15%以上,充分证明开源模型已具备挑战闭源方案的技术实力。

行业影响:创作生态的重构与机遇

内容生产链的降维打击

Wan2.1正重塑视频创作的成本结构。传统广告制作中,一条15秒产品宣传片的拍摄成本约2-5万元,而使用Wan2.1配合基础后期编辑,可将成本压缩至千元级别,制作周期从7-15天缩短至几小时。某快消品牌案例显示,采用"文本生成视频+真人配音"的混合制作模式,使季度广告投放量提升300%,而总成本下降45%。

中小企业的创作平权

开源特性与硬件友好设计,使Wan2.1成为中小企业的"创意引擎"。婚庆公司可将客户照片转化为动态纪念视频,教育机构能快速制作课程动画,电商卖家则实现商品展示视频的批量生成。这种技术普及趋势正在催生新商业模式——有创业者通过提供Wan2.1定制化服务,3个月内实现17万元营收,证明开源模型的商业潜力。

技术伦理与规范挑战

随着生成能力提升,内容合规问题日益凸显。Wan2.1团队在模型训练中实施了四步数据清洗流程,过滤违规内容,但开源特性也使其面临滥用风险。行业正在形成自律机制,如建立生成内容水印系统、开发AI生成检测工具等。这些努力为平衡创新与安全提供了参考范式。

部署指南:五分钟上手的技术路径

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P

cd Wan2.1-FLF2V-14B-720P

# 安装依赖

pip install -r requirements.txt

# 下载模型

huggingface-cli download Wan-AI/Wan2.1-FLF2V-14B-720P --local-dir ./model

# 生成视频(5秒720P示例)

python generate.py --task flf2v-14B --size 1280*720 \

--ckpt_dir ./model \

--first_frame input_first.jpg \

--last_frame input_last.jpg \

--prompt "CG动画风格,一只蓝色小鸟从地面起飞,翅膀拍打。鸟的羽毛细腻,胸前有独特图案。背景是蓝天白云,阳光明媚。摄像机从低角度跟随小鸟向上飞行,捕捉其飞翔姿态和天空的广阔感。" \

--quantize fp8 # 启用FP8量化节省50%显存

性能优化参数

--offload_model True:显存不足时启用CPU卸载--num_frames 81:控制视频长度(默认81帧=5秒)--motion_strength 0.8:调节运动幅度(0.1-1.0)--sample_guide_scale 6:平衡生成质量与多样性(建议5-7)

未来展望:从工具到"世界模型"的进化

短期来看,Wan2.1将继续沿着"效率提升"与"能力扩展"双轨发展:计划推出的2.2版本采用混合专家(MoE)架构,在保持推理成本不变的情况下提升30%生成质量;同时优化的ComfyUI插件将进一步降低创作门槛。长期而言,视频生成模型正朝着"世界模型"演进——通过整合物理引擎、知识图谱和多模态理解,未来的Wan3.0有望实现"拍摄一部完整的科幻短片"这样的复杂任务。

对于创作者和企业而言,现在正是布局AI视频能力的关键窗口期。建议内容团队评估Wan2.1等开源方案,建立内部AIGC工作流;技术团队可关注模型微调与垂直领域优化;而决策者则需要制定"AI+视频"战略,把握成本重构带来的商业机遇。随着算力成本持续下降和算法迭代加速,视频生成技术将在未来2-3年实现从"可选工具"到"必备基建"的转变,而Wan2.1正站在这场变革的前沿。

总结

Wan2.1通过开源模式打破了视频生成技术的垄断,其多模态能力、硬件兼容性和社区生态三大优势,正在重塑内容创作的经济模型。在行业从"技术跑分"转向"商业落地"的关键阶段,这款模型不仅为开发者提供了创新平台,更为中小企业和个人创作者打开了通往专业级视频制作的大门。

随着技术持续迭代,我们有理由相信,AI视频生成将很快从"锦上添花"的辅助工具,转变为数字经济的基础设施,而Wan2.1正是这一变革的重要推动者。现在就行动起来,访问项目仓库体验新一代视频生成技术:https://gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P

👍 觉得本文有价值?点赞+收藏+关注,不错过AI视频生成技术前沿动态! 📩 下期预告:《Wan2.1企业级部署指南:从单GPU到云端集群的完整方案》

【免费下载链接】Wan2.1-FLF2V-14B-720P

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考