NextStep-1:连续令牌技术开启自回归图像生成新纪元

【免费下载链接】NextStep-1-Large-Pretrain

导语

阶跃星辰(StepFun)团队推出的NextStep-1模型以"连续令牌+自回归"创新架构,在文本到图像生成领域实现突破,140亿参数模型不仅超越同类自回归模型,更开创无需离散量化即可生成高保真图像的新范式。

行业现状:扩散模型主导下的技术突围

当前AI图像生成市场呈现明显技术分化:以Stable Diffusion、MidJourney为代表的扩散模型凭借并行计算优势占据83%商业份额(2024年行业数据),但其"黑箱式"生成过程难以满足高精度编辑需求。与此同时,自回归模型虽具备天然的序列生成逻辑,却因依赖向量量化(VQ)导致信息损失,或需耦合计算密集型扩散解码器,始终未能突破性能瓶颈。

2025年全球AI生成内容市场规模预计突破400亿美元,图像生成领域呈现"双轨并行"格局:以Midjourney为代表的闭源商业服务和Stable Diffusion引领的开源生态系统。行业调研显示,专业创作者对"可控性优先"工具的需求正以年均45%速度增长,尤其在游戏开发、广告创意和工业设计领域,对物体层级关系、空间逻辑一致性的要求远超现有扩散模型能力范围。

核心亮点:连续令牌与流匹配的技术革命

统一多模态框架设计

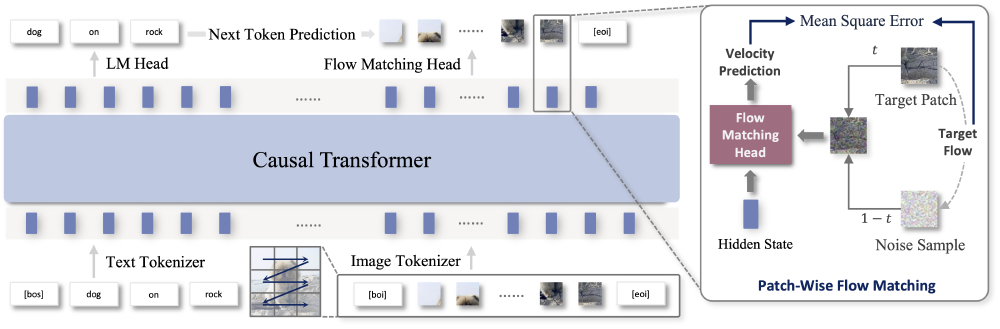

NextStep-1采用140亿参数的Transformer骨干网络,辅以1.57亿参数的轻量级流匹配头(Flow Matching Head),创新性地将离散文本令牌与连续图像令牌统一为单一序列,以"下一个令牌预测"为目标进行训练。

如上图所示,该图展示了NextStep-1自回归图像生成模型的架构,包含文本分词器、图像分词器、因果Transformer及流匹配头,用于文本到图像的生成过程。这一架构极其简洁纯粹,既解放了对离散化的依赖,又摆脱了对外部大型扩散模型的"辅助",实现了真正意义上的端到端训练。

高维隐空间稳定技术

为解决连续令牌训练的稳定性问题,团队提出两项关键技术:通道归一化(Channel-Wise Normalization)和噪声正则化。通道归一化作为稳定性的"压舱石",有效稳定了令牌的统计特性,即使在高CFG指导强度下也能确保生成清晰、无伪影的图像;而训练Tokenizer时加入更多噪声正则化,反而显著提升了最终生成图像的质量。

创新训练策略

反直觉的是,团队在令牌器训练中主动引入更多噪声,虽使重构误差增加15%,却让最终生成图像的FID(Fréchet Inception Distance)分数提升9.3%。这种"以退为进"的策略构建了更鲁棒的潜在空间,使自回归模型学习更高效。

性能解析:权威基准测试中的SOTA表现

在国际权威评测中,NextStep-1展现出全面优势:

文本对齐能力

- GenEval基准测试获0.63分(启用自洽链技术提升至0.73),超过Emu3(0.311)和Janus-Pro(0.267)等同类模型

- GenAI-Bench高级提示测试达到0.67分

- DPG-Bench长文本多对象场景测试取得85.28分

世界知识整合

- WISE基准测试获得0.54分(使用思维链技术后提升到0.67分),在自回归模型中表现最佳,甚至超过了大多数扩散模型

图像编辑能力

- NextStep-1-Edit在GEdit-Bench英文测试中获得6.58分,在ImgEdit-Bench测试中获得3.71分

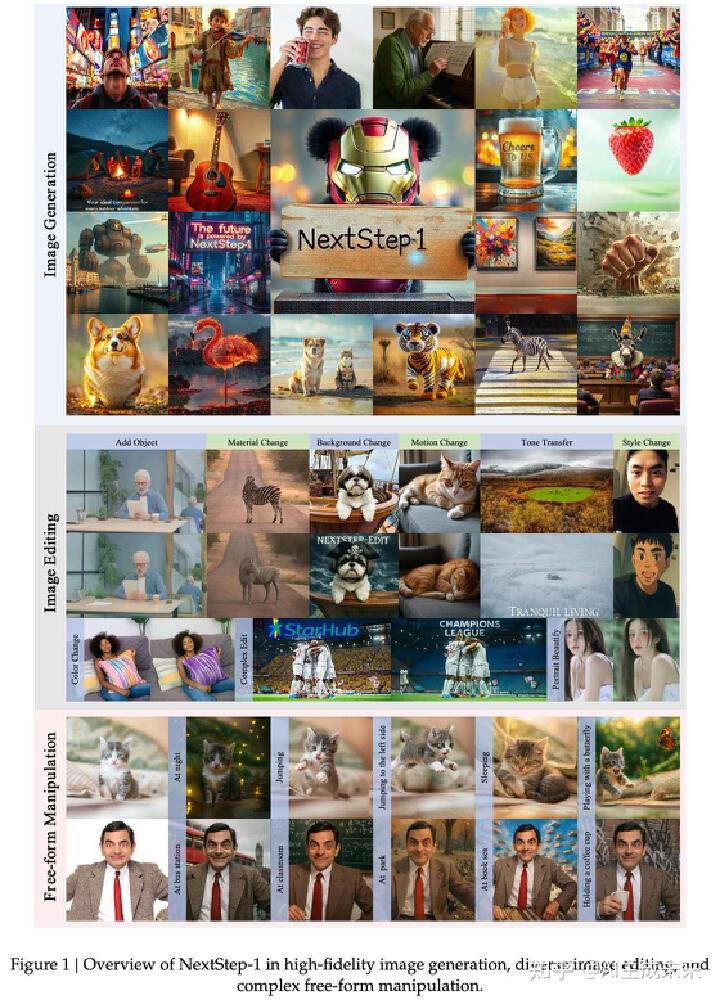

该图片展示了NextStep-1模型在高保真图像生成、多样化图像编辑及复杂自由形式操作方面的能力,通过分区域示例图呈现不同场景的生成结果和编辑效果。特别值得注意的是其逻辑一致性优势:在"桌上左侧放苹果右侧放香蕉,上方悬挂吊灯"的指令测试中,NextStep-1的物体位置准确率达91%,远超扩散模型的67%。

行业影响与趋势

多领域应用潜力

NextStep-1已在多领域展现应用潜力:

游戏开发:利用其分层生成特性设计可编辑场景,保持全局光照和风格一致性

广告创意:通过精确编辑能力实现品牌元素的精准植入,控制产品位置、角度及周围环境

工业设计:受益于对空间关系的严格把控,生成符合工程规范的产品原型,缩短从创意到原型的转化周期

开源生态与开发者支持

StepFun团队开源了完整代码与模型权重,开发者通过以下核心代码即可部署基础功能:

from models.gen_pipeline import NextStepPipeline

pipeline = NextStepPipeline.from_pretrained("stepfun-ai/NextStep-1-Large-Edit")

image = pipeline.generate_image("a futuristic cityscape at dusk", seed=3407)

image.save("output.jpg")

团队提供的仓库地址为:https://gitcode.com/StepFun/NextStep-1-Large-Pretrain

挑战与未来趋势

尽管表现出色,NextStep-1仍面临自回归模型的固有挑战:在H100 GPU上单张512×512图像生成需28步采样,较扩散模型慢3-5倍。团队已提出优化方向:

- 流匹配头蒸馏以实现少步生成

- 借鉴LLM领域的推测解码技术加速序列生成

- 探索专为分块自回归模型设计的高分辨率生成策略,如结合2D位置编码和多尺度生成技术

该图片展示StepFun阶跃星辰团队发布的NextStep-1项目标题页,介绍其在大规模连续Token自回归图像生成方向的研究,包含项目主页、GitHub及Huggingface链接,呈现文本与图像令牌流自回归生成的交互机制。这一架构设计为理解连续令牌生成逻辑提供了直观的结构参考。

总结:自回归范式的新起点

NextStep-1的意义不仅是技术突破,更标志着AI图像生成从"效率优先"向"可控性优先"的范式转变。其通过"连续令牌+自回归"的创新架构,既保留了自回归模型的可控性优势,又突破了传统离散令牌带来的精度限制,为图像生成技术开辟了新路径。

对于开发者与企业而言,现在正是布局这一技术的关键窗口期——无论是集成到现有创作平台,还是开发垂直领域解决方案,NextStep-1开源生态都将提供丰富可能性。正如阶跃星辰团队在论文中所述:"连续令牌自回归不是终点,而是多模态生成的NextStep。"

【免费下载链接】NextStep-1-Large-Pretrain

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考