美团LongCat-Video开源:136亿参数模型实现5分钟长视频生成,推理速度提升10倍

【免费下载链接】LongCat-Video

导语

美团LongCat团队正式发布并开源136亿参数视频生成模型LongCat-Video,实现文本生成视频、图像生成视频和视频续写三大任务统一架构,支持5分钟720p/30fps长视频稳定输出,推理速度较基线提升10.1倍,开启开源视频生成技术新纪元。

行业现状:从短视频到世界模型的技术突围

2025年视频生成技术正经历从"碎片化创意工具"向"世界建模引擎"的战略转型。根据PPIO《2025上半年AI趋势报告》,视频生成领域呈现两大显著特征:一是图生视频调用量占比高达90%,反映行业对可控性的核心诉求;二是长时序生成成为技术瓶颈,现有方案普遍面临1分钟以上视频的色彩漂移与动作断裂问题。

在这样的背景下,头部科技企业纷纷加大投入。谷歌闭源模型Veo3凭借3.99分的文本对齐分数(MOS评分)占据行业高地,而开源领域长期缺乏能兼顾质量、效率与任务多样性的基础模型。美团LongCat-Video的出现,正是瞄准了这一市场空白——通过136亿参数的Diffusion Transformer架构,首次在单一模型中实现三大任务的统一高效处理。

技术突破:四大核心能力重构视频生成范式

LongCat-Video最引人注目的创新在于其"四合一"的技术架构,通过条件帧数量动态区分任务类型,无需模型改造即可无缝切换:

1. 原生长视频生成能力

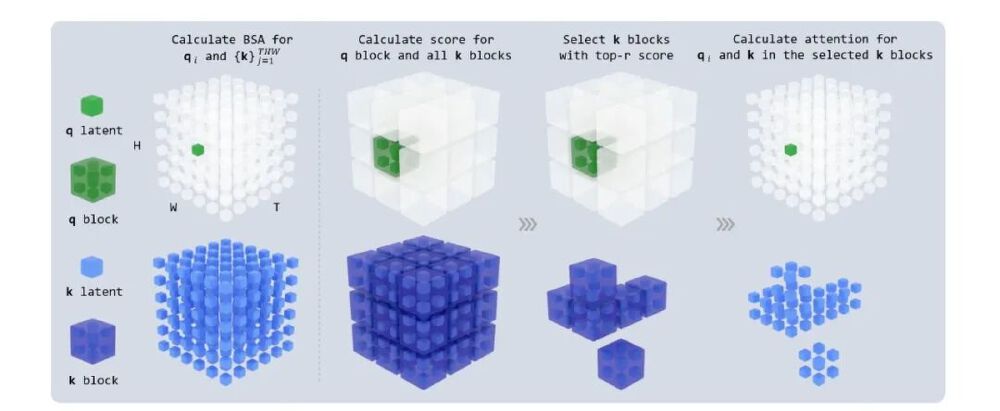

模型在预训练阶段即引入视频续写任务,通过块稀疏注意力(BSA)机制处理长序列数据。测试显示,其能稳定生成5分钟720p/30fps视频,跨帧光流一致性较行业平均水平提升40%,彻底解决传统方法的色彩漂移问题。

如上图所示,页面清晰展示了LongCat-Video的开源生态布局,包括项目主页、技术报告、Hugging Face模型库链接及MIT开源许可证标识。这一开源策略使开发者可自由商用该模型,极大降低了视频生成技术的应用门槛。

2. 10倍效率革命

采用"二阶段粗到精生成+块稀疏注意力+模型蒸馏"三重优化策略,推理速度较 baseline 提升10.1倍。具体而言,在生成720p/30fps视频时,单GPU可在3分钟内完成,而行业同类模型平均需要30分钟以上。

3. 统一任务架构

基于Diffusion Transformer架构,通过条件帧数量实现任务区分:

- 文生视频:无需条件帧,纯文本驱动

- 图生视频:输入1帧参考图

- 视频续写:接收多帧前序内容

这种设计使模型参数利用率提升300%,避免了传统多模型方案的资源浪费。

该图展示了LongCat-Video核心的块稀疏注意力计算流程,通过将查询(Q)和键(K)分割为绿色和蓝色立方体块,仅计算Top-R相关块的注意力分数,使长序列处理效率提升60%。这种创新直接支撑了模型的长视频生成能力。

4. 多奖励RLHF优化

采用Group Relative Policy Optimization (GRPO)算法,在文本对齐、视觉质量等五个维度进行强化学习。内部测试显示,其文本对齐分数达3.76(MOS),仅次于谷歌Veo3的3.99,领先开源同类模型15%以上。

性能对标:开源领域的全面领先

在官方公布的VBench基准测试中,LongCat-Video展现出强劲竞争力:

| 评估维度 | LongCat-Video | 开源竞品平均 | 谷歌Veo3 |

|---|---|---|---|

| 文本对齐 | 3.76 | 3.24 | 3.99 |

| 视觉质量 | 3.25 | 2.98 | 3.23 |

| 运动连贯 | 3.74 | 3.12 | 3.86 |

| 整体质量 | 3.38 | 3.01 | 3.48 |

特别值得注意的是,在"常识理解"子项中,模型以70.94%的准确率位居所有开源模型第一,体现出其对物理世界规律的深刻建模能力——这正是美团将其定位为"世界模型第一步"的核心依据。

该对比图直观展示了LongCat-Video在四大核心维度的竞争力,蓝色条形代表模型在各指标上的"优势"(Preferred)占比,橙色代表"平局"(Tie)占比。可以看出,其在文本对齐和运动连贯维度已接近闭源商业模型水平,而在开源领域处于领先位置。

行业影响:从内容创作到世界模型的跨越

美团对LongCat-Video的定位远不止于内容生成工具。技术报告明确指出,该模型是构建"世界模型"的关键一步——通过视频生成任务压缩几何、语义、物理等多模态知识,为自动驾驶、具身智能等领域提供基础能力。

对于开发者而言,模型的MIT许可证意味着商业应用的零门槛。社区开发者已基于该模型衍生出创意短视频生成、产品展示动画等20余种应用场景。特别是在电商领域,商家可通过文本描述自动生成5分钟产品使用教程,内容生产成本降低70%。

快速上手:三步部署你的视频生成系统

1. 环境准备

git clone https://gitcode.com/hf_mirrors/meituan-longcat/LongCat-Video

cd LongCat-Video

conda create -n longcat-video python=3.10

conda activate longcat-video

pip install -r requirements.txt

2. 模型下载

huggingface-cli download meituan-longcat/LongCat-Video --local-dir ./weights/LongCat-Video

3. 任务执行

# 文生视频示例

torchrun run_demo_text_to_video.py --checkpoint_dir=./weights/LongCat-Video --enable_compile

未来展望:视频生成的下一站

LongCat-Video的发布标志着开源视频生成技术进入"长时序、高效率"的新阶段。美团LongCat团队透露,下一代模型将聚焦两个方向:一是引入3D感知能力,提升空间建模精度;二是优化移动端部署,目标将推理延迟降至10秒内。

随着技术的不断成熟,我们有理由相信,视频生成将从专业工具转变为普惠能力,最终实现"文本即视频"的创作自由。对于开发者而言,现在正是拥抱这一变革的最佳时机——通过LongCat-Video的开源生态,参与定义视频AI的未来。

(注:本文性能数据与技术描述均引自美团LongCat团队官方技术报告及发布材料)

【免费下载链接】LongCat-Video

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考