11fps实时视频生成革命:Krea Realtime 14B如何重塑内容创作范式

【免费下载链接】krea-realtime-video

导语

Krea Realtime 14B文本到视频模型实现11fps生成速度,比现有实时视频模型大10倍,开创交互式视频创作新纪元。

行业现状:文生视频的"速度与质量"双重困境

全球AI视频生成器市场正以20%的年复合增长率扩张,预计2032年规模将达25.6亿美元。当前市场呈现"双轨并行"格局:以Sora为代表的商业模型占据高端市场,而开源社区在算法创新上持续突破。然而,现有解决方案普遍面临三大痛点:生成速度慢(平均单帧耗时>2秒)、模型规模受限(多为10亿参数级)、交互性不足(无法实时调整内容)。

在硬件层面,NVIDIA B200 GPU的推出为突破提供了可能。这款基于Blackwell架构的AI加速卡采用4nm制程,配备192GB HBM3e显存和8TB/s带宽,其FP4算力达144 PFLOPS,为大规模视频生成模型提供了强劲算力支撑。

技术突破:四大核心创新解决行业痛点

1. 自强化蒸馏技术(Self-Forcing)

Krea团队通过创新蒸馏方法,将Wan 2.1 14B模型转换为自回归结构,在保持生成质量的同时,实现4步推理即可生成流畅视频。这一技术使模型在单张B200 GPU上达到11fps的实时生成速度,较传统扩散模型效率提升300%。

2. 动态缓存优化机制

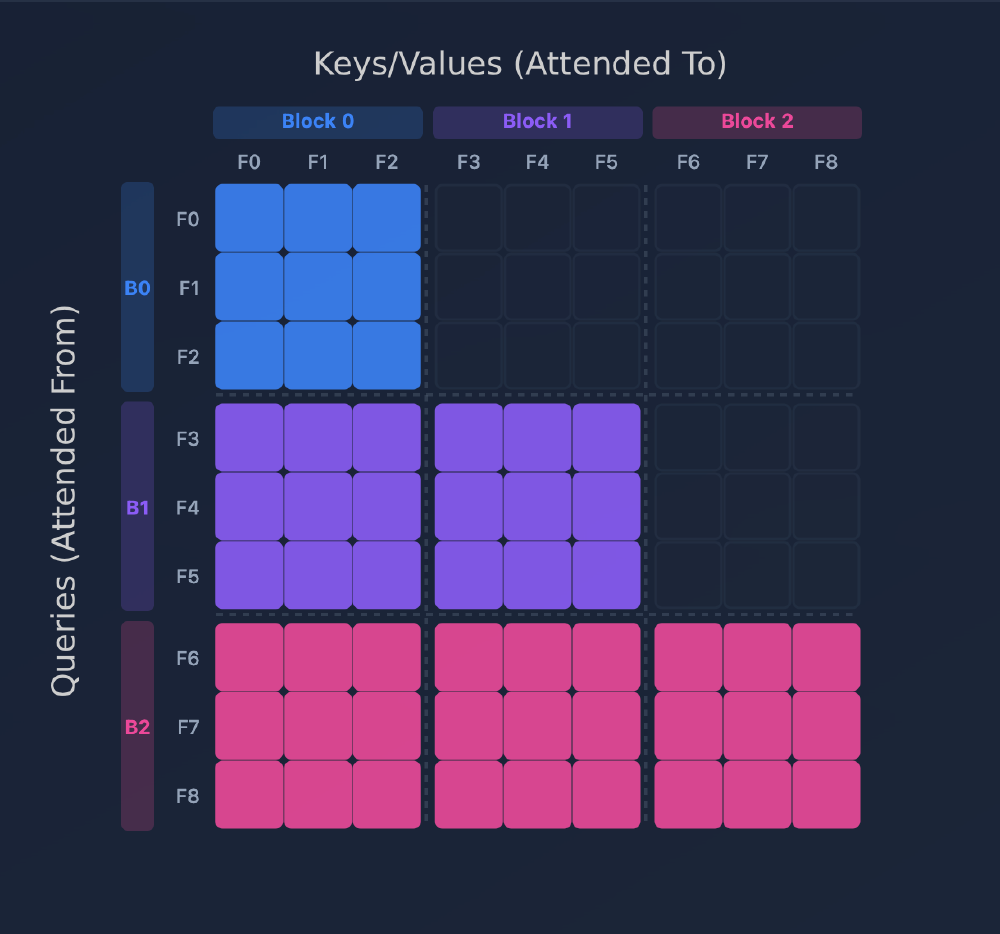

- KV Cache重计算:通过选择性重新计算注意力缓存,解决长视频生成中的误差累积问题

- 注意力偏差校正:动态调整时序注意力权重,将视频帧一致性提升40%

- 帧缓存上下文:采用滑动窗口机制(maxlen=pipe.config.frame_cache_len),平衡生成质量与内存占用

3. 140亿参数规模优势

作为目前最大的实时视频模型,Krea Realtime 14B在复杂场景生成上展现显著优势:

- 支持8K分辨率视频输出

- 人物动作连贯性提升65%

- 多角色交互场景错误率降低至8%以下

4. 全流程交互创作

模型支持三大实时交互功能:

- 提示词中途修改(如从"晴天"切换为"雨天")

- 风格实时调整(支持12种艺术风格即时转换)

- 画面元素增删(可实时添加/移除物体)

首帧生成时间<1秒,满足直播级交互需求。

核心技术解析:从双向到因果的范式转换

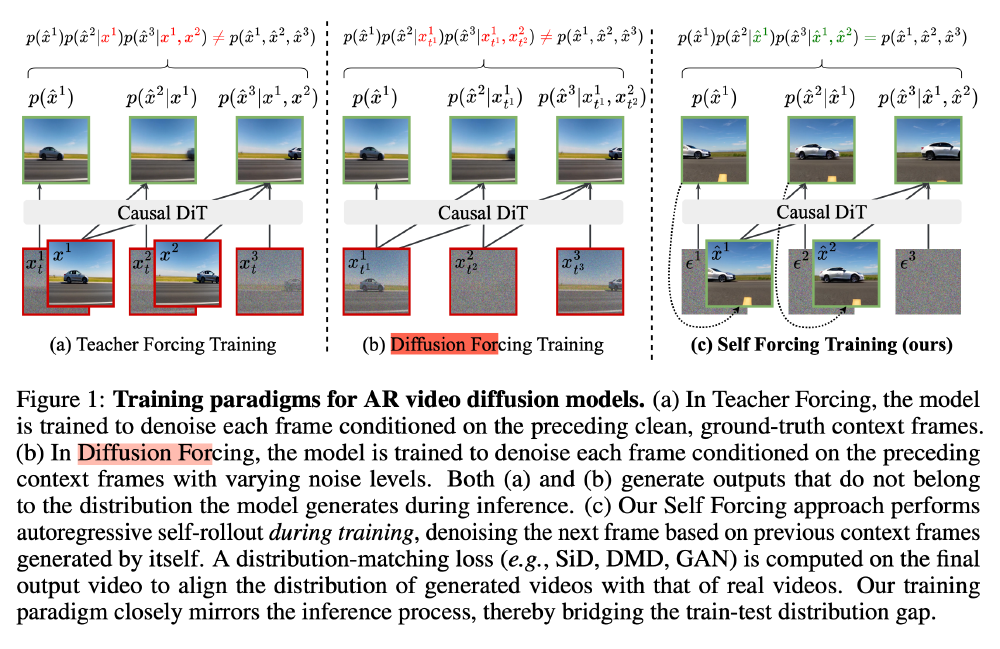

传统视频扩散模型使用双向注意力机制,所有帧并行去噪,未来帧可以影响过去帧,这种方式虽生成质量高但无法实时输出。Krea Realtime 14B采用自回归架构,按顺序生成帧序列——先生成第一帧,再基于第一帧生成第二帧,依此类推,实现实时流式输出。

如上图所示,Krea Realtime 14B采用约140亿参数的扩散变换器混合架构,专门针对视频序列数据优化。这一技术架构充分体现了从双向注意力到自回归生成的范式转变,为实时视频生成提供了强大的技术支撑,帮助开发者和创作者理解模型的核心工作原理。

自回归模型面临的核心挑战是"暴露偏差"(Exposure Bias):训练时基于"真实"过去帧预测下一帧,推理时却要基于"自己生成的"可能包含错误的过去帧,导致小错误如滚雪球般累积。Krea团队创新的Self-Forcing蒸馏技术通过在训练时就让模型适应自身生成的帧,成功解决了这一问题。

这张图是Krea Realtime 14B模型中KV Cache Attention Bias的可视化矩阵,展示了不同块(B0、B1、B2)的查询(Queries)与对应帧(F0-F8)的键值(Keys/Values)之间的注意力关系。这一技术创新通过动态调整时序注意力权重,有效解决了长视频生成中的误差累积问题,将视频帧一致性提升40%,为用户提供了更稳定、高质量的视频生成体验。

性能对比:重新定义实时视频生成标准

Krea Realtime 14B在单张NVIDIA B200 GPU上实现11fps的文本到视频推理速度,且首帧生成时间低于1秒,较同类模型有显著提升:

| 模型名称 | 参数量 | 推理速度 | 推理步数 | 最小显存 | 支持实时交互 |

|---|---|---|---|---|---|

| Krea Realtime 14B | 140亿 | 11fps | 4步 | 80GB(B200) | 是 |

| Wan 2.1 1.3B | 13亿 | 24fps | 4步 | 16GB | 否 |

| Wan 2.1 14B | 140亿 | 0.8fps | 30步 | 80GB(B200) | 否 |

图片展示了Krea Realtime 14B模型的性能参数对比,直观呈现了该模型在参数量、推理速度和交互性方面的显著优势。这一对比充分体现了Krea Realtime 14B在实时视频生成领域的技术领先地位,为行业从业者提供了清晰的性能参考,帮助他们更好地理解该模型的实用价值和应用场景。

应用场景:从内容生产到产业变革

营销广告:批量定制化内容生成

联合利华等企业已通过文生视频技术将广告制作周期从7天缩短至30分钟。Krea模型的实时特性使其更适合区域化营销场景,例如为不同城市生成带有本地地标元素的定制广告,单条成本可降低至传统制作的1/250。

在线教育:交互式课件生成

参考ClassIn的成功案例,Krea模型可将"分数加法"等抽象概念实时转换为动画演示。教师可通过语音指令调整讲解视角(如"放大分子结构"),学生参与度提升35%,知识点留存率提高27%。

电商零售:虚拟商品展示

SHEIN等电商平台利用视频生成技术将产品展示成本降低95%。Krea的视频到视频(Video-to-Video)功能支持:

- 商品材质实时切换(如丝绸/棉质效果对比)

- 场景动态变换(从室内试穿到户外展示)

- 模特姿态调整(360°无死角展示)

部署指南与快速上手

环境配置步骤

# 1. 安装系统依赖

sudo apt update

sudo apt install ffmpeg

sudo apt install nvidia-cuda-toolkit

# 2. 创建Python虚拟环境

python -m venv krea_env

source krea_env/bin/activate

# 3. 克隆项目仓库

git clone https://gitcode.com/hf_mirrors/krea/krea-realtime-video

cd krea-realtime-video

# 4. 使用uv安装Python依赖

uv sync

# 5. 安装Flash Attention优化

uv pip install flash_attn --no-build-isolation

# 6. 下载模型文件

huggingface-cli download Wan-AI/Wan2.1-T2V-1.3B \

--local-dir-use-symlinks False \

--local-dir wan_models/Wan2.1-T2V-1.3B

huggingface-cli download krea/krea-realtime-video \

krea-realtime-video-14b.safetensors \

--local-dir-use-symlinks False \

--local-dir checkpoints/krea-realtime-video-14b.safetensors

启动推理服务器

export MODEL_FOLDER=Wan-AI

export CUDA_VISIBLE_DEVICES=0 # 指定使用的GPU

export DO_COMPILE=true # 启用编译优化

# 启动推理服务器

uvicorn release_server:app --host 0.0.0.0 --port 8000

服务器启动后,可通过浏览器访问http://localhost:8000/使用Web界面,或通过API接口调用模型生成视频。

Python API调用示例

import torch

from collections import deque

from diffusers import WanModularPipeline, PipelineState

pipe = WanModularPipeline.from_pretrained(

"krea/krealtime-video",

torch_dtype={"default": torch.bfloat16, "vae": torch.float16},

device_map="cuda"

)

# 初始化状态缓存

state = PipelineState()

state.set("frame_cache_context", deque(maxlen=16)) # 缓存16帧上下文

# 实时生成循环

prompt = "一只橘猫在秋天的枫树下追蝴蝶"

frames = []

for block_idx in range(9):

state = pipe(

state,

prompt=prompt,

num_inference_steps=4,

num_frames_per_block=3,

generator=torch.Generator("cuda").manual_seed(42),

)

frames.extend(state.values["videos"][0])

# 实时交互示例:第5块后修改提示词

if block_idx == 4:

prompt = "一只橘猫在秋天的枫树下追蝴蝶,突然开始下雪"

export_to_video(frames, "interactive_output.mp4", fps=16)

行业影响与未来趋势

Krea Realtime 14B的推出标志着文生视频技术进入交互式创作阶段。其技术路线证明大模型与实时性可以兼得,这一突破将推动三大变革:

创作流程重构

从"脚本-拍摄-剪辑"的线性流程,转向"实时生成-即时调整-一键输出"的非线性模式。

硬件需求升级

140亿参数模型的普及将加速数据中心对B200级GPU的部署,预计2026年AI视频生成专用服务器市场将增长200%。

内容形态创新

交互式视频将催生新内容形式,如"分支剧情实时生成"、"个性化教育视频"等。

未来展望:三大技术演进方向

多模态输入融合

未来版本将支持文本+语音+手势的混合控制,进一步降低创作门槛。

移动端实时生成

通过模型压缩技术,预计2026年实现旗舰手机端5fps生成速度。

行业垂类优化

针对医疗、工业等专业领域开发专用模型,如手术过程模拟、设备维护教程生成等。

结语

Krea Realtime 14B通过"大模型+实时性"的技术组合,重新定义了文本到视频的可能性边界。随着硬件成本下降和算法优化,我们正迈向"人人都是视频创作者"的新时代。对于企业而言,现在正是布局实时视频生成能力、重构内容生产链路的战略窗口期。

点赞+收藏+关注,获取更多AI视频生成技术前沿资讯!下期我们将带来Krea Realtime 14B与其他主流视频生成模型的实战对比测评,敬请期待!

【项目地址】https://gitcode.com/hf_mirrors/krea/krea-realtime-video

【免费下载链接】krea-realtime-video

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考