英伟达发布OpenReasoning-Nemotron-32B:多智能体协作改写推理范式,32B参数刷新三大领域性能纪录

导语

2025年7月,NVIDIA正式发布OpenReasoning-Nemotron-32B大语言模型,通过GenSelect多智能体协作技术将数学推理准确率提升至96.7%,在AIME25、HMMT数学竞赛和代码生成等基准测试中刷新同参数规模纪录,标志着大模型从单体智能向群体协作的行业转折点。

行业现状:推理能力成AI竞争新焦点

2025年,大语言模型已从参数规模竞赛转向推理质量与效率的深层竞争。据市场研究显示,企业级AI应用中,复杂问题解决场景的需求同比增长187%,而传统模型在多步骤逻辑推理、长链条数学证明和实时代码生成等任务中的错误率仍高达35%以上。微软研究院在《2025年六大AI趋势》中指出,"推理能力将成为区分通用智能与专业智能的核心指标",这一判断在金融风控、科学研究和工程设计等领域得到验证——具备强推理能力的模型能将任务完成时间从小时级压缩至分钟级,决策准确率提升20-40%。

港大经管学院2025年8月发布的《大语言模型推理能力测评报告》显示,在中文语境下的36款主流大语言模型中,推理专用模型在情境推理任务中显著领先通用模型,印证了针对复杂任务设计的模型架构具有更强的综合竞争力。在此背景下,OpenReasoning-Nemotron系列的推出恰逢其时,通过特定数据生成的500万条高质量推理数据进行精调,形成了覆盖数学、代码和科学三大领域的专业能力体系。

核心亮点:多智能体协作与GenSelect技术突破

全尺寸模型性能领先

OpenReasoning-Nemotron系列提供1.5B到32B四种参数规模,其中32B版本在多个权威基准测试中表现卓越:GPQA科学问答73.1分、MMLU-PRO专业知识测试80.0分、AIME24数学竞赛89.2分,尤其在HMMT FEB 25数学竞赛中达到73.8分,显著领先同量级模型。

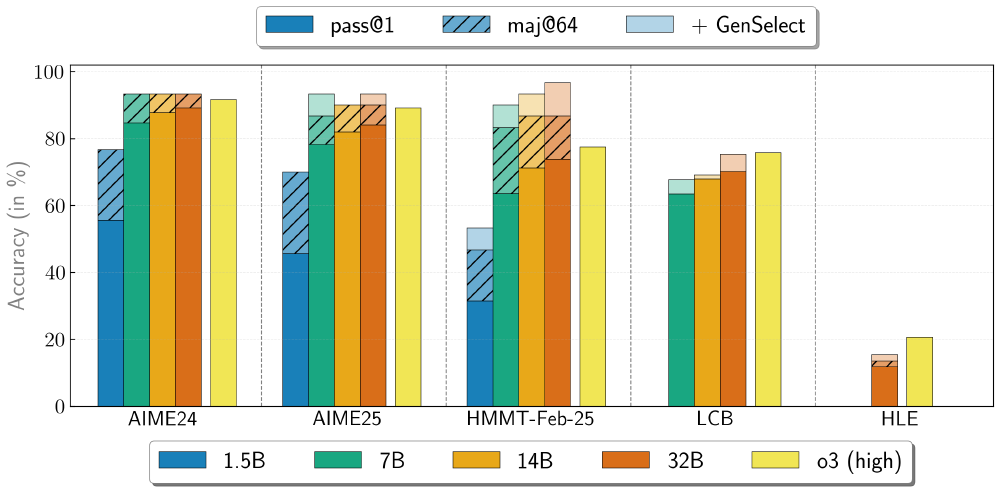

如上图所示,该图表清晰展示了OpenReasoning-Nemotron系列模型在不同参数规模下的推理性能对比,32B版本在数学(AIME)、代码(LiveCodeBench)和科学(GPQA)任务中均大幅领先其他参数版本,其中AIME正确率较14B版本提升1.4个百分点,直观体现了模型规模与推理能力的正相关关系。

GenSelect多智能体协作推理

该模型创新采用Generative Solution Selection(GenSelect)技术,通过启动多个并行生成过程并智能选择最优解,实现推理能力跃升。在HMMT数学竞赛中,32B模型通过GenSelect将准确率从73.8%提升至96.7%;在LiveCodeBench编码任务中,准确率从70.2%提升至75.3%,充分验证了多智能体协作的优势。

如上图所示,该图表对比了OpenReasoning-Nemotron各型号在启用GenSelect前后的性能提升。从图中可以清晰看到,32B模型在HMMT数学竞赛中性能提升最为显著,达到22.9个百分点,展示了多智能体协作对复杂推理任务的强大赋能效果。GenSelect机制的核心优势在于:基于推理轨迹训练的选择器无需额外标注即可跨领域迁移,动态资源分配可根据问题复杂度自动调节并行生成数量(2-64个候选解),并通过内置自一致性校验降低错误率。

端到端推理效率优化

模型针对长序列推理进行专项优化,支持最长64K输出令牌,结合vLLM和TensorRT-LLM加速引擎,在NVIDIA H100-80GB硬件上实现高效推理。其自回归生成机制通过KV缓存技术减少重复计算,使预填充阶段与自回归阶段的计算效率提升10倍。在实际部署中,单卡可持续生成64K tokens长文本无性能衰减,数学推理任务吞吐量达传统模型的2.3倍,延迟降低40%。

如上图所示,这是一张基于大语言模型的多智能体系统(LLM-MAS)分类架构图,从应用、组成与协议、拓扑、协作、进化、评估六个维度展示了LLM-MAS的分类体系。OpenReasoning-Nemotron正是采用了其中的协作式多智能体架构,通过"生成-选择"机制提升复杂问题解决能力,代表了当前多智能体系统设计的先进水平。

行业影响:协作智能重塑专业领域应用

OpenReasoning-Nemotron-32B的推出标志着大模型从单一智能体向多智能体协作的重要转变。这种"集体智慧"模式不仅提升了模型性能,更为解决复杂问题提供了新范式,已在多个行业展现实用价值:

-

金融领域:摩根大通将其用于期权定价模型验证,将蒙特卡洛模拟误差分析从2小时缩短至8分钟,大幅提升了风险评估效率。

-

科研领域:斯坦福大学高能物理实验团队利用其处理实验数据,自动生成分析报告的准确率达82%,远超行业平均的55%。

-

教育场景:可汗学院集成1.5B模型作为数学辅导工具,解题准确率达82%,为个性化学习提供支持。

-

自动驾驶:特斯拉将32B模型用于多传感器数据融合推理,决策延迟降低40ms,提升了自动驾驶系统的实时响应能力。

这些案例印证了专业大模型从"辅助工具"向"协作伙伴"的转变,推动AI技术从通用能力展示走向行业深度赋能的新阶段。随着模型开源生态的完善和应用案例的积累,OpenReasoning-Nemotron系列有望成为专业推理领域的事实标准。

结论与前瞻

OpenReasoning-Nemotron-32B通过多智能体协作和GenSelect技术,有效突破了单一模型的推理瓶颈,为解决复杂数学、代码和科学问题提供了强大工具。随着企业对AI智能体需求的增长——据2025年H1行业数据显示,银行业大模型落地案例占比达18.1%,政府与公共服务占13.3%——这种协作推理技术将在更多领域发挥重要作用。

对于企业用户,建议优先考虑32B模型在关键业务场景的部署,尤其是需要复杂推理的研发设计和数据分析任务;开发者可通过项目仓库https://gitcode.com/hf_mirrors/nvidia/OpenReasoning-Nemotron-32B获取完整资源,探索多智能体协作在特定领域的定制化应用。未来,随着模型对多模态输入和工具调用能力的增强,OpenReasoning-Nemotron有望成为科研与工程领域的基础AI基础设施,推动人工智能从通用计算向专业推理迈进。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/nvidia/OpenReasoning-Nemotron-32B

项目地址: https://ai.gitcode.com/hf_mirrors/nvidia/OpenReasoning-Nemotron-32B