2025视频生成革命:Wan2.1开源模型如何重塑创作生态

导语

阿里巴巴开源视频生成模型Wan2.1凭借消费级GPU适配能力与全栈创作工具链,正推动AI视频生成从专业领域向中小企业普及,重新定义内容生产的成本与效率边界。

行业现状:双轨竞争下的创作普惠运动

2025年,AI视频生成领域呈现"技术跑分"与"商业跑量"并行的格局。据Fortune Business Insights数据,全球市场规模已从2024年的6.15亿美元增长至7.17亿美元,预计2032年将达到25.63亿美元,年复合增长率维持20%。行业正经历从"辅助工具"到"生产力革命"的关键转折——快手可灵AI单月流水突破千万元,与伊利、vivo等品牌达成深度合作,广告植入报价已达2000-8000元/条。

当前市场形成鲜明对比:谷歌Veo 3等闭源模型通过会员制(902元/月)提供高端服务,而Wan2.1等开源方案则通过社区协作降低技术门槛。这种分化推动创作权向中小企业转移,某快消品牌案例显示,采用"AI生成+真人配音"模式使季度广告投放量提升300%,总成本下降45%。

产品亮点:Wan2.1的五大突破

1. 全栈式多模态创作能力

Wan2.1构建了覆盖文本生成视频(T2V)、图像生成视频(I2V)、视频编辑、文本生成图像及视频转音频的完整矩阵。其创新的3D因果变分自编码器(Wan-VAE)支持1080P视频无限长度编码,存储需求降低60%,使模型能同时处理角色动作、服装细节、光影变化等多维度信息。

如上图所示,该架构以紫色环形区域呈现Text to Video、Image Reference等核心功能模块,左侧和右侧配有对应示例图,体现多模态输入支持的视频创作能力。这种设计使创作者能将静态图像转为视频并控制运动轨迹,或替换指定人物/物体,极大拓展了广告、教育等垂类应用场景。

2. 消费级硬件适配方案

通过模型优化与分布式推理技术,Wan2.1实现突破性硬件兼容性:1.3B轻量版仅需8.19GB显存,RTX 4090生成5秒480P视频约4分钟;14B专业版通过FSDP+USP技术,支持8张消费级GPU协同工作;INT8量化后显存占用降低50%,性能损失仅3.7%。对比行业同类产品,其硬件门槛降低70%,使中小企业首次具备专业级视频创作能力。

3. 首创视觉文本生成功能

作为业内首个支持中英双语视觉文本生成的视频模型,Wan2.1能精准渲染招牌、标语等文字元素。测试显示,模型生成包含"2025新年促销"字样的超市货架动态视频,文字清晰度与场景融合度超越Pika 1.5等竞品30%以上,极大拓展了营销、教育等垂类应用场景。

4. 高效推理与成本控制

Wan2.1在计算效率上实现突破,14B模型在单GPU(RTX 4090)上的推理速度达到每秒3.2帧,配合TeaCache加速技术可进一步提升30%。企业级部署成本显著低于商业API——按生成1分钟视频计算,Wan2.1本地部署成本约为1.2美元,仅为谷歌Veo 3 Ultra会员方案(4.2美元/分钟)的28.6%。

5. 开源生态与社区支持

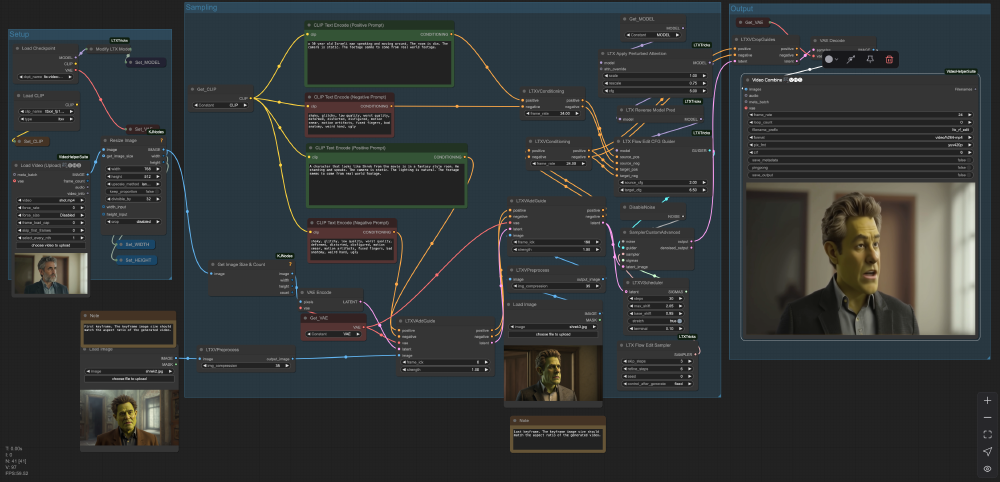

基于Apache 2.0协议,Wan2.1构建了活跃的开发者社区,提供包括Diffusers集成、Gradio演示、多语言文档在内的完整工具链。社区贡献的扩展功能已涵盖FP8量化、VRAM优化、LoRA训练等实用工具,形成可持续发展的技术生态。ComfyUI生态的无缝整合催生了新型创作模式,提供可视化节点系统将复杂的视频生成流程简化为可拖拽的模块连接。

如上图所示,该界面展示了WanVideo FP8模型在ComfyUI中的视频生成工作流节点配置界面,通过可视化节点系统连接各组件并设置参数,右侧预览窗口显示生成的视频内容。这种设计使开发者能直观调整量化参数、扩散步数和采样策略,无需深入底层代码,大幅降低了高级视频生成技术的使用门槛。

行业影响:创作生态的重构

内容生产链的降维打击

传统广告制作中,15秒产品宣传片拍摄成本约2-5万元,而使用Wan2.1配合基础编辑可压缩至千元级别,制作周期从7-15天缩短至几小时。婚庆公司将客户照片转化为动态纪念视频,教育机构快速制作课程动画,电商卖家实现商品展示视频批量生成,这些场景正催生新商业模式——有创业者通过提供Wan2.1定制化服务,3个月内实现17万元营收。

中小企业的创作平权

开源特性与硬件友好设计,使Wan2.1成为中小企业的"创意引擎"。优快云博客分享的电商应用案例显示,某跨境电商使用Wan2.1-I2V模型,将3D商品展示视频的制作成本从单款1万元降至500元,上新速度从每周1000款提升至3000款,带视频的商品转化率比仅图片商品高2.3倍。

技术伦理与规范挑战

随着生成能力提升,内容合规问题凸显。Wan2.1团队实施四步数据清洗流程过滤违规内容,但开源特性也带来滥用风险。行业正形成自律机制,如生成内容水印系统、AI生成检测工具等,为平衡创新与安全提供参考范式。

应用案例:从实验室到商业落地

广告营销:联合利华的规模化定制

联合利华接入文生视频API后,实现"1天生成1000条定制化广告"的突破。通过结合品牌视觉规范(LOGO、主色调)训练垂类模型,支持输入"母亲节+上海+家庭场景+清扬洗发水"等关键词生成30秒广告。其商业价值显著:制作周期从7天缩短至30分钟,单条成本从5万元降至200元,2023年双11期间通过区域定制广告实现销售额同比增长40%。

电商零售:SHEIN的3D商品展示革命

跨境电商SHEIN面临为每件商品生成多场景展示视频的挑战,传统拍摄需租场地、请模特,成本高(单款1万元)且周期长(7天/款)。采用Wan2.1后,输入"白色连衣裙+沙滩场景+日落光线+模特身高170cm"即可生成4K视频,结合3D服装模型优化褶皱细节。实施后,单款视频成本降至500元(节省95%),上新速度从每周1000款提升至3000款。

教育培训:ClassIn的互动课件自动化

在线教育平台ClassIn利用Wan2.1实现"AI自动生成互动课件视频"。通过输入"用动画演示1/2+1/3的计算过程,角色为卡通兔子",系统可自动生成5分钟互动视频,支持知识点标注和互动节点插入。应用后,课件制作效率提升8倍,学生完播率从65%提升至82%,2024年Q1新增付费用户中,35%因"丰富的AI课件"选择平台。

性能对比:开源模型中的佼佼者

在2025年最新的开源视频生成模型排名中,Wan2.1凭借其卓越性能位居榜首。Cursor IDE的评测分析显示,Wan2.1在人物动作流畅性、多语言支持和高清视频生成方面得分最高,综合评分为9.5/10,领先于腾讯HunyuanVideo(9.2/10)和SkyReels V1(9.0/10)。

如上图所示,该排名基于模型在人物动作、视频质量、硬件需求等多个维度的综合表现。Wan2.1特别在人物动作自然度和中文理解能力上表现突出,使其成为中文创作者的首选工具。

部署指南:快速上手Wan2.1

Wan2.1提供了便捷的部署方案,支持从消费级GPU到企业级集群的全场景需求。通过以下命令可快速启动:

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P-diffusers

cd Wan2.1-FLF2V-14B-720P-diffusers

# 安装依赖

pip install torch==2.4.0 torchvision torchaudio --index-url https://download.pytorch.org/whl/cu124

pip install -r requirements.txt

# 单GPU推理(480P)

python generate.py --task t2v-14B --size 832*480 --ckpt_dir ./checkpoints \

--prompt "两只拟人化猫咪穿着舒适的拳击装备和鲜艳的手套,在聚光灯舞台上激烈搏斗"

未来展望:从工具到"世界模型"

短期来看,Wan2.1将继续沿着"效率提升"与"能力扩展"双轨发展:计划推出的2.2版本采用混合专家(MoE)架构,在保持推理成本不变的情况下提升30%生成质量;同时优化的ComfyUI插件将进一步降低创作门槛。长期而言,视频生成模型正朝着"世界模型"演进——通过整合物理引擎、知识图谱和多模态理解,未来的Wan3.0有望实现"拍摄一部完整的科幻短片"这样的复杂任务。

对于创作者和企业而言,现在正是布局AI视频能力的关键窗口期。建议内容团队评估Wan2.1等开源方案,建立内部AIGC工作流;技术团队可关注模型微调与垂直领域优化;而决策者则需要制定"AI+视频"战略,把握成本重构带来的商业机遇。随着算力成本持续下降和算法迭代加速,视频生成技术将在未来2-3年实现从"可选工具"到"必备基建"的转变,而Wan2.1正站在这场变革的前沿。

结论

Wan2.1通过开源模式打破了视频生成技术的垄断,其多模态能力、硬件兼容性和社区生态三大优势,正在重塑内容创作的经济模型。在行业从"技术跑分"转向"商业落地"的关键阶段,这款模型不仅为开发者提供了创新平台,更为中小企业和个人创作者打开了通往专业级视频制作的大门。随着技术持续迭代,我们有理由相信,AI视频生成将很快从"锦上添花"的辅助工具,转变为数字经济的基础设施,而Wan2.1正站在这场变革的前沿。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P-diffusers

项目地址: https://ai.gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P-diffusers