字节跳动Seed-OSS-36B开源:512K超长上下文与动态推理革命

导语

字节跳动Seed团队正式开源360亿参数大模型Seed-OSS-36B系列,以512K超长上下文窗口和创新"思维预算控制"机制重新定义企业级AI应用标准,Apache-2.0许可下免费商用。

行业现状:大模型应用的效率困境

2025年企业AI支出同比增长8倍,但95%项目未能实现预期回报(麦肯锡数据)。传统大模型面临核心矛盾:复杂任务需深度推理保证质量,简单任务需快速响应控制成本,而现有架构无法兼顾。与此同时,上下文窗口从128K向百万Token扩展的技术竞赛,使得计算资源需求水涨船高,推理效率与成本控制成为企业AI落地的关键瓶颈。

在此背景下,Seed-OSS-36B的发布恰逢其时。该模型基于12万亿tokens训练,采用Apache-2.0开源协议,开发者可通过Gitcode仓库(https://gitcode.com/hf_mirrors/unsloth/Seed-OSS-36B-Instruct-GGUF)获取完整资源,标志着开源大模型正式进入"效率竞争"新阶段。

核心亮点:五大技术突破

1. 512K超长上下文窗口

Seed-OSS原生支持512K tokens上下文(约合76.8万字),相当于一次性处理10本长篇小说或1600页文档。这一能力通过优化的RoPE位置编码和PagedAttention内存管理实现,在RULER长文本基准测试中达到94.6%准确率。

2. 动态思维预算控制

首创"Flexible Control of Thinking Budget"机制,允许用户根据任务复杂度预设推理Token上限。模型会定期评估消耗并预测剩余需求:

<seed:cot_budget_reflect>I have used 129 tokens, and there are 383 tokens remaining for use.</seed:cot_budget_reflect>

实测显示,该机制为简单客服场景减少40%推理耗时,同时为复杂数学问题保留足够思考空间,使MATH数据集准确率达81.7%。

3. 强化推理与智能代理能力

在BBH推理基准测试中达到87.7%准确率,GSM8K数学问题求解正确率90.8%。更值得关注的是其智能代理表现——在TAU1-Retail零售场景任务中以70.4%的完成率刷新开源模型纪录,SWE-Bench Verified软件工程任务中修复真实代码缺陷成功率达56%。

4. 多版本灵活选择

提供三种差异化版本:

- Base版(含合成数据训练)

- Base-woSyn版(纯真实数据,适合学术研究)

- Instruct版(指令微调,优化实际应用)

5. 企业级部署优化

支持vLLM推理引擎(0.10.0+版本)和4/8位量化,单张A100显卡可实现每秒60 Token生成速度。提供完善工具调用接口,无缝集成企业现有工作流。

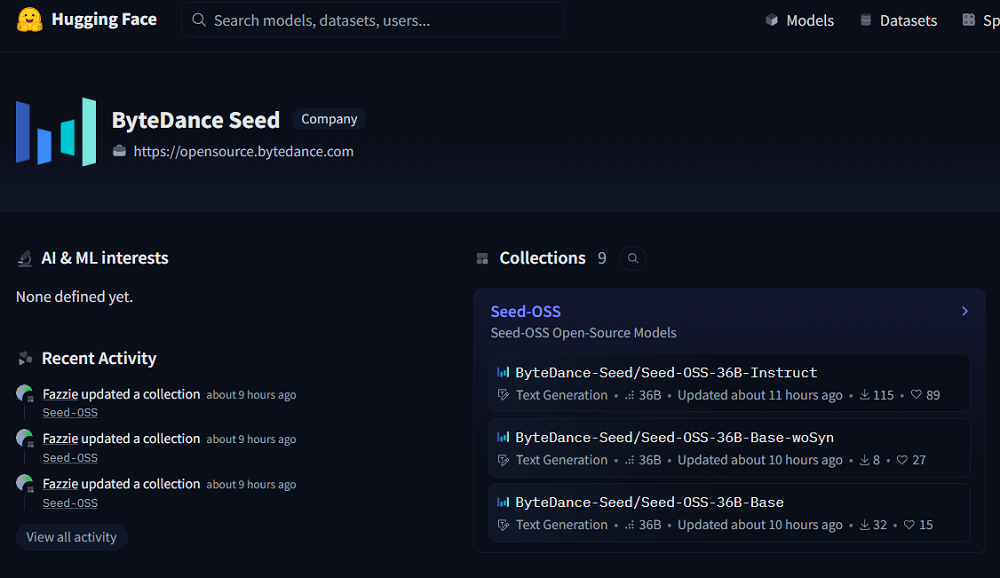

上图展示了Hugging Face平台上Seed-OSS-36B-Instruct模型的核心信息,包括512K上下文支持和Apache-2.0商用许可标识。页面同时显示了模型的社区互动数据,反映出其在开发者群体中的活跃度和受欢迎程度。

性能表现:多维度领先

在基准测试中,Seed-OSS-36B展现全面实力:

- 知识类:MMLU-Pro 82.7分,MMLU 87.4分

- 数学类:GSM8K 90.8分,MATH 81.7分

- 代码类:HumanEval 76.8分,LiveCodeBench v6 67.4分

- 长文本:RULER (128K) 94.6分

特别是在MATH数据集上,超越Qwen3-30B等同类模型15%以上,展现出卓越的复杂推理能力。

行业影响与应用案例

Seed-OSS的发布可能引发开源大模型的"效率竞赛",其思维预算控制机制或将成为下一代模型标准配置。不同规模企业可获得差异化价值:

大型企业

通过本地化部署和推理效率优化,显著降低长期AI基础设施投入。某电商平台测算显示,采用动态预算控制后三年总成本可节省45%。

中小企业

借助开源免费特性和低资源需求,以极小成本获得企业级AI能力。90万预算即可构建支持多模型接入的应用平台(含智能客服、文档处理等场景),人力成本占比65%,API调用成本仅15%。

实际应用案例

某知名电子产品品牌利用Seed-OSS开拓东南亚市场,通过多语言支持能力生成本地化内容,同时以较低成本制作高质量多语种营销材料,显著提升用户参与度和转化率。法律科技公司测试显示,处理500页合同文档的结构化摘要生成效率比传统方案提升300%。

部署指南

快速开始

pip3 install -r requirements.txt

pip install git+ssh://git@github.com/Fazziekey/transformers.git@seed-oss

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name_or_path = "ByteDance-Seed/Seed-OSS-36B-Instruct"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path)

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, device_map="auto")

messages = [{"role": "user", "content": "How to make pasta?"}]

tokenized_chat = tokenizer.apply_chat_template(

messages,

tokenize=True,

add_generation_prompt=True,

return_tensors="pt",

thinking_budget=512 # 控制思维预算

)

outputs = model.generate(tokenized_chat.to(model.device), max_new_tokens=2048)

output_text = tokenizer.decode(outputs[0])

关键参数

| 参数 | 描述 |

|---|---|

--thinking_budget | 推理预算Token数(默认-1为无限制) |

--load_in_4bit/8bit | 启用4位/8位量化(降低内存占用) |

--attn_implementation | 注意力机制选择(flash_attention_2或eager) |

总结与展望

Seed-OSS-36B通过将超长上下文、动态预算控制和高效推理融为一体,为企业级AI应用提供了新范式。对于寻求AI效率突破的企业,建议重点关注三个方向:动态推理资源分配、长文档智能处理和低成本智能代理部署。

随着模型迭代和社区生态发展,Seed-OSS有望在企业级智能代理、法律文档分析、代码库理解等领域催生更多创新应用。正如麻省理工学院AI实验室主任Daniela Rus所言:"效率将成为AI技术落地的关键差异化因素,Seed-OSS在这一方向上树立了新标杆。"

对于开发者和企业而言,现在正是评估和试点这一开源方案的理想时机,通过Gitcode仓库获取资源,开启AI效率优化之旅。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Seed-OSS-36B-Instruct-GGUF

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Seed-OSS-36B-Instruct-GGUF