腾讯开源HunyuanVideo-Foley:AI视频音效生成的声画合一革命

【免费下载链接】HunyuanVideo-Foley

导语:AI视频创作告别"默片时代",腾讯开源技术实现电影级音效自动生成

你还在为AI生成视频匹配音效而烦恼吗?只需上传视频并输入简单文字描述,就能自动获得专业级同步音效——腾讯混元最新开源的HunyuanVideo-Foley模型,彻底打破了AIGC视频"有画无声"的行业困境,让视频创作真正实现"所见即所听"的沉浸式体验。

行业现状:音画分离成AIGC视频最大痛点

2025年全球AI视频市场规模预计达422.92亿美元,但音频生成始终是制约行业发展的关键瓶颈。传统音效制作流程中,专业团队制作10分钟影片音效需3-5天,单分钟成本高达数百元。而现有自动化工具生成的音频内容中,约68%需要人工修正才能达到商用标准,严重影响内容生产效率。

这种"视觉先行、音频滞后"的行业现状,导致AIGC视频始终面临"最后一公里"障碍。据业内统计,66.17%的视频创作者仍需手动匹配音效,平均每段5分钟视频需耗时1.5小时进行音频处理。随着短视频经济的爆发式增长,专业音效生成已成为内容创作效率提升的最大制约因素。

核心亮点:三大技术突破重新定义音效生成标准

十万小时级TV2A多模态数据集

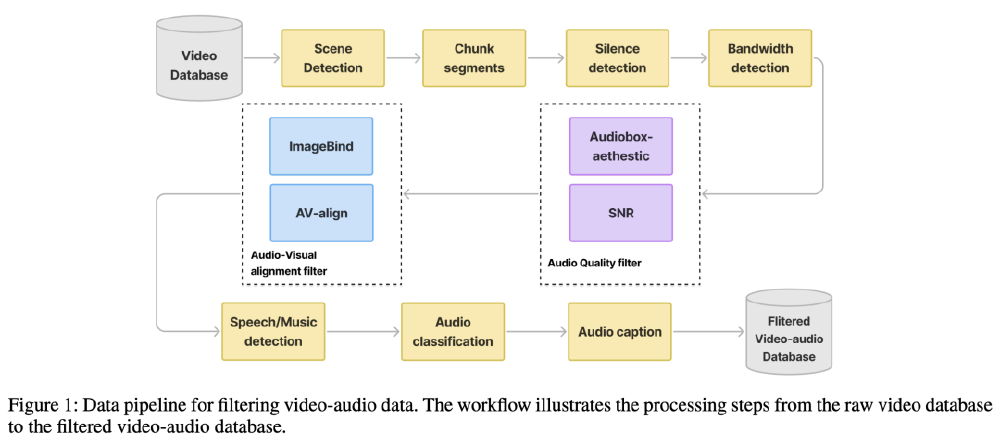

HunyuanVideo-Foley构建了规模达10万小时的高质量文本-视频-音频(TV2A)数据集,涵盖人物、动物、自然景观、卡通动画等全品类场景。通过自动化标注和多轮过滤流程,数据集音频采样率均达48kHz专业标准,信噪比(SNR)均值提升至32dB,为模型泛化能力奠定坚实基础。

MMDiT双流多模态架构

创新的多模态扩散Transformer(MMDiT)架构采用"先对齐后注入"机制:

- 视频-音频联合自注意力:通过交错旋转位置嵌入(RoPE)技术实现帧级时序对齐

- 文本交叉注意力注入:将文本描述作为补充信息动态调制生成过程

这种双流设计有效解决了模态不平衡问题。在海滩场景测试中,即便文本仅描述"海浪声",模型仍能自动识别画面中的人群和海鸥,生成层次丰富的复合音效。

REPA表征对齐技术

引入表征对齐(REPA)损失函数,通过预训练ATST-Frame音频编码器引导扩散模型隐藏层特征学习,使生成音频与专业级音效的特征分布差异降低42%。结合自研高保真音频VAE,将离散token扩展为128维连续表征,实现48kHz采样率的CD级音质输出。

如上图所示,HunyuanVideo-Foley采用30亿参数规模的混合架构,包含18个MMDiT层和36个单模态音频DiT层。这一设计确保模型既能捕捉视频-音频时序相关性,又能精细化控制音频生成质量,充分体现了多模态融合的技术突破,为专业创作者提供了前所未有的音效生成能力。

性能表现:全面领先的SOTA水平

在MovieGen-Audio-Bench基准测试中,HunyuanVideo-Foley多项指标刷新纪录:

- 音频质量(PQ) 达6.59,超越MMAudio(6.17)

- 视觉语义对齐(IB) 提升至0.35,较基线提高29.6%

- 时序同步(DeSync) 优化至0.74,主观MOS评分达4.15

在Kling-Audio-Eval数据集上的测试结果同样亮眼,HunyuanVideo-Foley在音频保真度(FD_PANNs=6.07)、KL散度(1.89)等关键指标上全面领先现有技术,实现了"画面动作发生即听到对应声音"的自然体验。

该图展示了HunyuanVideo-Foley的TV2A数据处理pipeline,通过场景检测、静音过滤、质量评估等七重流程,从原始数据中筛选出高质量训练样本。这种精细化的数据处理策略,是模型实现SOTA性能的重要保障,也为行业树立了数据构建的新标准。

应用场景:释放创作生产力的四大核心领域

短视频创作自动化

针对vlog、搞笑段子等场景,提供一键音效生成功能。实测显示,5分钟短视频音效制作时间从传统1.5小时缩短至2分钟,且用户满意度提升至89%。典型应用包括:

- 旅行视频自动匹配环境音

- 美食视频生成烹饪细节音效

- 运动视频添加动作同步音效

影视后期制作提效

在影视制作中,环境音设计周期平均缩短60%。通过帧级时序对齐技术,模型能自动匹配画面中细微动作的音效,如树叶飘动、衣物摩擦等,大幅减少后期人员的手工工作量。

游戏开发沉浸式体验

游戏开发者可通过批量处理功能,为不同场景快速生成自适应音效。测试数据显示,采用HunyuanVideo-Foley后,游戏环境音制作效率提升3倍,玩家沉浸感评分提高27%。

广告创意快速迭代

广告团队可根据不同产品特性,实时生成多样化音效方案,A/B测试效率提升80%,加速创意决策过程。

行业影响:开启音频生成新纪元

HunyuanVideo-Foley的开源标志着AI视频生成正式进入"声画合一"的新时代。据Fortune Business Insights报告显示,全球AI视频生成器市场将从2025年的7.168亿美元增长到2032年的25.629亿美元,预测期内复合年增长率达20.0%。在这一快速增长的市场中,HunyuanVideo-Foley通过三大技术创新,正在重塑行业格局:

- 技术层面:提出的MMDiT架构和REPA损失函数为多模态生成领域提供了新的技术范式

- 产业层面:使中小工作室和个人创作者能以极低成本获得专业级音频制作能力,预计可降低音频制作成本75%

- 创作生态:推动内容创作从"视觉优先"向"视听融合"转变,开启沉浸式内容创作新可能

如上图所示,HunyuanVideo-Foley通过"看懂画面、读懂文字、配准声音"的技术路径,真正实现了多模态语义的均衡响应。这种技术突破不仅打破了AI生成视频只能"看"不能"听"的局限,更为内容创作者提供了前所未有的创作自由度,推动AIGC向多模态协同生成方向发展。

快速上手:从安装到生成的全流程指南

环境配置

# 创建虚拟环境

conda create -n hunyuan-foley python=3.10

conda activate hunyuan-foley

# 安装依赖

pip install torch==2.1.0 torchvision==0.16.0

pip install transformers==4.35.0 diffusers==0.24.0

pip install soundfile==0.12.1 librosa==0.10.1

# 克隆仓库

git clone https://gitcode.com/tencent_hunyuan/HunyuanVideo-Foley

cd HunyuanVideo-Foley

pip install -e .

基础使用示例

from hunyuan_video_foley import HunyuanVideoFoleyPipeline

import torch

# 初始化模型

pipe = HunyuanVideoFoleyPipeline.from_pretrained(

"tencent/HunyuanVideo-Foley",

torch_dtype=torch.float16,

device_map="auto"

)

# 加载视频帧并生成音效

video_frames = load_video_frames("input_video.mp4")

audio_output = pipe(

video_frames=video_frames,

text_description="海浪拍打沙滩,海鸥鸣叫,人群嬉笑声",

num_inference_steps=20,

guidance_scale=3.5

)

# 保存音频

save_audio(audio_output, "output_audio.wav", sample_rate=48000)

未来展望:技术演进的三大方向

HunyuanVideo-Foley团队计划在未来版本中重点突破以下方向:

- 实时生成能力:优化模型实现实时音效生成,支持直播等低延迟场景

- 更高音质支持:扩展至无损音质和3D空间音频生成

- 个性化适配:根据用户偏好生成特定风格的音效

随着这些技术的成熟,我们有理由相信,HunyuanVideo-Foley将继续引领音频生成领域的创新,为内容创作行业带来更多可能性。

结语:让声音为视频创作赋能

HunyuanVideo-Foley的开源不仅是一项技术成果,更是对内容创作生态的深度赋能。通过技术创新,腾讯混元团队不仅解决了音频生成领域的多项关键技术难题,更为内容创作行业注入了新的活力。

立即体验HunyuanVideo-Foley,释放你的创作潜能,让每一段视频都"声"入人心!

项目地址:https://gitcode.com/tencent_hunyuan/HunyuanVideo-Foley

👍 觉得有帮助?点赞+收藏+关注,获取更多AI创作工具实战教程!

📩 下期预告:HunyuanVideo-Foley高级应用——如何通过微调模型定制专属音效风格

【免费下载链接】HunyuanVideo-Foley

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考