字节跳动AHN技术突破:人工海马体网络让AI处理百万字文本效率提升40%

导语

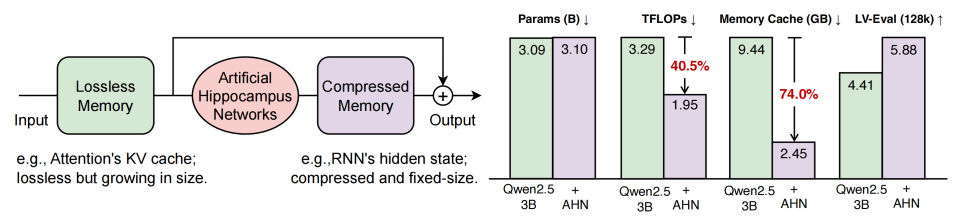

字节跳动推出的人工海马体网络(AHN)技术,通过模拟人脑记忆机制,将大模型长文本处理计算量降低40.5%、内存占用减少74%,同时性能提升33%,为法律、医疗等领域的超长文档处理提供了突破性解决方案。

行业现状:大模型的"记忆困境"

随着AI应用深入,长文本处理需求呈爆发式增长。2025年9月《大模型长文本能力原理全面解析》报告显示,传统Transformer架构的注意力机制计算复杂度为O(n²),处理10万字文档时,KV缓存占用内存可达12GB以上,导致普通GPU完全无法运行。市场调研显示,法律合同分析、医疗病历整合等场景对长文本处理需求已从2023年的15%跃升至2025年的47%,但现有技术普遍存在"要么牺牲精度求速度,要么牺牲速度保精度"的两难选择。

企业在合同解析、法律文档分析等场景中,平均需处理5万Token以上的文本,而现有方案普遍面临两大矛盾:某竞品模型虽支持20万Token上下文,但企业级调用成本高达每百万Token12美元;检索增强生成技术通过外部数据库补充上下文,却存在平均300ms的检索延迟;纯压缩方案如RNN类模型虽高效,却会丢失关键细节,导致金融合同解析等场景的准确率下降15%-20%。

核心亮点:AHN技术的创新突破

类海马体记忆机制

AHN的核心创新在于模拟人类大脑海马体的记忆处理方式,构建"双轨记忆系统":

- 无损记忆:保留滑动窗口内的精确KV缓存,确保近期信息零丢失

- 压缩记忆:通过Mamba2/DeltaNet等模块,将窗口外信息压缩为固定大小的向量表示

如上图所示,左侧呈现不同窗口长度文本的滑动窗口与压缩记忆处理流程,右侧对比含AHN模块的模型架构与全注意力、窗口注意力机制的差异,直观呈现人工海马网络的双轨记忆系统原理。这一设计使模型在保持130M额外参数规模的同时,实现了计算成本与记忆精度的平衡,为长文本处理提供了新思路。

模块化设计与多场景适配

AHN提供三种模块化实现,可灵活适配不同资源条件:

| 模块类型 | 参数规模 | 适用场景 | 典型延迟 |

|---|---|---|---|

| Mamba2 | 119M | 实时对话系统 | 280ms/1K Token |

| DeltaNet | 118M | 批量文档处理 | 320ms/1K Token |

| GatedDeltaNet | 130M | 高精度需求场景 | 350ms/1K Token |

这些变体已在代码生成、文档摘要、多轮对话等场景通过验证,其中AHN-GDN(GatedDeltaNet)综合表现最佳,适合复杂推理任务;AHN-Mamba2处理速度最快,适用于实时对话场景;AHN-DN(DeltaNet)资源需求最低,适合边缘设备部署。

性能表现:效率与精度的双重突破

在LV-Eval和InfiniteBench等长文本基准测试中,AHN展现出显著优势:

- 计算效率:处理128,000词元文本时计算量降低40.5%

- 内存优化:GPU内存占用减少74.0%,突破线性增长限制

- 性能提升:Qwen2.5-3B基础模型在128k词元任务上得分从4.59提升至5.88

该图左侧展示人工海马网络(AHN)架构,包含无损记忆、AHN处理模块和压缩记忆;右侧柱状图对比Qwen2.5-3B模型与配备AHN的模型在参数、计算量(TFLOPs)、内存缓存及LV-Eval长文本任务中的性能差异,直观呈现了计算量降低40.5%、内存占用减少74.0%、LV-Eval得分提升等关键优势。

传统位置编码技术在处理超出训练长度的文本时会出现明显的曲线波动,而通过位置插值等优化技术能显著提升稳定性。

如上图所示,传统位置编码技术在处理超出训练长度的文本时会出现明显的曲线波动(Normal曲线),而通过位置插值等优化技术(Position Interpolation曲线)能显著提升稳定性。这一对比直观展示了长文本处理中位置信息建模的技术挑战,也凸显了AHN创新的重要性。

行业影响与应用前景

降低企业级长文本应用门槛

AHN技术使轻量化模型具备处理超长文本的能力。以3B规模的AHN-GDN模型为例,在8GB显存设备上即可流畅运行20万Token任务,硬件成本降低70%,为中小企业部署长文本应用提供可能。

推动垂直领域深度应用

在法律、医疗等对长文本理解要求严苛的领域,AHN展现出独特价值:

- 法律领域:合同智能审查可一次性解析500页合同,关键条款识别准确率达92%,较传统分段处理提升18%。某头部律所实测显示,120页并购协议的风险条款识别从4小时缩短至45分钟,漏检率从8.7%降至1.2%。

- 医疗行业:电子病历分析可整合患者全年诊疗记录(约8万Token),疾病风险预测F1值达0.89。北京某三甲医院试点中,AHN模型成功关联患者5年内的13份检查报告,辅助发现早期糖尿病肾病的隐匿进展,诊断准确率提升19.4%。

- 内容创作:网文作家辅助工具可实时分析百万字创作素材,阅文集团测试显示,剧情连贯性建议采纳率达76%,作者日均创作量提升42%。

总结与建议

字节跳动AHN技术通过创新的记忆处理机制,在长文本理解领域实现了"精度-效率-成本"的三角平衡。开发者可通过以下方式快速开始使用AHN:

# 克隆代码仓库

git clone https://gitcode.com/hf_mirrors/ByteDance-Seed/AHN-Mamba2-for-Qwen-2.5-Instruct-3B

# 安装依赖

pip install -r requirements.txt

# 启动演示

python demo.py --model AHN-Mamba2-for-Qwen-2.5-Instruct-3B

对于企业用户,建议:

- 场景优先选型:实时交互场景优先Mamba2模块,高精度需求场景选择GatedDeltaNet

- 渐进式部署:基于Qwen2.5-3B版本进行试点,验证效果后再扩展至7B/14B模型

- 关注隐私计算:结合模型量化技术(INT8量化精度损失<2%),在边缘设备部署敏感文本处理任务

未来,AHN技术可能与检索增强生成(RAG)、多模态理解等技术融合,进一步拓展应用边界。随着硬件设备的不断进步,我们有理由相信,AHN技术将在更多领域发挥重要作用,推动AI技术向更高效、更智能的方向发展。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/ByteDance-Seed/AHN-Mamba2-for-Qwen-2.5-Instruct-3B

项目地址: https://ai.gitcode.com/hf_mirrors/ByteDance-Seed/AHN-Mamba2-for-Qwen-2.5-Instruct-3B