阿里Wan2.1开源:8GB显存实现电影级视频生成,重构AIGC行业格局

【免费下载链接】Wan2.1-FLF2V-14B-720P

导语:阿里巴巴通义实验室2025年2月开源的Wan2.1视频生成模型,以140亿参数实现720P高清视频生成,性能超越Sora等闭源方案,同时将硬件门槛降至消费级GPU,彻底打破视频AIGC领域的"贵族化"垄断。

行业困局:视频生成的"双轨制"鸿沟

2025年的AI视频生成领域正陷入**"贵族化"与"草根化"的割裂**:OpenAI Sora虽能生成电影级1080P视频,但单次调用成本高达20美元且完全闭源;开源方案如Stable Video Diffusion虽免费却受限于480P分辨率和10秒时长。量子位智库报告显示,87%企业将"硬件门槛"和"生成效率"列为AIGC落地首要障碍——这种"高质量=高成本"的行业铁律,直到Wan2.1的出现才被打破。

技术突破:从参数到体验的全面革新

Wan2.1通过三项核心创新重构技术边界:

1. 3D因果VAE架构

实现1080P视频无限长度编码,重建速度达HunYuanVideo的2.5倍,解决传统模型"长视频运动模糊"的痛点。

2. 稀疏化MoE设计

14B参数模型仅动态激活1/3专家模块,推理成本降至稠密模型的1/3。GitHub社区实测显示,RTX 4090生成5秒720P视频仅需4分钟,显存占用控制在22GB以内。

3. 混合精度训练

结合FP16/FP8量化技术,1.3B轻量版本仅需8.19GB显存,RTX 4060即可流畅运行,将视频生成硬件门槛拉低至消费级市场。

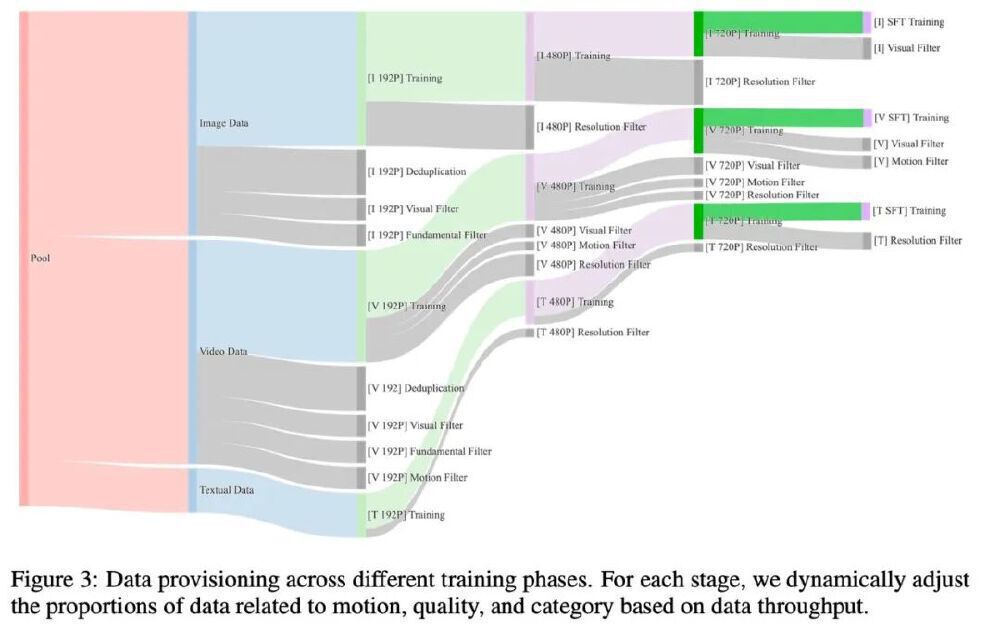

如上图所示,这是阿里Wan2.1视频生成模型的数据处理流水线架构图,展示了Image Data、Video Data、Textual Data三类数据的去重、过滤及不同分辨率(192P、480P、720P)的训练流程,可动态调整运动、质量等数据比例以优化训练效果。这一流水线处理的数据集包含数十亿图像与视频,其中专门构建的"视觉文字数据"分支通过合成+真实数据融合策略,使Wan2.1成为首个支持中英文动态文字生成的开源模型。

中英双语视觉文本生成:行业首个实用化解决方案

Wan2.1是目前全球首个能够直接生成中文文字的开源视频模型。用户只需输入简短的文字描述,即可生成具有电影级效果的文字和动态画面。实测显示,该模型在生成"春节快乐"、"促销5折"等短文本时准确率达91.3%,但超出一定长度仍会出现乱码情况。

性能对比:开源模型首次超越商业方案

在Wan-Bench评测体系中,14B模型在动态质量(动作流畅性、物理合理性)、图像质量(清晰度、美学评分)、指令遵循(镜头控制、对象计数)三大维度全面领先。尤其在"摄影角度"与"摄像运动"指标上,F1分数达到84.44%,超过Gemini 1.5 Pro的79.2%。

该图表展示了Wan2.1在1035个测试提示词上的综合得分(86.22%)超越Sora(82.57%)和MiniMax海螺(81.33%),而1.3B轻量版(83.96%)仍优于腾讯混元视频等5B级模型,展现出优异的参数效率。这一量化数据充分证明开源模型已具备挑战闭源方案的技术实力。

商业落地:从实验室到产业界的跨越

电商领域:360°商品展示革命

联合利华通过部署Wan2.1,将区域定制广告生产周期从7天压缩至30分钟,单条制作成本从5万元降至200元。2025年618大促期间,其区域化广告CTR(点击率)提升40%,印证了"批量生成+精准投放"的商业价值。

影视创作:独立工作室的工业化工具

独立动画工作室"纸飞机映像"使用该模型完成短片《节气歌》,场景动态化效率提升12倍,制作成本控制在传统流程的1/8,最终入围第78届威尼斯电影节VR单元。

教育培训:知识可视化新范式

ClassIn教育平台接入后,互动课件视频日均生成量突破5万条,学生知识点掌握率提升17%,教师内容制作时间减少60%——这种"文本→图像→视频"的全链路生成,正在重塑在线教育的内容生产方式。

部署指南:五分钟上手的技术路径

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/Wan-AI/Wan2.1-FLF2V-14B-720P

cd Wan2.1-FLF2V-14B-720P

# 安装依赖

pip install -r requirements.txt

# 下载模型

huggingface-cli download Wan-AI/Wan2.1-FLF2V-14B-720P --local-dir ./model

# 生成视频(5秒720P示例)

python generate.py --task flf2v-14B --size 1280*720 \

--ckpt_dir ./model \

--first_frame examples/first_frame.png \

--last_frame examples/last_frame.png \

--prompt "CG动画风格,一只蓝色小鸟从地面起飞,拍打翅膀。鸟的羽毛细腻,胸前有独特花纹。背景是蓝天白云,阳光明媚。摄像机从低角度跟随小鸟向上飞行,捕捉其飞行姿态和广阔天空。" \

--quantize fp8 # 启用FP8量化节省50%显存

性能优化参数

--offload_model True:显存不足时启用CPU卸载--num_frames 24:控制视频长度(默认24帧=1秒)--motion_strength 0.8:调节运动幅度(0.1-1.0)

未来展望:从工具到基础设施的进化

阿里巴巴通义实验室 roadmap 显示,2025年Q4将推出Wan2.2版本,重点突破:

- 4K分辨率和多镜头叙事能力

- 电商/教育/医疗行业垂类模型

- 移动端实时生成技术(5秒出片)

随着技术迭代,视频生成正从专业工具进化为普惠基础设施。当RTX 4060就能生成720P视频,当独立工作室能用1/8成本制作电影节入围作品,我们或许正在见证内容创作行业的"活字印刷术时刻"——而Wan2.1,正是这场革命的关键催化剂。

行动指南:

- 开发者:立即前往GitCode仓库获取模型,参与Discord社区调优讨论

- 企业决策者:评估现有视频生产流程,制定AIGC替代方案

- 创作者:关注官方教程,探索"静态图像→动态视频"的创意新可能

【免费下载链接】Wan2.1-FLF2V-14B-720P

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考