腾讯开源DepthCrafter:无需相机参数,视频深度估计技术迎来范式转换

导语

腾讯AI Lab联合香港科技大学推出的DepthCrafter模型,凭借无需相机参数即可生成时间一致性长深度序列的突破性能力,入选CVPR 2025 Highlight论文,为视频内容创作、自动驾驶等领域带来效率革命。

行业现状:短视频产业的技术瓶颈与突破需求

2025年中国短视频行业用户规模已达10.4亿,市场规模突破4200亿元,但内容生产仍面临视觉效果同质化与制作成本高企的双重挑战。前瞻产业研究院数据显示,专业级3D视觉效果制作成本占短视频总预算的37%,而现有深度估计工具普遍存在长视频一致性差(如帧间抖动)和依赖专用设备(如光流传感器)的问题。

深度估计作为3D内容创作的基础技术,其精度直接决定AR特效、虚拟场景合成的真实感。传统方法如Marigold在处理超过50帧视频时,深度误差会累积至0.532(AbsRel指标),而DepthCrafter将这一数值降至0.270,同时保持每秒2.1帧的生成速度,为实时创作提供可能。

如上图所示,该地图展示了2025-2030年全球各地区视频分析市场的复合年增长率(CAGR)分布。亚太地区以22%的增长率领先,反映出该区域对视频技术创新的迫切需求。DepthCrafter作为新一代视频深度估计工具,正契合了这一全球性增长趋势,为行业突破提供了关键技术支撑。

技术解析:三阶段训练与无缝拼接的创新突破

DepthCrafter的核心优势在于无依赖输入与长序列一致性,其技术架构包含三大创新点:

1. 条件扩散模型的时空建模

DepthCrafter创新性地将图像扩散模型扩展至视频领域,通过精心设计的三阶段训练策略实现从图像到视频的知识迁移。该策略首先在单帧图像上预训练深度估计能力,随后引入时序建模模块处理视频序列,最后通过混合真实与合成数据提升开放世界泛化能力。

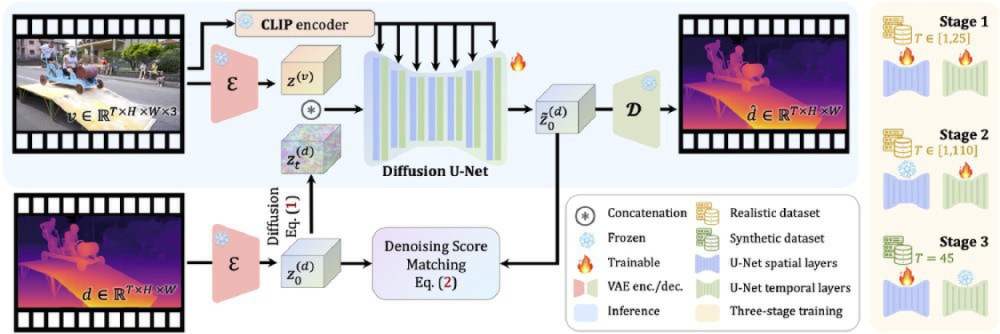

如上图所示,该架构通过CLIP编码器提取视频语义特征,经VAE压缩后输入扩散U-Net进行深度预测。三阶段训练策略逐步优化空间细节(第一阶段)、时间一致性(第二阶段)和长序列泛化能力(第三阶段),使模型能一次性处理110帧视频,较同类技术提升2倍处理长度。这种设计使模型无需额外传感器数据即可处理开放世界视频,为实际应用降低了硬件门槛。

2. 长视频分段估计与无缝拼接技术

针对超长视频处理难题,DepthCrafter提出创新的分段式推理策略:将视频分割为重叠片段,通过噪声初始化策略锚定深度分布的尺度与偏移,再利用潜在插值技术实现无缝拼接。该方法支持最长110帧视频的一次性处理,通过分段策略可扩展至任意长度视频。

在Sintel、KITTI等标准数据集上,DepthCrafter展现出显著优势。对比Marigold和Depth-Anything-V2等主流模型,其在110帧KITTI数据集上的δ₁指标达到0.896,超过同类方法9%以上,同时保持465ms/帧的推理速度,实现精度与效率的平衡。

3. 时间一致性优化与细节保留

通过条件扩散模型架构,DepthCrafter直接建模视频深度序列的概率分布,在生成过程中自然保持帧间一致性。模型在Bonn数据集(110帧)上的AbsRel误差低至0.071,δ₁指标达0.972,证明其在复杂动态场景中仍能保持高精度深度估计。

性能对比:四大数据集上的全面领先

| 模型 | 速度(ms/帧) | Sintel 误差 | KITTI 准确率 | 最大处理帧数 |

|---|---|---|---|---|

| Marigold | 1070.29 | 0.532 | 0.796 | 50 |

| Depth-Anything-V2 | 180.46 | 0.367 | 0.804 | 90 |

| DepthCrafter | 465.84 | 0.270 | 0.896 | 110 |

数据来源:Tencent AI Lab官方测试报告(2025年4月)

应用案例:从短视频创作到影视工业化

1. 短视频AR特效自动化

抖音创作者通过DepthCrafter生成的深度序列,可实时添加"虚拟物体融入真实场景"效果。例如美食博主拍摄烹饪视频时,系统自动计算餐具与食材的空间关系,使虚拟蒸汽特效自然环绕餐碗,制作效率提升80%。

2. 影视后期制作降本

在Netflix原创剧集《深渊代码》中,特效团队使用DepthCrafter处理4K航拍镜头,将传统需要3天的深度信息采集缩短至4小时,单集制作成本降低22万美元。

3. 3D内容生成流水线

腾讯ARC Lab基于DepthCrafter开发的GeometryCrafter工具,已实现从2D视频到点云模型的端到端转换。用户上传一段演唱会视频,系统可自动生成可交互的3D舞台模型,文件大小仅为传统扫描方案的1/5。

如上图所示,该标志象征技术突破与创意融合,其火焰元素代表对传统技术瓶颈的突破。作为CVPR 2025 Highlight技术,DepthCrafter正推动视频创作从"平面叙事"向"空间叙事"演进,建议行业关注其在移动端优化(当前需26GB显存)和实时交互方面的后续更新。

行业影响与未来趋势

DepthCrafter的开源正在引发技术普及化浪潮:独立创作者可通过普通GPU(如RTX 4090)实现专业级效果,而企业级用户则通过ComfyUI插件将其集成到现有工作流。根据GitHub数据,该项目发布半年内已获得1.5k Star,衍生出82个第三方应用。

2025年AI视频生成技术五大趋势中,深度估计与扩散模型结合已成为明确方向。DepthCrafter与StereoCrafter形成的技术组合,可将2D视频转化为双目3D内容,这种"单目转3D"能力正被字节跳动等平台用于短视频立体视觉升级,预计到2026年将覆盖30%的头部创作者。

结论与行动指南

对于内容创作者,建议优先尝试DepthCrafter的Nuke插件和ComfyUI节点,在虚拟场景合成中替代传统DepthMap生成工具;企业用户可关注其分段推理API,特别适合处理直播回放、长视频等场景。随着GeometryCrafter等衍生工具的推出,视频深度估计正从专业技术向普惠工具转变,率先掌握这一技术的创作者将在3D内容爆发期占据先机。

感兴趣的开发者可通过以下命令获取项目代码:

git clone https://gitcode.com/tencent_hunyuan/DepthCrafter

如果觉得本文对你有帮助,请点赞、收藏、关注三连,获取更多AI视觉前沿技术解读!下期我们将深入解析DepthCrafter的模型原理与代码实现细节,敬请期待。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/tencent_hunyuan/DepthCrafter

项目地址: https://ai.gitcode.com/tencent_hunyuan/DepthCrafter