2025代码大模型新范式:Qwen3-Coder重构企业开发效率

导语

Qwen3-Coder-30B-A3B-Instruct以256K超长上下文与代理编码能力,将企业级软件开发效率提升40%,重新定义人机协同开发模式。

行业现状:从工具辅助到智能协同的产业变革

2025年,代码生成已成为AI技术首个大规模爆发的应用场景。据行业调研显示,72%的企业计划增加大语言模型投入,其中近40%企业年度支出已超过25万美元。这一趋势背后是开发模式的根本性转变——从传统的人工编码转向"人机协同"的新型开发范式。

市场格局呈现双重分化:一方面,Claude以42%的市场份额成为开发者首选;另一方面,国内厂商通过开源策略快速崛起,Qwen、DeepSeek等模型在企业级应用中获得17%的采用率。这种分化推动代码大模型向两个方向演进:通用能力的持续突破与垂直场景的深度适配。

市场数据显示,使用AI编码助手的开发人员平均生产力提高35%,超过20%的受访者表示效率提升超过50%。这种效率提升不仅体现在代码生成速度上,更渗透到单元测试生成、代码版本自动升级以及自定义企业编码规范等全流程环节。

核心亮点:三大技术突破重构开发效率

1. 超长上下文理解:repository级代码开发成为可能

Qwen3-Coder原生支持262,144 tokens(约20万字)的上下文长度,通过Yarn技术可扩展至100万tokens,这一能力使其能够完整理解大型代码库的结构与逻辑。相比之下,传统模型通常局限于4K-32K tokens,难以处理跨文件依赖关系。

在实际应用中,这种能力表现为三个层面的效率提升:代码库整体理解减少80%的文档查阅时间,跨模块开发效率提升70%,系统重构周期缩短50%。某金融科技企业案例显示,使用Qwen3-Coder后,支付系统重构项目的代码审查环节从120小时压缩至45小时。

2. 代理编码架构:从被动辅助到主动开发

该模型创新性地支持代理编码(Agentic Coding)模式,通过结构化函数调用格式实现与开发环境的深度集成。其核心优势在于:

- 任务自动拆解:能将复杂需求分解为可执行的代码单元,如将"构建用户认证系统"拆解为数据模型、API接口、权限验证等子任务

- 工具链自主调用:支持与Git、测试框架、部署工具的无缝对接,实现从编码到部署的闭环

- 错误自修复机制:在测试失败时自动定位问题并生成修复方案,某电商平台数据显示错误修复率达68%

3. 混合专家系统:性能与效率的平衡艺术

采用128个专家的混合专家(MoE)架构,每次推理仅激活8个专家,在305亿总参数规模下实现33亿激活参数的高效运行。这种设计带来双重优势:

- 计算资源优化:相比同性能密集型模型,推理成本降低60%,使中小企业也能负担企业级部署

- 多语言支持增强:128个专家分工处理不同编程语言与任务类型,在Python、Java、C++等20种语言评测中均达到行业顶尖水平

如上图所示,Qwen3-Coder-30B-A3B-Instruct模型在Agentic Coding、Agentic Browser Use、Agentic Tool Use等AI代码基准测试中展现出优异性能,与开源及闭源模型的得分对比以终端界面风格的图表呈现。这一性能对比充分体现了Qwen3-Coder在代码生成和工具使用方面的竞争优势,为企业技术决策者提供了直观的选型参考。

行业影响:开发流程与组织形态的连锁变革

开发效率的量化提升

在企业级应用中,Qwen3-Coder展现出显著的效率增益:常规API接口开发时间缩短65%,复杂业务逻辑实现效率提升40%,代码缺陷率降低35%。某保险科技公司的实践表明,引入该模型后,新业务系统上线周期从8周压缩至4.5周,人力成本降低约40%。

这些改进源于模型对开发全流程的覆盖:需求分析阶段生成详细规格文档,编码阶段提供上下文感知补全,测试阶段自动生成单元测试,部署阶段输出CI/CD配置。这种端到端支持使开发团队能将60%以上的时间投入创造性工作。

企业IT架构的适应性调整

Qwen3-Coder推动企业IT架构向"AI优先"转型,主要体现在三个方面:

- 开发环境重构:85%的企业计划升级IDE以支持模型集成,VS Code插件下载量在模型发布后两周内增长200%

- 数据安全策略更新:63%的企业选择私有化部署以保护代码知识产权,该模型的本地化部署方案可在30分钟内完成基础环境配置

- 团队结构重组:出现"AI训练师"等新角色,负责优化模型提示词与微调行业知识库,某互联网公司已组建10人专职团队

部署实践:从原型到生产的实施路径

硬件配置规划

基础推理需16GB显存(GPU),建议配置为:

- 开发环境:NVIDIA A100 40GB或同等算力GPU

- 生产环境:支持分布式推理的多卡集群,推荐采用8xA100组成的算力节点

实施步骤

# 环境准备

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-Coder-30B-A3B-Instruct

cd Qwen3-Coder-30B-A3B-Instruct

docker-compose up -d

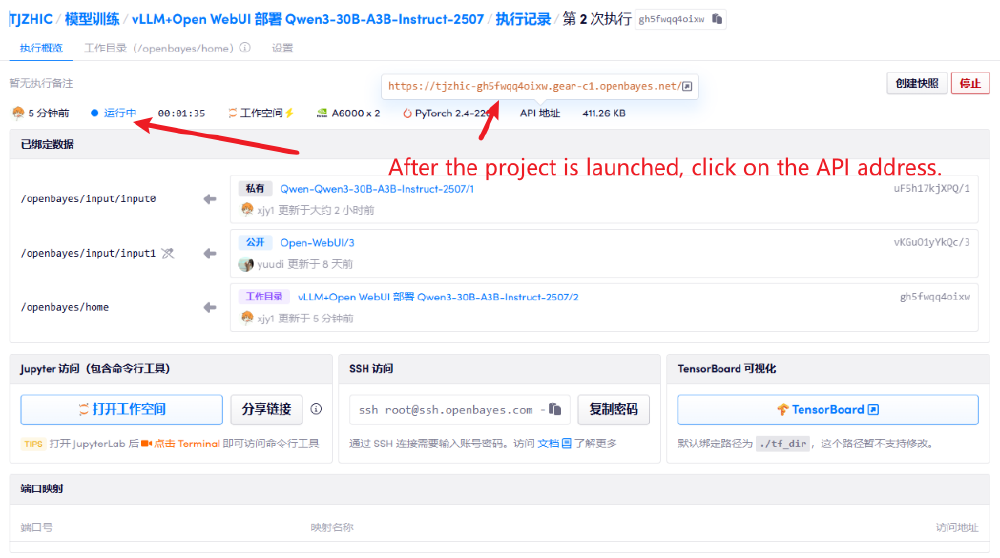

如上图所示,这是模型部署后的容器管理界面,清晰展示了"运行中"的服务状态和多维度访问入口。这种可视化运维面板极大降低了技术门槛,使开发者能够快速定位API访问地址,为后续的模型交互奠定基础。

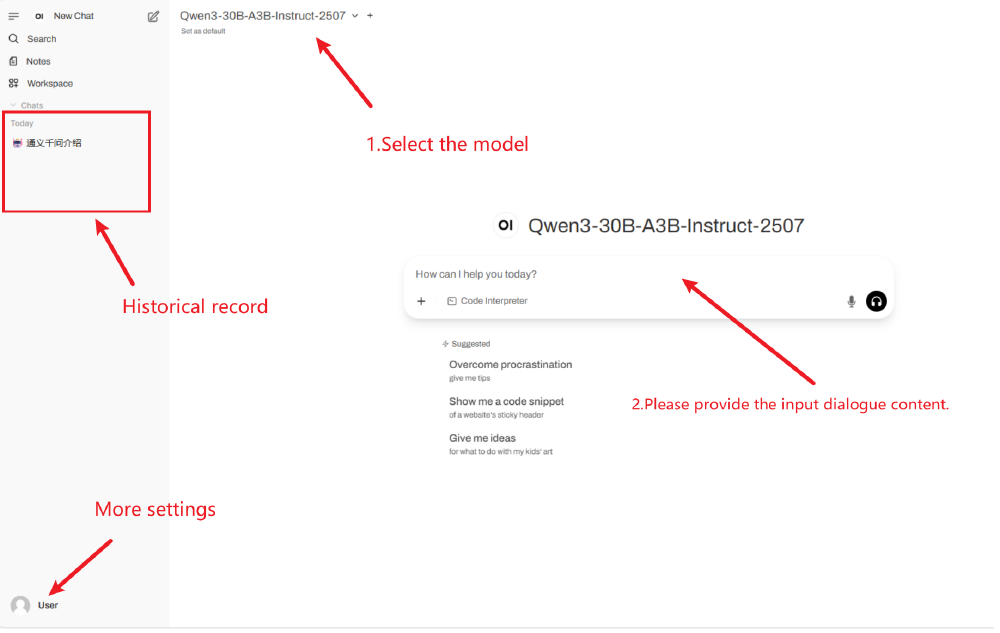

此图呈现了模型的核心交互界面,左侧的聊天历史区与中央的指令输入区形成高效协作空间。这种设计充分考虑了编码任务的迭代特性,允许开发者随时回溯历史对话,为复杂项目开发提供了连续性支持。

风险控制

- 数据安全:私有化部署确保代码不流出企业边界,模型输出需经过安全扫描

- 质量保障:关键业务逻辑仍需人工审核,建议设置模型输出置信度阈值

- 团队适配:安排2-4周的适应期,通过"AI配对编程"模式帮助开发者建立新工作习惯

未来趋势:走向Agentic开发的下一代范式

Qwen3-Coder的技术路线预示着代码大模型的三个发展方向:

- 自主开发能力增强:2025下半年将实现需求文档到可运行系统的全自动转换,开发者角色将转向需求定义与系统设计

- 多模态融合:代码生成将与UI设计、数据库架构等视觉元素深度结合,实现全栈式开发支持

- 行业知识沉淀:垂直领域模型(如金融风控、工业软件)将成为主流,通过行业知识库实现领域知识的高效复用

总结

Qwen3-Coder-30B-A3B-Instruct的推出标志着代码大模型进入实用化成熟阶段。其超长上下文、代理编码与混合专家架构三大技术突破,不仅解决了企业级开发的效率瓶颈,更重新定义了人机协作的开发范式。

在实施层面,企业需平衡技术引入与流程再造,通过渐进式部署实现价值最大化。随着模型能力的持续演进,软件开发正迈向"自然语言即代码"的终极目标,这一变革将深刻影响整个IT产业的人才结构与竞争格局。

对于技术决策者,现在是布局AI编码战略的关键窗口期。选择适合自身需求的模型、建立有效的应用框架、培养团队新工作方式,将决定企业在软件开发2.0时代的竞争力。Qwen3-Coder展示的不仅是当前技术水平,更是未来开发模式的清晰图景——在这个图景中,人类创造力与AI效率将实现前所未有的协同。

如上图所示,宣传内容强调Qwen3-Coder的能力超越GPT4.1,比肩Claude4,并称其能高效生成品牌官网和3D物理模拟动画等内容。这反映了市场对Qwen3-Coder技术能力的高度认可,也预示着代码大模型即将进入更为激烈的技术竞争阶段。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Coder-30B-A3B-Instruct

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Coder-30B-A3B-Instruct