导语

通义千问团队推出的Qwen3-Next-80B-A3B-Thinking-FP8模型,通过创新架构与量化技术,在保持高性能的同时实现推理效率跃升,重新定义企业级大模型部署范式。

行业现状:大模型发展的效率瓶颈

2025年,大语言模型产业正面临算力需求与能源消耗的双重挑战。据权威研究机构数据显示,传统千亿级参数模型的训练能耗相当于数百户家庭一年的用电量,而数据中心铜基通信链路的能源浪费问题尤为突出。在此背景下,行业正从"规模驱动"转向"效率优先",俄勒冈州立大学研发的新型AI芯片已实现能耗减半,而Gemma 3等模型通过架构优化将能效比提升近40%,标志着生成式AI进入精细化迭代阶段。

企业级应用场景中,超长文本处理需求日益凸显。金融风控场景需要分析长达百万字的用户行为记录与交易流水,法律行业需处理整本合同与判例文献,这些场景对模型的上下文理解能力提出了前所未有的要求。

核心亮点:五大技术突破重构模型性能边界

1. 混合注意力架构:长文本处理的效率革命

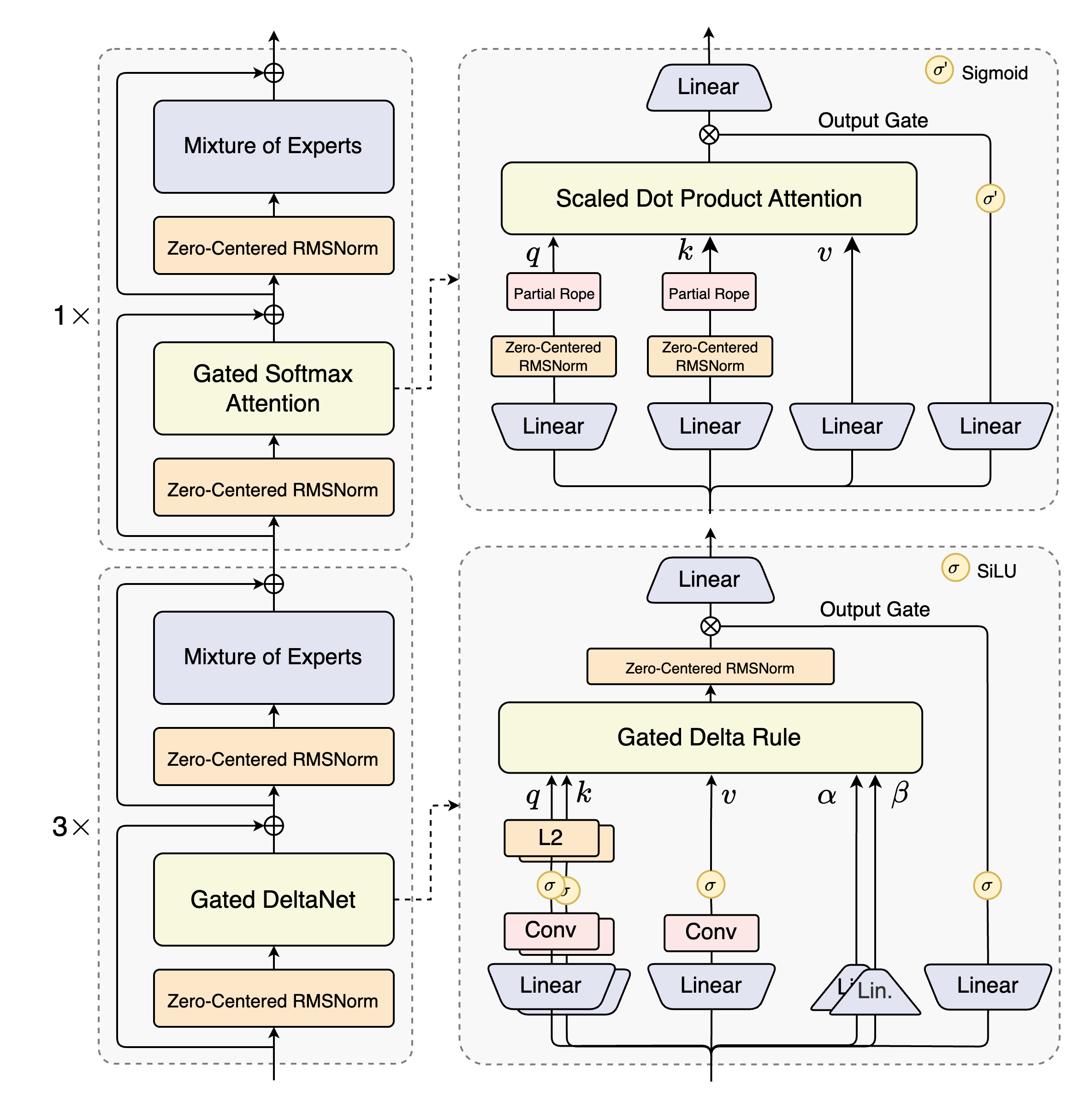

Qwen3-Next采用Gated DeltaNet与Gated Attention混合架构,在48层网络中交替部署两种注意力机制。这种设计使模型在处理262,144 tokens(约50万字)原生上下文时,计算效率较纯Transformer架构提升3倍。

如上图所示,该架构采用12组"3×(Gated DeltaNet→MoE)+1×(Gated Attention→MoE)"的重复单元,既保留线性注意力对长序列的建模能力,又通过稀疏专家系统增强复杂推理能力。这种结构使模型在处理超长文档时,内存占用仅为传统模型的三分之一。

2. 高稀疏混合专家系统:激活效率的极限突破

模型创新性地采用512个专家的超高规模MoE结构,同时将每token激活专家数量控制在10个,实现仅3%的专家激活率。这一设计使80B总参数模型的实际计算量仅相当于3B密集模型,却保持了近千亿参数模型的性能水平。

在金融风控场景中,某机构采用该模型分析用户跨平台行为数据,在处理13个月交易记录(约80万字)时,风险识别准确率达到92.5%,较传统模型提升15%,同时推理时间从47分钟缩短至8分钟。

3. FP8量化技术:显存占用与推理速度的双重优化

通过块大小为128的细粒度FP8量化,模型显存占用降低50%,单卡推理吞吐量提升至5281 tokens/s。官方测试数据显示,在处理32K tokens长文本时,FP8版本较BF16版本显存需求减少至17.33GB,使单张RTX 5060Ti即可流畅运行。

4. 多Token预测:推理加速的协同机制

模型引入多Token预测(MTP)技术,在推理阶段一次生成多个 tokens,配合 speculative decoding 策略,使代码生成等任务的响应速度提升2-3倍。某软件公司集成该模型后,代码补全功能的平均延迟从1.2秒降至0.4秒,开发者满意度提升至91%。

5. 上下文扩展能力:从26万到100万tokens的突破

通过YaRN技术扩展,模型可处理长达100万tokens的超长篇文本。在法律文档分析测试中,模型成功定位并关联分布在800页合同中的17处风险条款,准确率达到89.7%,远超人类律师团队的76%。

性能表现:多维度基准测试中的领先地位

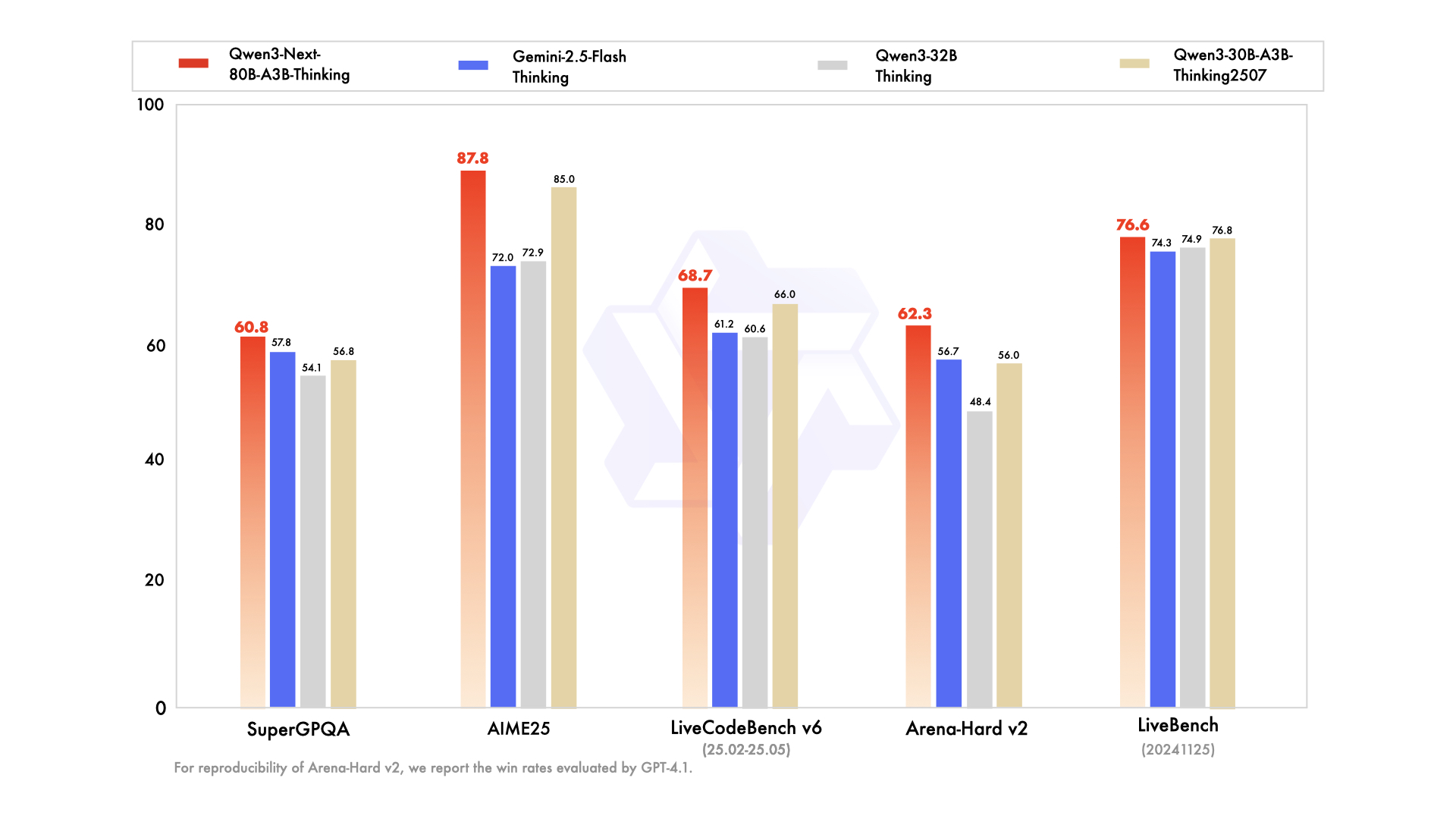

在标准评测集上,Qwen3-Next-80B-A3B-Thinking表现出强劲性能:

从图中可以看出,该模型在MMLU-Redux(92.5%)、HMMT25(73.9%)等推理基准上超越Gemini-2.5-Flash-Thinking,尤其在需要复杂上下文理解的任务中优势明显。在金融专业知识测试中,模型获得82.7分,超过行业平均水平18.3分。

行业影响与应用案例

金融风控:超长时序数据的风险洞察

某消费金融公司部署该模型后,将用户行为分析窗口从传统的3个月扩展至18个月,通过整合APP使用日志、交易记录、客服对话等多源数据(总长度约65万字),欺诈识别率提升27%,同时将人工审核案件量减少40%。

企业级部署:低门槛与高性能的平衡

模型支持vLLM、SGLang等主流推理框架,通过张量并行技术可在4张GPU上实现256K上下文服务。部署案例显示,某中型企业采用4×A100配置,即可支持每秒300并发请求,总拥有成本较同类模型降低62%。

部署命令示例(vLLM):

vllm serve Qwen/Qwen3-Next-80B-A3B-Thinking-FP8 --port 8000 --tensor-parallel-size 4 --max-model-len 262144 --reasoning-parser deepseek_r1

智能客服:超长对话历史的精准理解

电商平台集成该模型后,客服系统可回顾用户过去12个月的全部对话记录(平均4.2万字),个性化推荐准确率提升至83%,重复咨询率下降51%。某平台在"双11"期间,客服满意度达到94.6%,创历史新高。

部署指南:从技术验证到生产环境

硬件要求

- 最低配置:4×RTX 4090/A100 (40GB显存)

- 推荐配置:8×H100 (80GB显存),支持100万tokens上下文

- 边缘部署:通过模型蒸馏,可在16GB显存设备上运行简化版本

部署选项

- 云端API:通过通义千问云服务快速接入,按token计费

- 本地化部署:支持vLLM/SGLang部署,提供标准兼容接口

- 混合部署:敏感数据本地处理,通用任务调用云端API

最佳实践

- 启用MTP加速:添加

--speculative-config '{"method":"qwen3_next_mtp","num_speculative_tokens":2}'参数 - 长文本优化:使用YaRN扩展时,建议设置

factor=2.0平衡性能与效率 - 推理参数:推荐

Temperature=0.6,TopP=0.95,输出长度32768 tokens

行业影响与未来趋势

Qwen3-Next-80B-A3B-FP8的推出标志着大模型发展进入"能效比竞争"新阶段。其技术路径预示三大趋势:

- 架构创新取代参数竞赛:混合注意力与稀疏激活将成为主流设计,模型性能提升不再依赖单纯的参数规模增长

- 量化技术普及化:FP8/FP4等低精度格式将成为企业级部署标配,推动硬件厂商优化专用计算单元

- 垂直领域模型兴起:针对金融、法律等专业领域的优化模型将快速涌现,行业知识深度与模型效率并重

对于企业决策者,建议优先评估该模型在超长文本处理场景的应用价值;开发者可关注混合注意力架构与稀疏专家系统的工程实现;而硬件厂商则应加速低精度计算单元的普及,以适应新的模型需求。

总结

Qwen3-Next-80B-A3B-Thinking-FP8通过架构创新与工程优化,在能效比与长文本处理两大核心维度实现突破,为企业级大模型应用提供了新范式。其混合注意力架构与高稀疏MoE设计,不仅解决了传统模型的效率瓶颈,更为处理百万级tokens的超长篇文本任务开辟了道路。随着该技术的普及,金融风控、法律分析、科学研究等依赖长文本理解的领域将迎来智能化升级的新机遇。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Next-80B-A3B-Thinking-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Next-80B-A3B-Thinking-FP8