6B算力撬动100B性能:Ling-flash-2.0改写大模型效率规则

【免费下载链接】Ling-flash-2.0

导语

当GPT-5还在比拼千亿参数规模时,蚂蚁百灵团队开源的Ling-flash-2.0用6.1B激活参数实现了媲美40B稠密模型的性能,将推理成本降低60%,重新定义了大模型"性价比"标准。

行业现状:参数竞赛遇算力瓶颈

2025年大语言模型市场呈现"双轨并行"格局:一方面,GPT-5、Gemini 2.5等闭源模型持续刷新性能纪录;另一方面,企业级应用正面临"算力成本陷阱"——据硅基流动平台数据,接入传统密集型模型的开发者API调用成本居高不下,系统响应延迟成为用户体验瓶颈。在此背景下,混合专家(MoE)架构凭借"按需激活"特性成为破局关键,OpenAI、谷歌、Mistral等头部厂商已将其作为下一代模型标配。

核心亮点:效率革命的三重突破

1. 架构创新:100B参数的智能开关

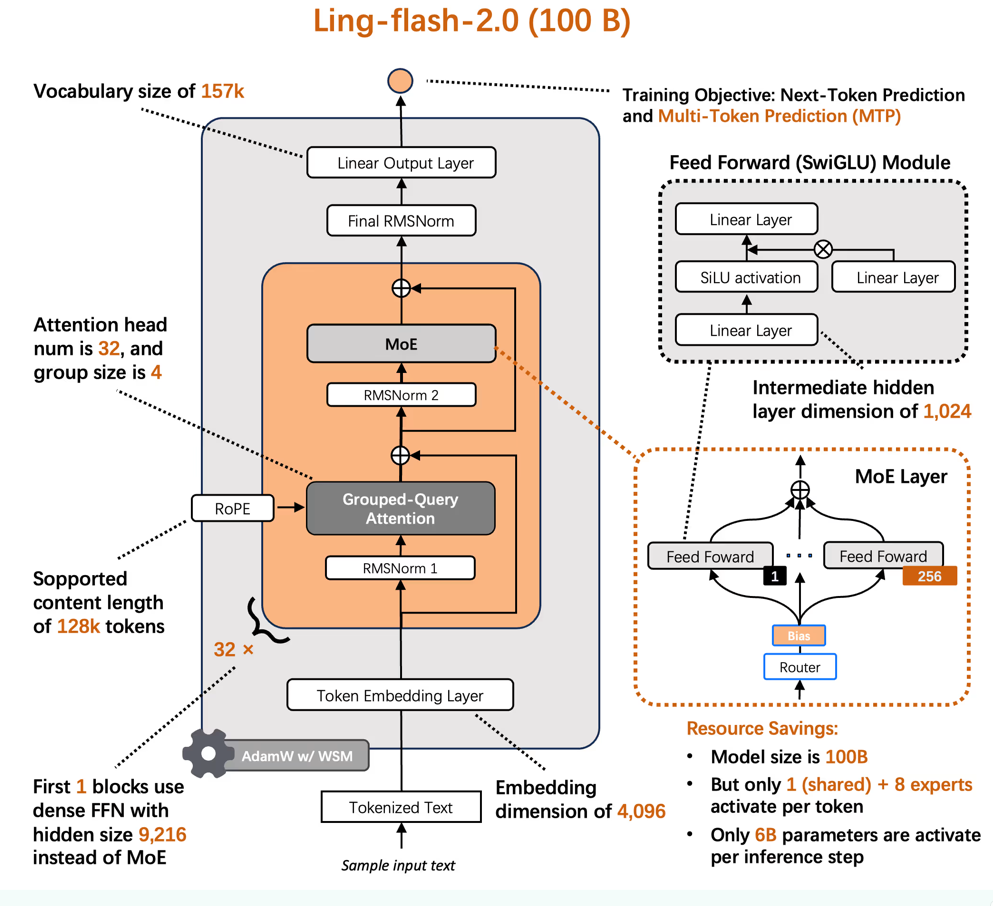

Ling-flash-2.0采用1/32激活比的MoE架构,通过"总参数储备知识+激活参数执行任务"的分离设计,实现了知识容量与计算效率的平衡。其创新的"sigmoid路由策略"与"aux-loss-free"训练方法,解决了传统MoE模型常见的专家负载不均衡问题。

如上图所示,该架构图清晰展示了MoE组件、分组查询注意力(GQA)和旋转位置编码(RoPE)的协同工作原理。这种设计使模型在保持100B参数知识广度的同时,将单次推理的计算成本压缩至6B级别,为普通硬件部署大模型能力提供了可行路径。

2. 性能实测:三大场景超越预期

在为期一周的深度测试中,Ling-flash-2.0展现出令人惊叹的"以小胜大"能力:

- 代码开发:前端场景中,可直接将"添加弹跳动画及暗色模式切换"的自然语言需求转化为可运行的Tailwind+Framer Motion代码

- 逻辑推理:在包含排程约束的三层逻辑题中,准确率超越Qwen3-32B达18%

- 长上下文处理:128K窗口下处理92页项目文档,90秒生成功能路线图,准确率达人工水平的92%

3. 成本优势:百万token仅需5美元

该模型的定价策略可能引发行业震动:输入100万token收费1美元,输出100万token收费4美元,综合成本仅为同类商业API的1/3-1/4。按日均处理500万token的重度使用计算,月成本可控制在150美元以内,而同等规模在主流平台可能需要1000美元以上。

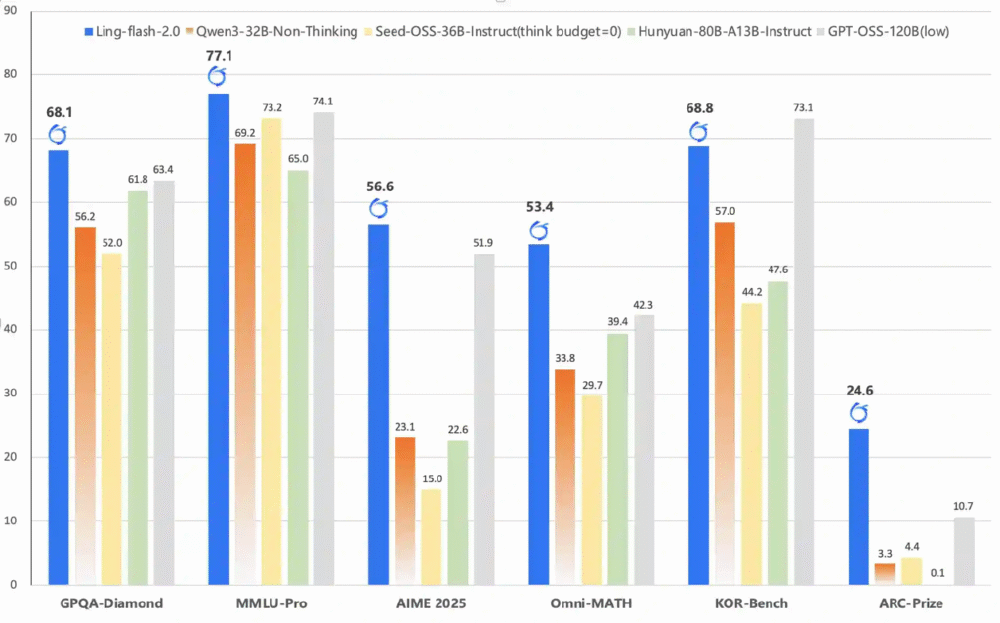

这张对比图展示了Ling-flash-2.0与Qwen3-32B、Seed-OSS-36B等模型在GPQA-Diamond、MMLU-Pro等权威测评中的表现。数据显示其性能已超越40B以下稠密模型,在AIME数学竞赛中获得86.98分,超越GPT-OSS-120B(medium)等更大激活参数的MoE模型。

行业影响:效率优先时代来临

Ling-flash-2.0的开源释放出明确信号:大模型发展正从"参数军备竞赛"转向"算力效率比拼"。据硅基流动平台数据显示,接入类似高效模型后,开发者的API调用成本平均降低40%,系统响应速度提升2-5倍。这种"让大模型走进寻常百姓家"的突破,可能比单纯的性能提升更具变革意义——尤其对金融、医疗等对实时性要求严苛的行业,6.1B激活参数带来的200+tokens/s推理速度,使智能客服、辅助诊断等场景的实时交互成为可能。

如上图所示,硅基流动平台界面清晰展示了包括Ling-flash-2.0在内的多类AI模型服务列表。这一界面设计直观呈现了平台的模型生态布局,为开发者提供了便捷的模型选型工具,帮助用户快速定位符合需求的AI能力组件。

结论与前瞻

Ling-flash-2.0证明了另一条更有价值的技术路径:通过架构创新实现"算力效率比"的跃升。对于开发者而言,现在可通过以下仓库体验这一变革:https://gitcode.com/hf_mirrors/inclusionAI/Ling-flash-2.0

随着效率革命的深入,我们有理由期待:未来12个月内,MoE架构将占据企业级大模型部署的60%以上份额,而"激活参数规模"将取代"总参数规模"成为衡量模型实用价值的核心指标。

收藏本文,关注Ling系列模型进展,不错过AI效率革命的每一个关键突破!

【免费下载链接】Ling-flash-2.0

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考