智谱AI开源力作:GLM-4-9B-Chat深度解析,重新定义开源大模型性能标准

【免费下载链接】glm-4-9b-chat-1m-hf

在人工智能技术飞速发展的今天,大语言模型的竞争已然进入白热化阶段。近日,智谱AI正式对外发布了GLM-4系列预训练模型的开源版本——GLM-4-9B,这一突破性成果迅速在AI领域引发广泛关注。作为该系列的重要成员,GLM-4-9B-Chat经过精心的人类偏好对齐训练,不仅在语义理解、数学推理、代码生成和知识储备等核心能力上实现了全面提升,更创新性地集成了多轮对话、网页浏览、代码执行、自定义工具调用以及超长上下文推理(支持128K上下文窗口)等多元化功能。这款模型的问世,无疑为AI开发者和研究人员提供了一个功能强大且极具性价比的全新选择。

GLM-4-9B-Chat的核心优势首先体现在其卓越的多语言处理能力上。该模型能够流畅支持包括中文、英文、日语、韩语、德语在内的26种语言,这意味着它可以轻松应对全球化的多语言交流场景。无论是跨国企业的智能客服,还是多语种内容的自动生成与翻译,GLM-4-9B-Chat都展现出了令人瞩目的潜力。其次,其超长的上下文处理能力更是一大亮点。128K的上下文长度允许模型一次性处理海量文本信息,这对于长篇文档理解、复杂合同分析、多轮深度对话等场景至关重要,极大地拓展了模型的应用边界。

在功能性方面,GLM-4-9B-Chat的自定义工具调用(Function Call)能力堪称一绝。这一特性使得模型不再局限于自身的知识库,而是能够灵活调用外部工具,如执行代码片段、进行实时网页浏览等,从而完成更为复杂和专业的任务。例如,用户可以直接让模型编写一段数据分析代码并执行,或者让其联网获取最新的资讯并进行总结。这种“模型+工具”的协同模式,显著提升了AI的实用价值。

性能表现上,GLM-4-9B-Chat在众多权威数据集评测中均展现出超越同类模型的实力。特别是在与Llama-3-8B的对比中,GLM-4-9B-Chat在语义理解、数学问题求解、逻辑推理、代码生成质量和知识覆盖广度等多个维度上都取得了领先成绩,充分证明了其强大的综合能力。

基于这些核心优势,GLM-4-9B-Chat的应用场景极为广泛。在自然语言处理领域,它可以用于文本分类、情感分析、命名实体识别等基础任务;在多语言对话方面,其出色的多语言数据集表现确保了不同语言背景用户之间的顺畅沟通;代码生成与执行是其另一强项,在知名的HumanEval代码生成评测中,GLM-4-9B-Chat斩获了71.8的高分,展现出专业级的编程辅助能力;而在知识问答领域,面对MMLU(大规模多任务语言理解)和C-Eval(中文基础模型评估)等涵盖多学科知识的复杂评测,GLM-4-9B-Chat也交出了令人满意的答卷,能够为用户提供准确且深入的解答。

对于广大开发者而言,快速上手并高效使用这款强大的模型是首要需求。为此,官方提供了详尽的快速开始指南,支持主流的Transformers库(4.46.0及更高版本)和vLLM库(0.6.4及更高版本)进行推理部署。

若选择使用Transformers库,开发者首先需要安装必要的依赖包。完成环境配置后,便可通过简洁的代码调用模型。官方示例中,以“猫有几条腿”这样一个简单的问答为例,清晰展示了从模型加载到生成回答的完整代码流程。这段示例代码不仅易于理解,也为开发者提供了一个良好的起点,方便他们根据自身需求进行修改和扩展。

对于追求更高推理效率的用户,vLLM库无疑是更佳选择。vLLM以其高效的PagedAttention技术而闻名,能够显著提升大模型的吞吐量和响应速度。使用vLLM调用GLM-4-9B-Chat同样需要先安装相应的依赖。在调用过程中,开发者可以根据自身硬件配置对模型参数进行灵活设置。一个常见的问题是内存溢出(OOM),官方对此也给出了解决方案,建议用户可以通过调整max_model_len(最大模型序列长度)或tp_size(张量并行大小)等参数来优化内存使用,确保模型稳定运行。

GLM-4-9B-Chat的主要特性可以用“全面且强大”来概括。其高性能表现并非空穴来风,而是在一系列权威综合基准测试中得到了充分验证。在AlignBench-v2、MT-Bench、IFEval等对齐与对话能力评测中,在MMLU、C-Eval等知识掌握度评测中,在GSM8K、MATH等数学能力评测中,以及在HumanEval、NCB等代码生成与理解评测中,GLM-4-9B-Chat均以明显优势超越了Llama-3-8B-Instruct和ChatGLM3-6B等当前主流的开源对话模型。这一系列的优异成绩,为开发者选择GLM-4-9B-Chat提供了坚实的信心保障。

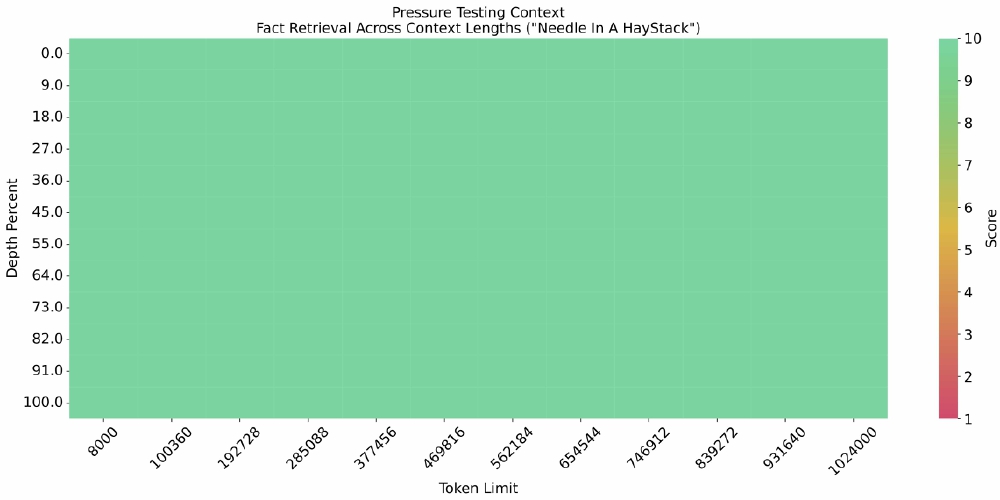

长上下文处理能力的实际效果如何,一直是开发者关注的焦点。为了直观展示这一点,我们来看下面这张热力图:

如上图所示,该热力图清晰展示了GLM-4-9B-Chat模型在著名的“Needle In A HayStack”(草堆寻针)实验中,在不同token长度限制下的事实检索性能。结果显示,即使在上下文长度达到1M这样极端的条件下,模型的表现依然稳定且得分较高。这一结果充分证明了GLM-4-9B-Chat在处理超长文本时,依然能够准确捕捉关键信息,为处理长篇文档、书籍等提供了可靠的技术支撑。

如上图所示,该热力图清晰展示了GLM-4-9B-Chat模型在著名的“Needle In A HayStack”(草堆寻针)实验中,在不同token长度限制下的事实检索性能。结果显示,即使在上下文长度达到1M这样极端的条件下,模型的表现依然稳定且得分较高。这一结果充分证明了GLM-4-9B-Chat在处理超长文本时,依然能够准确捕捉关键信息,为处理长篇文档、书籍等提供了可靠的技术支撑。

除了“Needle In A HayStack”实验,GLM-4-9B-Chat在LongBench等专业的长文本评测基准上也取得了良好结果,进一步印证了其在长上下文理解方面的强大实力。

多语言能力的评测同样是衡量一款全球化大模型的重要指标。GLM-4-9B-Chat在M-MMLU(多语言大规模多任务语言理解)、FLORES(跨语言机器翻译评估)、MGSM(多语言数学问题求解)、XWinograd、XStoryCloze、XCOPA等六个权威多语言数据集上的表现均优于Llama-3-8B-Instruct,展现了其在跨语言理解和生成方面的卓越能力。这意味着GLM-4-9B-Chat能够更好地服务于全球不同语言背景的用户,推动AI技术的普惠发展。

为了满足不同场景的需求,智谱AI还推出了GLM-4-9B-Chat的衍生版本。其中,GLM-4-9B-Chat-1M模型将上下文长度进一步扩展到了惊人的1M,能够处理整本书籍级别的文本输入;而多模态模型GLM-4V-9B则在语言能力的基础上,新增了图像理解能力,开启了图文并茂的智能交互新模式。

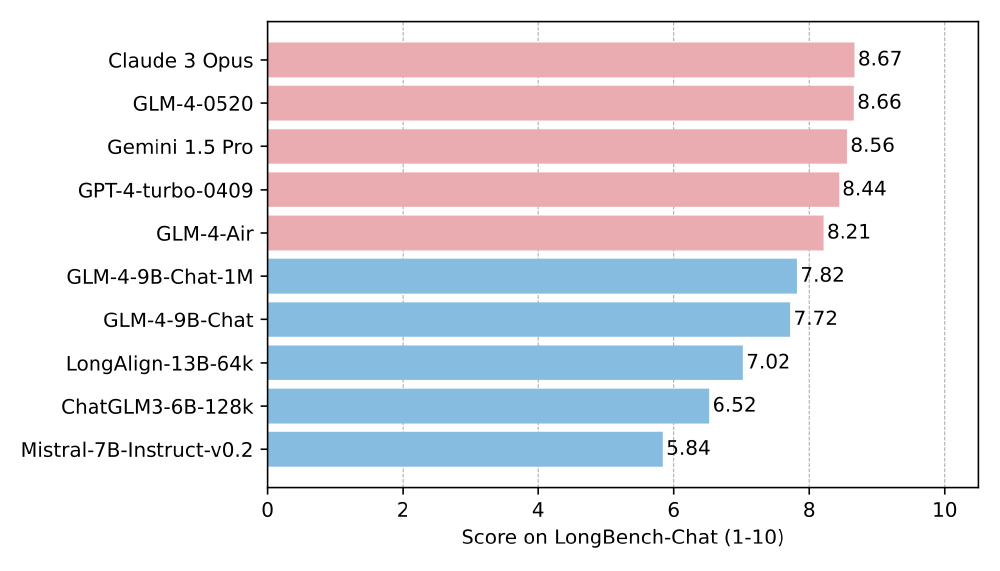

为了让大家更直观地了解GLM-4-9B-Chat及其衍生版本在长文本处理任务上的表现,我们来看下面这张横向条形图:

如上图所示,这张横向条形图对比了包括GLM-4-9B-Chat-1M在内的多个大语言模型在LongBench-Chat任务上的得分情况。从图中可以清晰看出,GLM-4-9B-Chat-1M在长文本理解任务上表现尤为突出,这为需要处理超长文本的应用场景(如法律文档分析、学术论文综述等)提供了强有力的技术支持,帮助用户更高效地从海量信息中提取价值。

如上图所示,这张横向条形图对比了包括GLM-4-9B-Chat-1M在内的多个大语言模型在LongBench-Chat任务上的得分情况。从图中可以清晰看出,GLM-4-9B-Chat-1M在长文本理解任务上表现尤为突出,这为需要处理超长文本的应用场景(如法律文档分析、学术论文综述等)提供了强有力的技术支持,帮助用户更高效地从海量信息中提取价值。

在模型的使用许可方面,用户需要注意GLM-4模型的权重是在特定许可证条款下提供的。开发者在使用前应仔细阅读并理解相关许可协议,确保合规使用。此外,在学术研究或商业报告中引用GLM-4模型时,需参考官方指定的论文,以尊重开发者的知识产权。

官方特别强调,为了确保模型能够正常运行并获得最佳性能,使用此仓库中的权重时,务必将Transformers库更新至4.46.0或更高版本。旧版本的Transformers库可能会与GLM-4-9B-Chat模型存在兼容性问题,导致无法正确加载模型或出现推理错误。因此,严格按照官方推荐的依赖项版本进行安装和配置,是顺利使用该模型的关键前提。

综上所述,智谱AI开源的GLM-4-9B-Chat模型凭借其卓越的综合性能、丰富的功能特性和广泛的应用潜力,无疑为开源大模型领域注入了新的活力。它不仅为开发者提供了一个强大且灵活的AI工具,也为AI技术的普及和创新应用开辟了新的可能性。从技术发展的角度来看,GLM-4-9B-Chat及其后续版本(如支持1M上下文的GLM-4-9B-Chat-1M和多模态的GLM-4V-9B)的推出,标志着开源大模型在性能逼近闭源商业模型的道路上又迈出了坚实的一步。未来,随着技术的不断迭代和优化,我们有理由相信,GLM-4系列模型将在更多领域发挥重要作用,推动人工智能技术更好地服务于社会生产和人们的日常生活。对于开发者而言,现在正是深入探索和应用GLM-4-9B-Chat的绝佳时机,借助这一强大的工具,开发出更具创新性和实用性的AI应用。

【免费下载链接】glm-4-9b-chat-1m-hf

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考