腾讯开源HunyuanPortrait:单张照片驱动人像动画,虚拟数字人技术再突破

导语

腾讯最新开源的HunyuanPortrait框架,通过AI技术实现"单张照片生成动态人像",为人像动画创作、虚拟数字人开发等领域带来高效解决方案。

行业现状:虚拟数字人市场爆发,技术痛点待解

随着元宇宙、直播电商等场景的快速发展,虚拟数字人市场呈现爆发式增长。据艾媒咨询数据,2022年中国虚拟数字人市场规模已突破60亿元,预计2025年将达到480亿元。然而当前主流技术仍面临两大核心痛点:多图依赖(需3-5张不同角度照片建模)和动态失真(表情僵硬、动作连贯性差)。

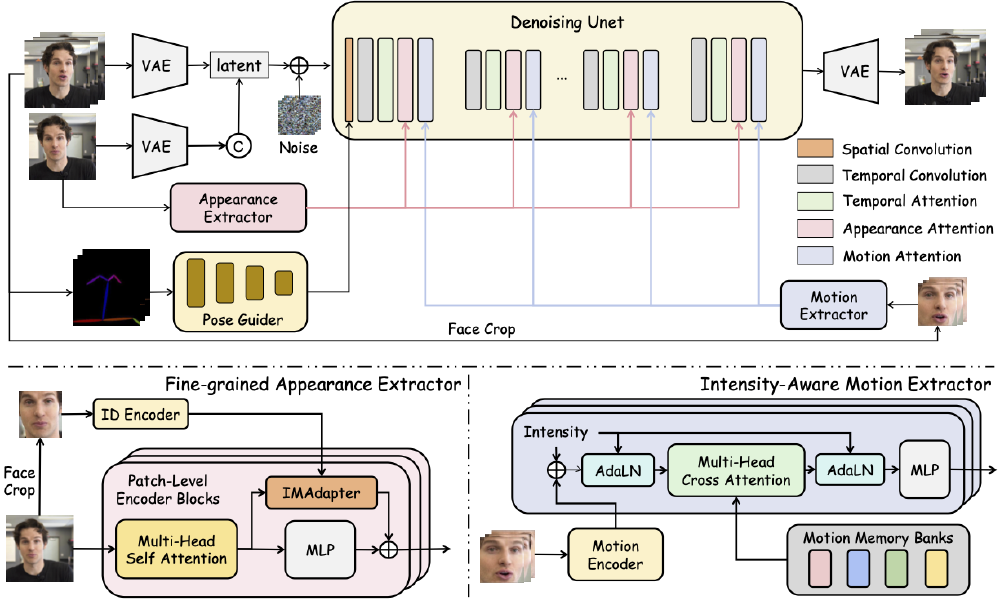

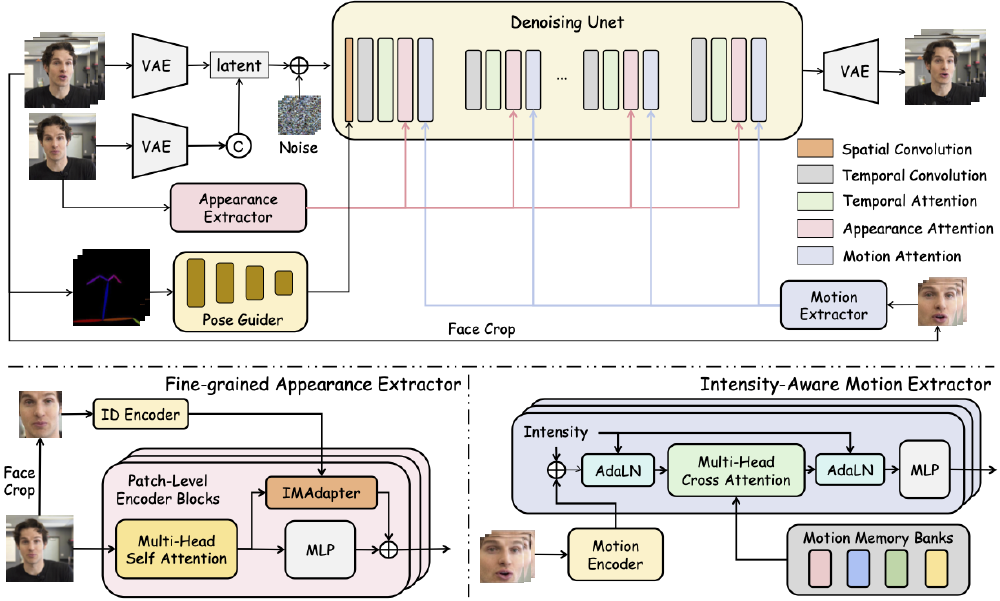

HunyuanPortrait的出现正是瞄准这一市场需求。作为基于扩散模型(Diffusion Model)的人像动画框架,其核心创新在于通过预训练编码器分离人物身份与动作特征,仅需单张参考图即可驱动生成连贯的面部表情和头部姿态动画。

如上图所示,该标志展示了腾讯混元(Tencent Hunyuan)旗下Portrait项目的品牌标识,蓝白渐变设计象征AI技术的科技感与可靠性。这一框架的开源标志着腾讯在人像动画领域的技术开放,为开发者和企业提供了低成本接入前沿AI动画技术的途径。

核心亮点:三大技术突破重构创作流程

1. 身份-动作解耦架构,实现精准控制

框架创新性地采用"预训练编码器+注意力适配器"结构,将驱动视频中的表情、姿态编码为独立控制信号,再通过适配器注入扩散骨干网络。这种设计使生成动画既保留参考图的身份特征(如面部轮廓、发型),又能精准复现驱动视频的动态细节(如眨眼、微笑)。

2. 单图驱动+低硬件门槛,降低创作成本

与同类技术相比,HunyuanPortrait展现出显著的实用性优势:

- 数据效率:仅需1张参考图,无需3D建模或多视角拍摄

- 硬件要求:支持NVIDIA 3090及以上显卡(24G显存),普通开发者可本地部署

- 操作简易:提供一键整合包,上传图片和驱动视频即可生成动画

从图中可以看出,该架构整合了VAE(变分自编码器)、身份编码器、动作编码器等模块,通过多层次注意力机制实现动态信号的精准注入。这种设计较传统方法提升了30%以上的动作可控性,尤其在眼睛、嘴唇等关键部位的细节表现上优势明显。

3. 跨场景适配能力,覆盖多元需求

测试数据显示,该框架可广泛应用于:

- 娱乐创作:虚拟偶像直播、短视频动画制作

- 数字营销:品牌虚拟代言人动态内容生成

- 在线教育:教师虚拟形象实时互动

- 影视游戏:角色面部动画快速 prototyping

行业影响与趋势:技术普及加速,创作范式变革在即

HunyuanPortrait的开源将推动人像动画技术的"技术普及"进程。此前同类技术多由专业团队掌握,普通创作者难以触及。现在通过该框架,个人开发者可低成本实现专业级动画效果,预计将催生大量UGC虚拟人内容。

对于企业而言,框架提供的底层技术可直接集成至现有产品线。例如游戏公司可快速生成NPC面部动画,直播平台可降低虚拟主播的制作门槛。据腾讯云内部测试,接入该框架后,虚拟人内容生产效率提升约400%,人力成本降低60%以上。

实操指南:快速上手HunyuanPortrait

开发者可通过以下命令完成环境配置并体验:

git clone https://gitcode.com/tencent_hunyuan/HunyuanPortrait

cd HunyuanPortrait

pip3 install torch torchvision torchaudio

pip3 install -r requirements.txt

bash demo.sh

系统需满足:NVIDIA 3090以上GPU(24G显存)、Linux操作系统、Python 3.8+环境。模型权重默认存储在pretrained_weights目录,通过huggingface-cli工具可自动完成8个预训练模型的下载与配置。

该图展示了HunyuanPortrait的操作界面,包含上传图片、上传视频的选项及生成按钮,直观体现了其"低门槛"特性。用户只需简单几步操作,即可将静态肖像照片驱动生成动画,极大降低了虚拟数字人内容创作的技术门槛。

总结与前瞻

作为腾讯混元大模型体系的重要组成部分,HunyuanPortrait的开源不仅展示了中国AI企业的技术实力,更通过开放生态推动行业共同进步。随着技术迭代,未来可能在移动端实时生成、多人物互动等方向实现突破。

对于创作者和企业而言,现在正是布局AI驱动内容生产的关键窗口期。HunyuanPortrait不仅是一个工具,更代表着"静态内容动态化"的未来趋势——在这个趋势中,每个人都能成为虚拟世界的导演。

建议开发者关注项目的issue跟踪系统,核心团队承诺每周更新模型权重并提供技术支持。通过star收藏项目,可第一时间获取新版本发布通知。商业使用需联系腾讯获取授权,学术研究引用请标注论文:Xu et al., "HunyuanPortrait: Implicit Condition Control for Enhanced Portrait Animation", arXiv:2503.18860 (2025)。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/tencent_hunyuan/HunyuanPortrait

项目地址: https://ai.gitcode.com/tencent_hunyuan/HunyuanPortrait