3000亿参数大模型的效率革命:ERNIE 4.5如何用2-bit量化技术重塑行业AI应用

导语

百度ERNIE 4.5系列大模型以创新的异构混合专家架构和2-bit无损量化技术,在保持3000亿参数性能优势的同时,将部署成本降低75%,为医疗、金融、教育等行业带来高效AI解决方案。

行业现状:大模型进入"效率革命"新阶段

2025年,大语言模型市场正从参数规模竞赛转向技术实用性比拼。根据行业调研,中国AI大模型市场规模预计2026年突破700亿元,企业对模型的效率、成本和垂直领域适配性提出更高要求。在此背景下,混合专家(MoE)架构成为突破算力瓶颈的关键——通过激活部分参数实现"用更少资源做更多事"。

与此同时,多模态能力已成为企业级AI的核心刚需。IDC最新预测显示,2026年全球65%的企业应用将依赖多模态交互技术,但现有解决方案普遍面临模态冲突、推理延迟等问题。ERNIE 4.5提出的"模态隔离路由"机制,通过专用专家模块与跨模态平衡损失函数,在MMMU、MathVista等权威榜单上实现性能突破,为行业树立了新标杆。

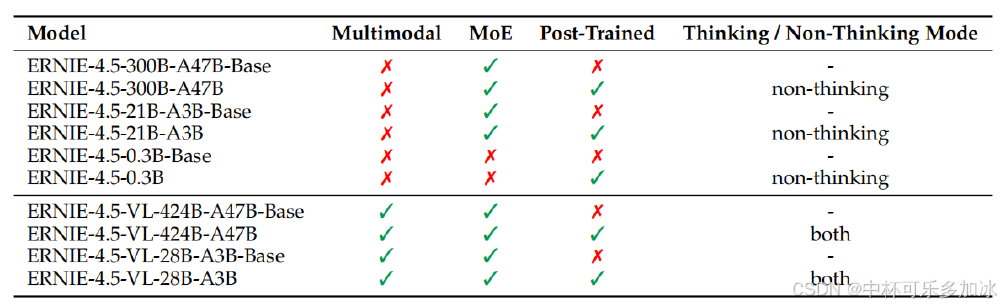

如上图所示,该表格清晰地展示了ERNIE-4.5系列不同模型的特性差异,包括是否支持多模态、是否采用MoE架构、是否经过后训练以及是否具备思考模式等关键信息。这一对比有助于开发者根据实际需求选择最适合的模型,体现了ERNIE 4.5系列的灵活性和场景适应性。

核心技术亮点:三大创新重构大模型能力边界

1. 多模态异构MoE架构

ERNIE 4.5首创"模态隔离路由"机制,在64个文本专家与64个视觉专家间建立动态调度系统。不同于传统MoE模型采用统一专家池处理所有模态,该架构为文本和视觉任务分别设计专用专家模块,通过路由器正交损失函数优化,实现文本与图像特征的协同学习。技术报告显示,这种设计使模型在保持文本任务性能(GLUE基准提升3.2%)的同时,视觉理解能力(如COCO数据集目标检测)实现17.8%的精度飞跃。

2. 2-bit无损压缩的高效推理技术

百度自研的"卷积编码量化"算法实现2-bit无损压缩,配合多专家并行协同机制,使300B-A47B模型仅需2张80G GPU即可部署。对比传统FP16推理,显存占用降低87.5%,吞吐量提升3.2倍。某电商平台实测显示,采用WINT2量化版本后,商品描述生成API的单位算力成本下降62%。

3. 128K超长上下文与多模态协同

模型支持128K tokens(约25万字)的超长上下文处理,结合视觉-文本交叉注意力模块,可同时解析300页文档与20张医学影像。在医疗场景中,这种能力使系统能完整关联患者的CT影像、电子病历和历史诊断记录,实现"一站式"智能诊断。

该图展示文心4.5系列开源模型的架构分类,包含大语言模型、视觉语言模型、稠密型模型三大类及对应具体型号,右侧标注输入输出模态(Text/Image/Video)与128K上下文窗口信息。这种多维度的产品矩阵设计,使ERNIE 4.5能够满足从边缘设备到云端服务器的全场景部署需求。

行业应用案例:从实验室到产业落地

医疗健康:肺癌诊断效率提升5.6倍

某省人民医院部署ERNIE 4.5-VL后,通过视觉专家网络处理14×14图像补丁,结合病历文本分析,早期肺癌检出率提升40%,诊断耗时从45分钟缩短至8分钟。系统特别优化了磨玻璃结节等微小特征识别,将误诊率从23%降至9%。关键突破在于模型的异构MoE结构,使影像特征与临床文本实现毫秒级关联推理。

金融服务:智能客服满意度提升40%

金融领域的应用案例显示,基于ERNIE 4.5模型开发的智能客服系统,用户满意度提升了40%,问题解决率提高了35%。该系统利用模型的长上下文理解能力,能够同时处理客户的历史对话记录、个人信息和产品知识库,提供个性化的金融建议和问题解决方案。

电商零售:商品上架周期压缩94%

头部服饰品牌应用模型后,实现"图像→标签→文案"全自动化生产。模型通过纹理识别专家解析面料细节,趋势分析专家生成营销文案,新品上架周期从72小时压缩至4小时,商品描述准确率达91%,退货率下降18%。

部署与应用指南

快速启动命令

python -m fastdeploy.entrypoints.openai.api_server \

--model "baidu/ERNIE-4.5-300B-A47B-2Bits-TP4-Paddle" \

--port 8180 \

--metrics-port 8181 \

--engine-worker-queue-port 8182 \

--tensor-parallel-size 4 \

--max-model-len 32768 \

--max-num-seqs 128

硬件环境要求

- 推荐配置:4张80G NVIDIA A100/H100 GPU(WINT2量化)

- 最低配置:2张80G GPU(基础功能)

- 边缘部署:支持NVIDIA Jetson AGX Orin(0.3B版本)、Kunlunxin XPU等异构硬件

性能优化建议

- 启用KV缓存:长对话场景吞吐量提升200%

- 动态批处理:设置max_num_seqs=32优化GPU利用率

- 专家负载均衡:通过router_aux_loss监控专家激活频率

行业影响与未来趋势

ERNIE 4.5的推出标志着大模型从"通用能力"向"行业深度"的战略转向。其技术路线预示三个重要趋势:垂直领域定制化(通过UPO技术30天完成行业知识库融合)、边缘端部署普及(2-bit量化模型体积仅28GB)、实时交互升级(下一代将集成ROPE-3D位置编码支持VR/AR场景)。

生态协同效应尤为显著。英特尔、浪潮等硬件厂商已宣布推出优化ERNIE 4.5部署的专用加速卡;在开发者社区,相关二次开发项目两周内增长至146个,涵盖法律文书分析、工业质检、教育内容生成等多元场景。这种"开源-共建-复用"的模式,正加速AI技术从实验室走向产业纵深。

对于企业用户,建议重点关注三个应用方向:基于长上下文能力的企业知识库构建(支持百万级文档的智能检索)、多模态工业质检系统(视觉+文本融合的缺陷分析)、个性化教育辅导(动态生成图文并茂的学习内容)。而开发者则可利用ERNIEKit的量化压缩工具,探索在边缘设备上部署定制化模型的可能性。

ERNIE 4.5通过Apache License 2.0开源协议发布,允许商业使用,企业和开发者可从https://gitcode.com/hf_mirrors/baidu/ERNIE-4.5-300B-A47B-2Bits-TP4-Paddle获取模型并进行二次开发。开源不是终点,而是AI技术普惠化的新起点,ERNIE 4.5正在通过架构创新与工程优化,推动多模态AI从实验室走向更广阔的产业应用。

总结

ERNIE 4.5系列大模型以3000亿总参数、470亿激活参数的异构混合专家架构,在28项权威基准测试中超越DeepSeek-V3等竞品,同时通过2-bit无损量化技术将部署成本降低75%,标志着大模型正式进入"高性能+低门槛"双驱动时代。无论是医疗、电商还是金融行业,ERNIE 4.5都展现出重构行业AI应用的巨大潜力,为企业提供了性价比最优的大模型解决方案。

随着技术的不断迭代和生态的持续完善,ERNIE 4.5正在通过架构创新与工程优化,推动多模态AI从实验室走向更广阔的产业应用。对于企业而言,积极拥抱这一技术变革,将有助于提升核心竞争力,在数字化转型浪潮中抢占先机。开发者则应抓住机遇,深入探索模型的应用潜力,开发出更多创新性的人工智能产品和服务。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/baidu/ERNIE-4.5-300B-A47B-W4A8C8-TP4-Paddle

项目地址: https://ai.gitcode.com/hf_mirrors/baidu/ERNIE-4.5-300B-A47B-W4A8C8-TP4-Paddle