探索动态场景的未来:神经场景图(Neural Scene Graphs)

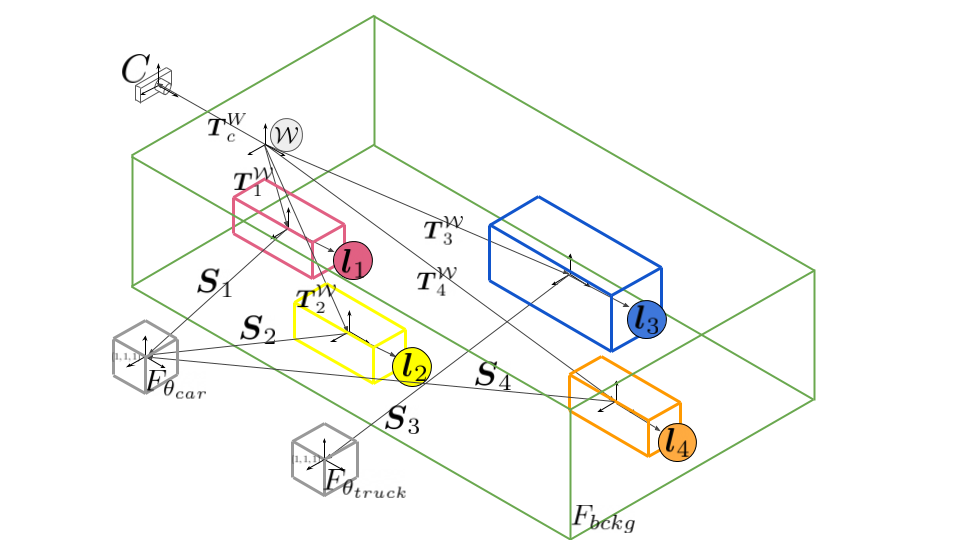

在计算机视觉和图形学的世界里,我们正见证一项革命性的技术创新——Neural Scene Graphs。这是一个在CVPR 2021上发表的研究成果,它提供了一种优化多个辐射场来表示不同对象和静态背景的智能方法。通过学习到的表示形式,我们可以渲染出新颖的对象组合和视图,为动态场景的理解与重建带来全新的可能。

项目简介

该项目由Julian Ost等人开发,是对Neural Radiance Fields (NeRF)的创新性扩展。其核心在于构建神经场景图,以捕捉场景中物体间的相互作用和运动,允许用户创建和操控动态场景。原代码库基于Mildenhall等人的NeRF实现,并对其进行了扩展和优化。

技术分析

Neural Scene Graphs利用深度学习的方法,将每一个独立的物体和背景都建模为一个单独的辐射场。这些辐射场可以通过训练进行优化,使得它们能够精确地再现原始图像中的每一个细节。通过这种方式,模型不仅能够处理单一帧的图像,还能理解并预测物体随时间的变化,从而生成连续的动态序列。

应用场景

这项技术的应用潜力广泛,包括但不限于:

- 虚拟现实(VR):实时渲染动态场景,让用户体验更加逼真的虚拟世界。

- 自动驾驶:帮助车辆理解和预测复杂道路环境中的动态元素,如其他车辆、行人和障碍物的行为。

- 电影制作:创造出栩栩如生的特效,无需实物拍摄或复杂的后期合成。

- 游戏引擎:提升游戏世界的交互性和沉浸感。

项目特点

- 灵活性:可以独立训练和优化每个物体的辐射场,适应多变的场景布局。

- 可扩展性:能处理任意数量的物体,支持动态添加和移除。

- 高效渲染:即使在复杂的场景下也能快速生成高分辨率的图像。

- 易用性:提供了详细的配置文件和脚本,简化了数据准备和模型训练的过程。

要开始你的探索之旅,只需按照项目文档中的步骤安装依赖、下载数据集并运行示例脚本。无论是训练新的场景还是渲染预训练的模型,这个项目都能帮你轻松完成。

不要错过这个机会,一起加入这场动态场景重构的革命吧!

论文链接:https://openaccess.thecvf.com/content/CVPR2021/html/Ost_Neural_Scene_Graphs_for_Dynamic_Scenes_CVPR_2021_paper.html

项目主页:https://light.princeton.edu/publication/neural-scene-graphs

引用本文时,请使用以下格式:

@InProceedings{Ost_2021_CVPR,

author = {Ost, Julian and Mannan, Fahim and Thuerey, Nils and Knodt, Julian and Heide, Felix},

title = {Neural Scene Graphs for Dynamic Scenes},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

month = {June},

year = {2021},

pages = {2856-2865}

}

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考