2025年Stable Diffusion全解析:从技术突破到行业变革

【免费下载链接】stable-diffusion-v1-5

导语

Stable Diffusion 3.5版本实现消费级硬件"开箱即用",开源模型正以每月迭代的速度重构图像生成行业格局,已占据专业设计领域37%市场份额。

行业现状:文生图市场的"双轨制"竞争

当前AI图像生成领域呈现明显的技术分化:闭源阵营以Midjourney v6为代表,通过云端服务提供极致生成质量;而开源体系则以Stable Diffusion为核心,凭借灵活性和定制化优势快速渗透企业级市场。根据2025年AI工具全景图显示,Stable Diffusion尤其在需要本地化部署的金融、医疗等敏感行业渗透率超过50%。

Stability AI公司2024年10月发布的Stable Diffusion 3.5版本,标志着开源模型在生成质量上实现关键突破。该版本采用全新的MMDiT架构,在处理复杂提示词和纠正拼写错误方面能力提升40%,同时通过显存优化技术,使消费级显卡(如RTX 4070)也能流畅运行1024×1024分辨率图像生成。

核心技术亮点:从"能用"到"好用"的跨越

性能与效率的平衡艺术

Stable Diffusion 3.5实现了三大技术突破:采用混合专家模型(MoE)架构,将参数量动态分配至80亿参数规模;通过对抗性扩散蒸馏技术,将生成步骤从50步压缩至2-4步;创新性的"提示词修复引擎",能自动识别并修正拼写错误和逻辑矛盾的文本描述。这些改进使模型在保持生成质量的同时,推理速度提升3倍,硬件门槛降低60%。

生态系统的开放协作模式

作为开源项目,Stable Diffusion形成了独特的发展路径:基础模型由Stability AI维护,社区开发者贡献超过2000种风格LoRA模型,企业则专注垂直领域解决方案。这种模式催生出丰富的衍生工具,如基于SD3.5开发的Stable Video Diffusion,已实现文本到10秒短视频的直接生成,帧率可达24fps。

ControlNet插件:精准控制的创作革命

ControlNet作为Stable Diffusion最具影响力的插件系统,通过引入额外条件控制生成过程,实现了从"黑箱"到可控创作的转变。最新版本支持14种不同控制类型,包括Canny边缘检测、Depth深度估计、Openpose姿态控制等。

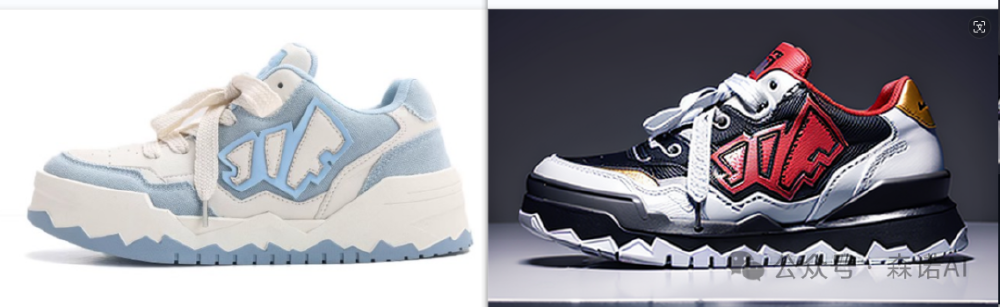

如上图所示,两张风格相似的运动鞋对比图,左侧为蓝白配色款式,右侧为红黑配色款式,展示了Stable Diffusion的ControlNet插件在商品图像生成(如线稿转绘、风格上色)中的应用效果。这一技术使得设计师能够快速生成同一产品的多种风格变体,大幅提升了设计效率和创意多样性。

行业应用案例:从设计工具到生产力革命

电商零售:视觉内容生产的降本增效

某头部服装品牌应用Stable Diffusion构建虚拟模特系统,通过输入服装参数(材质、颜色、版型)和场景描述,自动生成符合品牌调性的商品展示图。该系统使视觉内容制作周期从72小时缩短至4小时,单图成本降低85%,同时支持A/B测试不同风格组合,转化率提升12%。

具体实现流程包括:使用3D Openpose提取模特姿态,通过ControlNet的Canny边缘控制确保服装轮廓准确,结合商品蒙版技术实现服装与模特的精准融合。这种技术方案使电商平台能够快速生成海量产品展示图,大幅降低传统摄影的时间和经济成本。

医疗健康:辅助诊断的新范式

在放射科领域,Stable Diffusion被用于医学影像增强。通过训练特定器官的LoRA模型,可将低分辨率CT影像重建为高清3D结构,帮助医生更精准识别早期肺结节。某三甲医院的临床测试显示,该技术将微小病灶检出率提升23%,诊断时间缩短40%。

教育出版:个性化教材的规模化生产

教育科技公司利用Stable Diffusion开发动态插图生成工具,教师输入知识点描述即可获得匹配的教学图像。该工具已支持15种学科风格模板,包括分子结构示意图、历史场景还原等专业内容,使教材更新效率提升300%,个性化教学材料成本降低70%。

未来趋势:扩散模型的边界拓展

多模态融合加速

Stable Diffusion正从单一图像生成向多模态创作演进。最新测试版已支持文本-图像-视频的连贯生成,用户输入"清晨森林中的小鹿",可同时获得静态插画和10秒动画片段。这种能力为游戏开发、广告制作等行业提供了端到端解决方案。

边缘计算的普及

随着AMD等硬件厂商推出专用优化(如针对XDNA 2 NPU的BF16精度模型),Stable Diffusion正快速向边缘设备渗透。2025年新发布的轻薄本已能本地运行SD3.5基础模型,15秒内生成512×512图像,这为移动创作、现场设计等场景开辟了新可能。

伦理与规范的协同建设

面对AI生成内容的版权争议,Stability AI联合行业协会推出"来源追踪系统",所有通过官方API生成的图像将嵌入隐形水印,记录模型版本、生成时间和提示词信息。该系统已被Adobe、Figma等设计平台采纳,推动行业向可追溯方向发展。

企业落地建议

对于考虑引入Stable Diffusion的组织,建议采取三步实施策略:

- 试点验证:选择非核心业务场景(如社交媒体素材),评估生成质量与效率提升

- 定制开发:基于通用模型微调行业专用LoRA,如电商的"产品摄影风格"或医疗的"器官成像模板"

- 流程重构:将AI生成环节嵌入现有工作流,如设计团队的"AI初稿+人工精修"新模式

随着技术持续迭代,Stable Diffusion已从单纯的图像生成工具,进化为重构视觉内容生产链条的基础设施。对于企业而言,现在正是布局这一技术的关键窗口期,既能享受开源生态的成本优势,又可通过定制化开发构建差异化竞争力。

项目地址: https://ai.gitcode.com/hf_mirrors/bdsqlsz/stable-diffusion-v1-5

【免费下载链接】stable-diffusion-v1-5

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考