参考文档Tutorial/docs/L2/LMDeploy/task.md at camp4 · InternLM/Tutorial (github.com)

1 配置LMDeploy环境

1.1 环境搭建

开发机创建应选择 30%A100*1(24GB显存容量),Cuda12.2-conda镜像。

创建名为lmdeploy的conda环境,python版本为3.10,创建成功后激活环境并安装0.5.3版本的lmdeploy及相关包。

conda create -n lmdeploy python=3.10 -y

conda activate lmdeploy

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia -y

pip install timm==1.0.8 openai==1.40.3 lmdeploy[all]==0.5.3

pip install datasets==2.19.21.2 InternStudio环境获取模型

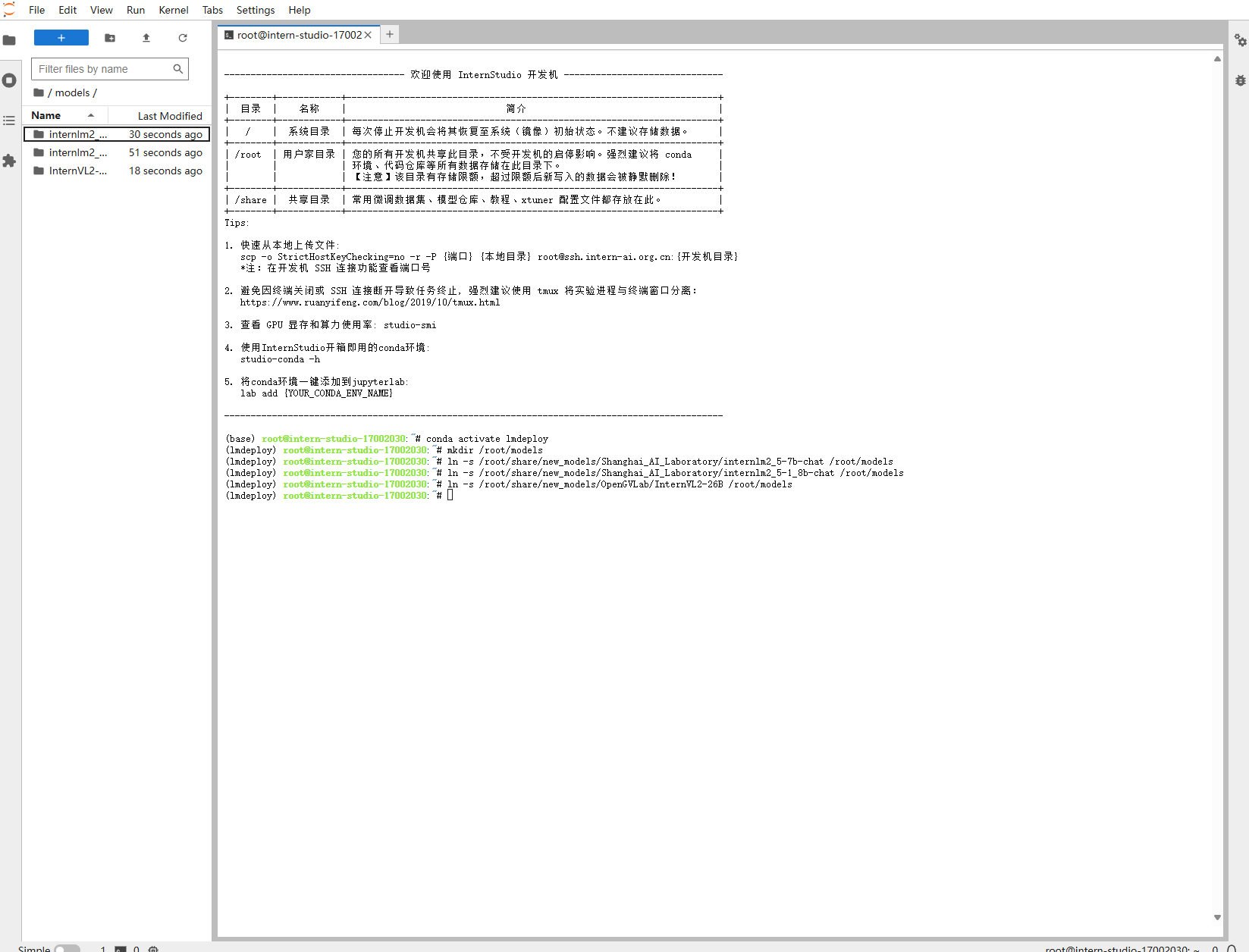

运行以下命令,创建文件夹并设置开发机共享目录的软链接。

mkdir /root/models

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2_5-7b-chat /root/models

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2_5-1_8b-chat /root/models

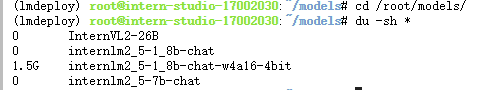

ln -s /root/share/new_models/OpenGVLab/InternVL2-26B /root/models可以看到/root/models中会出现internlm2_5-7b-chat、internlm2_5-1_8b-chat和InternVL2-26B文件夹。

使用internlm2_5-1_8b-chat模型

1.3 LMDeploy验证启动模型文件

在量化工作正式开始前,我们还需要验证一下获取的模型文件能否正常工作

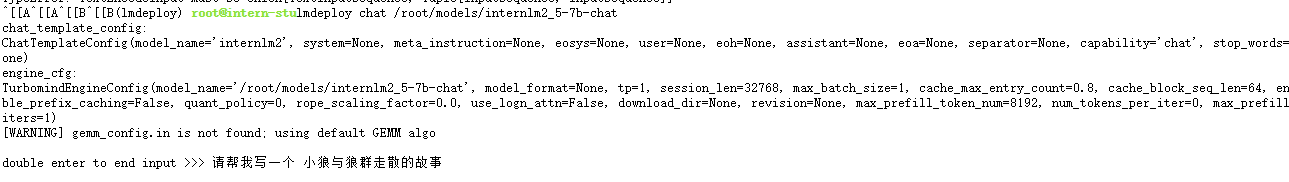

让我们进入创建好的conda环境并启动InternLM2_5-7b-chat!

conda activate lmdeploy

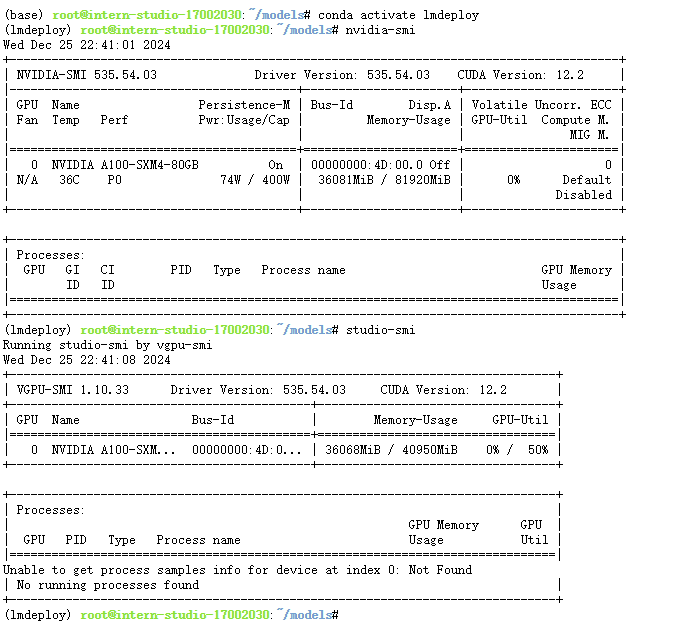

lmdeploy chat /root/models/internlm2_5-7b-chat启动成功后,会显示如下。

可以在CLI(“命令行界面” Command Line Interface的缩写)中和InternLM2.5尽情对话了,注意输入内容完成后需要按两次回车才能够执行,以下为示例。

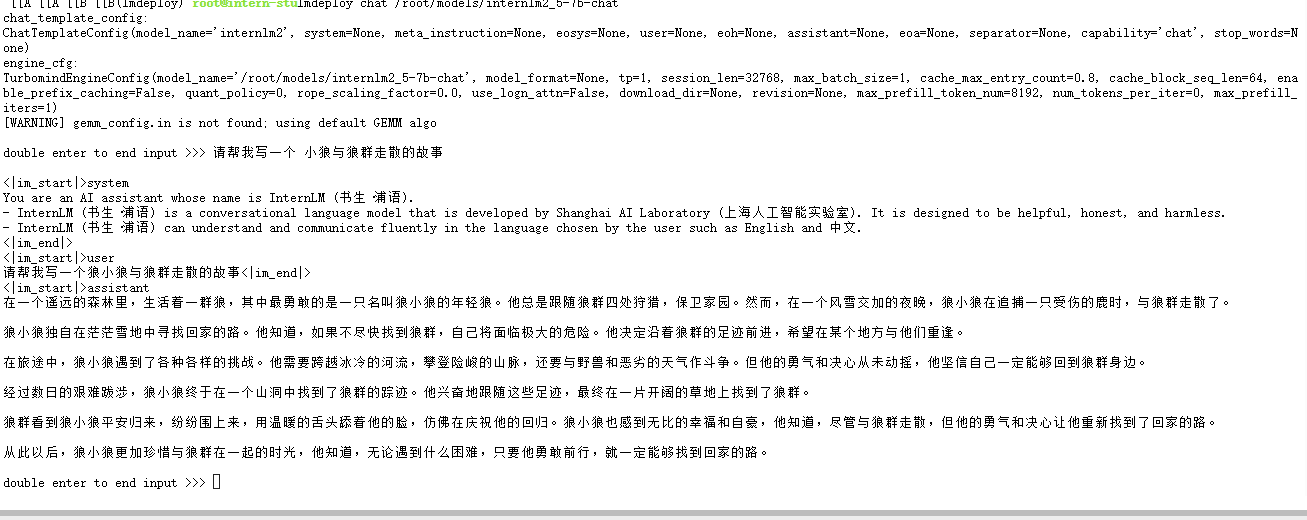

我选择 50%A100*1 建立机器,运行InternLM2.5 7B模型,此时显存占用为36GB。

![]()

由上文可知InternLM2.5 7B模型为bf16,LMDpeloy推理精度为bf16的7B模型权重需要占用14GB显存;如下图所示,lmdeploy默认设置cache-max-entry-count为0.8,即kv cache占用剩余显存的80%;

此时对于24GB的显卡,即30%A100,权重占用14GB显存,剩余显存24-14=10GB,因此kv cache占用10GB*0.8=8GB,加上原来的权重14GB,总共占用14+8=22GB。

而对于40GB的显卡,即50%A100,权重占用14GB,剩余显存40-14=26GB,因此kv cache占用26GB*0.8=20.8GB,加上原来的权重14GB,总共占用34.8GB。

实际加载模型后,其他项也会占用部分显存,因此剩余显存比理论偏低,实际占用会略高于22GB和34.8GB。

此外,如果想要实现显存资源的监控,我们也可以新开一个终端输入如下两条指令的任意一条,查看命令输入时的显存占用情况。

nvidia-smi

studio-smi

注释:实验室提供的环境为虚拟化的显存,nvidia-smi是NVIDIA GPU驱动程序的一部分,用于显示NVIDIA GPU的当前状态,故当前环境只能看80GB单卡 A100 显存使用情况,无法观测虚拟化后30%或50%A100等的显存情况。针对于此,实验室提供了studio-smi 命令工具,能够观测到虚拟化后的显存使用情况。

2 LMDeploy与InternLM2.5

2.1 LMDeploy API部署InternLM2.5

在实际应用中,将大模型封装为API接口服务,供客户端访问也十分常见。

2.1.1 启动API服务器

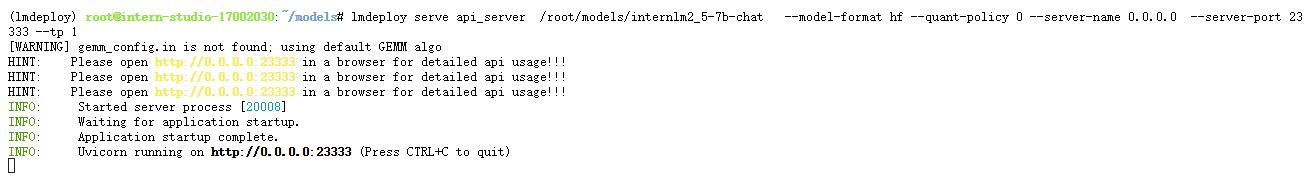

进入创建好的conda环境,并通下命令启动API服务器,部署InternLM2.5模型:

conda activate lmdeploy

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 0 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1命令解释:

lmdeploy serve api_server:这个命令用于启动API服务器。/root/models/internlm2_5-7b-chat:这是模型的路径。--model-format hf:这个参数指定了模型的格式。hf代表“Hugging Face”格式。--quant-policy 0:这个参数指定了量化策略。--server-name 0.0.0.0:这个参数指定了服务器的名称。在这里,0.0.0.0是一个特殊的IP地址,它表示所有网络接口。--server-port 23333:这个参数指定了服务器的端口号。在这里,23333是服务器将监听的端口号。--tp 1:这个参数表示并行数量(GPU数量)。

稍待片刻,终端显示如下。

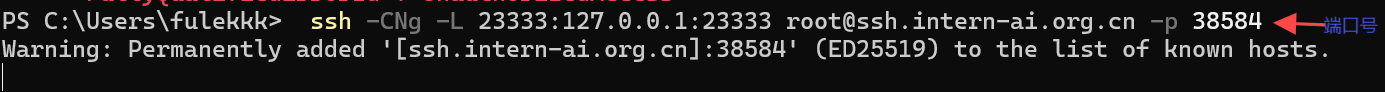

这一步由于部署在远程服务器上,所以本地需要做一下ssh转发才能直接访问。电脑打开一个cmd或powershell窗口,输入命令如下:

ssh -CNg -L 23333:127.0.0.1:23333 root@ssh.intern-ai.org.cn -p 你的ssh端口号

设置过自定义服务了,所以直接连上了,如果之前没有成功设置或没有设置.

要求输入密码的时候按照下图操作

把密码复制过去不会显示,直接回车就好。

如上上图所示即为连接成功,保留本机终端窗口

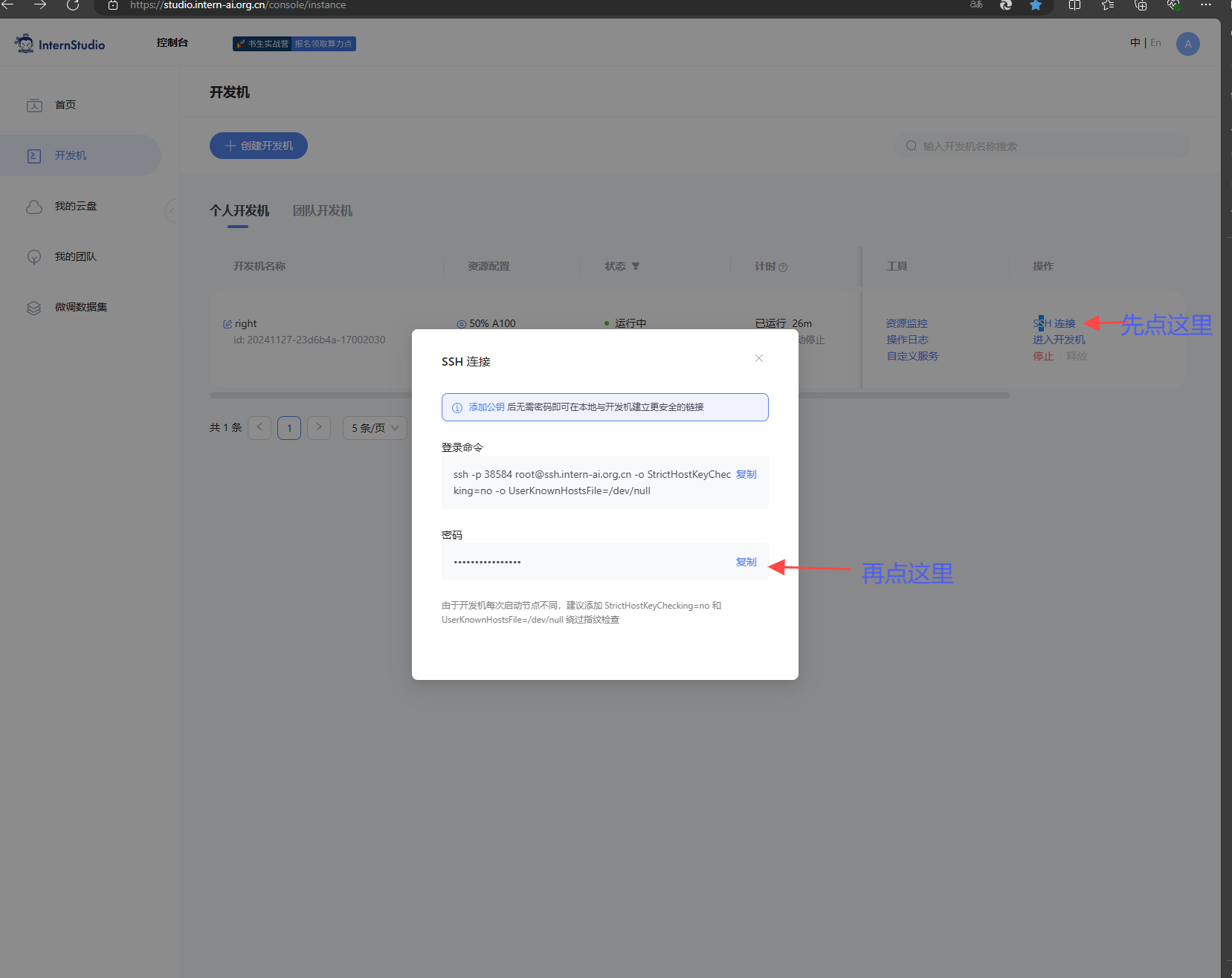

然后打开浏览器,访问http://127.0.0.1:23333看到如下界面即代表部署成功。

2.1.2 以命令行形式连接API服务器

关闭http://127.0.0.1:23333网页,但保持终端和本地窗口不动,在开发机里新建一个终端。

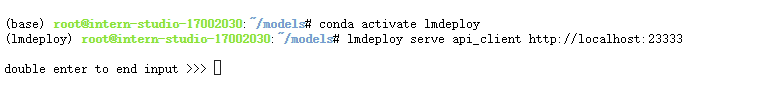

运行如下命令,激活conda环境并启动命令行客户端。

conda activate lmdeploy

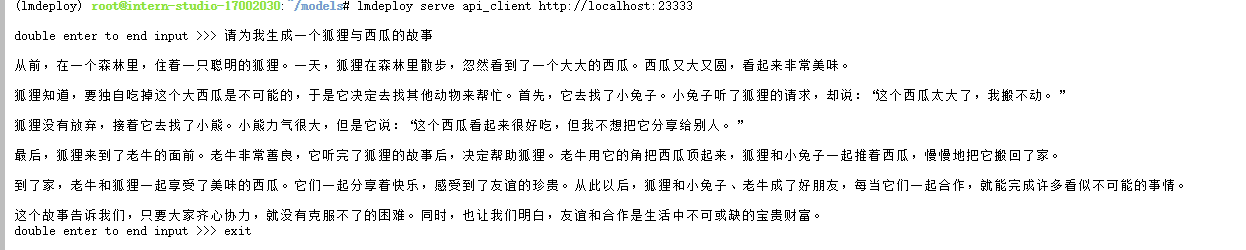

lmdeploy serve api_client http://localhost:23333稍待片刻,等出现double enter to end input >>>的输入提示即启动成功,此时便可以随意与InternLM2.5对话,同样是两下回车确定,输入exit退出。

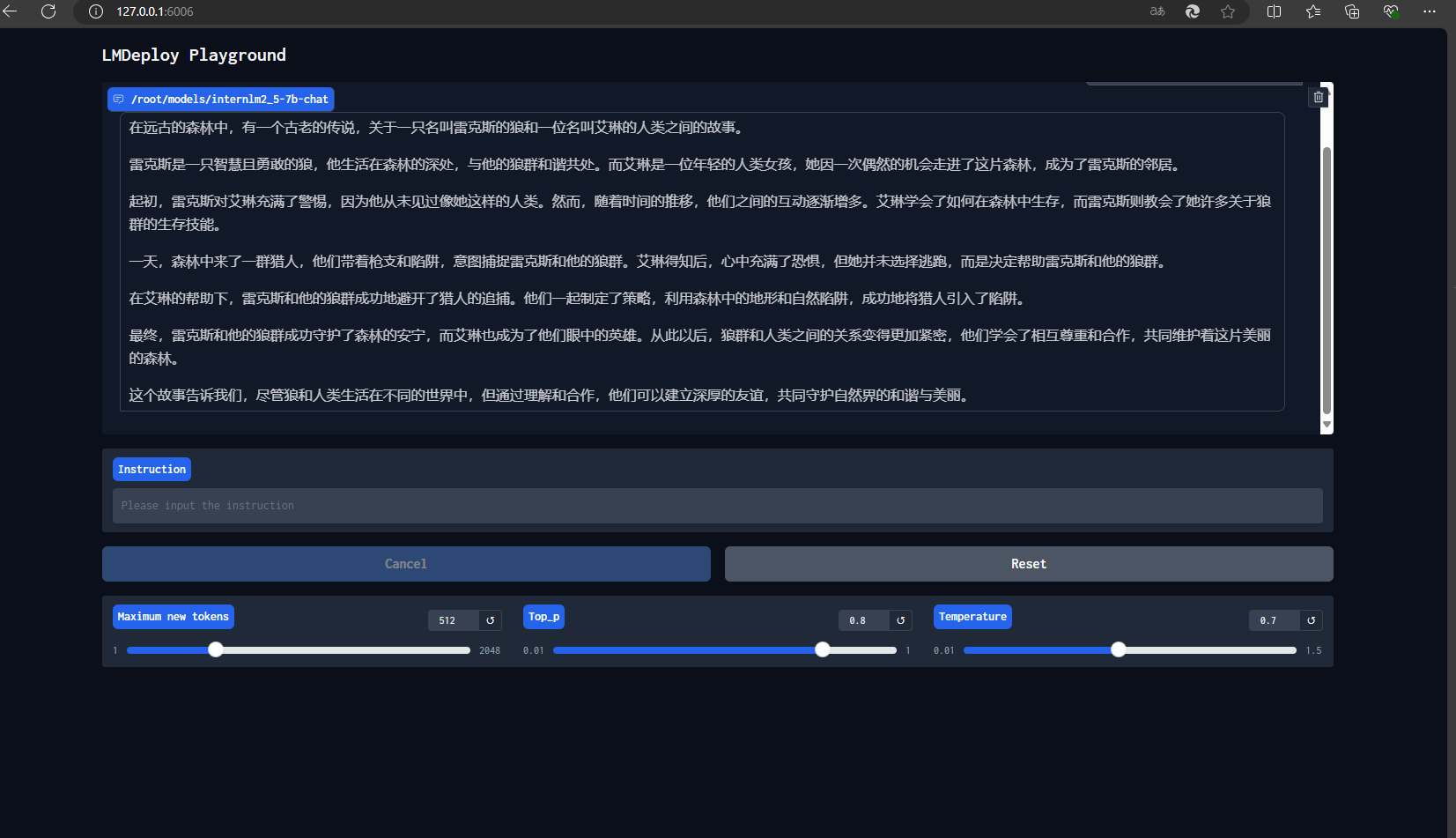

2.1.3 以Gradio网页形式连接API服务器

保持第一个终端不动,在新建终端中输入exit退出

输入以下命令,使用Gradio作为前端,启动网页。

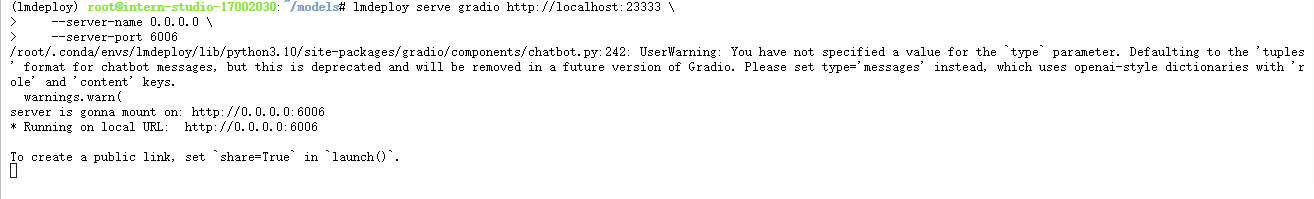

lmdeploy serve gradio http://localhost:23333 \

--server-name 0.0.0.0 \

--server-port 6006稍待片刻,等终端如下图所示便保持两个终端不动。

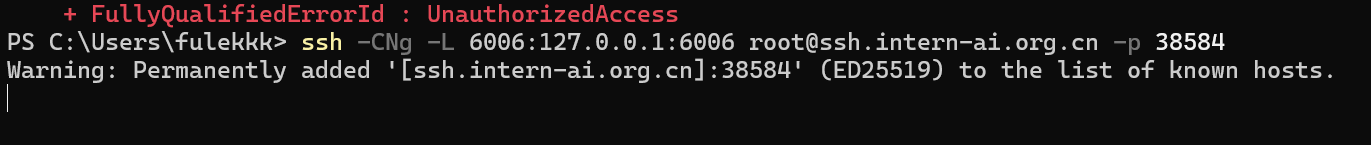

关闭之前的cmd/powershell窗口,重开一个,再次做一下ssh转发(因为此时端口不同)。在你本地打开一个cmd或powershell窗口,输入命令如下。

ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p <你的ssh端口号>重复上述操作,待窗口保持在如下状态即可。

打开浏览器,访问地址http://127.0.0.1:6006,然后就可以与模型尽情对话了。

2.2 LMDeploy Lite

随着模型变得越来越大,我们需要一些大模型压缩技术来降低模型部署的成本,并提升模型的推理性能。LMDeploy 提供了权重量化和 k/v cache两种策略。

2.2.1 设置最大kv cache缓存大小

KV Cache 是一种在大型语言模型(LLM)中广泛应用的技术,其核心在于存储和复用推理过程中产生的键值对(Key-Value Pairs),以避免重复计算,从而提高模型的推理效率。在 Transformer 架构中,KV Cache 缓存已计算的 Key 和 Value 矩阵,特别适用于自回归生成任务,使模型能够高效利用历史信息,类似于人类的短期记忆。

模型运行时的显存占用主要分为三部分:模型参数、KV Cache 和中间计算结果。为优化显存管理,LMDeploy 提供了 KV Cache 管理器,通过 --cache-max-entry-count 参数控制 KV Cache 的显存使用比例,默认值为 0.8,保证高效缓存的同时优化显存利用。

InternLM2.5正常运行时占用显存。

![]()

执行以下命令,再来观看占用显存情况。

lmdeploy chat /root/models/internlm2_5-7b-chat --cache-max-entry-count 0.4稍待片刻,观测显存占用情况,可以看到减少了约10GB的显存。

![]()

之前的情况

在 BF16 精度下,7B 模型权重占用 14GB:

70×109 parameters×2 Bytes/parameter=14 GB

剩余显存为 40GB - 14GB = 26GB

kv cache 默认占用 80%:

26 GB×0.8=20.8 GB

其他项占用 1GB

因此,总显存占用为:

14 GB+20.8 GB+1 GB=35.8 GB

之后的情况

模型权重占用:

在 BF16 精度下,7B 模型权重占用 14GB(与之前一致)

kv cache 占用:

剩余显存为 40GB - 14GB = 26GB

kv cache 修改为占用 40%:

26 GB×0.4=10.4 GB

其他项:

其他项占用 1GB

总显存占用为:14 GB+10.4 GB+1 GB=25.4 GB

减少的显存占用为:

20.8 GB−10.4 GB=10.4 GB

因此,50% A100 的开发机显存减少了10.4 GB。

2.2.2 设置在线 kv cache int4/int8 量化

从 v0.4.0 开始,LMDeploy 支持对在线 KV Cache 进行 int4/int8 量化,其量化方式采用 per-head per-token 的非对称量化。这种量化技术能够进一步降低显存占用,同时保持较高的推理效率和模型性能。

使用 LMDeploy 应用 KV 量化非常简单,只需设置以下两个参数:

-

quant_policy:指定 KV Cache 的量化方式:-

quant_policy=4:启用 KV Cache 的 int4 量化。 -

quant_policy=8:启用 KV Cache 的 int8 量化。

-

-

cache-max-entry-count:控制 KV Cache 占用显存的最大比例。

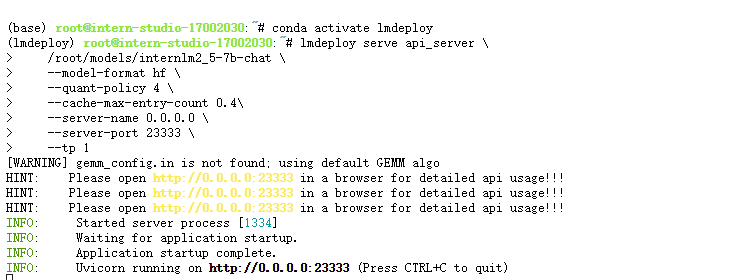

通过2.1 LMDeploy API部署InternLM2.5的实践为例,输入以下指令,启动API服务器。

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 4 \

--cache-max-entry-count 0.4\

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1稍等片刻,显示如下图即为启动成功。

此时显存占用约25GB

相较于1.3 LMDeploy验证启动模型文件直接启动模型的显存占用情况(35GB)减少了10GB的占用。此时10GB显存的减少逻辑与2.2.1 设置最大kv cache缓存大小中4GB显存的减少一致,均因设置kv cache占用参数cache-max-entry-count至0.4而减少了10GB显存占用。

![]()

2.2.3 W4A16 模型量化和部署

模型量化是一种模型优化技术,其核心目标是降低机器学习模型的计算复杂度和存储需求,同时尽量保持模型性能。这一过程涉及将模型中的浮点数权重和激活值映射到低精度的表示形式,如整数格式。具体来说:

- 精度降低:量化将模型参数从较高的位宽(例如32位浮点数)转换为较低的位宽(例如8位、4位或更低位宽的整数)。

- 存储和计算效率:通过减少模型参数的位宽,量化可以减少模型的存储占用,并降低计算资源消耗,因为整数运算通常比浮点运算更快、更节能。

- 硬件兼容性:量化后的模型更适合在硬件上运行,尤其是那些不支持或不高效执行浮点运算的硬件平台,如嵌入式设备和移动设备。

- 性能保持:尽管量化会降低模型的数值精度,但通过精心设计和训练,量化模型可以在保持相当性能的同时实现上述优势。

- 量化策略:量化策略包括对称量化、非对称量化、动态量化和量化感知训练等,每种策略都有其特定的应用场景和优缺点。

- 模型性能:量化可能会对模型的精度和泛化能力产生影响,因此需要通过实验和调优来确定最佳的量化策略和位宽,以平衡模型性能和效率。

W4A16是一种模型量化技术,具体含义如下:

- W4:表示权重(weight)量化为4位整数(int4)。这意味着模型中的权重参数将从它们原始的浮点表示(例如FP32、BF16或FP16)转换为4位的整数表示,从而显著减少模型的大小。

- A16:表示激活(Activate)保持在16位浮点数(例如FP16或BF16)。激活是在神经网络中传播的数据,通常在每层运算之后产生,保持16位浮点数可以减少精度损失,保持模型性能。

通过这种量化技术,可以显著降低模型的显存占用,并提高推理速度,尤其是在小批量推理场景下。

让我们回到LMDeploy,在最新的版本中,LMDeploy使用的是AWQ算法,能够实现模型的4bit权重量化。

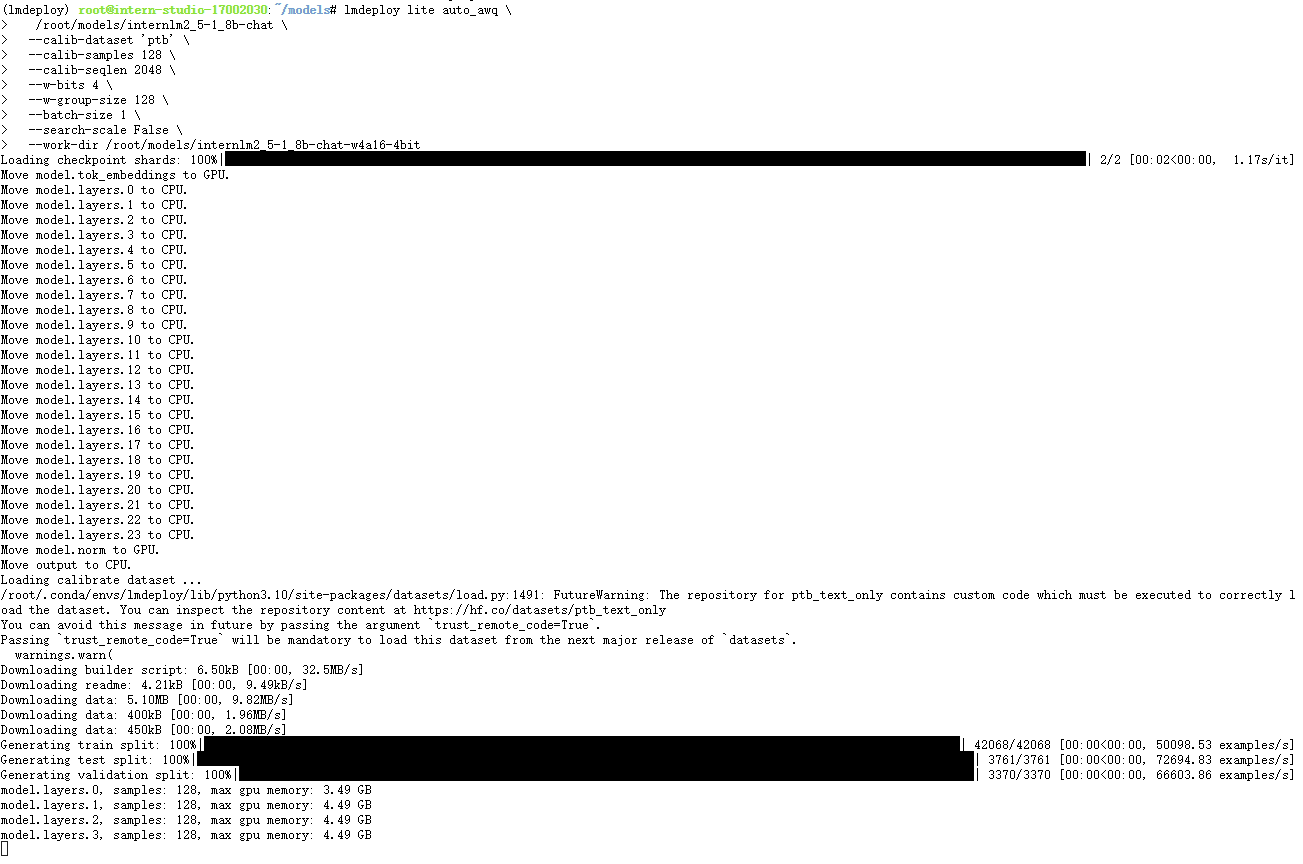

此处对1.8B模型进行量化:

lmdeploy lite auto_awq \

/root/models/internlm2_5-1_8b-chat \

--calib-dataset 'ptb' \

--calib-samples 128 \

--calib-seqlen 2048 \

--w-bits 4 \

--w-group-size 128 \

--batch-size 1 \

--search-scale False \

--work-dir /root/models/internlm2_5-1_8b-chat-w4a16-4bit命令解释:

lmdeploy lite auto_awq:lite这是LMDeploy的命令,用于启动量化过程,而auto_awq代表自动权重量化(auto-weight-quantization)。/root/models/internlm2_5-7b-chat: 模型文件的路径。--calib-dataset 'ptb': 这个参数指定了一个校准数据集,这里使用的是’ptb’(Penn Treebank,一个常用的语言模型数据集)。--calib-samples 128: 这指定了用于校准的样本数量—128个样本--calib-seqlen 2048: 这指定了校准过程中使用的序列长度—2048--w-bits 4: 这表示权重(weights)的位数将被量化为4位。--work-dir /root/models/internlm2_5-7b-chat-w4a16-4bit: 这是工作目录的路径,用于存储量化后的模型和中间结果。

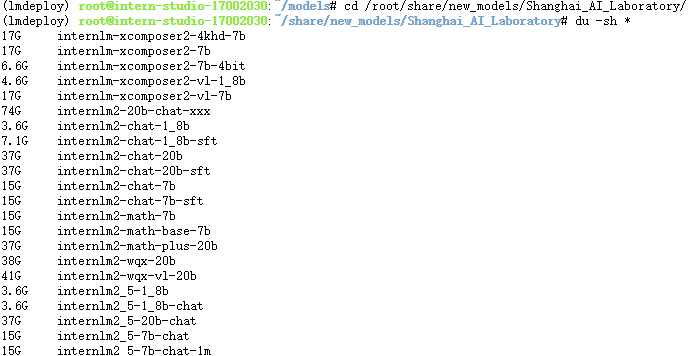

等终端输出如下时,说明正在推理中,稍待片刻。

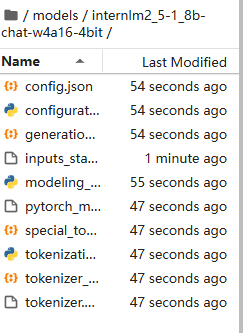

等待推理完成,便可以直接在你设置的目标文件夹看到对应的模型文件。

那么推理后的模型和原本的模型区别在哪里呢?最明显的两点是模型文件大小以及占据显存大小。

我们可以输入如下指令查看在当前目录中显示所有子目录的大小。

cd /root/models/

du -sh *输出结果如下。(其余文件夹都是以软链接的形式存在的,不占用空间,故显示为0)

那么原模型大小呢?输入以下指令查看。

cd /root/share/new_models/Shanghai_AI_Laboratory/

du -sh *

3.6G>1.5G

那么显存占用情况对比呢?输入以下指令启动量化后的模型。

lmdeploy chat /root/models/internlm2_5-7b-chat-w4a16-4bit --model-format awq稍待片刻,我们直接观测右上角的显存占用情况。

![]()

35=>33,W4A16量化后的模型少了约2GB的显存占用。

2.2.4 W4A16 量化+ KV cache+KV cache 量化

输入以下指令,让我们同时启用量化后的模型、设定kv cache占用和kv cache int4量化。

lmdeploy serve api_server \

/root/models/internlm2_5-1_8b-chat-w4a16-4bit/ \

--model-format awq \

--quant-policy 4 \

--cache-max-entry-count 0.4\

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1此时显存占用17G

![]()

3 LMDeploy与InternVL2

3.1 LMDeploy Lite

InternVL2-26B需要约70+GB显存,为了能在开发机上成功运行,我们先进行量化操作,这也是量化本身的意义所在——即降低模型部署成本。

3.1.1 W4A16 模型量化和部署

针对InternVL系列模型,让我们先进入conda环境,并输入以下指令,执行模型的量化工作。(本步骤耗时较长,请耐心等待)

conda activate lmdeploy

lmdeploy lite auto_awq \

/root/models/InternVL2-26B \

--calib-dataset 'ptb' \

--calib-samples 128 \

--calib-seqlen 2048 \

--w-bits 4 \

--w-group-size 128 \

--batch-size 1 \

--search-scale False \

--work-dir /root/models/InternVL2-26B-w4a16-4bit等终端输出如下时,说明正在推理中,稍待片刻。

3.2 LMDeploy API部署InternVL2

通过以下命令启动API服务器,部署InternVL2模型:

lmdeploy serve api_server \

/root/models/InternVL2-26B-w4a16-4bit/ \

--model-format awq \

--quant-policy 4 \

--cache-max-entry-count 0.1 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1其余步骤与2.1.1 启动API服务器剩余内容一致。

命令行形式、Gradio网页形式连接操作与

以下为Gradio网页形式连接成功后对话截图。

4 LMDeploy之FastAPI与Function call

4.1 API开发

与之前一样,让我们进入创建好的conda环境并输入指令启动API服务器。

conda activate lmdeploy

lmdeploy serve api_server \

/root/models/internlm2_5-1_8b-chat-w4a16-4bit \

--model-format awq \

--cache-max-entry-count 0.4 \

--quant-policy 4 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1保持终端窗口不动,新建一个终端。

在新建终端中输入如下指令,新建internlm2_5.py。

touch /root/internlm2_5.py将以下内容复制粘贴进internlm2_5.py。

# 导入openai模块中的OpenAI类,这个类用于与OpenAI API进行交互

from openai import OpenAI

# 创建一个OpenAI的客户端实例,需要传入API密钥和API的基础URL

client = OpenAI(

api_key='YOUR_API_KEY',

# 替换为你的OpenAI API密钥,由于我们使用的本地API,无需密钥,任意填写即可

base_url="http://0.0.0.0:23333/v1"

# 指定API的基础URL,这里使用了本地地址和端口

)

# 调用client.models.list()方法获取所有可用的模型,并选择第一个模型的ID

# models.list()返回一个模型列表,每个模型都有一个id属性

model_name = client.models.list().data[0].id

# 使用client.chat.completions.create()方法创建一个聊天补全请求

# 这个方法需要传入多个参数来指定请求的细节

response = client.chat.completions.create(

model=model_name,

# 指定要使用的模型ID

messages=[

# 定义消息列表,列表中的每个字典代表一个消息

{"role": "system", "content": "你是一个友好的小助手,负责解决问题."},

# 系统消息,定义助手的行为

{"role": "user", "content": "帮我讲述一个关于狐狸和西瓜的小故事"},

# 用户消息,询问时间管理的建议

],

temperature=0.8,

# 控制生成文本的随机性,值越高生成的文本越随机

top_p=0.8

# 控制生成文本的多样性,值越高生成的文本越多样

)

# 打印出API的响应结果

print(response.choices[0].message.content)按Ctrl+S键保存(Mac用户按Command+S)。

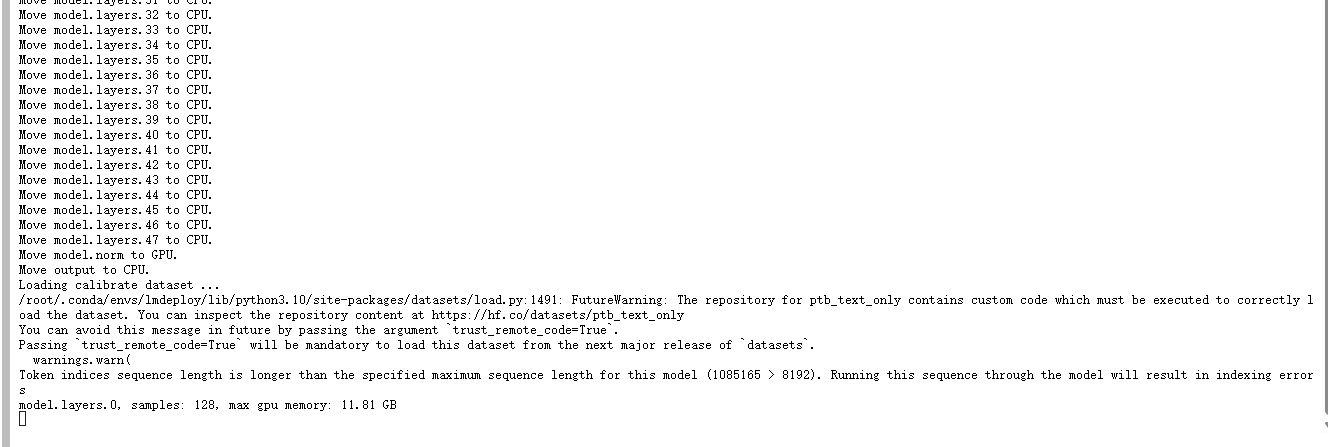

现在让我们在新建终端输入以下指令激活环境并运行python代码。

conda activate lmdeploy

python /root/internlm2_5.py终端会输出如下结果。

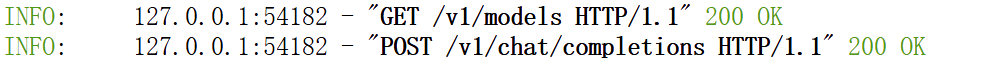

此时代表我们成功地使用本地API与大模型进行了一次对话,如果切回第一个终端窗口,会看到如下信息,这代表其成功的完成了一次用户问题GET与输出POST。

4.2 Function call

首先让我们进入创建好的conda环境并启动API服务器。

conda activate lmdeploy

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat \

--model-format hf \

--quant-policy 0 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1目前LMDeploy在0.5.3版本中支持了对InternLM2, InternLM2.5和llama3.1这三个模型,故我们选用InternLM2.5 封装API。

让我们使用一个简单的例子作为演示。输入如下指令,新建internlm2_5_func.py。

touch /root/internlm2_5_func.py双击打开,并将以下内容复制粘贴进internlm2_5_func.py。

from openai import OpenAI

def add(a: int, b: int):

return a + b

def mul(a: int, b: int):

return a * b

tools = [{

'type': 'function',

'function': {

'name': 'add',

'description': 'Compute the sum of two numbers',

'parameters': {

'type': 'object',

'properties': {

'a': {

'type': 'int',

'description': 'A number',

},

'b': {

'type': 'int',

'description': 'A number',

},

},

'required': ['a', 'b'],

},

}

}, {

'type': 'function',

'function': {

'name': 'mul',

'description': 'Calculate the product of two numbers',

'parameters': {

'type': 'object',

'properties': {

'a': {

'type': 'int',

'description': 'A number',

},

'b': {

'type': 'int',

'description': 'A number',

},

},

'required': ['a', 'b'],

},

}

}]

messages = [{'role': 'user', 'content': 'Compute (3+5)*2'}]

client = OpenAI(api_key='YOUR_API_KEY', base_url='http://0.0.0.0:23333/v1')

model_name = client.models.list().data[0].id

response = client.chat.completions.create(

model=model_name,

messages=messages,

temperature=0.8,

top_p=0.8,

stream=False,

tools=tools)

print(response)

func1_name = response.choices[0].message.tool_calls[0].function.name

func1_args = response.choices[0].message.tool_calls[0].function.arguments

func1_out = eval(f'{func1_name}(**{func1_args})')

print(func1_out)

messages.append({

'role': 'assistant',

'content': response.choices[0].message.content

})

messages.append({

'role': 'environment',

'content': f'3+5={func1_out}',

'name': 'plugin'

})

response = client.chat.completions.create(

model=model_name,

messages=messages,

temperature=0.8,

top_p=0.8,

stream=False,

tools=tools)

print(response)

func2_name = response.choices[0].message.tool_calls[0].function.name

func2_args = response.choices[0].message.tool_calls[0].function.arguments

func2_out = eval(f'{func2_name}(**{func2_args})')

print(func2_out)按Ctrl+S键保存(Mac用户按Command+S)。

这里我有报错,是因为没有在终端中输入以下命令

export token=your api_key #把=后面的换成自己的浦语apitoken现在让我们输入以下指令运行python代码

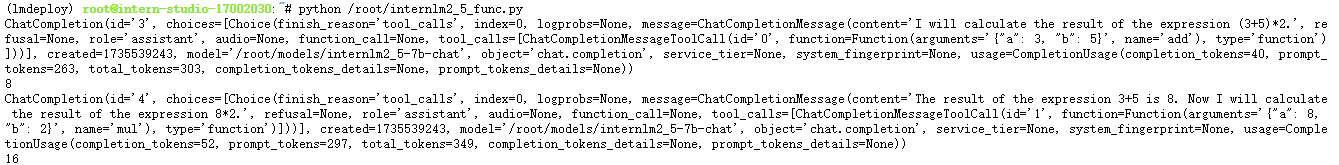

python /root/internlm2_5_func.py稍待片刻终端输出如下。

我们可以看出InternLM2.5将输入'Compute (3+5)*2'根据提供的function拆分成了"加"和"乘"两步,第一步调用function add实现加,再于第二步调用function mul实现乘,再最终输出结果16.

1153

1153

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?