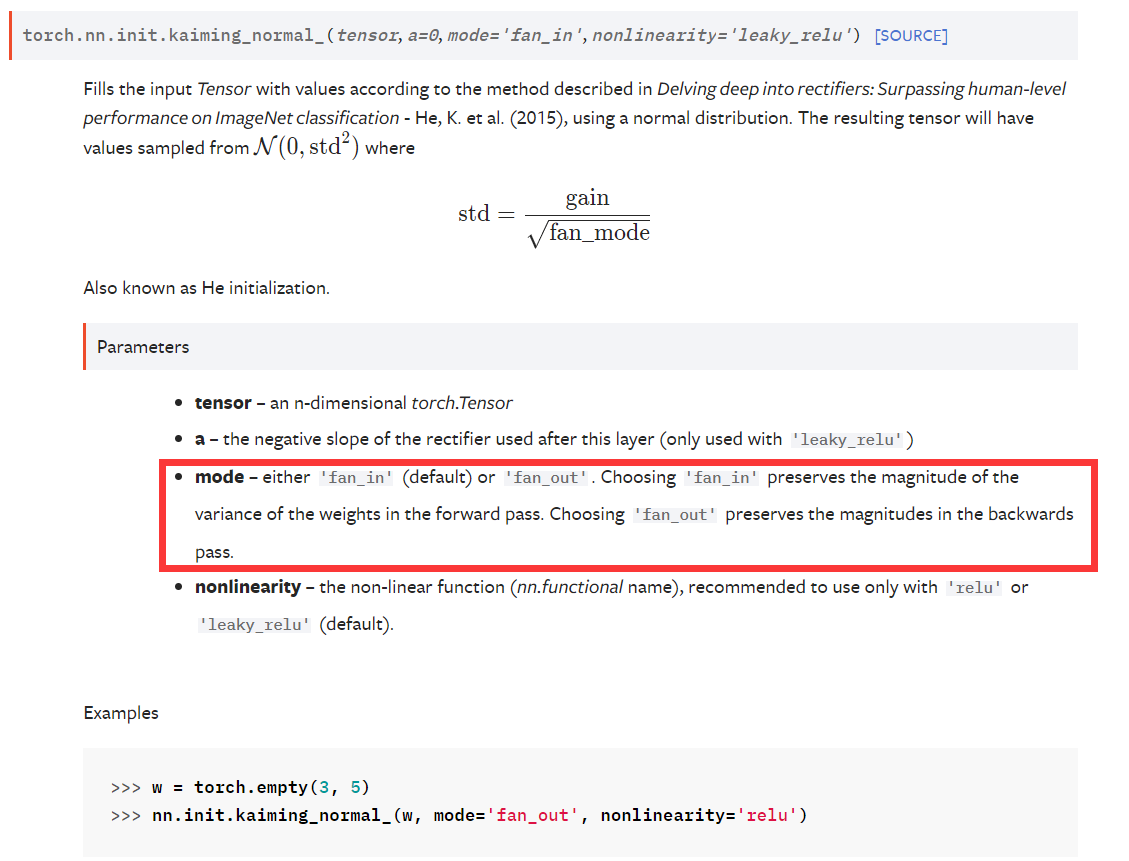

mode:‘fan_in’ (default)或者‘fan_out’. 使用fan_in保持weights的方差在前向传播中不变;使用fan_out保持weights的方差在反向传播中不变。

在使用过程中,一般都要默认设置fan_out

见Pytorch官网详解

Pytorch Kaiming 初始化(Initialization)中fan_in和fan_out的区别

最新推荐文章于 2025-04-22 09:02:26 发布

在PyTorch中,权重初始化时可以选择'fan_in'或'fan_out'模式。'fan_in'用于保持前向传播中权重的方差不变,而'fan_out'则确保反向传播中的方差稳定。通常推荐使用默认的'fan_out'设置,以保证在网络训练过程中的稳定性。

在PyTorch中,权重初始化时可以选择'fan_in'或'fan_out'模式。'fan_in'用于保持前向传播中权重的方差不变,而'fan_out'则确保反向传播中的方差稳定。通常推荐使用默认的'fan_out'设置,以保证在网络训练过程中的稳定性。

部署运行你感兴趣的模型镜像

您可能感兴趣的与本文相关的镜像

PyTorch 2.7

PyTorch

Cuda

PyTorch 是一个开源的 Python 机器学习库,基于 Torch 库,底层由 C++ 实现,应用于人工智能领域,如计算机视觉和自然语言处理

6540

6540

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?