目录

一、工具定位与目标

工具名称:COZE 智能音乐生成器

核心目标:用户输入主题、情绪、时长等需求参数后,COZE 平台基于音乐生成模型与音频处理技术,自动创作符合场景需求的背景音乐,支持多格式导出与个性化调整,为视频制作、游戏开发、直播等场景提供高效的音乐素材解决方案。

应用场景:

- 短视频 / 影视配乐(如DY、B 战视频背景音乐);

- 游戏 / 动画音效设计(如冒险游戏战斗音乐、休闲游戏背景音乐);

- 商业场景氛围营造(如商场、餐厅背景音乐);

- 冥想 / 学习辅助音乐(如白噪音、轻音乐)。

二、核心功能模块设计

1. 需求解析与特征提取模块

- 语义理解与转化:

- 用户输入文本描述(如 “激昂的战斗背景音乐”“舒缓的冥想音乐”),COZE 通过 NLP 技术解析关键词,提取情绪特征(如快乐 / 悲伤)、风格特征(如古典 / 电子)、节奏特征(如快 / 慢);

- 支持直接选择预设场景模板(如 “恐怖电影”“运动健身”),系统自动匹配对应音乐特征参数。

- 参数化音乐设计:

- 提供 BPM(每分钟节拍数)、调式(如 C 大调)、乐器组合(如钢琴 + 弦乐)等专业参数调整;

- 支持动态调整音乐结构(如前奏 - 主歌 - 副歌 - 尾声)与情绪曲线(如渐强、突转)。

2. 音乐生成模块

- 模型选择与协作:

- 集成 多模态生成模型,根据需求选择最优模型组合;

- 针对不同音乐风格(如古典、摇滚),使用对应领域的预训练模型进行微调,提升生成质量。

- 条件生成与约束优化:

- 将用户需求转化为模型可理解的条件参数(如 “4/4 拍、F 小调、BPM=120”);

- 通过强化学习优化生成过程,确保音乐的旋律性、和谐性与原创性。

3. 音频处理与优化模块

- 风格融合与混音:

- 支持将生成的主旋律与预置的鼓点、和声等元素混合,增强音乐层次感;

- 实现不同音乐风格的融合(如 “古风 + 电子”),满足个性化需求。

- 智能剪辑与适配:

- 根据指定时长自动剪辑音乐,保持结构完整性;

- 提供淡入淡出、音量渐变等效果,适配不同播放场景。

4. 交互与输出模块

- 实时试听与调整:

- 生成音乐预览片段,支持用户通过滑块调整情绪强度、节奏快慢等参数;

- 提供 “不满意?再生成一次” 功能,快速迭代直至满意。

- 多格式导出:

- 支持 MP3、WAV、AAC 等常见格式,可自定义采样率与比特率;

- 生成音乐版权信息文件,明确授权范围与使用限制。

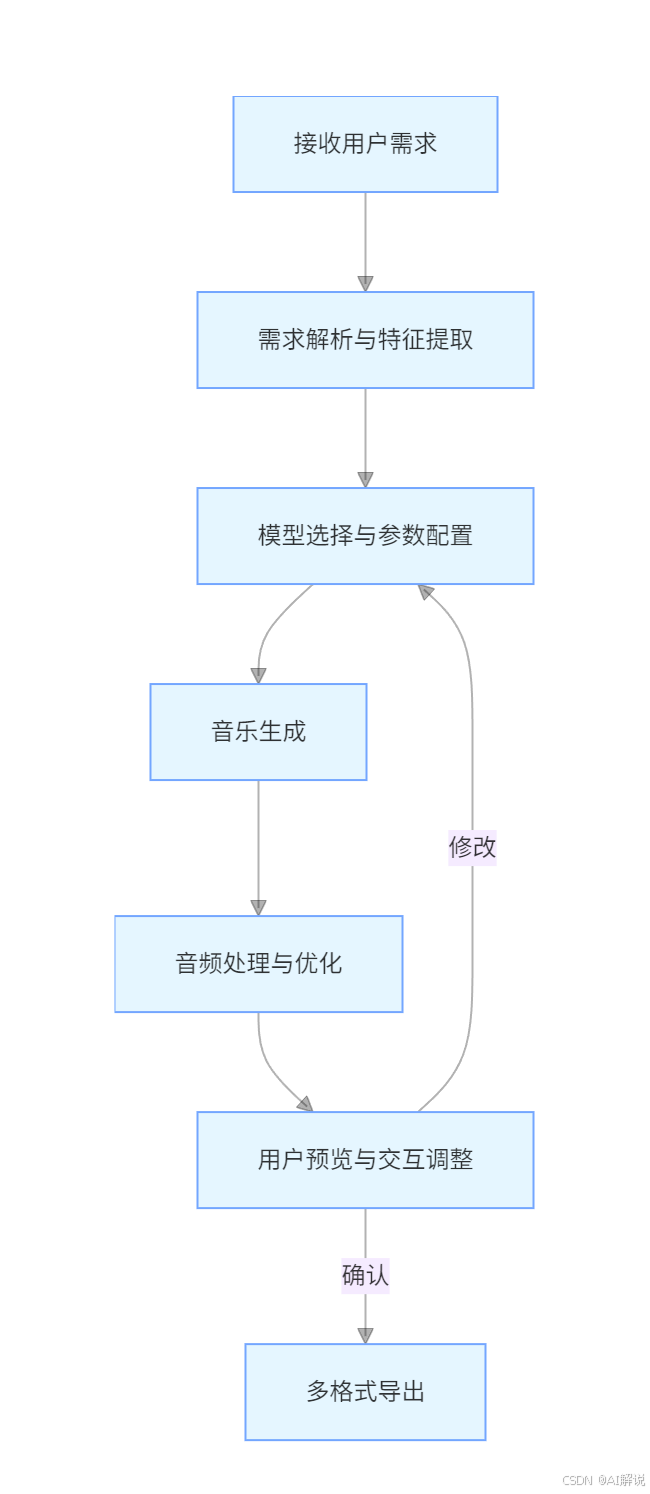

三、COZE 平台搭建流程

1. 触发与输入设计

- 指令触发:用户输入 “生成背景音乐 + 描述”(如 “生成适合瑜伽视频的背景音乐”);

- 参数补充:支持追加指令细化需求(如 “时长 3 分钟,风格:New Age,BPM=80”)。

2. 工作流核心节点配置

3. 关键节点实现细节

- 音乐特征数据库:

- 建立包含 10 万 + 音乐片段的特征库,标注情绪、风格、BPM 等信息;

- 使用对比学习算法,实现用户需求与音乐特征的语义匹配。

- 分布式渲染:

- 采用 GPU 集群加速音乐生成过程,单首 3 分钟音乐生成时间控制在 10 秒内;

- 支持断点续传,避免因网络问题导致生成中断。

四、技术实现与合规性

1. 技术要点

- 多模态对齐:

- 通过 CLIP 等模型实现文本描述与音乐特征的跨模态对齐;

- 引入情感计算技术,将文本中的情绪关键词映射为音乐参数。

- 版权检测:

- 构建音乐指纹库,对生成音乐进行相似度检测;

- 采用区块链技术记录音乐生成过程,确保原创性证明。

2. 合规与安全

- 数据隐私:

- 用户输入的文本描述与调整参数仅用于生成过程,不存储原始数据;

- 支持本地部署版本,满足企业级数据安全需求。

- 版权授权:

- 提供多种授权模式(如个人非商用、企业商用);

- 自动生成音乐版权证书,明确授权范围与使用期限。

五、迭代与扩展方向

- 实时互动生成:

- 接入直播平台 API,根据主播实时话术生成同步背景音乐;

- 支持观众投票影响音乐风格变化,增强互动体验。

- 场景自适应音乐:

- 基于计算机视觉技术,分析视频内容自动匹配背景音乐;

- 实现音乐动态调整(如根据画面节奏加快 BPM)。

- 多轨导出与创作协作:

- 支持导出分轨音频(如钢琴、鼓点单独轨道),方便后期混音;

- 团队协作功能,多人共同编辑同一首音乐项目。

通过整合音乐生成模型与 COZE 平台能力,实现从文本需求到高质量背景音乐的全流程自动化创作。 COZE 的可视化流程搭建能力,可快速实现上述逻辑, 最终形成一个高效、合规的工具。如需进一步细化某个模块,可和我交流、提供更多开发参数或配置细节。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?