调度—>定时任务,分布式调度—>在分布式集群环境下定时任务这件事

Elastic-job(当当⽹开源的分布式调度框架)

一. 定时任务的场景

定时任务形式:每隔⼀定时间/特定某⼀时刻执⾏

例如:

订单审核、出库

订单超时⾃动取消、⽀付退款

礼券同步、⽣成、发放作业

物流信息推送、抓取作业、退换货处理作业

数据积压监控、⽇志监控、服务可⽤性探测作业

定时备份数据

⾦融系统每天的定时结算

数据归档、清理作业

报表、离线数据分析作业

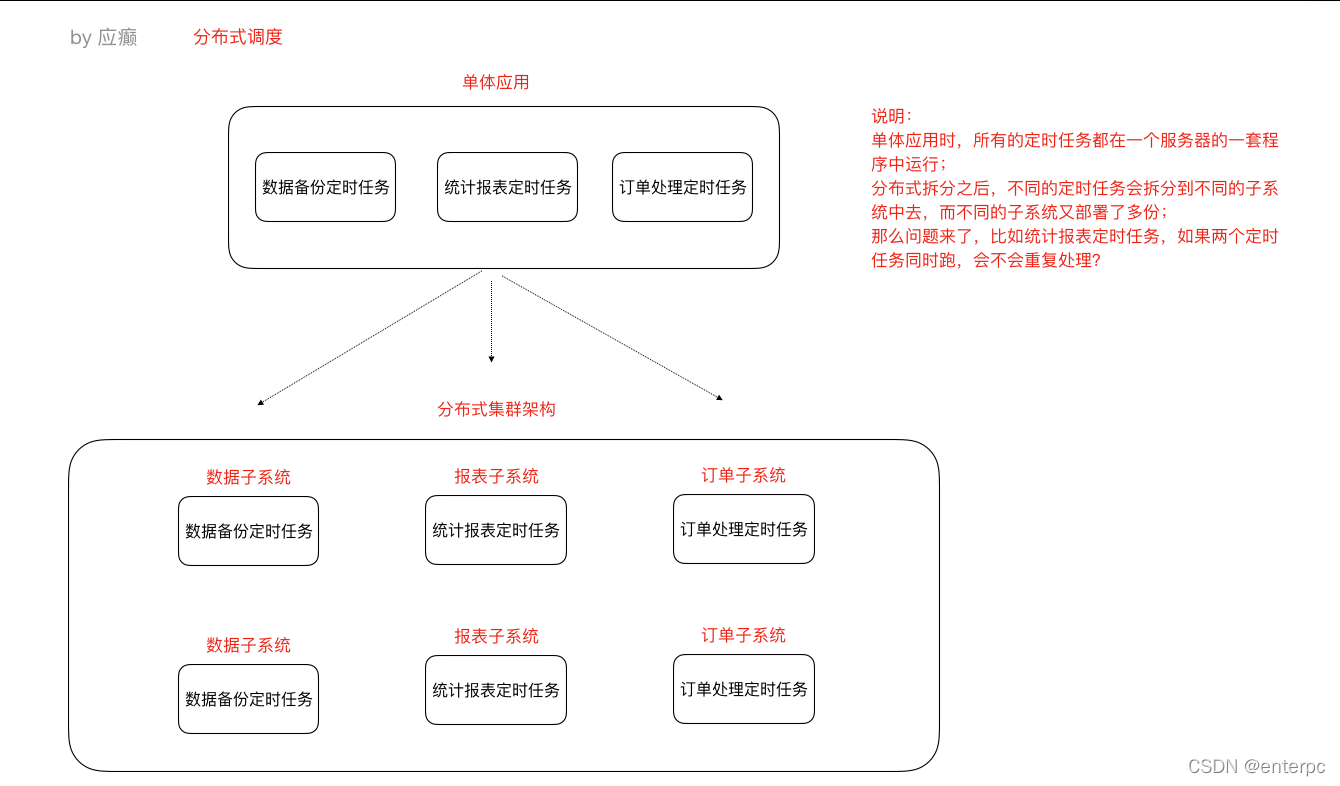

二. 什么是分布式调度

什么是分布式任务调度?有两层含义

1)运⾏在分布式集群环境下的调度任务(同⼀个定时任务程序部署多份,只应该有⼀个定时任务在执⾏)

2)分布式调度—>定时任务的分布式—>定时任务的拆分(即为把⼀个⼤的作业任务拆分为多个⼩的作业任务,同时执⾏)

三. 定时任务与消息队列的区别

(一)共同点

异步处理

⽐如注册、下单事件

应⽤解耦

不管定时任务作业还是MQ都可以作为两个应⽤之间的⻮轮实现应⽤解耦,这个⻮轮可以中转

数据,当然单体服务不需要考虑这些,服务拆分的时候往往都会考虑

流量削峰

双⼗⼀的时候,任务作业和MQ都可以⽤来扛流量,后端系统根据服务能⼒定时处理订单或者

从MQ抓取订单抓取到⼀个订单到来事件的话触发处理,对于前端⽤户来说看到的结果是已经

下单成功了,下单是不受任何影响的

(二)本质不同

定时任务作业是时间驱动,⽽MQ是事件驱动;

时间驱动是不可代替的,⽐如⾦融系统每⽇的利息结算,不是说利息来⼀条(利息到来事件)就算

⼀下,⽽往往是通过定时任务批量计算;

所以,定时任务作业更倾向于批处理,MQ倾向于逐条处理;

四. 定时任务的实现⽅式

定时任务的实现⽅式有多种。早期没有定时任务框架的时候,我们会使⽤JDK中的Timer机制和多线程机制(Runnable+线程休眠)来实现定时或者间隔⼀段时间执⾏某⼀段程序;后来有了定时任务框架,⽐ 如⼤名鼎鼎的Quartz任务调度框架,使⽤时间表达式(包括:秒、分、时、⽇、周、年)配置某⼀个任务什么时间去执⾏:

(一)任务调度框架Quartz回顾示意(我们课程主要内容不是Quartz)

1. 引入jar

<!--任务调度框架quartz-->

<!-- https://mvnrepository.com/artifact/org.quartz-scheduler/quartz -->

<dependency>

<groupId>org.quartz-scheduler</groupId>

<artifactId>quartz</artifactId>

<version>2.3.2</version>

</dependency>

2. 定时任务作业主调度程序

package quartz;

import org.quartz.*;

import org.quartz.impl.StdSchedulerFactory;

public class QuartzMan {

// 1、创建任务调度器(好比公交调度站)

public static Scheduler createScheduler() throws SchedulerException {

SchedulerFactory schedulerFactory = new StdSchedulerFactory();

Scheduler scheduler = schedulerFactory.getScheduler();

return scheduler;

}

// 2、创建一个任务(好比某一个公交车的出行)

public static JobDetail createJob() {

JobBuilder jobBuilder = JobBuilder.newJob(DemoJob.class); // TODO 自定义任务类

//设置任务的基本属性

jobBuilder.withIdentity("jobName","myJob");

JobDetail jobDetail = jobBuilder.build();

return jobDetail;

}

/**

* 3、创建作业任务时间触发器(类似于公交车出车时间表)

* cron表达式由七个位置组成,空格分隔

* 1、Seconds(秒) 0~59

* 2、Minutes(分) 0~59

* 3、Hours(小时) 0~23

* 4、Day of Month(天)1~31,注意有的月份不足31天

* 5、Month(月) 0~11,或者 JAN,FEB,MAR,APR,MAY,JUN,JUL,AUG,SEP,OCT,NOV,DEC

* 6、Day of Week(周) 1~7,1=SUN或者 SUN,MON,TUE,WEB,THU,FRI,SAT

* 7、Year(年)1970~2099 可选项

*示例:

* 0 0 11 * * ? 每天的11点触发执行一次

* 0 30 10 1 * ? 每月1号上午10点半触发执行一次

*/

public static Trigger createTrigger() {

// 创建时间触发器

CronTrigger cronTrigger = TriggerBuilder.newTrigger()

.withIdentity("triggerName","myTrigger")

.startNow()

//设置时间表达式:每隔2秒执行一次

.withSchedule(CronScheduleBuilder.cronSchedule("*/2 * * * * ?")).build();

return cronTrigger;

}

/**

* main函数中开启定时任务

* @param args

*/

public static void main(String[] args) throws SchedulerException {

// 1、创建任务调度器(好比公交调度站)

Scheduler scheduler = QuartzMan.createScheduler();

// 2、创建一个任务(好比某一个公交车的出行)

JobDetail job = QuartzMan.createJob();

// 3、创建任务的时间触发器(好比这个公交车的出行时间表)

Trigger trigger = QuartzMan.createTrigger();

// 4、使用任务调度器根据时间触发器执行我们的任务

scheduler.scheduleJob(job,trigger);

scheduler.start();

}

}

3. 定义⼀个job,需实现Job接⼝

package quartz;

import org.quartz.Job;

import org.quartz.JobExecutionContext;

import org.quartz.JobExecutionException;

public class DemoJob implements Job {

@Override

public void execute(JobExecutionContext jobExecutionContext) throws JobExecutionException {

System.out.println("我是一个定时任务执行逻辑");

}

}

以上,是回顾⼀下任务调度框架Quartz的⼤致⽤法,那么在分布式架构环境中使⽤Quartz已经不能更好的满⾜我们需求,我们可以使⽤专业的分布式调度框架,这⾥我们推荐使⽤Elastic-job。

五. 分布式调度框架Elastic-Job

(一)Elastic-Job介绍

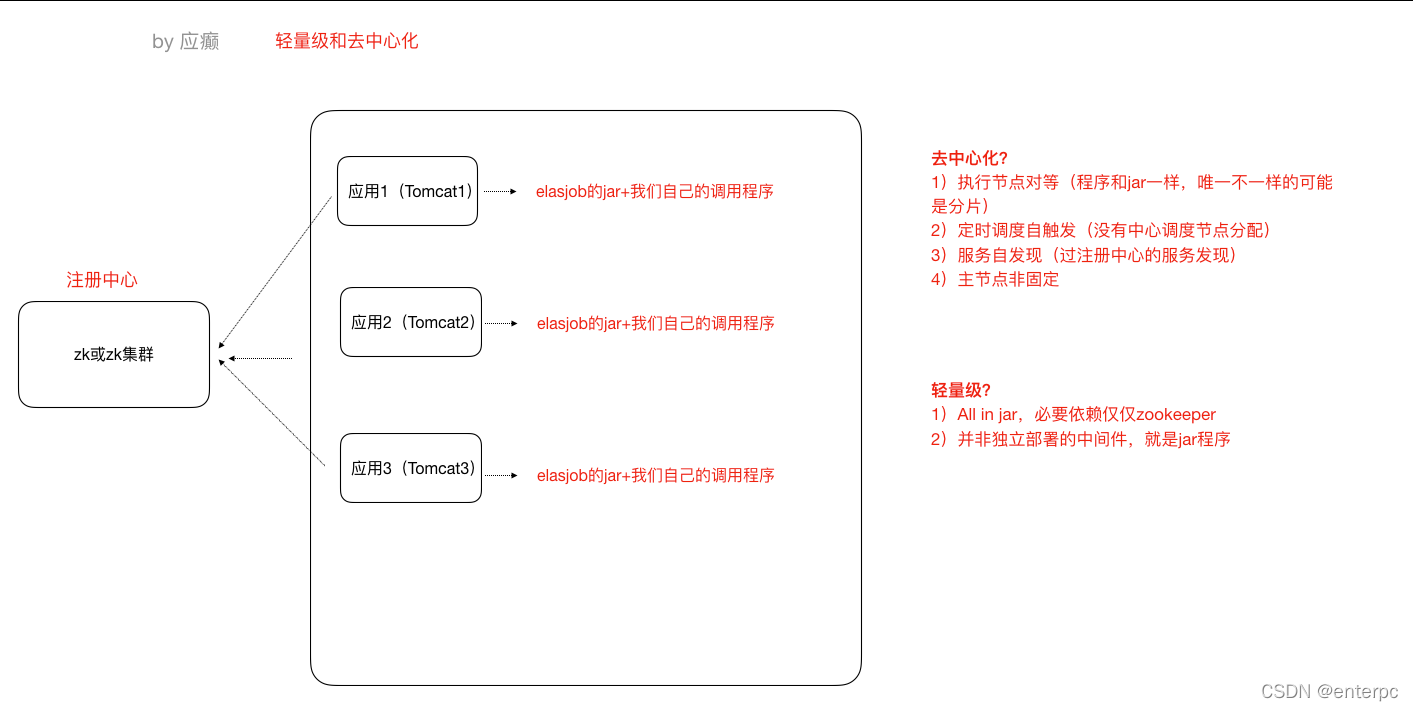

Elastic-Job是当当⽹开源的⼀个分布式调度解决⽅案,基于Quartz⼆次开发的,由两个相互独⽴的⼦项⽬Elastic-Job-Lite和Elastic-Job-Cloud组成。我们要学习的是 Elastic-Job-Lite,它定位为轻量级⽆中⼼ 化解决⽅案,使⽤Jar包的形式提供分布式任务的协调服务,⽽Elastic-Job-Cloud⼦项⽬需要结合Mesos 以及Docker在云环境下使⽤。

Elastic-Job的github地址:https://github.com/elasticjob

主要功能介绍:

- 分布式调度协调

- 在分布式环境中,任务能够按指定的调度策略执⾏,并且能够避免同⼀任务多实例重复执⾏

- 丰富的调度策略 基于成熟的定时任务作业框架Quartz cron表达式执⾏定时任务

- 弹性扩容缩容 当集群中增加某⼀个实例,它应当也能够被选举并执⾏任务;当集群减少⼀个实例时,它所执⾏的任务能被转移到别的实例来执⾏。

- 失效转移 某实例在任务执⾏失败后,会被转移到其他实例执⾏

- 错过执⾏作业重触发 若因某种原因导致作业错过执⾏,⾃动记录错过执⾏的作业,并在上次作业完成后⾃动触发。

- ⽀持并⾏调度 ⽀持任务分⽚,任务分⽚是指将⼀个任务分为多个⼩任务项在多个实例同时执⾏。

- 作业分⽚⼀致性 当任务被分⽚后,保证同⼀分⽚在分布式环境中仅⼀个执⾏实例

(二)Elastic-Job-Lite应⽤

jar包(API) + 安装zk软件

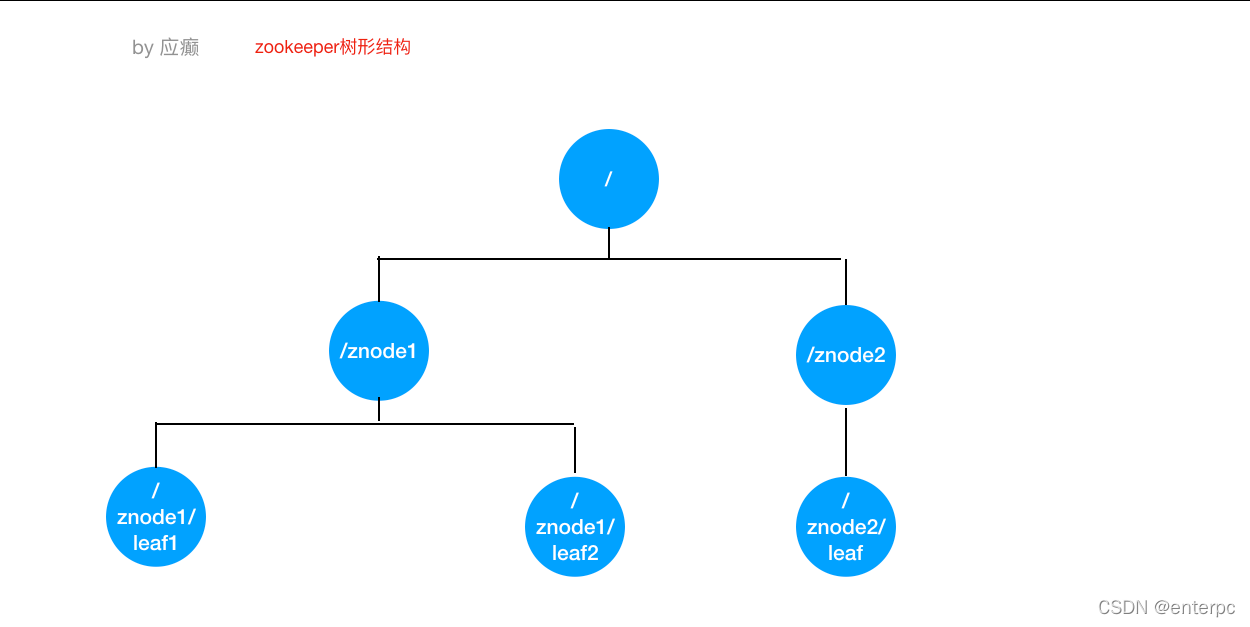

Elastic-Job依赖于Zookeeper进⾏分布式协调,所以需要安装Zookeeper软件(3.4.6版本以上),关于 Zookeeper,此处我们不做详解,在阶段三会有深度学习,我们此处需要明⽩Zookeeper的本质功能: 存储+通知。

1. 安装Zookeeper(此处单例配置)

我们使⽤3.4.10版本,在linux平台解压下载的zookeeper-3.4.10.tar.gz

2)进⼊conf⽬录,cp zoo_sample.cfg zoo.cfg

3) 进⼊bin⽬录,启动zk服务

启动 ./zkServer.sh start

停⽌ ./zkServer.sh stop

查看状态 ./zkServer.sh status

2. Zookeeper的树形节点结构图

3. 引入jar包

<!-- https://mvnrepository.com/artifact/com.dangdang/elastic-job-lite-core -->

<!--elastic-job-lite核心包-->

<dependency>

<groupId>com.dangdang</groupId>

<artifactId>elastic-job-lite-core</artifactId>

<version>2.1.5</version>

</dependency>

4. 定时任务实例

需求:每隔两秒钟执⾏⼀次定时任务(resume表中未归档的数据归档到resume_bak表中,

每次归档1条记录)

1)resume_bak和resume表结构完全⼀样

2)resume表中数据归档之后不删除,只将state置为"已归档"

数据

-- ----------------------------

-- Table structure for resume

-- ----------------------------

DROP TABLE IF EXISTS `resume`;

CREATE TABLE `resume` (

`id` bigint(20) NOT NULL AUTO_INCREMENT,

`name` varchar(255) DEFAULT NULL,

`sex` varchar(255) DEFAULT NULL,

`phone` varchar(255) DEFAULT NULL,

`address` varchar(255) DEFAULT NULL,

`education` varchar(255) DEFAULT NULL,

`state` varchar(255) DEFAULT NULL,

PRIMARY KEY (`id`)

) ENGINE=InnoDB AUTO_INCREMENT=1001 DEFAULT CHARSET=utf8;

SET FOREIGN_KEY_CHECKS = 1;

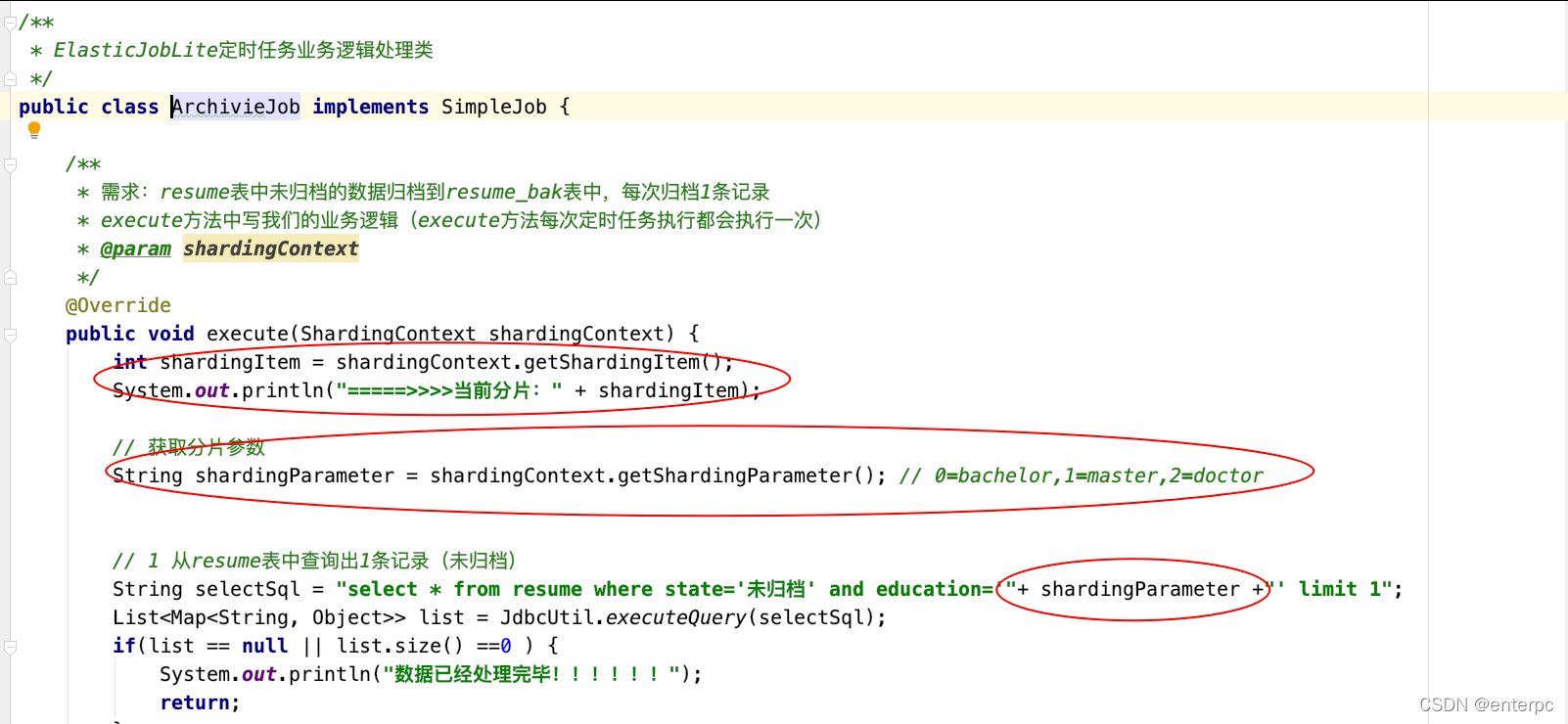

5. 定时任务类

package elasticjob;

import com.dangdang.ddframe.job.api.ShardingContext;

import com.dangdang.ddframe.job.api.simple.SimpleJob;

import java.util.List;

import java.util.Map;

/**

* ElasticJobLite定时任务业务逻辑处理类

*/

public class ArchivieJob implements SimpleJob {

/**

* 需求:resume表中未归档的数据归档到resume_bak表中,每次归档1条记录

* execute方法中写我们的业务逻辑(execute方法每次定时任务执行都会执行一次)

* @param shardingContext

*/

@Override

public void execute(ShardingContext shardingContext) {

//获取当前的分片

int shardingItem = shardingContext.getShardingItem();

System.out.println("=====>>>>当前分片:" + shardingItem);

// 获取分片参数shardingItemParameters("0=bachelor,1=master,2=doctor").build();在ElasticJobMain类中设置的

String shardingParameter = shardingContext.getShardingParameter(); // 0=bachelor,1=master,2=doctor

// 1 从resume表中查询出1条记录(未归档)

String selectSql = "select * from resume where state='未归档' and education='"+ shardingParameter +"' limit 1";

List<Map<String, Object>> list = JdbcUtil.executeQuery(selectSql);

if(list == null || list.size() ==0 ) {

System.out.println("数据已经处理完毕!!!!!!");

return;

}

// 2 "未归档"更改为"已归档"

Map<String, Object> stringObjectMap = list.get(0);

long id = (long) stringObjectMap.get("id");

String name = (String) stringObjectMap.get("name");

String education = (String) stringObjectMap.get("education");

System.out.println("=======>>>>id:" + id + " name:" + name + " education:" + education);

String updateSql = "update resume set state='已归档' where id=?";

JdbcUtil.executeUpdate(updateSql,id);

// 3 归档这条记录,把这条记录插入到resume_bak表

String insertSql = "insert into resume_bak select * from resume where id=?";

JdbcUtil.executeUpdate(insertSql,id);

}

}

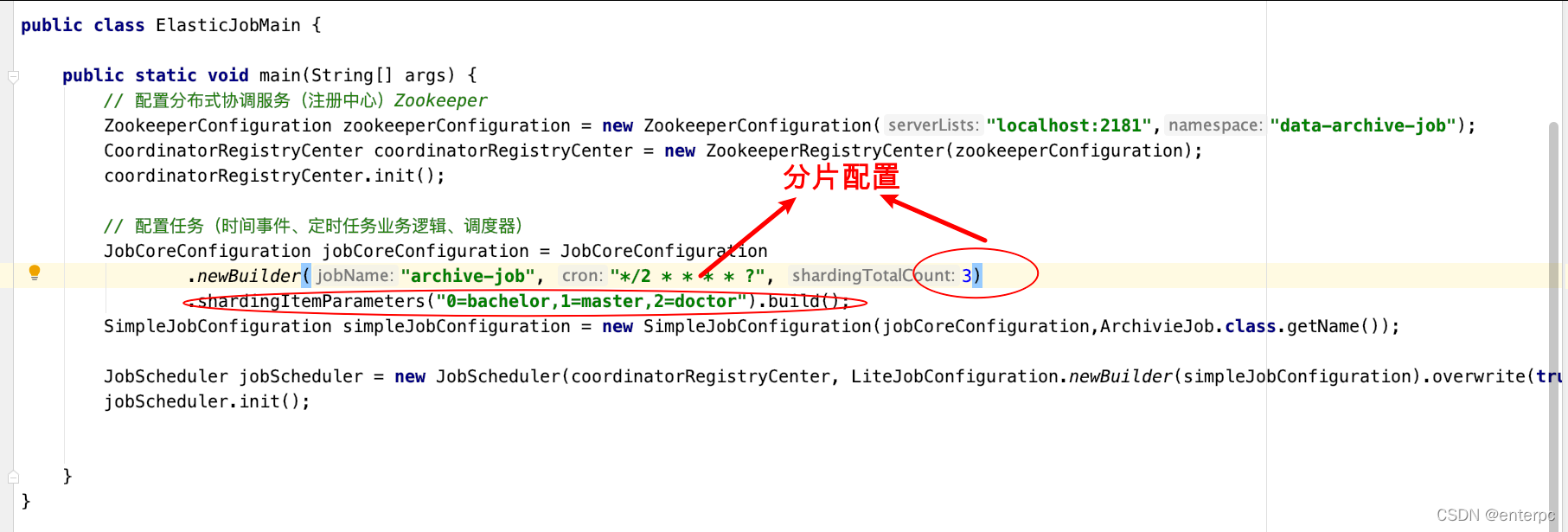

6. 主类

package elasticjob;

import com.dangdang.ddframe.job.config.JobCoreConfiguration;

import com.dangdang.ddframe.job.config.simple.SimpleJobConfiguration;

import com.dangdang.ddframe.job.lite.api.JobScheduler;

import com.dangdang.ddframe.job.lite.config.LiteJobConfiguration;

import com.dangdang.ddframe.job.reg.base.CoordinatorRegistryCenter;

import com.dangdang.ddframe.job.reg.zookeeper.ZookeeperConfiguration;

import com.dangdang.ddframe.job.reg.zookeeper.ZookeeperRegistryCenter;

public class ElasticJobMain {

public static void main(String[] args) {

// 配置分布式协调服务(注册中心)Zookeeper

ZookeeperConfiguration zookeeperConfiguration = new ZookeeperConfiguration("192.168.200.128:2181","data-archive-job");

CoordinatorRegistryCenter coordinatorRegistryCenter = new ZookeeperRegistryCenter(zookeeperConfiguration);

coordinatorRegistryCenter.init();

// 配置任务(时间事件、定时任务业务逻辑、调度器)

JobCoreConfiguration jobCoreConfiguration = JobCoreConfiguration

.newBuilder("archive-job", "*/2 * * * * ?", 3)

.shardingItemParameters("0=bachelor,1=master,2=doctor").build();

SimpleJobConfiguration simpleJobConfiguration = new SimpleJobConfiguration(jobCoreConfiguration,ArchivieJob.class.getName());

//这里加overwrite(true)的时候当重写上面的配置信息时会重写进zookeeper中

JobScheduler jobScheduler = new JobScheduler(coordinatorRegistryCenter, LiteJobConfiguration.newBuilder(simpleJobConfiguration).overwrite(true).build());

jobScheduler.init();

}

}

7. JdbcUtil⼯具类

package elasticjob;

import java.sql.*;

import java.util.ArrayList;

import java.util.HashMap;

import java.util.List;

import java.util.Map;

public class JdbcUtil {

//url

private static String url = "jdbc:mysql://192.168.200.128:3306/jpa?characterEncoding=utf8&useSSL=false";

//user

private static String user = "root";

//password

private static String password = "PcPc@123";

//驱动程序类

private static String driver = "com.mysql.jdbc.Driver";

static {

try {

Class.forName(driver);

} catch (ClassNotFoundException e) {

// TODO Auto-generated catch block

e.printStackTrace();

}

}

public static Connection getConnection() {

try {

return DriverManager.getConnection(url, user, password);

} catch (SQLException e) {

// TODO Auto-generated catch block

e.printStackTrace();

}

return null;

}

public static void close(ResultSet rs, PreparedStatement ps, Connection con) {

if (rs != null) {

try {

rs.close();

} catch (SQLException e) {

// TODO Auto-generated catch block

e.printStackTrace();

} finally {

if (ps != null) {

try {

ps.close();

} catch (SQLException e) {

// TODO Auto-generated catch block

e.printStackTrace();

} finally {

if (con != null) {

try {

con.close();

} catch (SQLException e) {

// TODO Auto-generated catch block

e.printStackTrace();

}

}

}

}

}

}

}

/***

* DML操作(增删改)

* 1.获取连接数据库对象

* 2.预处理

* 3.执行更新操作

* @param sql

* @param obj

*/

//调用者只需传入一个sql语句,和一个Object数组。该数组存储的是SQL语句中的占位符

public static void executeUpdate(String sql,Object...obj) {

Connection con = getConnection();//调用getConnection()方法连接数据库

PreparedStatement ps = null;

try {

ps = con.prepareStatement(sql);//预处理

for (int i = 0; i < obj.length; i++) {//预处理声明占位符

ps.setObject(i + 1, obj[i]);

}

ps.executeUpdate();//执行更新操作

} catch (SQLException e) {

// TODO Auto-generated catch block

e.printStackTrace();

} finally {

close(null, ps, con);//调用close()方法关闭资源

}

}

/***

* DQL查询

* Result获取数据集

*

* @param sql

* @param obj

* @return

*/

public static List<Map<String,Object>> executeQuery(String sql, Object...obj) {

Connection con = getConnection();

ResultSet rs = null;

PreparedStatement ps = null;

try {

ps = con.prepareStatement(sql);

for (int i = 0; i < obj.length; i++) {

ps.setObject(i + 1, obj[i]);

}

rs = ps.executeQuery();

//new 一个空的list集合用来存放查询结果

List<Map<String, Object>> list = new ArrayList<>();

//获取结果集的列数

int count = rs.getMetaData().getColumnCount();

//对结果集遍历每一条数据是一个Map集合,列是k,值是v

while (rs.next()) {

//一个空的map集合,用来存放每一行数据

Map<String, Object> map = new HashMap<String, Object>();

for (int i = 0; i < count; i++) {

Object ob = rs.getObject(i + 1);//获取值

String key = rs.getMetaData().getColumnName(i + 1);//获取k即列名

map.put(key, ob);

}

list.add(map);

}

return list;

} catch (SQLException e) {

// TODO Auto-generated catch block

e.printStackTrace();

} finally {

close(rs, ps, con);

}

return null;

}

}

(四)Elastic-Job-Lite轻量级去中⼼化的特点

如何理解轻量级和去中⼼化?

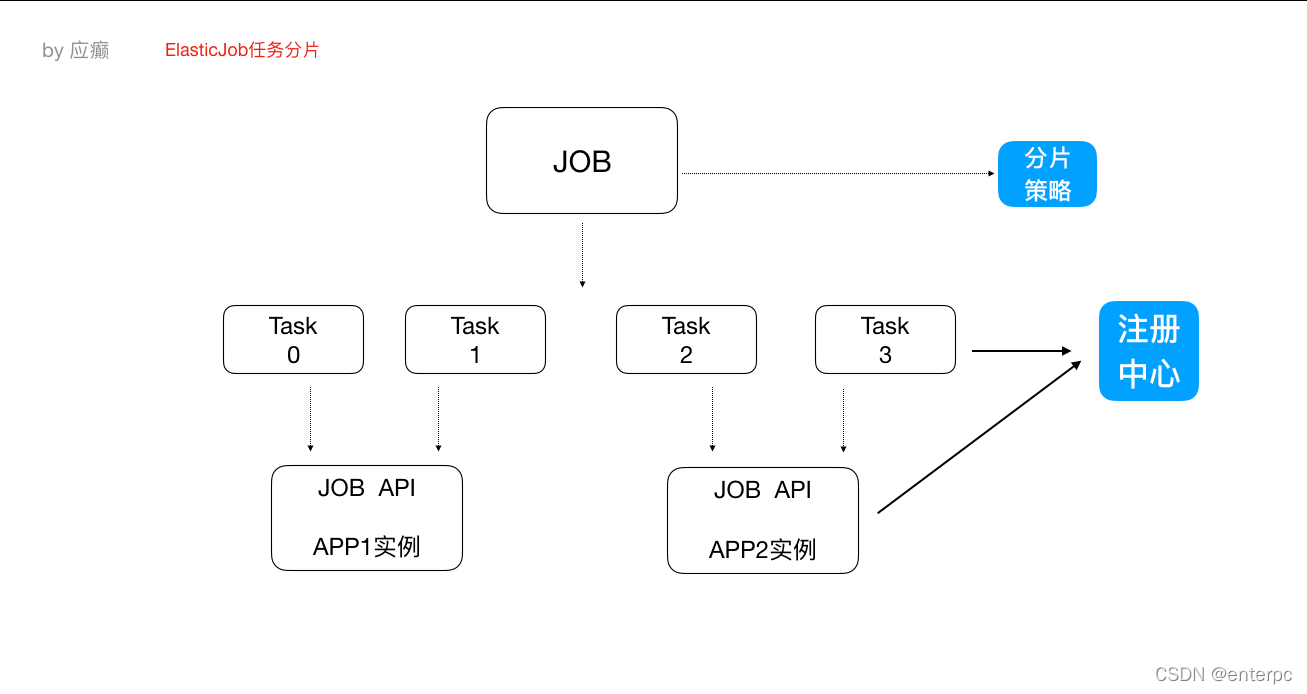

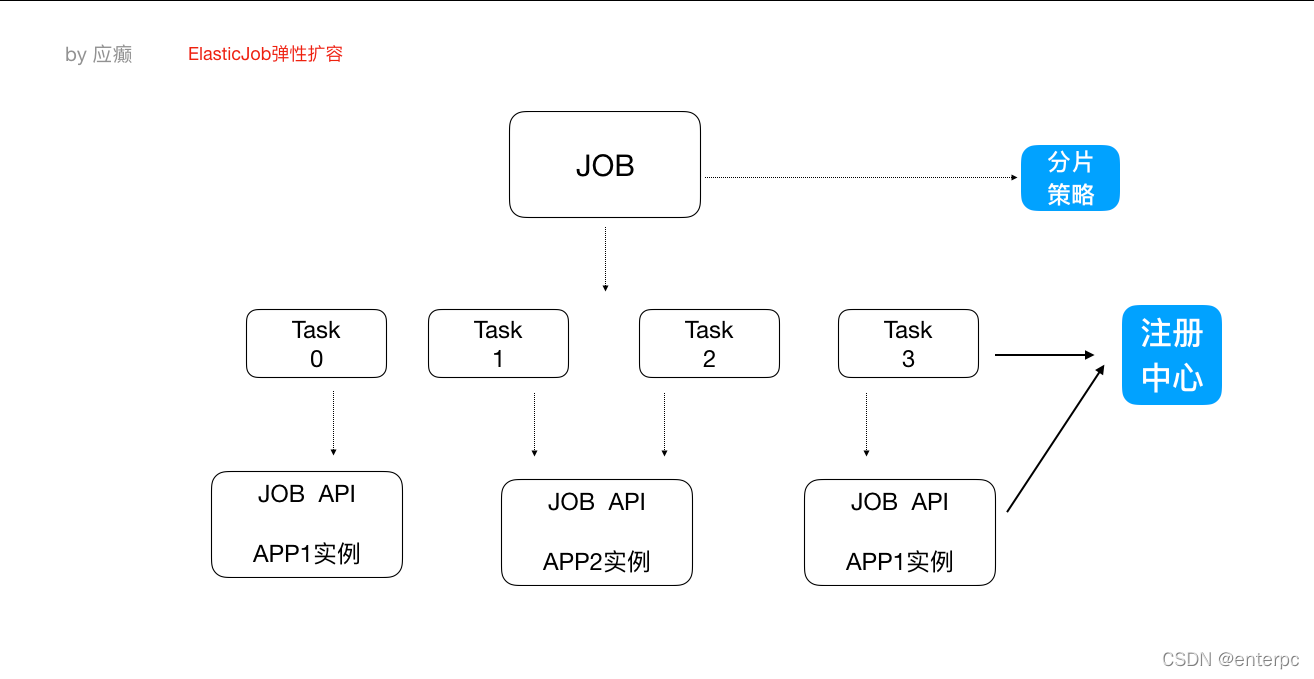

(五)任务分⽚

⼀个⼤的⾮常耗时的作业Job,⽐如:⼀次要处理⼀亿的数据,那这⼀亿的数据存储在数据库中,如果⽤⼀个作业节点处理⼀亿数据要很久,在互联⽹领域是不太能接受的,互联⽹领域更希望机器的增加去 横向扩展处理能⼒。所以,ElasticJob可以把作业分为多个的task(每⼀个task就是⼀个任务分⽚),每 ⼀个task交给具体的⼀个机器实例去处理(⼀个机器实例是可以处理多个task的),但是具体每个task 执⾏什么逻辑由我们⾃⼰来指定。

Strategy策略定义这些分⽚项怎么去分配到各个机器上去,默认是平均去分,可以定制,⽐如某⼀个机器负载 ⽐较⾼或者预配置⽐较⾼,那么就可以写策略。分⽚和作业本身是通过⼀个注册中⼼协调的,因 为在分布式环境下,状态数据肯定集中到⼀点,才可以在分布式中沟通。

分⽚代码

(六)弹性扩容

新增加⼀个运⾏实例app3,它会⾃动注册到注册中⼼,注册中⼼发现新的服务上线,注册中⼼会通知ElasticJob 进⾏重新分⽚,那么总得分⽚项有多少,那么就可以搞多少个实例机器,⽐如完全可以分 1000⽚ 最多就可以有多少app实例,,,,机器能成的主,完全可以分1000⽚

那么就可以搞1000台机器⼀起执⾏作业。

注意:

1)分⽚项也是⼀个JOB配置,修改配置,重新分⽚,在下⼀次定时运⾏之前会重新调⽤分⽚算法,那么这个分⽚算法的结果就是:哪台机器运⾏哪⼀个⼀⽚,这个结果存储到zk中的,主节点会把分⽚给分好 放到注册中⼼去,然后执⾏节点从注册中⼼获取信息(执⾏节点在定时任务开启的时候获取相应的分 ⽚)。

2)如果所有的节点挂掉值剩下⼀个节点,所有分⽚都会指向剩下的⼀个节点,这也是ElasticJob的⾼可⽤。

分布式定时任务实践

分布式定时任务实践

168万+

168万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?