前面讲Hadoop的时候已经说了大数据的整个生态就是围绕存储采集、存储、计算进行的,今天要说的就是“计算”,目前分离线计算和实时计算,这两大块分别诞生了像Spark和Flink两大Super Star框架,这两大框架的初衷Spark定位于离线计算,Flink定位于实时计算,但随着业务的发展,也是为了市场的占有,二者分别开始蚕食对方的领域,各自在自身的体系架构中融入了实时和离线计算,大有一统江湖之意。

1.Flink的安装和配置

去官网下载Flink安装包,放到虚拟机的某个目录下。

用下面的命令解压:

tar -zxvf apache-flink-1.9.3.tar.gz修改配置,打开 /conf/flink-conf.yaml

jobmanager.rpc.address: localhost

rest.port: 8081根据自身情况修改这两个属性,第一个是jobmanager的地址,可以改成你的实际IP地址,第二个是Flink的Web客户端的端口号,如果默认的8081没有用,那就不用改,如果被占用,就改成其他的。

设置环境变量,打开 /etc/profile,增加:

export FLINK_HOME=/usr/local/flink-1.9.0/

export PATH=$PATH:$FLINK_HOME/bin用 source命令让环境变量生效。

进入flink安装目录的bin目录,输入下面的命令启动flink:

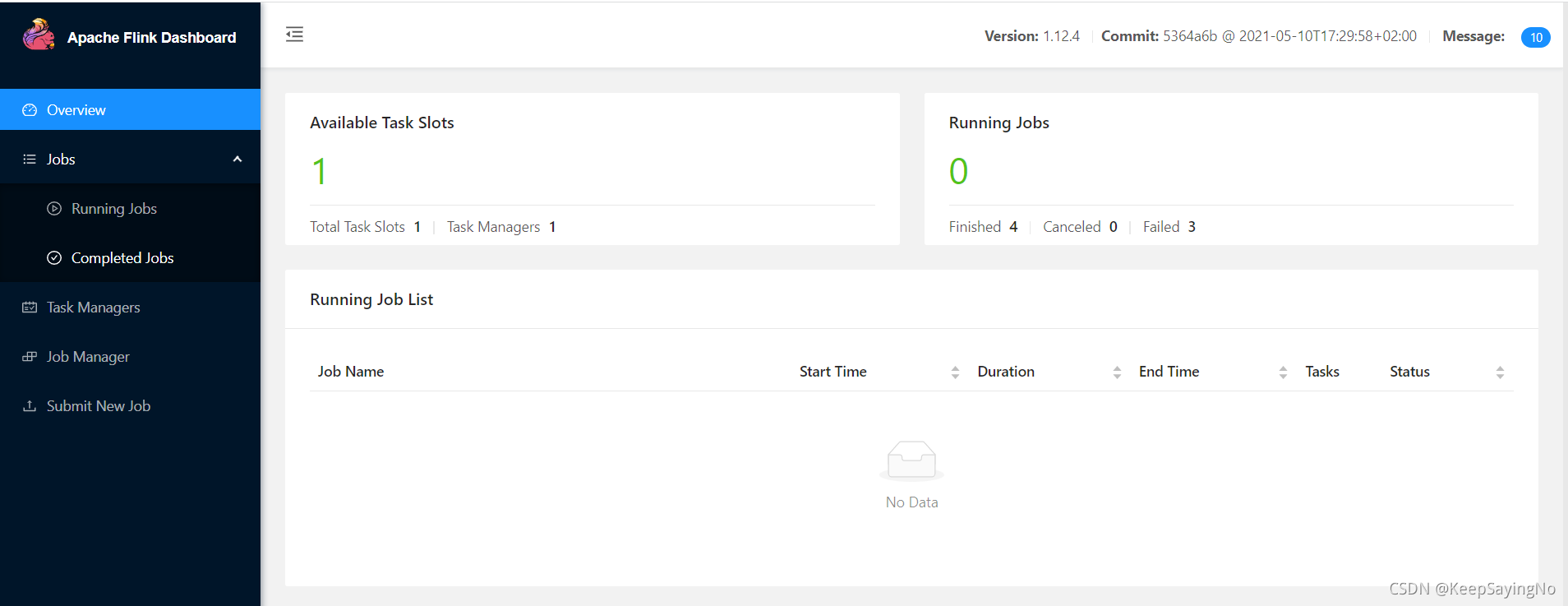

./start-cluster.sh在你的电脑的浏览器中敲下面的地址就可以访问Flink Web UI

http://192.136.11.100:8081/

2.任务提交

flink的安装目录下的/examples目录下提供了丰富的例子,首先以经典WordCount为例,在flink的根目录下执行下面的命令:

./bin/flink run ./examples/streaming/WordCount.jar虚拟机会打印下面的信息:

Executing WordCount example with default input data set.

Use --input to sp

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1586

1586

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?