安装包

pip install scrapy

pip install scrapyd

pip install scrapyd-client

pip install spiderkeeper进入到scrapy项目的根目录:

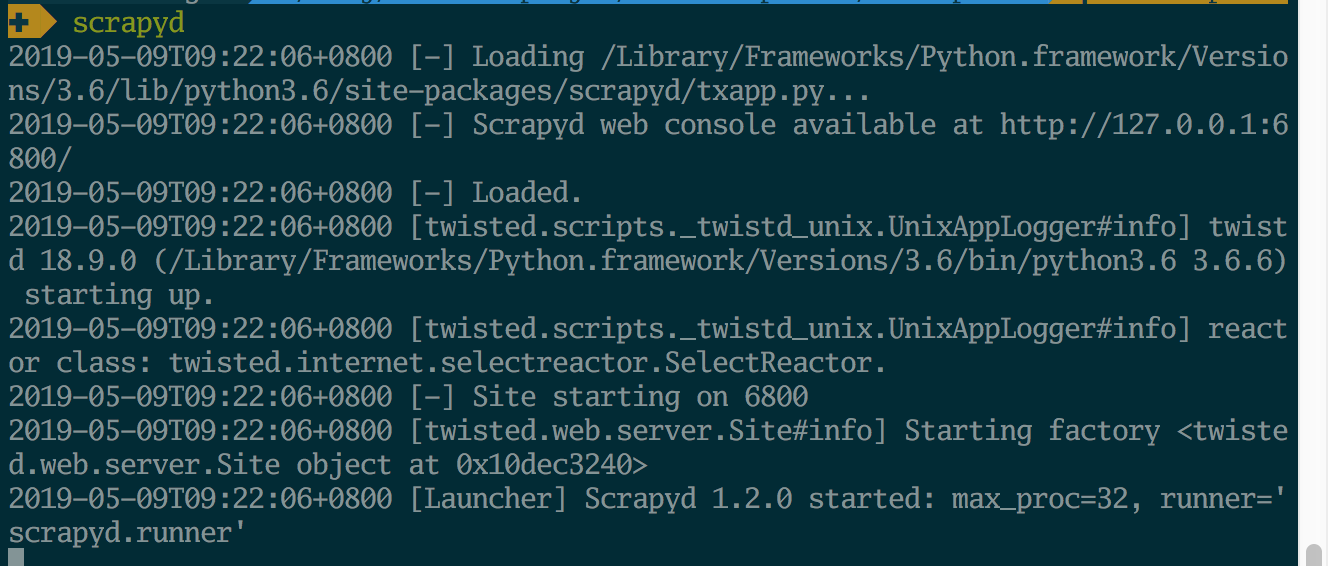

运行scrapyd

scrapyd如果不出错就会生成一个scrapyd的服务。

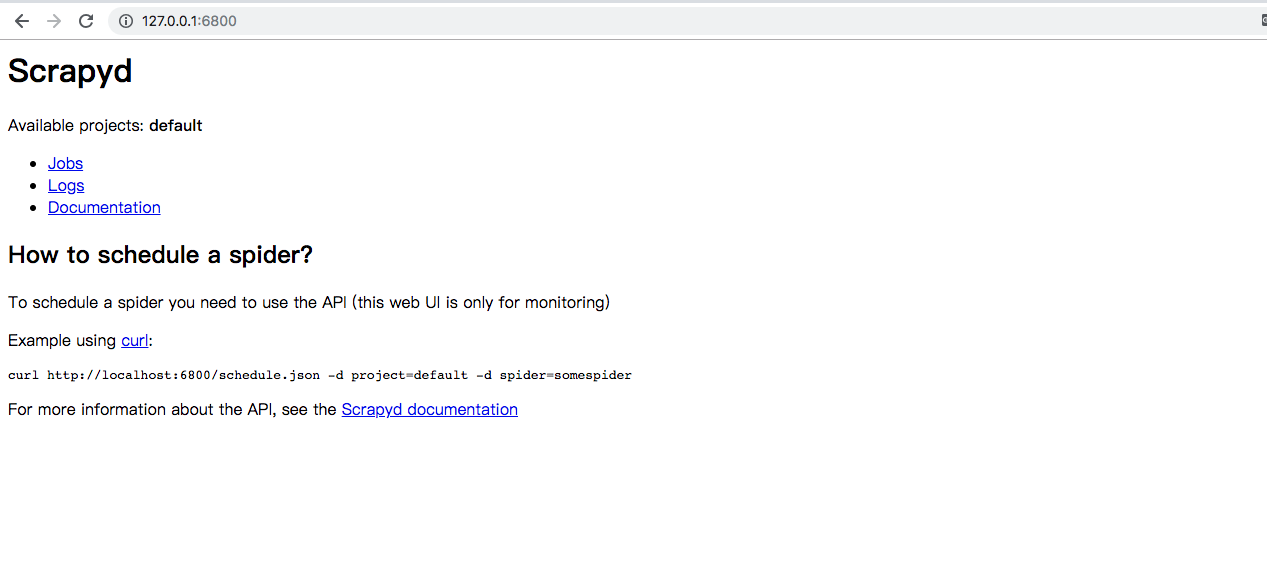

打开对应页面

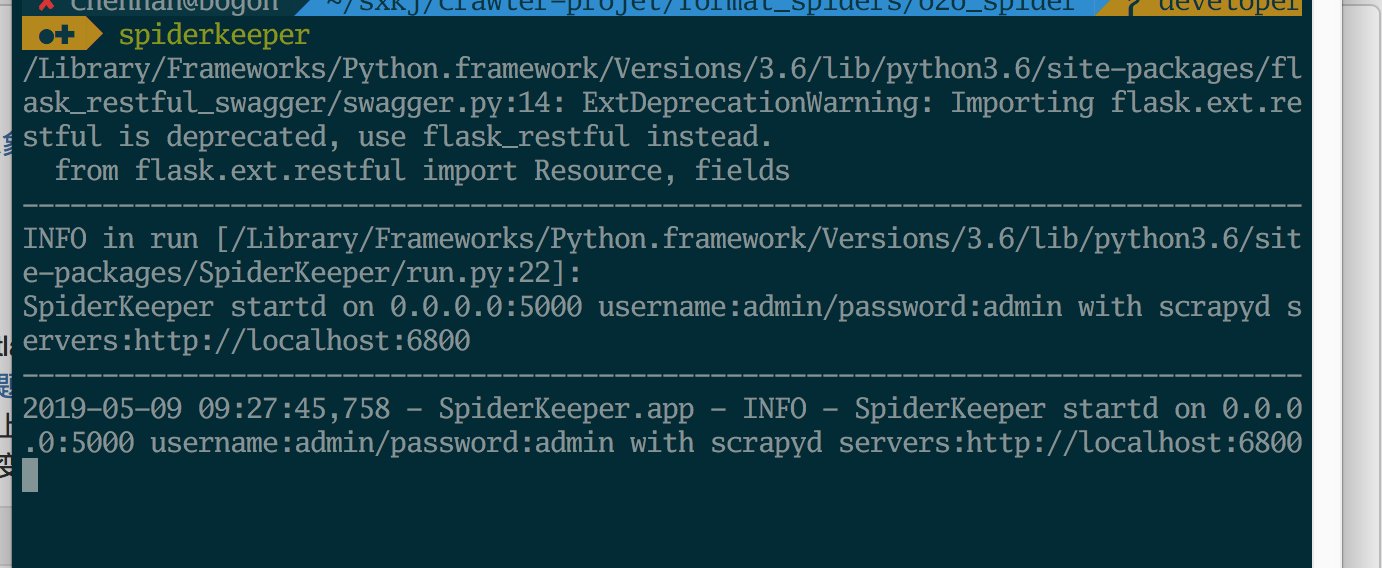

再另起窗口执行spiderkeeper命令

spiderkeeper

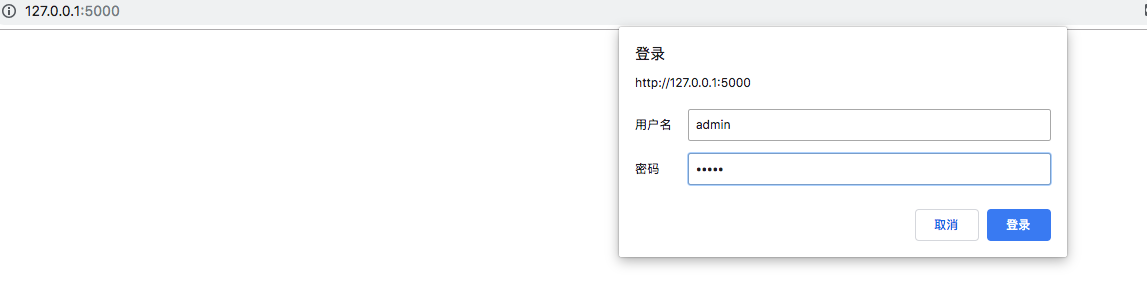

打开spiderkeeper的页面

默认用户名:admin

密码:admin

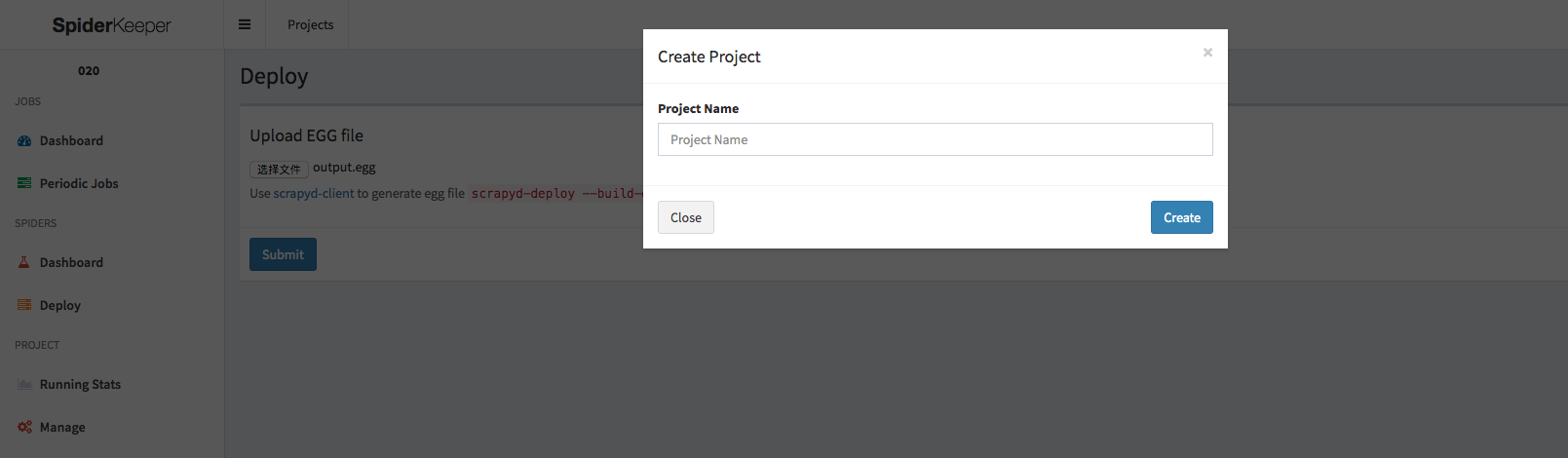

创建项目

点击Projects-》Create Project

打包egg文件

在scrapy的项目根目录,也就是和setting.py一个等级.

scrapyd-deploy -p chahao -v 1.0 --build-egg chahao.egg-p后面加的是项目的名字,也就是scrapy爬虫文件的name,后面的内容可以不管,注意最后.egg的文件名规范就行。

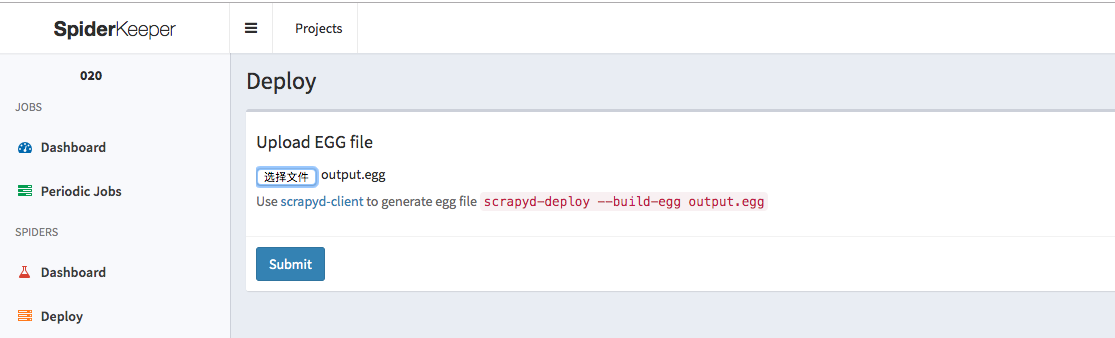

点击deploy上传项目

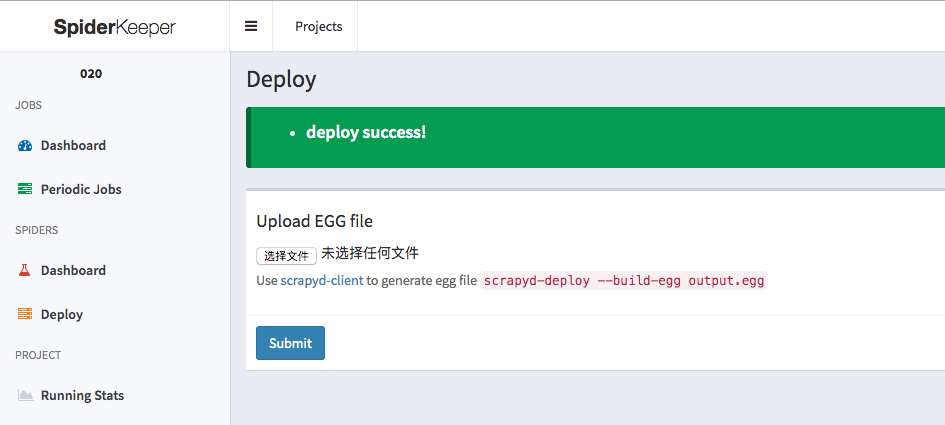

提交以后看到部署成功即可。

执行项目

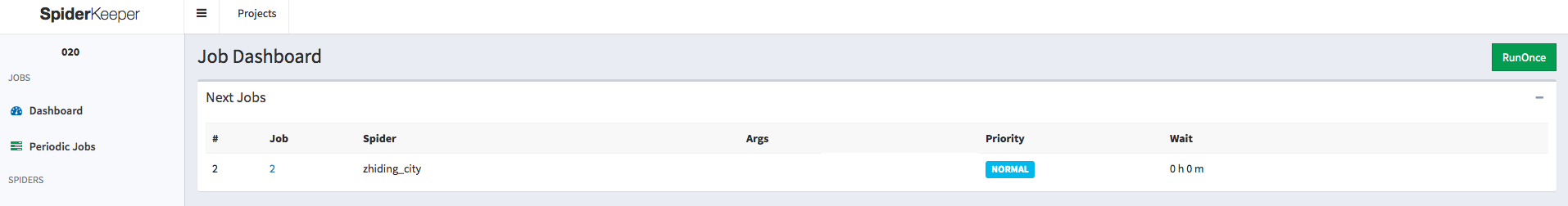

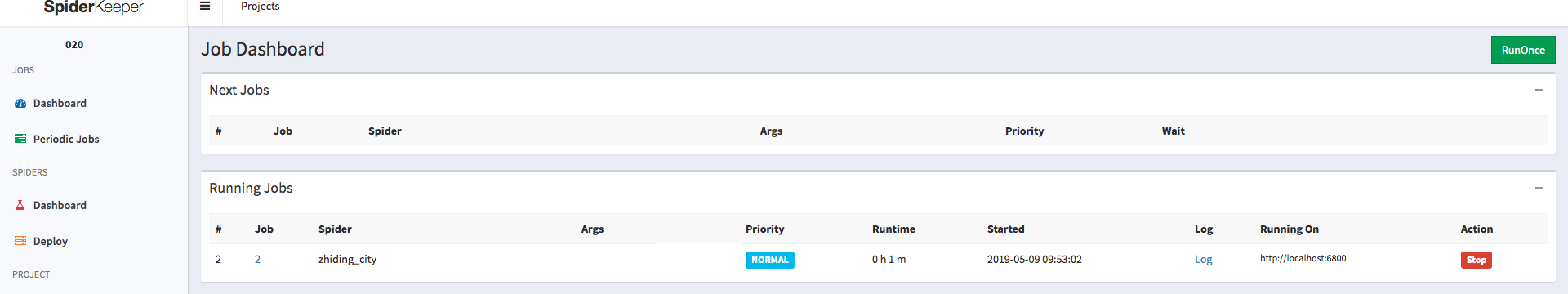

点击Dashboard然后点击Runonce选择对于的爬虫文件运行即可。

成功之后就可以看到上图的情况,刷新页面

可以查看爬虫的日志和运行状态,点击stop即可停止运行爬虫。

遇到坑

坑1:

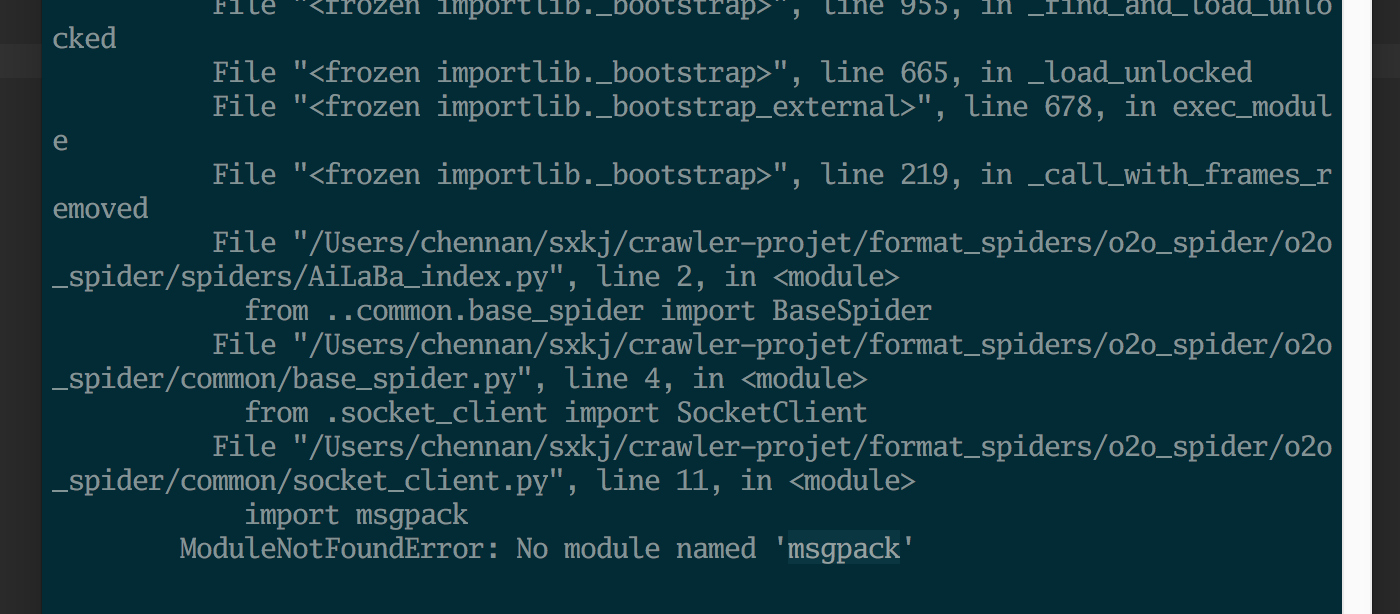

提交完了之后,运行文件看不到东西。

看后台发现scrapyd出错了,错误如下

可知原因是项目中没有安装msgpack这个包,安装即可,通过这个错误可以知道,在提交项目到spiderkeeper对应的机器时

需要保证该机器的环境能正常运行程序。

本文介绍如何使用pip安装Scrapy及相关的辅助工具,并通过SpiderKeeper进行项目的部署与管理。详细步骤包括创建项目、打包egg文件、上传并运行爬虫。

本文介绍如何使用pip安装Scrapy及相关的辅助工具,并通过SpiderKeeper进行项目的部署与管理。详细步骤包括创建项目、打包egg文件、上传并运行爬虫。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?