大家好,在现代科技发展的背景下,机器学习任务对分布式计算的依赖日益加深。这些任务包括网络训练、超参数调优、模型部署和数据处理等,都对计算资源有着巨大的需求。缺乏集群计算支持,会导致这些任务处理速度缓慢,严重降低工作效率。

Ray这一分布式计算框架的出现,为解决计算瓶颈提供了有效途径。它专为Python语言设计,并且能够与PyTorch等深度学习库无缝协作,提升机器学习应用的开发速度和部署效率。

本文将介绍Ray生态系统的核心元素以及如何将其与PyTorch配合使用。

1.Ray简介

Ray是一个开源的Python库,专注于并行和分布式计算。

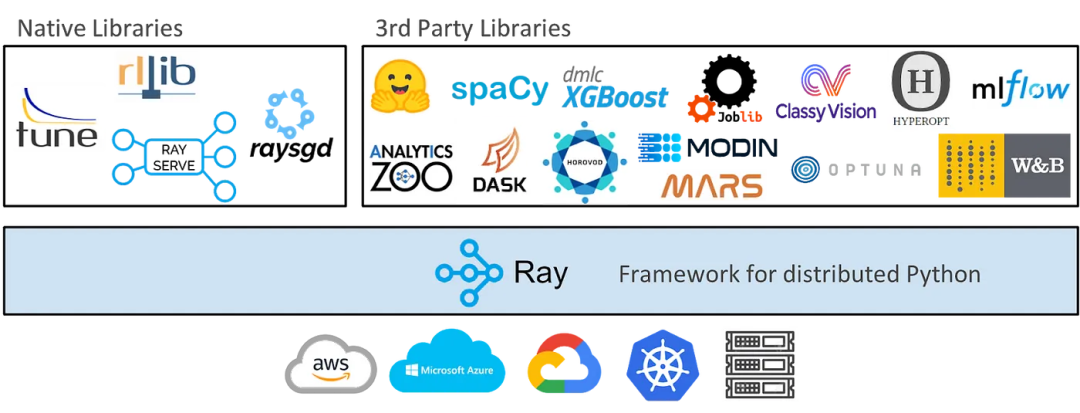

上图展示了从宏观角度观察,Ray的生态系统主要由三个关键部分组成:

1) Ray系统的核心:提供基础的并行和分布式计算能力

2) 可扩展的机器学习库:包括Ray团队开发的原生库,也包括社区贡献的第三方库。

3) 工具:用于在各种集群环境或云服务上轻松启动和管理集群。

这样的架构设计使Ray能够灵活适应不同的计算需求和环境,为用户提供强大的计算支持。

2.Ray的核心优势

Ray框架能够让Python应用程序在多个CPU核心或计算机上并行运行,显著提高了处理速度和计算效率。以下是Ray的主要优势:

-

简单性:不用重构代码,即可实现扩展Python应用程序,无论是在单机还是多台机器环境。

-

稳健性:即便面临硬件故障或任务抢占,应用仍能稳定运行,不受影响。

-

高性能:任务执行延迟低至毫秒级,可以扩展到数万个核心,同时在处理数值数据时保持低序列化开销。

3.库生态系统

由于Ray框架具有通用性,开发者社区已在其基础上开发出众多库和工具,用以应对各种不同的计算任务。这些库大多数都能与PyTorch兼容,且对原有代码的改动极小,实现了各个库之间的无缝集成。以下是Ray生态系统中众多库的若干示例。

3.1 RaySGD

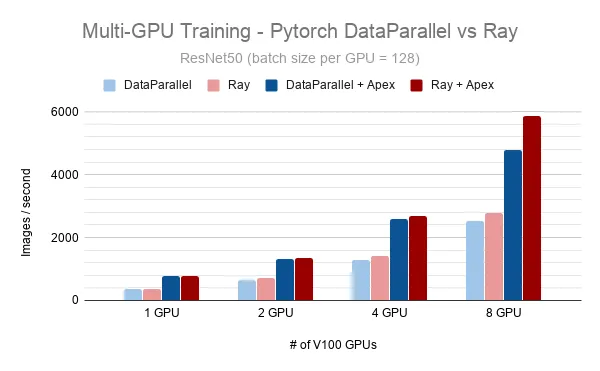

PyTorch的DataParallel与Ray在p3dn.24xlarge实例上的比较

RaySGD是一个专为数据并行训练提供分布式训练封装工具的库,旨在简化并加速训练流程。例如,RaySGD TorchTrainer是围绕torch.distributed.launch的封装器,通过提供Python API,可以将分布式训练集成到更广泛的Python应用中。这样一来,开发者无需将训练代码嵌入到复杂的bash脚本里,便能实现训练的分布式运行。

此外,RaySGD库还具备以下优势:

-

易用性:无需密切监控各个计算节点,即可扩展PyTorch的DistributedDataParallel。

-

可扩展性:支持从单一CPU到多节点、多CPU和多GPU集群的灵活扩展,仅需简单修改几行代码。

-

加速训练:内置支持使用NVIDIA Apex进行混合精度训练。

-

容错性:当云计算资源被抢占时,能够自动进行恢复。

-

兼容性:与其他库如Ray Tune和Ray Serve无缝集成。

可以通过安装Ray(pip install -U ray torch)并运行以下代码来开始使用TorchTrainer:

import torch

from torch.utils.data import DataLoader

from torchvision.datasets import C

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

47

47

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?